- OLED TV topic

- Projektor topic

- Sony MILC fényképezőgépcsalád

- Apple MacBook

- Végre feketében pózol a Noctua legkomolyabb 120 mm-es ventilátora

- AMD K6-III, és minden ami RETRO - Oldschool tuning

- Milyen széket vegyek?

- Gaming notebook topik

- A Linux megnégyszerezte magát a Steamen — a Microsoft ismét ígérget

- Fejhallgató erősítő és DAC topik

-

51787 - 51701

51787 - 51701 51700 - 51601 51600 - 51501 51500 - 51401 51400 - 51301 51300 - 51201 51200 - 51101 51100 - 51001 51000 - 50901 50900 - 50801 50800 - 50701 50700 - 50601 50600 - 50501 50500 - 50401 50400 - 50301 50300 - 50201 50200 - 50101 50100 - 50001 50000 - 48001 48000 - 46001 46000 - 44001 44000 - 42001 42000 - 40001 40000 - 38001 38000 - 36001 36000 - 34001 34000 - 32001 32000 - 30001 30000 - 28001 28000 - 26001 26000 - 24001 24000 - 22001 22000 - 20001 20000 - 18001 18000 - 16001 16000 - 14001 14000 - 12001 12000 - 10001 10000 - 8001 8000 - 6001 6000 - 4001 4000 - 2001 2000 - 1

-

Fórumok

PROHARDVER! - hardver fórumok

Notebookok TV & Audió Digitális fényképezés Alaplapok, chipsetek, memóriák Processzorok, tuning Hűtés, házak, tápok, modding Videokártyák Monitorok Adattárolás Multimédia, életmód, 3D nyomtatás Nyomtatók, szkennerek Tabletek, E-bookok PC, mini PC, barebone, szerver Beviteli eszközök Egyéb hardverek PROHARDVER! BlogokMobilarena - mobil fórumok

Okostelefonok Mobiltelefonok Okosórák Autó+mobil Üzlet és Szolgáltatások Mobilalkalmazások Tartozékok, egyebek Mobilarena blogokIT café - infotech fórumok

Infotech Hálózat, szolgáltatók OS, alkalmazások SzoftverfejlesztésGAMEPOD - játék fórumok

PC játékok Konzol játékok MobiljátékokLOGOUT - lépj ki, lépj be!

LOGOUT reakciók Monologoszféra FototrendFÁRADT GŐZ - közösségi tér szinte bármiről

Tudomány, oktatás Sport, életmód, utazás, egészség Kultúra, művészet, média Gazdaság, jog Technika, hobbi, otthon Társadalom, közélet Egyéb Lokál PROHARDVER! interaktív

Új hozzászólás Aktív témák

-

Alogonomus

őstag

Alogonomus

őstag

A kínai hatóságok legfeljebb azt a csempészt üldözik, aki nem a kínai kormányzat számára csempészi a kártyát. Amíg a legjobb kínai saját GPU is több generációnyi lemaradásban van az Nvidia és az AMD megoldásaihoz képest, addig a kínai kormányzatnak szüksége van a két nagy gyártó termékeire, ha ésszerű keretek között szeretne számítástechnikai rendszereket üzemeltetni a kormányzati/kutatási céljai kiszolgálására.

Az otthoni felhasználók esetében pedig aki korábban hajlandó volt a nyugati világban 4-5 ezer dollárért árult 5090-ért a kínai belpiacon mondjuk 6-7 ezer dollárnyi összeget kiadni, az akkor várhatóan a nagyon megnehezített csempészés miatt mondjuk további 1-2 ezer dollárral megemelt árat is kifizeti a kártyáért, mert kell neki a kártya.

-

S_x96x_S

addikt

S_x96x_S

addikt

Ez mondjuk tényleg csak diplomáciai üzengetési célú lényegtelen tiltás, mert amelyik kínai emberkének kell egy 5090, az úgyis egy Kínába becsempészett – vagy eleve a kínai összeszerelő üzemből "eltűnt" – teljes értékű 5090-et szerez be.

a probléma,

hogy most már az USA és a Kínai hatóságok is üldözik a csempészeket.

Vagyis a csempészett GPU

- kockázata extrém módon megnött

- a behoztott mennyiség a tizedére eshetett és ami elérhető a szürke piacon az extrém módon megdrágulhatott.. -

Alogonomus

őstag

Alogonomus

őstag

"China Slams the Door on NVIDIA’s RTX 5090 D v2,

Refusing Import Permits for a GPU Built Exclusively for Its Own Market"

https://wccftech.com/china-slams-door-on-nvidia-rtx-5090-d-v2-refusing-import-permits-for-a-gpu-built-exclusively-for-its-own-market/Ez mondjuk tényleg csak diplomáciai üzengetési célú lényegtelen tiltás, mert amelyik kínai emberkének kell egy 5090, az úgyis egy Kínába becsempészett – vagy eleve a kínai összeszerelő üzemből "eltűnt" – teljes értékű 5090-et szerez be.

-

S_x96x_S

addikt

S_x96x_S

addikt

"China Slams the Door on NVIDIA’s RTX 5090 D v2,

Refusing Import Permits for a GPU Built Exclusively for Its Own Market"

https://wccftech.com/china-slams-door-on-nvidia-rtx-5090-d-v2-refusing-import-permits-for-a-gpu-built-exclusively-for-its-own-market/ -

Abu85

HÁZIGAZDA

Abu85

HÁZIGAZDA

Mindig bedobsz valami addig nem emlegetett dolgot magyarázatként!

Utánanéztem, az FSR Swapchain a frame pacinghez kell a kép generálás során. Ezért lehet gond Nvidián, de például én nem tapasztaltam hibát Stalker 2-ben, amikor bekapcsoltam 3060 Ti-n az FSR FG-t. Lehet, hogy a GSC valamit jól csinált implementáláskor?

Ideális esetben minden játéknak szállítania kell a megfelelő swapchaint. De ez önmagában még nem jelent semmit, mert van úgy, hogy ezt visszautasítja a driver, és akkor betölti a játék a default swapchaint. Ezek általában abból erednek, hogy valami problémát tapasztalt vele a stúdió vagy a gyártó, és javítás helyett azt választották, hogy letiltják a hibákat produkáló hardverekre.

-

S_x96x_S

addikt

S_x96x_S

addikt

Űrverseny.

Az nvidia és az amd is más stratégiával közelit.

https://marketwise.com/investing/nvidia-vs-amd-who-will-win-orbital-ai-space-race/---

NVIDIA Launches Space Computing, Rocketing AI Into Orbit

- Engineered for size-, weight- and power-constrained environments, NVIDIA Space-1 Vera Rubin Module, IGX Thor and Jetson Orin platforms deliver data-center-class performance and edge AI inferencing for orbital data centers, geospatial intelligence and autonomous space operations.

- Aetherflux, Axiom Space, Kepler Communications, Planet Labs PBC, Sophia Space and Starcloud are using NVIDIA accelerated computing platforms to power next-generation space missions.

---

Az AMD-nek főleg a XILINX -től örökölt ( és alaposan kitesztelt ) sugárzásálló FPGA chipjei vannak az űrbéli működésre.

amd: AI in Space: Start at the Edge, Build for the Mission

https://www.amd.com/en/solutions/aerospace-and-defense/space.html

---és persze ott van még a SpaceX és a Google is.

-

S_x96x_S

addikt

S_x96x_S

addikt

Egyenlőre még mindig büntiben van az nvidia Kínában.

"10 Chinese firms have U.S. approval to buy H200s, but Beijing won't let them."

"President Donald Trump said on Friday that Beijing is refusing to let Chinese companies buy Nvidia's H200 AI chips."

https://www.tomshardware.com/tech-industry/trump-says-china-is-blocking-h200-purchases -

Yutani

nagyúr

Yutani

nagyúr

Nem ismeri a GeForce driver az FSR swapchaint, ami kell az FSR framegennek. Helyette betölti a Windows default swapchaint. Ezt egyébként az NVIDIA tudja javítani, mert az FSR swapchain támogatható a GeForce-on is, de ehhez az NVIDIA-nak azt kell hazudnia a driverből a játéknak, hogy a GeForce egy Radeon.

Mindig bedobsz valami addig nem emlegetett dolgot magyarázatként!

Utánanéztem, az FSR Swapchain a frame pacinghez kell a kép generálás során. Ezért lehet gond Nvidián, de például én nem tapasztaltam hibát Stalker 2-ben, amikor bekapcsoltam 3060 Ti-n az FSR FG-t. Lehet, hogy a GSC valamit jól csinált implementáláskor?

-

PuMbA

titán

PuMbA

titán

Kíváncsiságból kipróbáltam a Last of Us 2-ben az FSR framegent, de valami rettenetes volt. 60-ból csinált 120-at, de dadogósabb lett tőle a játék. A DLSS framegen fantasztikus volt. Nem tudom, hogy ez minek volt a hibája. Ha nem tetszett neki az 5070 Ti, akkor azt sem hiszem, hogy az RTX 3000-es széria tetszene neki.

Nem tudom, hogy miért. Itt semmi gond az FSR FG-vel és sima a frametime egy GTX1060-on Pragmata alatt: [link]

Közben el is felejtettem, hogy még a GTX1000-res felhasználóknak is adott az AMD frame generation-t.

-

Abu85

HÁZIGAZDA

Abu85

HÁZIGAZDA

Kíváncsiságból kipróbáltam a Last of Us 2-ben az FSR framegent, de valami rettenetes volt. 60-ból csinált 120-at, de dadogósabb lett tőle a játék. A DLSS framegen fantasztikus volt. Nem tudom, hogy ez minek volt a hibája. Ha nem tetszett neki az 5070 Ti, akkor azt sem hiszem, hogy az RTX 3000-es széria tetszene neki.

Nem ismeri a GeForce driver az FSR swapchaint, ami kell az FSR framegennek. Helyette betölti a Windows default swapchaint. Ezt egyébként az NVIDIA tudja javítani, mert az FSR swapchain támogatható a GeForce-on is, de ehhez az NVIDIA-nak azt kell hazudnia a driverből a játéknak, hogy a GeForce egy Radeon.

-

FLATRONW

őstag

FLATRONW

őstag

Kíváncsiságból kipróbáltam a Last of Us 2-ben az FSR framegent, de valami rettenetes volt. 60-ból csinált 120-at, de dadogósabb lett tőle a játék. A DLSS framegen fantasztikus volt. Nem tudom, hogy ez minek volt a hibája. Ha nem tetszett neki az 5070 Ti, akkor azt sem hiszem, hogy az RTX 3000-es széria tetszene neki.

-

PuMbA

titán

PuMbA

titán

A pontos szavak a videóban úgy hangzottak, hogy minden milliszekundum számít és ha nem fut elég gyorsan az FSR, akkor az alapvető célja nem teljesül a felskálázásnak. Ez csak a szövegelés persze, a valós méréseknél kiderül, hogy igaz-e vagy sem.

-

PuMbA

titán

PuMbA

titán

Meglátjuk

Közel pariban lennének szerintem, mert az NVIDIA-nál a frame generation hiányzik a 2000-res és 3000-res sorozatban, míg AMD-nél RDNA1 esetén is van jó minőségű frame generation. Igazából az AMD megcsinálta az NVIDIA-nak a frame generation-t a régebbi kártyáikra.

Közel pariban lennének szerintem, mert az NVIDIA-nál a frame generation hiányzik a 2000-res és 3000-res sorozatban, míg AMD-nél RDNA1 esetén is van jó minőségű frame generation. Igazából az AMD megcsinálta az NVIDIA-nak a frame generation-t a régebbi kártyáikra. -

FLATRONW

őstag

FLATRONW

őstag

A hivatalos AMD videóban Jack Huynh egyébként azt mondja, hogy nem lesz lassulás. Nagy átírást / optimalizálást csináltak az FP8 verzióhoz képest, ahol sokkal egyszerűbb volt a munka.

Kíváncsian várjuk

Ha tényleg nem lesz lassulás, akkor az kegyetlen lenne, mert az NVIDIA-ra / RTX2000 /3000 tulajokra rátromfolnának.

Ha tényleg nem lesz lassulás, akkor az kegyetlen lenne, mert az NVIDIA-ra / RTX2000 /3000 tulajokra rátromfolnának.Ha a 6000-es szériánál nem lesz lassulás, amit nem hiszek, akkor is csak az NV 3000-es szériára tromfolnának rá ennyi késéssel. Nem mintha számítana, de az RDNA 1-ig kéne visszamenni támogatásban, hogy pariban legyenek az NV-vel.

-

PuMbA

titán

PuMbA

titán

A hivatalos AMD videóban Jack Huynh egyébként azt mondja, hogy nem lesz lassulás. Nagy átírást / optimalizálást csináltak az FP8 verzióhoz képest, ahol sokkal egyszerűbb volt a munka.

Kíváncsian várjuk

Ha tényleg nem lesz lassulás, akkor az kegyetlen lenne, mert az NVIDIA-ra / RTX2000 /3000 tulajokra rátromfolnának.

Ha tényleg nem lesz lassulás, akkor az kegyetlen lenne, mert az NVIDIA-ra / RTX2000 /3000 tulajokra rátromfolnának. -

PuMbA

titán

PuMbA

titán

-

Yutani

nagyúr

Yutani

nagyúr

Már kezdtem elveszteni minden reményem az 1 éves RDNA4 évfordulón, de titokban még mindig bíztam a hallgatásuk miatt. Az AMD nem léphette meg szerintem sem, hogy nem adja ki, mert saját maguknak tettek volna rosszat

AMD FSR Upscaling 4.1 officially coming to Radeon RX 7000 GPUs in July, RX 6000 in 2027

Na végre. Belátták, hogy ha lassabb is, de kell a korábbi szériákra?

-

PuMbA

titán

PuMbA

titán

Már kezdtem elveszteni minden reményem az 1 éves RDNA4 évfordulón, de titokban még mindig bíztam a hallgatásuk miatt. Az AMD nem léphette meg szerintem sem, hogy nem adja ki, mert saját maguknak tettek volna rosszat

AMD FSR Upscaling 4.1 officially coming to Radeon RX 7000 GPUs in July, RX 6000 in 2027

-

olymind1

senior tag

olymind1

senior tag

-

X2N

őstag

X2N

őstag

a 16GB VRAM -os GPU is elég lehet a next-gen PC-s játékoknál,

hogyha tényleg 24GB -ot kap a PS6.Ami egyszerre jó és rossz hír is.

"PlayStation 6 May Ditch 32GB RAM Dream for 24GB Reality as Sony Scrambles to Keep Console Under Price Ceiling"

https://wccftech.com/playstation-6-ditch-32gb-ram-sony-scramble-console-price/Már megmondtam hónapokkal ezelőtt hogy csak álom lesz a 32G ram

-

S_x96x_S

addikt

S_x96x_S

addikt

a 16GB VRAM -os GPU is elég lehet a next-gen PC-s játékoknál,

hogyha tényleg 24GB -ot kap a PS6.Ami egyszerre jó és rossz hír is.

"PlayStation 6 May Ditch 32GB RAM Dream for 24GB Reality as Sony Scrambles to Keep Console Under Price Ceiling"

https://wccftech.com/playstation-6-ditch-32gb-ram-sony-scramble-console-price/ -

Yutani

nagyúr

Yutani

nagyúr

"Egy árnyék vagy tükröződés úgy néz ki raszterizációban hogy köze nincs a valósághoz, ez nem stílus kérdése."

Minden stilus kerdese, mert megvaltozik a vegeredmeny, ami 100%-osan szubjektiv mindenkinel, hogy melyik tetszik. Legyen az jatek beallitas, mod, RT, vagy AI neural rendering altal megvaltoztatott vegeredmeny.

Akarhogy probalod csurni csavarni, full ugyanarrol van szo."Mi van akkor ha nem az instagram filteres ai slop/mű karakter/környezet kinézet a cél?"

Akkor kikapcsolod, ha neked nem tetszik.

De oke, mivel memek keszultek belole, ezert most divat utalni a meg nem jelent DLSS5-t.Tessek, itt a Dying Light, mint pelda, ahol a Chromatic Aberration default. Tehat a logikad alapjan igy akartak a jatek fejlesztoi, ez az eredeti stilus. Minden ettol eltero az mar az eredeti stilus megcsufitasa es mit kepzek, hogy en mindig kikapcsoltam.

"Te felvennél olyan concept artist-ot aki rajzolni se tud?"

Nekem mint user, a jatekban hasznalt vegeredmeny szamit. Ha a jatek jo es nekem tetszik, engem nem erdekel.

Ez kb hasonlo, mint az AI zene. A munkatarsam 2 hete megallas nelkul hallgatott egy szamot, aztan vegul megosztotta az office csoportban es akkor szembesult vele, hogy ez bizony egy AI altal generalt szam, nem "valodi zeneszek" csinaltak.Nekem a DL-ben kifejezetten tetszett a CA, mert ahogy X2N is mondja, filmszerűbbé tette a látványt, emiatt jobb élményt nyújtott. Kissé elmosta a számítógép grafika "élét", így "élethűbb" lett.

De szerencsére ki lehet kapcsolni, ezért aztán mindenki a magának tetsző beállításokkal tudja játszani a játékot.

-

X2N

őstag

X2N

őstag

"Egy árnyék vagy tükröződés úgy néz ki raszterizációban hogy köze nincs a valósághoz, ez nem stílus kérdése."

Minden stilus kerdese, mert megvaltozik a vegeredmeny, ami 100%-osan szubjektiv mindenkinel, hogy melyik tetszik. Legyen az jatek beallitas, mod, RT, vagy AI neural rendering altal megvaltoztatott vegeredmeny.

Akarhogy probalod csurni csavarni, full ugyanarrol van szo."Mi van akkor ha nem az instagram filteres ai slop/mű karakter/környezet kinézet a cél?"

Akkor kikapcsolod, ha neked nem tetszik.

De oke, mivel memek keszultek belole, ezert most divat utalni a meg nem jelent DLSS5-t.Tessek, itt a Dying Light, mint pelda, ahol a Chromatic Aberration default. Tehat a logikad alapjan igy akartak a jatek fejlesztoi, ez az eredeti stilus. Minden ettol eltero az mar az eredeti stilus megcsufitasa es mit kepzek, hogy en mindig kikapcsoltam.

"Te felvennél olyan concept artist-ot aki rajzolni se tud?"

Nekem mint user, a jatekban hasznalt vegeredmeny szamit. Ha a jatek jo es nekem tetszik, engem nem erdekel.

Ez kb hasonlo, mint az AI zene. A munkatarsam 2 hete megallas nelkul hallgatott egy szamot, aztan vegul megosztotta az office csoportban es akkor szembesult vele, hogy ez bizony egy AI altal generalt szam, nem "valodi zeneszek" csinaltak."Tessek, itt a Dying Light, mint pelda, ahol a Chromatic Aberration default. Tehat a logikad alapjan igy akartak a jatek fejlesztoi, ez az eredeti stilus. Minden ettol eltero az mar az eredeti stilus megcsufitasa es mit kepzek, hogy en mindig kikapcsoltam."

Igen ezt valaki eldöntötte. Van ennek is oka, általában az mert tudják a fejlesztők is hogy a grafikai részletesség annyira nem jó, így tesznek rá még post effekteket hogy elfedjék amit kell. Ez az átlag usert nem zavarja, mi nem azok vagyunk. De egyben filmszerűbb is a látvány ezektől mert a kamera lencse hibái is ott lesznek. Nem mindenkinek tetszik nekem se, de ez is kikapcsolható mint a film grain, és nem kell hozzá külön dedikált hardver se, ugye? Nem véletlen PC-n játszunk, megszoktuk hogy mindenki ki/be lehet kapcsolni.

Ettől függetlenül én is várom a DLSS5-t csak nem vagyok optimista.

-

Busterftw

nagyúr

Busterftw

nagyúr

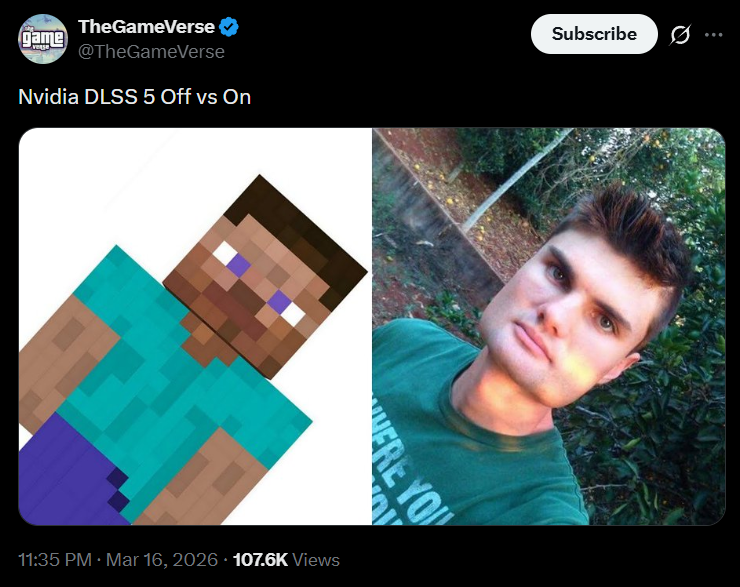

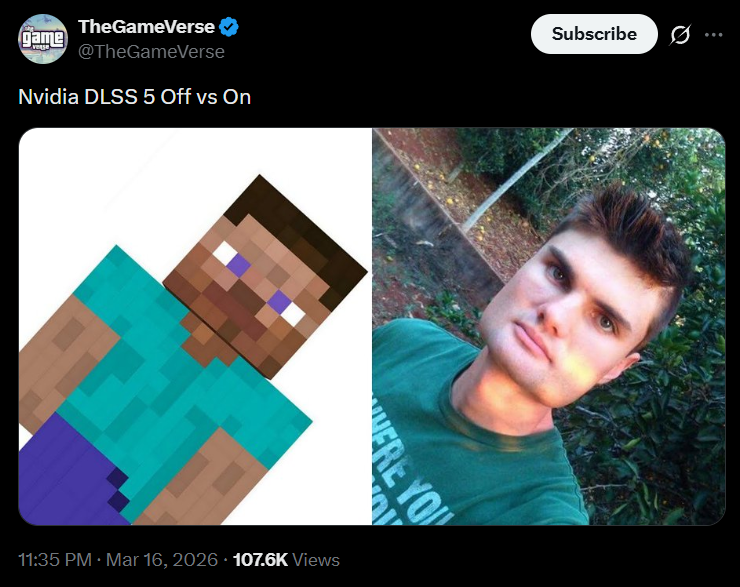

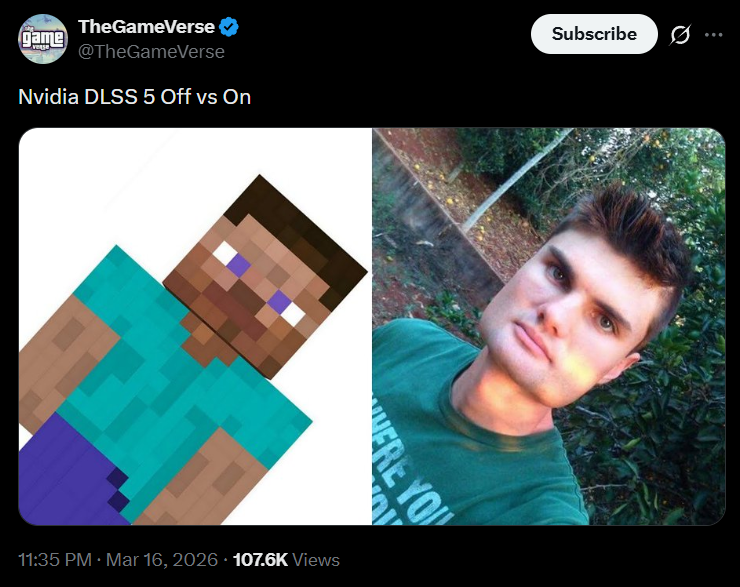

Egy árnyék vagy tükröződés úgy néz ki raszterizációban hogy köze nincs a valósághoz, ez nem stílus kérdése. Még a megvilágítással lehet trükközni raszterizációnál hogy imitáljuk a raytracinges kinézetet ha sok fényforrást teszel be, de az előbbieket már nem tudja a raszter érdemben imitálni.

De az hogy a karaktereket/karakter dizájn-t teljesen átalakítja az már viszont gond, mert ott volt egy koncepció is ami szerint meg lett tervezve. Ezt a DLSS5 nem veszi figyelembe, ebből születtek mémek rendesen:

Mi van akkor ha nem az instagram filteres ai slop/mű karakter/környezet kinézet a cél? Hanem realisztikus/stilizált? Az is probléma hogy úgy van eredetileg color gradelve egy játékban színhelyes bekalibrált monitorokon hogy jól nézzen ki. Ha te elkezded a színeket, expozíciót,kontrasztot tologatni akkor majd bebukik a szín információ, és nem fogod normálisan látni a szín átmeneteket se, a gamma meg el lesz rontva teljesen.Elég csak megnézni minecraft-nál a raytracinget, mennyit dob a látványon az hogy fizikailag pontos lesz a megvilágítás/árnyék/tükröződés, anélkül hogy mást is megváltoztatnának amit nem kellene.

Igen vannak MODOK, amik még jobban megváltoztatják a kinézetet, de ezekhez nem kell külön hardver. Plusz ember alkotta, volt koncepció, ezt a kérdést már megbeszéltük.

Van egyébként már Skyrim alá hasonló ai image to image mod, linkeltem itt, vagy az NV találgatósba(reShade részeként) hónapokkal ezelőtt amikor kijött a DLSS5 bemutató...meg lehet nézni mennyire változtatta meg az eredeti kinézetet és változtatta meg a a játék dizájnt, koncepciót. Azt a kérdést kell feltenni hogy ha összehasonlítod before/after hogy felismerhető-e az eredeti alkotás, vagy túltolta és valami teljesen más lett a végeredmény. Ha az utóbbi az egyáltalán nem jó. Nem elég konzisztens. Nem az a lényeg hogy "csinosan" nézzen ki, hanem hogy bele tudd élni magad a világba. Nem mellesleg csomó dolgot, pl. karakter önárnyékot is megváltoztat, leszed a képről, plusz az agyunk folyamatosan azt fogja figyelni hogy ezek a karakter modellek majd mennyire borzalmasan követik le az eredetileg is rossz arc arcmimikát, animációt, komplex mozgásoknál rögtön tele lesz anomáliákkal a kép...

Bloom, Chromatic Aberration, DOF, Zaj, perspektív torzítás - Ezek post process effektek, egyébként is lenne a képen ha egy igazi kamera lencsét/szenzort használnánk, legtöbbször itt is az a baj hogy túltolják és ez zavaró.

"Tehat csak az az igazi artist, aki papir ceruzaval csinalja? Ne vicceljunk mar." Te felvennél olyan concept artist-ot aki rajzolni se tud?

Ez az alap, hogy tudsz rajzolni.

Ez az alap, hogy tudsz rajzolni."Egy árnyék vagy tükröződés úgy néz ki raszterizációban hogy köze nincs a valósághoz, ez nem stílus kérdése."

Minden stilus kerdese, mert megvaltozik a vegeredmeny, ami 100%-osan szubjektiv mindenkinel, hogy melyik tetszik. Legyen az jatek beallitas, mod, RT, vagy AI neural rendering altal megvaltoztatott vegeredmeny.

Akarhogy probalod csurni csavarni, full ugyanarrol van szo."Mi van akkor ha nem az instagram filteres ai slop/mű karakter/környezet kinézet a cél?"

Akkor kikapcsolod, ha neked nem tetszik.

De oke, mivel memek keszultek belole, ezert most divat utalni a meg nem jelent DLSS5-t.Tessek, itt a Dying Light, mint pelda, ahol a Chromatic Aberration default. Tehat a logikad alapjan igy akartak a jatek fejlesztoi, ez az eredeti stilus. Minden ettol eltero az mar az eredeti stilus megcsufitasa es mit kepzek, hogy en mindig kikapcsoltam.

"Te felvennél olyan concept artist-ot aki rajzolni se tud?"

Nekem mint user, a jatekban hasznalt vegeredmeny szamit. Ha a jatek jo es nekem tetszik, engem nem erdekel.

Ez kb hasonlo, mint az AI zene. A munkatarsam 2 hete megallas nelkul hallgatott egy szamot, aztan vegul megosztotta az office csoportban es akkor szembesult vele, hogy ez bizony egy AI altal generalt szam, nem "valodi zeneszek" csinaltak. -

S_x96x_S

addikt

S_x96x_S

addikt

NVIDIA Rubin Ultra vs. AMD MI500

"NVIDIA Rubin & Rubin Ultra Platforms Facing Design/Spec Issues As Per Rumors While AMD MI500 Positioned For 2H 2027 Launch"

https://wccftech.com/nvidia-rubin-rubin-ultra-platforms-facing-design-spec-issues-amd-mi500-positioned-for-2h-2027/ -

X2N

őstag

X2N

őstag

Egy árnyék vagy tükröződés úgy néz ki raszterizációban hogy köze nincs a valósághoz, ez nem stílus kérdése. Még a megvilágítással lehet trükközni raszterizációnál hogy imitáljuk a raytracinges kinézetet ha sok fényforrást teszel be, de az előbbieket már nem tudja a raszter érdemben imitálni.

De az hogy a karaktereket/karakter dizájn-t teljesen átalakítja az már viszont gond, mert ott volt egy koncepció is ami szerint meg lett tervezve. Ezt a DLSS5 nem veszi figyelembe, ebből születtek mémek rendesen:

Mi van akkor ha nem az instagram filteres ai slop/mű karakter/környezet kinézet a cél? Hanem realisztikus/stilizált? Az is probléma hogy úgy van eredetileg color gradelve egy játékban színhelyes bekalibrált monitorokon hogy jól nézzen ki. Ha te elkezded a színeket, expozíciót,kontrasztot tologatni akkor majd bebukik a szín információ, és nem fogod normálisan látni a szín átmeneteket se, a gamma meg el lesz rontva teljesen.Elég csak megnézni minecraft-nál a raytracinget, mennyit dob a látványon az hogy fizikailag pontos lesz a megvilágítás/árnyék/tükröződés, anélkül hogy mást is megváltoztatnának amit nem kellene.

Igen vannak MODOK, amik még jobban megváltoztatják a kinézetet, de ezekhez nem kell külön hardver. Plusz ember alkotta, volt koncepció, ezt a kérdést már megbeszéltük.

Van egyébként már Skyrim alá hasonló ai image to image mod, linkeltem itt, vagy az NV találgatósba(reShade részeként) hónapokkal ezelőtt amikor kijött a DLSS5 bemutató...meg lehet nézni mennyire változtatta meg az eredeti kinézetet és változtatta meg a a játék dizájnt, koncepciót. Azt a kérdést kell feltenni hogy ha összehasonlítod before/after hogy felismerhető-e az eredeti alkotás, vagy túltolta és valami teljesen más lett a végeredmény. Ha az utóbbi az egyáltalán nem jó. Nem elég konzisztens. Nem az a lényeg hogy "csinosan" nézzen ki, hanem hogy bele tudd élni magad a világba. Nem mellesleg csomó dolgot, pl. karakter önárnyékot is megváltoztat, leszed a képről, plusz az agyunk folyamatosan azt fogja figyelni hogy ezek a karakter modellek majd mennyire borzalmasan követik le az eredetileg is rossz arc arcmimikát, animációt, komplex mozgásoknál rögtön tele lesz anomáliákkal a kép...

Bloom, Chromatic Aberration, DOF, Zaj, perspektív torzítás - Ezek post process effektek, egyébként is lenne a képen ha egy igazi kamera lencsét/szenzort használnánk, legtöbbször itt is az a baj hogy túltolják és ez zavaró.

"Tehat csak az az igazi artist, aki papir ceruzaval csinalja? Ne vicceljunk mar." Te felvennél olyan concept artist-ot aki rajzolni se tud?

Ez az alap, hogy tudsz rajzolni.

Ez az alap, hogy tudsz rajzolni.Persze az tök jó lenne ha úgy működne a DLSS5 hogy nem változtatja meg az eredeti kinézetet ennyire radikálisan, mint mondjuk a Mass Effect-nél a Legendary Edition kicsit modernizálta a játék kinézetét mert új UE-re lett portolva a játék, szebben is be lett világítva mert lehetséges volt az újabb engine miatt.

-

X2N

őstag

X2N

őstag

Mar hogyne lenne? Az RT bekapcsolasaval megvaltoztatja a jatek kinezetet, stilusat, ami valakinek tetszik vagy nem tetszik. A DLSS5 demozasaval ugyanazt csinalod az userrel.

Bekapcsolod, megvaltozik az "eredeti" aztan eldontod izlesed szerint hogy melyik variacio tetszik."Mi a különbség a MOD meg a DLSS5 közzött?Tényleg bele kell menjünk?

Menjunk bele.

A DLSS5 megvaltoztatja az "eredeti" stilust, ezzel van a problemad.

A mod is megvaloztatja az eredeti stilust es ugyanugy lesznek userek, akiknek a moddolt verzio nem fog tetszteni, valakinek meg az kell.

Full ugyanarrol beszelsz, egy szubjektiv dologrol, hogy az opcionalis feature ket vegeredmenye kozul neked melyik tetszik vagy nem tetszik.Mellesleg mi az eredeti stilus? Bloom, Chromatic Aberration on? Ha default on volt es kikapcsolom, akkor mar megvaltoztatom az artist altal megalmodott eredeti kepet.

A DLSS5 nem jelent meg, egy techdemot mutattak 2x5090-el, masszivan tulreagaljatok a helyzetet egy olyan feature-rol ami kikapcsolhato.

"és ezek nélkül nem tudja megcsinálni a feladatát az nem tekinthető igazi artistnak"

Melyik metrika vagy definicio szerint? Tehat csak az az igazi artist, aki papir ceruzaval csinalja? Ne vicceljunk mar.Egy árnyék vagy tükröződés úgy néz ki raszterizációban hogy köze nincs a valósághoz, ez nem stílus kérdése. Még a megvilágítással lehet trükközni raszterizációnál hogy imitáljuk a raytracinges kinézetet ha sok fényforrást teszel be, de az előbbieket már nem tudja a raszter érdemben imitálni.

De az hogy a karaktereket/karakter dizájn-t teljesen átalakítja az már viszont gond, mert ott volt egy koncepció is ami szerint meg lett tervezve. Ezt a DLSS5 nem veszi figyelembe, ebből születtek mémek rendesen:

Mi van akkor ha nem az instagram filteres ai slop/mű karakter/környezet kinézet a cél? Hanem realisztikus/stilizált? Az is probléma hogy úgy van eredetileg color gradelve egy játékban színhelyes bekalibrált monitorokon hogy jól nézzen ki. Ha te elkezded a színeket, expozíciót,kontrasztot tologatni akkor majd bebukik a szín információ, és nem fogod normálisan látni a szín átmeneteket se, a gamma meg el lesz rontva teljesen.Elég csak megnézni minecraft-nál a raytracinget, mennyit dob a látványon az hogy fizikailag pontos lesz a megvilágítás/árnyék/tükröződés, anélkül hogy mást is megváltoztatnának amit nem kellene.

Igen vannak MODOK, amik még jobban megváltoztatják a kinézetet, de ezekhez nem kell külön hardver. Plusz ember alkotta, volt koncepció, ezt a kérdést már megbeszéltük.

Van egyébként már Skyrim alá hasonló ai image to image mod, linkeltem itt, vagy az NV találgatósba(reShade részeként) hónapokkal ezelőtt amikor kijött a DLSS5 bemutató...meg lehet nézni mennyire változtatta meg az eredeti kinézetet és változtatta meg a a játék dizájnt, koncepciót. Azt a kérdést kell feltenni hogy ha összehasonlítod before/after hogy felismerhető-e az eredeti alkotás, vagy túltolta és valami teljesen más lett a végeredmény. Ha az utóbbi az egyáltalán nem jó. Nem elég konzisztens. Nem az a lényeg hogy "csinosan" nézzen ki, hanem hogy bele tudd élni magad a világba. Nem mellesleg csomó dolgot, pl. karakter önárnyékot is megváltoztat, leszed a képről, plusz az agyunk folyamatosan azt fogja figyelni hogy ezek a karakter modellek majd mennyire borzalmasan követik le az eredetileg is rossz arc arcmimikát, animációt, komplex mozgásoknál rögtön tele lesz anomáliákkal a kép...

Bloom, Chromatic Aberration, DOF, Zaj, perspektív torzítás - Ezek post process effektek, egyébként is lenne a képen ha egy igazi kamera lencsét/szenzort használnánk, legtöbbször itt is az a baj hogy túltolják és ez zavaró.

"Tehat csak az az igazi artist, aki papir ceruzaval csinalja? Ne vicceljunk mar." Te felvennél olyan concept artist-ot aki rajzolni se tud?

Ez az alap, hogy tudsz rajzolni.

Ez az alap, hogy tudsz rajzolni. -

Busterftw

nagyúr

Busterftw

nagyúr

RT-nek ehhez semmi köze, ne keverd ide. Az valós fizikai számításon alapul, mindig élethűbb lesz a raszterizációnál. Ettől még nem biztos hogy jobban is fog kinézni a végeredmény. Emlékezz vissza hogy amikor kijöttek az RTX-es kártyák mindenki azt nézegette hogy most akkor látja-e a raytracinget vagy nem....

Mi a különbség a MOD meg a DLSS5 közzött?

Tényleg bele kell menjünk? Techdemo? Hagyjuk már. Képgeneráló maximum.

1. a MOD az egy ember munkája, valaki dolgozott vele, döntéseket hozott, miközben készítette. Vette a fáradtságot hogy elkészítse. Az image2image generátor csak azt próbálja kitalálni mit várnak el tőle, abból amit bele traineltek, általában mások munkája alapján. Olyan is a végeredmény. AI Slop-nak hívják.

2. a mod ingyenes, nem kell dedikkált hardvert venni hozzá

3. a modtól nem lesz ghosting

4. a modtól nem lesz furcsa objektum-él

5. a modtól nincs megnövekedett input lag

6. a modtól nem lesznek téves frame-ek

7. a mod konzisztens

8. egy mod vagy komolyabb modcsomag lehet önálló művészi alkotás, ami az eredeti alkotást kibővíti funkciókkal, javíthatja a kinézetét, akár jelentősebben megváltoztatva azt a készítő szándéka szerint

9. egy moddal akár olyanok is élvezhetik az eredeti alkotást, akik mondjuk nem élveznének mert nem tudják a nyelvet(játék fordítások).Az AI is csak egy eszköz, segíthet ötletelni, gyorsítani a munkát, de nem az fogja megcsinálni a az egész alkotást, az az artist aki ilyenket használ, és ezek nélkül nem tudja megcsinálni a feladatát az nem tekinthető igazi artistnak.

Ezt ugye te se gondolod komolyan hogy állásinterjún kijelented hogy te majd ai-al fogod megcsinálni a munkádat, de neked ezért fizessenek...Mar hogyne lenne? Az RT bekapcsolasaval megvaltoztatja a jatek kinezetet, stilusat, ami valakinek tetszik vagy nem tetszik. A DLSS5 demozasaval ugyanazt csinalod az userrel.

Bekapcsolod, megvaltozik az "eredeti" aztan eldontod izlesed szerint hogy melyik variacio tetszik."Mi a különbség a MOD meg a DLSS5 közzött?Tényleg bele kell menjünk?

Menjunk bele.

A DLSS5 megvaltoztatja az "eredeti" stilust, ezzel van a problemad.

A mod is megvaloztatja az eredeti stilust es ugyanugy lesznek userek, akiknek a moddolt verzio nem fog tetszteni, valakinek meg az kell.

Full ugyanarrol beszelsz, egy szubjektiv dologrol, hogy az opcionalis feature ket vegeredmenye kozul neked melyik tetszik vagy nem tetszik.Mellesleg mi az eredeti stilus? Bloom, Chromatic Aberration on? Ha default on volt es kikapcsolom, akkor mar megvaltoztatom az artist altal megalmodott eredeti kepet.

A DLSS5 nem jelent meg, egy techdemot mutattak 2x5090-el, masszivan tulreagaljatok a helyzetet egy olyan feature-rol ami kikapcsolhato.

"és ezek nélkül nem tudja megcsinálni a feladatát az nem tekinthető igazi artistnak"

Melyik metrika vagy definicio szerint? Tehat csak az az igazi artist, aki papir ceruzaval csinalja? Ne vicceljunk mar. -

PuMbA

titán

PuMbA

titán

"58% of gamers say AI should not alter games in DLSS 5 poll"

https://videocardz.com/newz/techpowerup-poll-shows-58-of-readers-do-not-want-dlss-5-altering-gamesHát igen, nincs meglepetés

Biztosan visszább fognak venni belőle az őszi DLSS 5 megjelenésre, mert amit mutattak, azt a többség nem akarja. Érdekes lesz, hogy mit találnak ki.

Biztosan visszább fognak venni belőle az őszi DLSS 5 megjelenésre, mert amit mutattak, azt a többség nem akarja. Érdekes lesz, hogy mit találnak ki. -

S_x96x_S

addikt

S_x96x_S

addikt

"58% of gamers say AI should not alter games in DLSS 5 poll"

https://videocardz.com/newz/techpowerup-poll-shows-58-of-readers-do-not-want-dlss-5-altering-games -

X2N

őstag

X2N

őstag

Most leirtal egy jo hosszu valamit, mit akartal kerdezni?

Ez kb olyan, mintha beraknek ket kepet egy RT ON-RT OFF keprol es izelnek itt wall of textben, hogy neked mi az hogy az RT ON beallitas stilusa nem tetszik, amit ki tudsz kapcsolni.

Ez egy techdemo volt az Nvidiatol ebben a fazisban, tul van reagalva masszivan.Abba mar bele se megyek, hogy pl a jatekosok koreben a modok mit tudnak megvaltoztatni a jatekokkal, ha esetleg valakinek az tetszik:

Most irjak en is a moddernek, meg a 10ezer usernek a ki letoltotte (nem tudom a letoltesek hogy vannak szamolva), hogy mit kepzelnek, az game artist nem igy almodta meg, nektek ez ne tetszen?

(az az artist, aki valoszinuleg mar masszivan hasznal AI-t a workflowjahoz..)RT-nek ehhez semmi köze, ne keverd ide. Az valós fizikai számításon alapul, mindig élethűbb lesz a raszterizációnál. Ettől még nem biztos hogy jobban is fog kinézni a végeredmény. Emlékezz vissza hogy amikor kijöttek az RTX-es kártyák mindenki azt nézegette hogy most akkor látja-e a raytracinget vagy nem....

Mi a különbség a MOD meg a DLSS5 közzött?

Tényleg bele kell menjünk? Techdemo? Hagyjuk már. Képgeneráló maximum.

1. a MOD az egy ember munkája, valaki dolgozott vele, döntéseket hozott, miközben készítette. Vette a fáradtságot hogy elkészítse. Az image2image generátor csak azt próbálja kitalálni mit várnak el tőle, abból amit bele traineltek, általában mások munkája alapján. Olyan is a végeredmény. AI Slop-nak hívják.

2. a mod ingyenes, nem kell dedikkált hardvert venni hozzá

3. a modtól nem lesz ghosting

4. a modtól nem lesz furcsa objektum-él

5. a modtól nincs megnövekedett input lag

6. a modtól nem lesznek téves frame-ek

7. a mod konzisztens

8. egy mod vagy komolyabb modcsomag lehet önálló művészi alkotás, ami az eredeti alkotást kibővíti funkciókkal, javíthatja a kinézetét, akár jelentősebben megváltoztatva azt a készítő szándéka szerint

9. egy moddal akár olyanok is élvezhetik az eredeti alkotást, akik mondjuk nem élveznének mert nem tudják a nyelvet(játék fordítások).Az AI is csak egy eszköz, segíthet ötletelni, gyorsítani a munkát, de nem az fogja megcsinálni a az egész alkotást, az az artist aki ilyenket használ, és ezek nélkül nem tudja megcsinálni a feladatát az nem tekinthető igazi artistnak.

Ezt ugye te se gondolod komolyan hogy állásinterjún kijelented hogy te majd ai-al fogod megcsinálni a munkádat, de neked ezért fizessenek... -

Alogonomus

őstag

Alogonomus

őstag

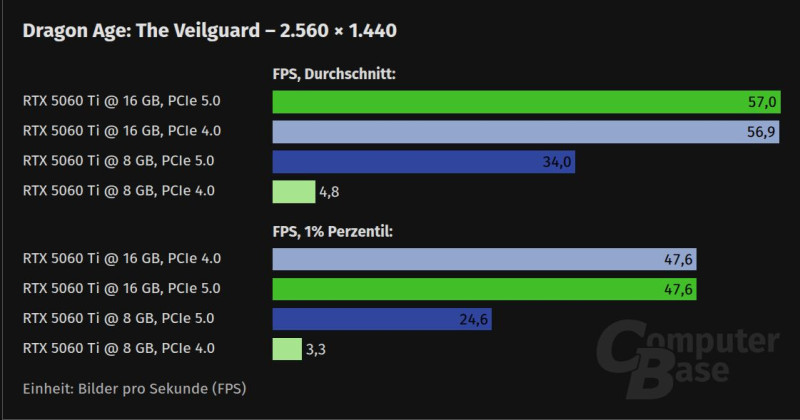

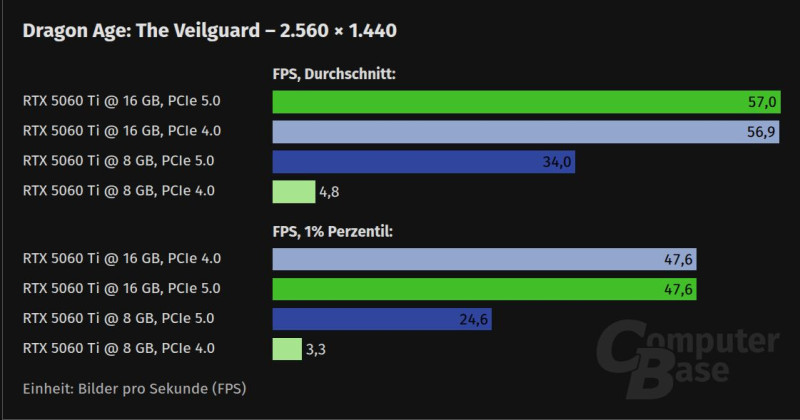

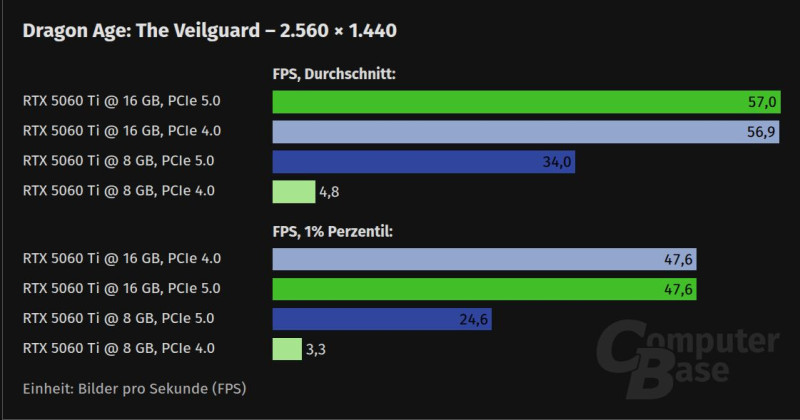

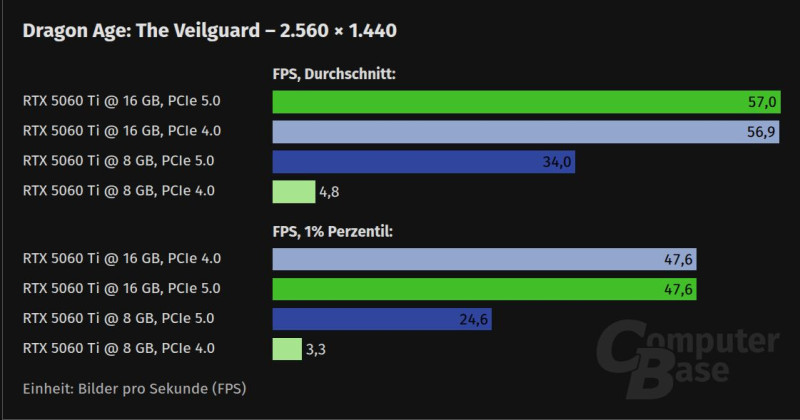

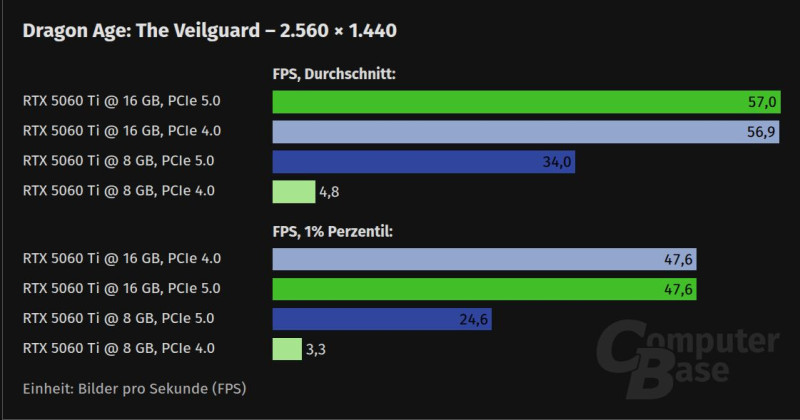

Azért ez a teszt más következtetésre jutott a felezett sávszélességű 5060 Ti és a teljes sávszélességű 9060 XT 8GB-os verzióinak összehasonlítása kapcsán. Nyilván mindkét modellnél árt a teljesítménynek a felezett sávszélesség, de nagyon nem azonos mértékben.

-

S_x96x_S

addikt

S_x96x_S

addikt

> A kevés VRAM-ot nem menti meg a PCIe sávszélesség.

Nem gyógyítja meg teljesen,

de jelentősen enyhitheti a fájdalmat/problémát

És néha már ez is elég hogy játszható legyen

vagyis bár a 8GB VRAM a fő szűk keresztmetszet

és a PCIe sávszélesség a másodlagos bottleneck.

de ha a VRAM kevés,

akkor gyors PCIe nagyon sokat tud segíteni az adatok gyors mozgatásában

( és ez a "B terv" VRAM-hiányos esetre. )amúgy is a Frosbite engine ( Veilguard )

sok dolgot nagyon jól optimalizál,

de az alacsony VRAM + Asset streaming-et nem igazán.

És ráadásul a DirectStorage-t se támogatja az engine. -

FLATRONW

őstag

FLATRONW

őstag

Van egy olyan érzésem, hogy semekkora pci-e sávszélesség nem segítene a kevés vram hiányán. Persze látványos, hogy nem esik teljesen össze pcie 5 mellett, de valószínűleg a további sávszélesség csak minimálisan vagy egyáltalán nem növelné a teljesítményt.

-

Busterftw

nagyúr

Busterftw

nagyúr

Azért remélem abban egyetértünk hogy van különbség a között amikor egy video game artist megcsinál a legjobb tudása szerint egy karaktermodell kinézetet/jelenetet/megvilágítást ami figyelembe veszi az adott játékbeli jelenethez szükséges dramaturgiai elemeket(gondolok itt elsősorban a Resident Evil-es Grace-es DLSS5 promóra amivel reklámozták az egészet, ahol egyébként azt a házat látogatja meg éppen Grace, ahol ~1 évvel ezelőtt az anyját a szeme láttára brutálisan meggyilkolják, vagyis nem fog kinézni úgy a karakter mintha randira menne, vagy nem lesz úgy kisminkelve mintha épp most töltene fel instára képet. Nem minden játékba kell ai-al belekontárkodni, még akkor se ha látszólag jobban néz ki, mert nem lesz jobb tőle ha nem veszi figyelembe az eredeti szándékát a game artist-nak...

Ezzel szemben a DLSS5-be beépített image2image generátor ezzel nem foglalkozik, csak művészeti kontextus nélkül gyártja majd a közösségi médiás trash képeket a karakterekre, mesterséges megvilágítással, amire eredetileg is trénelték, ami egy játékban teljesen kizökkenthet a játékost a beleélésből. pl. Stalker 2-be majd Gigachad/looksmaxxing-embereket fog gyártani az amúgy szláv/balkáni etnikum karakterekből? Sokan már azon kiakadtak hogy nők vannak a zónában az új részben...amit amúgy a lore kvázi megtilt.

Ezen akadtak ki az emberek, játék fejlesztők, akiket egyébként meg se kérdeztek semmiről. Ha megkérdezik a fejlesztőket(azokat akik ténylegesen ezzel foglalkoznak, nem a felső vezetést)hogy mit gondolnak erről és hallgatnak rájuk sokkal jobb marketinganyagot is lehetett volna készíteni, mert ők tudják mi illik az adott jelenethez, nem az aki ezt jóváhagyta mert szerinte "realisztikusabb". Vannak sokkal fontosabb dolgok is mint a realisztikus kinézet...játékoknál.

Most leirtal egy jo hosszu valamit, mit akartal kerdezni?

Ez kb olyan, mintha beraknek ket kepet egy RT ON-RT OFF keprol es izelnek itt wall of textben, hogy neked mi az hogy az RT ON beallitas stilusa nem tetszik, amit ki tudsz kapcsolni.

Ez egy techdemo volt az Nvidiatol ebben a fazisban, tul van reagalva masszivan.Abba mar bele se megyek, hogy pl a jatekosok koreben a modok mit tudnak megvaltoztatni a jatekokkal, ha esetleg valakinek az tetszik:

Most irjak en is a moddernek, meg a 10ezer usernek a ki letoltotte (nem tudom a letoltesek hogy vannak szamolva), hogy mit kepzelnek, az game artist nem igy almodta meg, nektek ez ne tetszen?

(az az artist, aki valoszinuleg mar masszivan hasznal AI-t a workflowjahoz..) -

X2N

őstag

X2N

őstag

Abban remelem egyetertunk, hogy hatalmas kulonbseg van az erosen szubjektiv hasrautes es "trust me bro" szintu hsz-ek es konkret, visszakeresheto adatok kozott.

"mindenesetre, ezentúl én is 6 tizedejegy pontossággal várom az nvidia cpu market share piaci részesedést."

Ha a reszesedest felmero entitas ezt kozli, akkor bemasolom 6 tizedjegy pontossaggal ezentul, csak neked.

Azért remélem abban egyetértünk hogy van különbség a között amikor egy video game artist megcsinál a legjobb tudása szerint egy karaktermodell kinézetet/jelenetet/megvilágítást ami figyelembe veszi az adott játékbeli jelenethez szükséges dramaturgiai elemeket(gondolok itt elsősorban a Resident Evil-es Grace-es DLSS5 promóra amivel reklámozták az egészet, ahol egyébként azt a házat látogatja meg éppen Grace, ahol ~1 évvel ezelőtt az anyját a szeme láttára brutálisan meggyilkolják, vagyis nem fog kinézni úgy a karakter mintha randira menne, vagy nem lesz úgy kisminkelve mintha épp most töltene fel instára képet. Nem minden játékba kell ai-al belekontárkodni, még akkor se ha látszólag jobban néz ki, mert nem lesz jobb tőle ha nem veszi figyelembe az eredeti szándékát a game artist-nak...

Ezzel szemben a DLSS5-be beépített image2image generátor ezzel nem foglalkozik, csak művészeti kontextus nélkül gyártja majd a közösségi médiás trash képeket a karakterekre, mesterséges megvilágítással, amire eredetileg is trénelték, ami egy játékban teljesen kizökkenthet a játékost a beleélésből. pl. Stalker 2-be majd Gigachad/looksmaxxing-embereket fog gyártani az amúgy szláv/balkáni etnikum karakterekből? Sokan már azon kiakadtak hogy nők vannak a zónában az új részben...amit amúgy a lore kvázi megtilt.

Ezen akadtak ki az emberek, játék fejlesztők, akiket egyébként meg se kérdeztek semmiről. Ha megkérdezik a fejlesztőket(azokat akik ténylegesen ezzel foglalkoznak, nem a felső vezetést)hogy mit gondolnak erről és hallgatnak rájuk sokkal jobb marketinganyagot is lehetett volna készíteni, mert ők tudják mi illik az adott jelenethez, nem az aki ezt jóváhagyta mert szerinte "realisztikusabb". Vannak sokkal fontosabb dolgok is mint a realisztikus kinézet...játékoknál.

-

Yutani

nagyúr

Yutani

nagyúr

> Itt csak az látszik, hogy elfogyott a 8GB 1440p-n ebben a játékban, és a herélt 8x sávon próbálja átpumpálni az adatot a rendszer.

és akkor a PCIe 3.0 mindenre elég vagy sem ?

![;]](//cdn.rios.hu/dl/s/v1.gif)

mert matematikailag

a PCIe 3.0 / 4.0 mindenre elég hez - végtelen számú bizonyíték kell.

de a cáfolathoz elég csak 1

A kevés VRAM-ot nem menti meg a PCIe sávszélesség. A grafikon alapján kellene a 6.0, de azt meg a kártya nem tudja.

Egyébként meg elég a 3.0, ha van elég VRAM is.

-

Busterftw

nagyúr

Busterftw

nagyúr

>> "amúgy sokszor én se értek egyet Busterftw -vel."

>Nem is kell, de nem is errol van szo.

mindenesetre, ezentúl én is 6 tizedejegy pontossággal várom

az nvidia cpu market share piaci részesedést.

( de csak azért mert még olyan pici )amúgy

xkcd "Precision vs Accuracy" ( csak Obamát cseréld le Jensen-re )

https://www.explainxkcd.com/wiki/index.php/2696:_Precision_vs_AccuracyAbban remelem egyetertunk, hogy hatalmas kulonbseg van az erosen szubjektiv hasrautes es "trust me bro" szintu hsz-ek es konkret, visszakeresheto adatok kozott.

"mindenesetre, ezentúl én is 6 tizedejegy pontossággal várom az nvidia cpu market share piaci részesedést."

Ha a reszesedest felmero entitas ezt kozli, akkor bemasolom 6 tizedjegy pontossaggal ezentul, csak neked.

-

S_x96x_S

addikt

S_x96x_S

addikt

>> "amúgy sokszor én se értek egyet Busterftw -vel."

>Nem is kell, de nem is errol van szo.

mindenesetre, ezentúl én is 6 tizedejegy pontossággal várom

az nvidia cpu market share piaci részesedést.

( de csak azért mert még olyan pici )amúgy

xkcd "Precision vs Accuracy" ( csak Obamát cseréld le Jensen-re )

https://www.explainxkcd.com/wiki/index.php/2696:_Precision_vs_Accuracy -

S_x96x_S

addikt

S_x96x_S

addikt

> Itt csak az látszik, hogy elfogyott a 8GB 1440p-n ebben a játékban, és a herélt 8x sávon próbálja átpumpálni az adatot a rendszer.

és akkor a PCIe 3.0 mindenre elég vagy sem ?

![;]](//cdn.rios.hu/dl/s/v1.gif)

mert matematikailag

a PCIe 3.0 / 4.0 mindenre elég hez - végtelen számú bizonyíték kell.

de a cáfolathoz elég csak 1

-

Busterftw

nagyúr

Busterftw

nagyúr

> Más hogyhogy elfogadja az információkat amiket írok úgy, ahogy vannak és nem kell hétpecsétes bírósági iratot benyújtanom neki komplett matematikai bizonyítással a harmadik tizedesjegyig?

> 20.5 éve PH-zok

Szalad az idő...

Szalad az idő...azért emlékeztetlek, hogy ez egy szakmai fórum,

és nem árt, hogyha mindenben pontosak és precizek vagyunk!

emiatt jelzem, hogy

20.56825358995894248437 éve vagy a PH-n !

és ez az érték folyamatosan nő, minden másodpercel

és már el is avult az érték !

// ha kell, akkor lehetek még preziebb is !

amúgy sokszor én se értek egyet Busterftw -vel."amúgy sokszor én se értek egyet Busterftw -vel."

Nem is kell, de nem is errol van szo.

Jaceknek kuldj reszemrol eletjelet, ha lenne valasz, uzenem hianyoznak a -10 fokos teli ablakos tesztek

-

Busterftw

nagyúr

Busterftw

nagyúr

"Ott van, hogy "aims to"."

Köszönöm, tehát hülyeséget írtál, mert nem találgat, hiszen az "aims to" nem ezt jelenti csak azt, hogy a pontossága mondjuk +-3%, amitől még a like-dislike arány nem változik jelentősen

"A saját 3rd party API-juk extrapolal egy saccolt számot."

Ez hova van leírva, hogy "extrapolál" és "saccol"? Költői kérdés, mert a fentiek alapján nem érdekel, mert még egy "aims to" kifejezést nem sikerül lefordítanod.

"Pontosan, topikból topikra ezt csinálod. "

És senkinek nincs baja vele, csak neked

Érzed, hogy a közös nevező te vagy? Te mész szemben az autópályán mindenkivel, nem én. Szeretném megélni azt a pillanatot, amikor felfogod, de sajnos nem tudom, hogy ez mikor következik be

Érzed, hogy a közös nevező te vagy? Te mész szemben az autópályán mindenkivel, nem én. Szeretném megélni azt a pillanatot, amikor felfogod, de sajnos nem tudom, hogy ez mikor következik be

Nem irtam hulyeseget, az nem az en hibam, hogy nem megy jol az angol.

aims to: tries to, attempts to, intends to, seeks to.Tehat arra torekedik, hogy a leheto legpontosabb ertekelest mutassa - ez pedig azt jelenti, hogy becslest keszit. Ha rendelkezne a pontos, valodi szamokkal, nem kellene "torekednie" rajuk, egyszeruen csak megjelenitene oket...

"hogy a pontossága mondjuk +-3%"

Aha, csak ugye fogalmad sincs, hogy mennyire pontos, talalgatsz ahogy ok is, mert akkor kozolnek a pontos szamokat es a leirasban igy is fogalmaznanak."Ez hova van leírva, hogy "extrapolál" és "saccol"? Költői kérdés, mert a fentiek alapján nem érdekel, mert még egy "aims to" kifejezést nem sikerül lefordítanod."

A hivatalos honlapjukon van leirva, persze hogy nem erdekel, mert teged cafol.

De ujra, miert neznel utana barminek is magadtol..."Te mész szemben az autópályán mindenkivel, nem én"

Az erdekes, mert te ferditettel, nem en, gorgess vissza. Csak ahelyett, hogy gyakoroltal volna egy kis onreflexiot, megastad a szokasos ongol godrot, aztan terelsz."Más hogyhogy elfogadja az információkat amiket írok"

De miert haritasz? Leirtal egy ferditest egy altalad linkelt forrasrol.

Amit leirtal a forumon a forrassal kapcsolatban az nem igaz, mert a producer mast mondott.

Most ezert ram haragszol, mert te ferditettel?Nem mondta, hogy a legtobb usernek nem tetszett, hanem azt mondta sok usernek nem tetszett, ami szamok nelkul NULLA informacio. Mi az a sok? 100? 10000? 100000?

Csak Nvidia tulajok szamitanak? Mi van azokkal, akiknek ezt elkuldom, koze nincs a jatekhoz, gepe sincsen, es dislike-olja, amit a Youtube nem is kozol.Vagy szerinted hogy megy a forumozas, hogy mindenki csak autopilotban hsz-t gyujt?

Most az a bajod, hogy te linkeltel valamit a nyilvanos forumra megnezesre es valaszoltak hogy marhasagot irtal, a forras egyaltalan nem ezt emlit?

Az szerintem mindenkinek vilagos, hogy nem szeretsz utananezni a dolgoknak es a mostani sajat valaszreakciokkal is csak hsz-t jarsz gyujteni. -

PuMbA

titán

PuMbA

titán

Hogy hozzak példát: anno világosan leírtam, amikor 6700XT-re váltottam RTX3060-ról, hogy az RT teljesítménye gyengébb és visszább kellett vennem az RT-ből, valamint FSR 2/3 nem jó és az akkori DLSS verzió mennyivel jobb volt. Ajnároztam a DLSS-t. Teleírtam vele az AMD GPU-k jövője topikot, visszakereshető

XeSS-sel toltam játékokat, ha szükség volt felskálázásra.

XeSS-sel toltam játékokat, ha szükség volt felskálázásra.Most a 9070-emmel nem vágyokozok

Most a 9070-emmel nem vágyokozok különösképp, mert megkaptam azt, amit a 6700XT-vel elveszítettem anno az RTX3060-nal szemben. A 6700XT előnye a raszter teljesítményben volt és hogy kevésbé kellett FSR-re támaszkodnom az RTX3060-nal szemben.

-

PuMbA

titán

PuMbA

titán

Hogy hozzak példát: anno világosan leírtam, amikor 6700XT-re váltottam RTX3060-ról, hogy az RT teljesítménye gyengébb és visszább kellett vennem az RT-ből, valamint FSR 2/3 nem jó és az akkori DLSS verzió mennyivel jobb volt. Ajnároztam a DLSS-t. Teleírtam vele az AMD GPU-k jövője topikot, visszakereshető

XeSS-sel toltam játékokat, ha szükség volt felskálázásra.

XeSS-sel toltam játékokat, ha szükség volt felskálázásra.Most a 9070-emmel nem vágyokozok

-

X2N

őstag

X2N

őstag

A Titok:

Egy éve vettél Radeon kártyát elötte Nvidiád volt és azóta megváltozott a hozzáállásod. Azóta Nvidia fika megy tőled, elötte meg kitiltottak a Radeon topikból.. Szóval a titok hogy vs topikokban az a jó ami a gépedben van ,elfelejted amit elötte kaptál.Annyira rossz volt elötte Nvidiát használni? Ha már a poltikát szóba hoztad,ez most sok helyszínen zajlik, ne aggódj.

Mielött mondanád, Én sem vagyok pártatlan, nekem mindíg is az Nvidia volt az első számú.De cserében nem forgok napra.Veszélyesek ezek a radeon kártyák. Kiből mit hoz ki.

Tőlem már akkor is ment az nv fika amikor a sokadik nv kártyám volt. Részemről nincs részrehajlás. Kapja mindenki az ívet.

Tőlem már akkor is ment az nv fika amikor a sokadik nv kártyám volt. Részemről nincs részrehajlás. Kapja mindenki az ívet. ![;]](//cdn.rios.hu/dl/s/v1.gif)

-

PuMbA

titán

PuMbA

titán

> Más hogyhogy elfogadja az információkat amiket írok úgy, ahogy vannak és nem kell hétpecsétes bírósági iratot benyújtanom neki komplett matematikai bizonyítással a harmadik tizedesjegyig?

> 20.5 éve PH-zok

Szalad az idő...

Szalad az idő...azért emlékeztetlek, hogy ez egy szakmai fórum,

és nem árt, hogyha mindenben pontosak és precizek vagyunk!

emiatt jelzem, hogy

20.56825358995894248437 éve vagy a PH-n !

és ez az érték folyamatosan nő, minden másodpercel

és már el is avult az érték !

// ha kell, akkor lehetek még preziebb is !

amúgy sokszor én se értek egyet Busterftw -vel.Ez jó

b.: Még az előző hozzászólásomhoz. Azért volt NVIDIA és AMD kártyám is, mert ha már érdekelnek a VGA-k, akkor legyen tapasztalatom mindkét oldalról.

-

PuMbA

titán

PuMbA

titán

A Titok:

Egy éve vettél Radeon kártyát elötte Nvidiád volt és azóta megváltozott a hozzáállásod. Azóta Nvidia fika megy tőled, elötte meg kitiltottak a Radeon topikból.. Szóval a titok hogy vs topikokban az a jó ami a gépedben van ,elfelejted amit elötte kaptál.Annyira rossz volt elötte Nvidiát használni? Ha már a poltikát szóba hoztad,ez most sok helyszínen zajlik, ne aggódj.

Mielött mondanád, Én sem vagyok pártatlan, nekem mindíg is az Nvidia volt az első számú.De cserében nem forgok napra.Nem megy NVIDIA fika tőlem és napra sem forgok. Az információk alátámasztják, amit mondok. Lásd Steam felmérésen 1,5 éve folyamatosan növekszik az AMD kártyák részesedése

A kitiltásom off topik miatt volt, nem azért mert hülyeségeket írtam.

-

b.

félisten

b.

félisten

Ha az előző hozzászólásomra nem is, de erre az egy kérdésre válaszolj. Hogy lehet az, hogy folyamatosan írok a PH-ra (már 16 éve), többféle topikban és az utóbbi körülbelül 1 évben csak te vagy aki így viselkedik / viselkedett velem? Más hogyhogy elfogadja az információkat amiket írok úgy, ahogy vannak és nem kell hétpecsétes bírósági iratot benyújtanom neki komplett matematikai bizonyítással a harmadik tizedesjegyig?

A Titok:

Egy éve vettél Radeon kártyát elötte Nvidiád volt és azóta megváltozott a hozzáállásod. Azóta Nvidia fika megy tőled, elötte meg kitiltottak a Radeon topikból.. Szóval a titok hogy vs topikokban az a jó ami a gépedben van ,elfelejted amit elötte kaptál.Annyira rossz volt elötte Nvidiát használni? Ha már a poltikát szóba hoztad,ez most sok helyszínen zajlik, ne aggódj.

Mielött mondanád, Én sem vagyok pártatlan, nekem mindíg is az Nvidia volt az első számú.De cserében nem forgok napra. -

Yutani

nagyúr

Yutani

nagyúr

hamarosan PCIe 8.0

"PCI-SIG PCIe 8.0 Specification Draft 0.5 Released"És akik szerint a PCIe 3.0 mindenre elég,

azoknak emlékeztetőül, hogy néha a PCIe 4.0 - se elég.

Itt csak az látszik, hogy elfogyott a 8GB 1440p-n ebben a játékban, és a herélt 8x sávon próbálja átpumpálni az adatot a rendszer.

-

Jacek

veterán

Jacek

veterán

> Más hogyhogy elfogadja az információkat amiket írok úgy, ahogy vannak és nem kell hétpecsétes bírósági iratot benyújtanom neki komplett matematikai bizonyítással a harmadik tizedesjegyig?

> 20.5 éve PH-zok

Szalad az idő...

Szalad az idő...azért emlékeztetlek, hogy ez egy szakmai fórum,

és nem árt, hogyha mindenben pontosak és precizek vagyunk!

emiatt jelzem, hogy

20.56825358995894248437 éve vagy a PH-n !

és ez az érték folyamatosan nő, minden másodpercel

és már el is avult az érték !

// ha kell, akkor lehetek még preziebb is !

amúgy sokszor én se értek egyet Busterftw -vel.Kivel?

-

S_x96x_S

addikt

S_x96x_S

addikt

> Más hogyhogy elfogadja az információkat amiket írok úgy, ahogy vannak és nem kell hétpecsétes bírósági iratot benyújtanom neki komplett matematikai bizonyítással a harmadik tizedesjegyig?

> 20.5 éve PH-zok

Szalad az idő...

Szalad az idő...azért emlékeztetlek, hogy ez egy szakmai fórum,

és nem árt, hogyha mindenben pontosak és precizek vagyunk!

emiatt jelzem, hogy

20.56825358995894248437 éve vagy a PH-n !

és ez az érték folyamatosan nő, minden másodpercel

és már el is avult az érték !

// ha kell, akkor lehetek még preziebb is !

amúgy sokszor én se értek egyet Busterftw -vel. -

PuMbA

titán

PuMbA

titán

Ha az előző hozzászólásomra nem is, de erre az egy kérdésre válaszolj. Hogy lehet az, hogy folyamatosan írok a PH-ra (már 16 éve), többféle topikban és az utóbbi körülbelül 1 évben csak te vagy aki így viselkedik / viselkedett velem? Más hogyhogy elfogadja az információkat amiket írok úgy, ahogy vannak és nem kell hétpecsétes bírósági iratot benyújtanom neki komplett matematikai bizonyítással a harmadik tizedesjegyig?

20.5 éve PH-zok

Szalad az idő...

Szalad az idő... -

PuMbA

titán

PuMbA

titán

"Ott van, hogy "aims to"."

Köszönöm, tehát hülyeséget írtál, mert nem találgat, hiszen az "aims to" nem ezt jelenti csak azt, hogy a pontossága mondjuk +-3%, amitől még a like-dislike arány nem változik jelentősen

"A saját 3rd party API-juk extrapolal egy saccolt számot."

Ez hova van leírva, hogy "extrapolál" és "saccol"? Költői kérdés, mert a fentiek alapján nem érdekel, mert még egy "aims to" kifejezést nem sikerül lefordítanod.

"Pontosan, topikból topikra ezt csinálod. "

És senkinek nincs baja vele, csak neked

Érzed, hogy a közös nevező te vagy? Te mész szemben az autópályán mindenkivel, nem én. Szeretném megélni azt a pillanatot, amikor felfogod, de sajnos nem tudom, hogy ez mikor következik be

Érzed, hogy a közös nevező te vagy? Te mész szemben az autópályán mindenkivel, nem én. Szeretném megélni azt a pillanatot, amikor felfogod, de sajnos nem tudom, hogy ez mikor következik be

Ha az előző hozzászólásomra nem is, de erre az egy kérdésre válaszolj. Hogy lehet az, hogy folyamatosan írok a PH-ra (már 16 éve), többféle topikban és az utóbbi körülbelül 1 évben csak te vagy aki így viselkedik / viselkedett velem? Más hogyhogy elfogadja az információkat amiket írok úgy, ahogy vannak és nem kell hétpecsétes bírósági iratot benyújtanom neki komplett matematikai bizonyítással a harmadik tizedesjegyig?

-

PuMbA

titán

PuMbA

titán

Ott van, hogy "aims to". A saját 3rd party API-juk extrapolal egy saccolt számot. Ezért a szám nem lehet pontos, tehát csak találgatni tudnak, mivel nem publikus a dislike szám.

Ezt leirják a honlapjukon.Fejtsd ki légyszíves ezen tények után, hogy ez mitől nevetséges?

Tudják pontosan a számokat? Nem, hiszen azt csak a videó tulajdonosa tudja, nem publikus.

Tehát ilyen-olyan megoldással találgatnak? Igen, lásd a honlapon.A többit meg kihagytad. Hányan nyomtak dislike-ra, mert fújNvidia, fújfelskálázó, nem töltött be a videó stb?

Teljesen ignorálod ezeket, nyilván nem véletlenül."Ideje észrevenni, hogy csak te csinálod ezt."

Pontosan, topikból topikra ezt csinálod. Amikor objektíven megcáfolnak (lásd a producer idézetének ferdítése fentebb, vagy hogy miert nem releváns a nem publikus dislike szám , akkor terelsz, majd bármilyen önreflexió nélkül később csinálod ugyanazt.

Nagyon rontja a szakmai topikok minőségét.

Egy kis utánanézésel ennek többsége pedig elkerülhető lenne, de hát már ez is sokszor el lett mondva, eredménytelenül."Ott van, hogy "aims to"."

Köszönöm, tehát hülyeséget írtál, mert nem találgat, hiszen az "aims to" nem ezt jelenti csak azt, hogy a pontossága mondjuk +-3%, amitől még a like-dislike arány nem változik jelentősen

"A saját 3rd party API-juk extrapolal egy saccolt számot."

Ez hova van leírva, hogy "extrapolál" és "saccol"? Költői kérdés, mert a fentiek alapján nem érdekel, mert még egy "aims to" kifejezést nem sikerül lefordítanod.

"Pontosan, topikból topikra ezt csinálod. "

És senkinek nincs baja vele, csak neked

Érzed, hogy a közös nevező te vagy? Te mész szemben az autópályán mindenkivel, nem én. Szeretném megélni azt a pillanatot, amikor felfogod, de sajnos nem tudom, hogy ez mikor következik be

Érzed, hogy a közös nevező te vagy? Te mész szemben az autópályán mindenkivel, nem én. Szeretném megélni azt a pillanatot, amikor felfogod, de sajnos nem tudom, hogy ez mikor következik be

-

Busterftw

nagyúr

Busterftw

nagyúr

"Csak ugye a leiras nem csak ezt mondja, hanem azt is, hogy masszivan talalgatnak/probalkoznak."

Rámutatnál a leírásban a "találgatás" szóra?

Mert én ilyet nem olvastam. A leírásban pontosan ez áll: amíg számolta a Gugli a dislike-okat, azokat az archív adatokat kinyerték és ehhez adják hozzá a böngésző bővítményben számolt dislike számokat.

Mert én ilyet nem olvastam. A leírásban pontosan ez áll: amíg számolta a Gugli a dislike-okat, azokat az archív adatokat kinyerték és ehhez adják hozzá a böngésző bővítményben számolt dislike számokat.Továbbra is az eddigi vitáidhoz hasonlóan próbálod hitelteleníteni az adatokat / információkat mindenféle nevetséges indokkal. Bármit kitalálsz, csak legyen valami baj velük, hogy te nyerd meg a vitát. Nagyon átlátszó, hogy sose jó neked semmi, csak az amit te állítasz, amiről még ennyi infód sincs

Ott van, hogy "aims to". A saját 3rd party API-juk extrapolal egy saccolt számot. Ezért a szám nem lehet pontos, tehát csak találgatni tudnak, mivel nem publikus a dislike szám.

Ezt leirják a honlapjukon.Fejtsd ki légyszíves ezen tények után, hogy ez mitől nevetséges?

Tudják pontosan a számokat? Nem, hiszen azt csak a videó tulajdonosa tudja, nem publikus.

Tehát ilyen-olyan megoldással találgatnak? Igen, lásd a honlapon.A többit meg kihagytad. Hányan nyomtak dislike-ra, mert fújNvidia, fújfelskálázó, nem töltött be a videó stb?

Teljesen ignorálod ezeket, nyilván nem véletlenül."Ideje észrevenni, hogy csak te csinálod ezt."

Pontosan, topikból topikra ezt csinálod. Amikor objektíven megcáfolnak (lásd a producer idézetének ferdítése fentebb, vagy hogy miert nem releváns a nem publikus dislike szám , akkor terelsz, majd bármilyen önreflexió nélkül később csinálod ugyanazt.

Nagyon rontja a szakmai topikok minőségét.

Egy kis utánanézésel ennek többsége pedig elkerülhető lenne, de hát már ez is sokszor el lett mondva, eredménytelenül. -

PuMbA

titán

PuMbA

titán

"Csak ugye a leiras nem csak ezt mondja, hanem azt is, hogy masszivan talalgatnak/probalkoznak."

Rámutatnál a leírásban a "találgatás" szóra?

Mert én ilyet nem olvastam. A leírásban pontosan ez áll: amíg számolta a Gugli a dislike-okat, azokat az archív adatokat kinyerték és ehhez adják hozzá a böngésző bővítményben számolt dislike számokat.

Mert én ilyet nem olvastam. A leírásban pontosan ez áll: amíg számolta a Gugli a dislike-okat, azokat az archív adatokat kinyerték és ehhez adják hozzá a böngésző bővítményben számolt dislike számokat.Továbbra is az eddigi vitáidhoz hasonlóan próbálod hitelteleníteni az adatokat / információkat mindenféle nevetséges indokkal. Bármit kitalálsz, csak legyen valami baj velük, hogy te nyerd meg a vitát. Nagyon átlátszó, hogy sose jó neked semmi, csak az amit te állítasz, amiről még ennyi infód sincs

Ideje észrevenni, hogy csak te csinálod ezt. Nézz körül…akár más topikokban is. Nem feltűnő?

-

PuMbA

titán

PuMbA

titán

"A dislike-ok számát az ezt a nem hivatalos YouTube böngésző kiterjesztést használók között, akik rányomnak a dislike gombra számolják meg a leírása szerint"

Csak ugye a leiras nem csak ezt mondja, hanem azt is, hogy masszivan talalgatnak/probalkoznak."tehát a valós dislike számok még nagyobbak"

Ezt csak a video tulajdonosa tudja megmondani a Studio statok alapjan, minden egyeb az talalgatas es hasrautes. Ezert nem relevans.

Azt mar meg sem emlitem, hogy nem tudni hanyan nyomtak dislike-ot a videora csak azert, mert fujNvidia, vagy mert fujfelskalazo, vagy tobb tucat mas indok miatt.De főleg nem mutatja meg az először "legtöbb user" nem szereti majd a "sok user" nem szereti narratívát, elvégre becslések szerint 1.7 milliárd pc gamer van.

"Csak ugye a leiras nem csak ezt mondja, hanem azt is, hogy masszivan talalgatnak/probalkoznak."

Rámutatnál a leírásban a "találgatás" szóra?

Mert én ilyet nem olvastam. A leírásban pontosan ez áll: amíg számolta a Gugli a dislike-okat, azokat az archív adatokat kinyerték és ehhez adják hozzá a böngésző bővítményben számolt dislike számokat.

Mert én ilyet nem olvastam. A leírásban pontosan ez áll: amíg számolta a Gugli a dislike-okat, azokat az archív adatokat kinyerték és ehhez adják hozzá a böngésző bővítményben számolt dislike számokat.Továbbra is az eddigi vitáidhoz hasonlóan próbálod hitelteleníteni az adatokat / információkat mindenféle nevetséges indokkal. Bármit kitalálsz, csak legyen valami baj velük, hogy te nyerd meg a vitát. Nagyon átlátszó, hogy sose jó neked semmi, csak az amit te állítasz, amiről még ennyi infód sincs

-

S_x96x_S

addikt

S_x96x_S

addikt

hamarosan PCIe 8.0

"PCI-SIG PCIe 8.0 Specification Draft 0.5 Released"És akik szerint a PCIe 3.0 mindenre elég,

azoknak emlékeztetőül, hogy néha a PCIe 4.0 - se elég.

-

Busterftw

nagyúr

Busterftw

nagyúr

A dislike-ok számát az ezt a nem hivatalos YouTube böngésző kiterjesztést használók között, akik rányomnak a dislike gombra számolják meg a leírása szerint, ami azt jelenti, hogy akik nem használják ezt a nem hivatalos YouTube böngésző kiterjesztést, de dislike-ra nyomtak az bele se számolódik, tehát a valós dislike számok még nagyobbak, így abban az értelemben "marhára nem releváns", hogy még több is

A leírás:

"This extension aims to restore power to users by using a combination of archived like and dislike data, as well as the likes and dislikes made by extension users to show the most accurate ratings.""A dislike-ok számát az ezt a nem hivatalos YouTube böngésző kiterjesztést használók között, akik rányomnak a dislike gombra számolják meg a leírása szerint"

Csak ugye a leiras nem csak ezt mondja, hanem azt is, hogy masszivan talalgatnak/probalkoznak."tehát a valós dislike számok még nagyobbak"

Ezt csak a video tulajdonosa tudja megmondani a Studio statok alapjan, minden egyeb az talalgatas es hasrautes. Ezert nem relevans.

Azt mar meg sem emlitem, hogy nem tudni hanyan nyomtak dislike-ot a videora csak azert, mert fujNvidia, vagy mert fujfelskalazo, vagy tobb tucat mas indok miatt.De főleg nem mutatja meg az először "legtöbb user" nem szereti majd a "sok user" nem szereti narratívát, elvégre becslések szerint 1.7 milliárd pc gamer van.

-

S_x96x_S

addikt

S_x96x_S

addikt

az AMD MI430X - a legerősebb FP64 -es kártya

és ez az állítás igaz is

mivel az nvidia már nem a native FP64 -re fókuszál.AMD MI430X Is The “Highest Performance” FP64 GPU Ever Built, Surpassing NVIDIA’s Rubin By 6x In Classic-HPC Workloads

https://wccftech.com/amd-mi430x-highest-performance-fp64-gpu-ever-built-surpassing-nvidia-rubin-by-6x/"AMD has always been a leader in terms of FP64 FLOPs, and their next-generation MI430X has now been previewed, offering up to 200 TFLOPs of raw FP64 performance, the highest ever for any HPC GPU."

-

PuMbA

titán

PuMbA

titán

A dislike-ok számát az ezt a nem hivatalos YouTube böngésző kiterjesztést használók között, akik rányomnak a dislike gombra számolják meg a leírása szerint, ami azt jelenti, hogy akik nem használják ezt a nem hivatalos YouTube böngésző kiterjesztést, de dislike-ra nyomtak az bele se számolódik, tehát a valós dislike számok még nagyobbak, így abban az értelemben "marhára nem releváns", hogy még több is

A leírás:

"This extension aims to restore power to users by using a combination of archived like and dislike data, as well as the likes and dislikes made by extension users to show the most accurate ratings." -

Busterftw

nagyúr

Busterftw

nagyúr

A problema meg mindig azzal van, hogy a like/dislike ratio marhara nem relevans, mert a Youtube nem kozol publikus dislike szamokat...

-

Kolbi_30

őstag

Kolbi_30

őstag

Gyors példa

Mókusok: 16e

Hörcsögök: 82eTeljes erdei állatok: 1.5 millió

Tehát szerinted: tök ireleváns, sőt idézlek "érdekes számösszehasonlításokat, aminek nincs alapja" hogy az erdőben mennyi mókus vagy hörcsög lakik. Szerintem mindent megbeszéltünk.

Téma:

De azért jó hogy szóba került, mert pontosan tudod te is és én is, milyen kevés az a 82e ember, akinek nem tetszett a DLSS5 a 1.5 millióból.

Szerintem ezen folosleges porogni.

Megnezte x fő, abbol y ugy gondolta nem jo..z nek tetszett a maradek meg le se szarta. Ezek a like dislike nyomkodasok semmit nem mondanak semmirol..en is nezek videokat de nem nyomkodok.. -

X2N

őstag

X2N

őstag

Jó, hát a Digital Foundry szakmai hitelessége a blama előtt is a Linus Tech Tips szintjén volt, a többi influenszer csatornával is azonos szinten...

Nálatok ki az abszolút mélypont?

-

b.

félisten

b.

félisten

Jó, hát a Digital Foundry szakmai hitelessége a blama előtt is a Linus Tech Tips szintjén volt, a többi influenszer csatornával is azonos szinten...

Na ne viccelj már.

Azzal a videóval sem volt semmi baj, elmondták az első benyomásaikat.

Totál egyetértek velük. -

Alogonomus

őstag

Alogonomus

őstag

-

PuMbA

titán

PuMbA

titán

-

X2N

őstag

X2N

őstag

Igen és ne feledkezzünk el a Digital Foundry-s féle blamáról se...

-

PuMbA

titán

PuMbA

titán

És mi van azzal, hogy nekem például nem tetszett, de mégse nyomtam dislike-ra, mert sose szoktam YouTube-on értékelni?

Attól, hogy valaki megnézte a videót, de nem nyomott a dislike-ra az nem jelenti azt, hogy tetszett neki, mert ha jól olvasom, te erről írtál most.

Attól, hogy valaki megnézte a videót, de nem nyomott a dislike-ra az nem jelenti azt, hogy tetszett neki, mert ha jól olvasom, te erről írtál most.Önmagában a megtekintés szám ezért nem mérvadó szerintem, mert semmit se tudunk meg belőle, se azt, hogy tetszett-e, se azt, hogy nem tetszett-e azoknak, akik nem szavaztak, így a megtekintés szám akármennyi lehet, nem változtat abban, amit biztosan tudunk, tehát a like-dislike számokat.

-

Hopan

lelkes újonc

Hopan

lelkes újonc

Helyes, tehát majdnem egy millióval nőtt a nézettség, és csak 19 ezerrel a nem tetszések száma.

Valamiért az az érzésem, hogy egy 10 milliós megtekintés melletti ezres dislike-nak is ugyan ez volna a mondanivalója számotokra, értitek ugye mire gondolok????

-

X2N

őstag

X2N

őstag

Neked az nem elég? Már 2,4M megtekintésnél jár, 19E like/101E dislike-al.

Bőven elég információ ez, nekem se szokásom like/dislike-olgatni.![;]](//cdn.rios.hu/dl/s/v1.gif)

Erre már reagálnia kellett a CEO-nak is kármentésként...azzal hogy a játékosok hülyék és nem értenek hozzá. -

Hopan

lelkes újonc

Hopan

lelkes újonc

Tessék: a producer nem ezt írta, bocs, benéztem. Ettől még az elhangzott állításaim mindegyikét tartom, azt is hogy a DLSS 5 a legtöbb embernek nem tetszett, így semmiféle öngól nincs

Minden állításomnak megvan a helye továbbra is, csak nem a Capcom cikk az alapja, most ez nekem mindegy igazából.

Minden állításomnak megvan a helye továbbra is, csak nem a Capcom cikk az alapja, most ez nekem mindegy igazából." DLSS 5 a legtöbb embernek nem tetszett"

Ez egészen pontosan, abból az egy példából kiindulva, amiről már beszélgettünk ma, így néz ki:

Az 1,5 millió ember közöl mindössze 82e ember jelezte, hogy nem tetszik, és 16e ember jelezte, hogy tetszik.

-

PuMbA

titán

PuMbA

titán

Tessék: a producer nem ezt írta, bocs, benéztem. Ettől még az elhangzott állításaim mindegyikét tartom, azt is hogy a DLSS 5 a legtöbb embernek nem tetszett, így semmiféle öngól nincs

Minden állításomnak megvan a helye továbbra is, csak nem a Capcom cikk az alapja, most ez nekem mindegy igazából.

Minden állításomnak megvan a helye továbbra is, csak nem a Capcom cikk az alapja, most ez nekem mindegy igazából. -

Busterftw

nagyúr

Busterftw

nagyúr

"Csak ugye en nem irtam semmit, amit ala kellene tamasztanom, te hoztad a linket es ferditetted a producer idezetet."

Én se írtam semmit, amit alá kellene támasztanom

Mivel nincs pontos adatunk róla így nem is bírnám alátámasztani, tehát csak a saját tapasztalatomból indulhatok ki, mégpedig hogy akármerre jártam a neten, sok negatív DLSS 5 kommenttel, cikkel, videóval találkoztam és kevés pozitívval. Ez a saját tapasztalatom, de mondd, ha a tied más volt és te e helyett láttad azt a sok pozitív megnyilvánulást. Erre lehetőséget ad a fórum.

Mivel nincs pontos adatunk róla így nem is bírnám alátámasztani, tehát csak a saját tapasztalatomból indulhatok ki, mégpedig hogy akármerre jártam a neten, sok negatív DLSS 5 kommenttel, cikkel, videóval találkoztam és kevés pozitívval. Ez a saját tapasztalatom, de mondd, ha a tied más volt és te e helyett láttad azt a sok pozitív megnyilvánulást. Erre lehetőséget ad a fórum.Írtál egy ferdítést aztán rúgtad az öngólokat.

Nem lett volna egyszerűbb visszaolvasni valójában mit írt a producer és elintézni annyival, hogy basszus, tényleg nem azt írta, my bad.Inkább maradtál a ferdítésnél és rúgtad az öngólokat amikor szembesítés jött.

-

PuMbA

titán

PuMbA

titán

Mert ez adja meg a valaszt az elferditett kijelentesre. Enelkul a kijelentes egy hasrautes.

"Te sem tudod alátámasztani, hogy pontosan hány embernek tetszik a DLSS 5 és ezt a bizonytalanságod akarod lenyomni a torkomon"

Csak ugye en nem irtam semmit, amit ala kellene tamasztanom, te hoztad a linket es ferditetted a producer idezetet.

Nalam nincs semmilyen bizonytalansag, ott van feketen feheren, hogy valojaban mit mondott a producer es te mit ferditettel ebbol."A legjobb tudomásunk szerint pedig a legtöbb embernek nem tetszett a DLSS 5, mert több erre vonatkozó információ van a neten, mint pozitív vélemény."

Ami pontosan mi, mi a minta? Mert:

1. a producer meg mindig nem azt mondta, hogy a legtobb usernek nem tetszett.

2. Az itteni forumon XY embernek nem tetszett, mi pontosan az arany?

3. Egy darab youtube video like/dislike aranya, amit a Youtube 5 eve nem kozol.

4. A neten fellelheto osszes megjelent DLSS5 videot/anyagot megtekinto userekbol mennyinek nem tetszett?

Ezeket a pontokat buktad eddig."Ugyanezt tetted a Steam statisztikás csörtédnél."

Pontosan mit? A Steam statisztika es a globalis market share korrelaciot mutat generaciokon keresztul.

Mivel nem ertesz egyet? Utananezhetsz te is, ugyanaz lesz a konkuzio."Képzeljétek el"

Kepzeljetek el, hogy milyen jo lenne a szakmai topik, ha nem szubjektiv, teves hasrautesekkel es trust me bro forrasokkal lenne teli, barmilyen onreflekcio nelkul."Csak ugye en nem irtam semmit, amit ala kellene tamasztanom, te hoztad a linket es ferditetted a producer idezetet."

Én se írtam semmit, amit alá kellene támasztanom

Mivel nincs pontos adatunk róla így nem is bírnám alátámasztani, tehát csak a saját tapasztalatomból indulhatok ki, mégpedig hogy akármerre jártam a neten, sok negatív DLSS 5 kommenttel, cikkel, videóval találkoztam és kevés pozitívval. Ez a saját tapasztalatom, de mondd, ha a tied más volt és te e helyett láttad azt a sok pozitív megnyilvánulást. Erre lehetőséget ad a fórum.

Mivel nincs pontos adatunk róla így nem is bírnám alátámasztani, tehát csak a saját tapasztalatomból indulhatok ki, mégpedig hogy akármerre jártam a neten, sok negatív DLSS 5 kommenttel, cikkel, videóval találkoztam és kevés pozitívval. Ez a saját tapasztalatom, de mondd, ha a tied más volt és te e helyett láttad azt a sok pozitív megnyilvánulást. Erre lehetőséget ad a fórum. -

Busterftw

nagyúr

Busterftw

nagyúr

"Aha, tehat hany userbol a vilagon hanynak nem tetszett pontosan a DLSS5?

Ez a valasz jelentene a valosagot."Miért kérdezel olyat, amiről tudjuk, hogy nincs pontos adat? Ugyanezt tetted a Steam statisztikás csörtédnél. Te sem tudod alátámasztani, hogy pontosan hány embernek tetszik a DLSS 5 és ezt a bizonytalanságod akarod lenyomni a torkomon

Továbbra sem bíróság a fórum, hogy nekem pontosan pecsétes papírral igazolni kell, amit írok és a legjobb tudomásunk szerinti információkból dolgozunk. A legjobb tudomásunk szerint pedig a legtöbb embernek nem tetszett a DLSS 5, mert több erre vonatkozó információ van a neten, mint pozitív vélemény.

Továbbra sem bíróság a fórum, hogy nekem pontosan pecsétes papírral igazolni kell, amit írok és a legjobb tudomásunk szerinti információkból dolgozunk. A legjobb tudomásunk szerint pedig a legtöbb embernek nem tetszett a DLSS 5, mert több erre vonatkozó információ van a neten, mint pozitív vélemény.Mert ez adja meg a valaszt az elferditett kijelentesre. Enelkul a kijelentes egy hasrautes.

"Te sem tudod alátámasztani, hogy pontosan hány embernek tetszik a DLSS 5 és ezt a bizonytalanságod akarod lenyomni a torkomon"

Csak ugye en nem irtam semmit, amit ala kellene tamasztanom, te hoztad a linket es ferditetted a producer idezetet.

Nalam nincs semmilyen bizonytalansag, ott van feketen feheren, hogy valojaban mit mondott a producer es te mit ferditettel ebbol."A legjobb tudomásunk szerint pedig a legtöbb embernek nem tetszett a DLSS 5, mert több erre vonatkozó információ van a neten, mint pozitív vélemény."

Ami pontosan mi, mi a minta? Mert:

1. a producer meg mindig nem azt mondta, hogy a legtobb usernek nem tetszett.

2. Az itteni forumon XY embernek nem tetszett, mi pontosan az arany?

3. Egy darab youtube video like/dislike aranya, amit a Youtube 5 eve nem kozol.

4. A neten fellelheto osszes megjelent DLSS5 videot/anyagot megtekinto userekbol mennyinek nem tetszett?

Ezeket a pontokat buktad eddig."Ugyanezt tetted a Steam statisztikás csörtédnél."

Pontosan mit? A Steam statisztika es a globalis market share korrelaciot mutat generaciokon keresztul.

Mivel nem ertesz egyet? Utananezhetsz te is, ugyanaz lesz a konkuzio."Képzeljétek el"

Kepzeljetek el, hogy milyen jo lenne a szakmai topik, ha nem szubjektiv, teves hasrautesekkel es trust me bro forrasokkal lenne teli, barmilyen onreflekcio nelkul. -

PuMbA

titán

PuMbA

titán

Képzeljétek el, hogy milyen gyászos lenne az egész fórum, ha minden szakmai topikban, minden állításra az egész világra vonatkozó pontos globális adatokat kérnének, mert ha nem akkor az egy nem bizonyítható, kamu állítás

![;]](//cdn.rios.hu/dl/s/v1.gif)

-

PuMbA

titán

PuMbA

titán

"Aha, tehat hany userbol a vilagon hanynak nem tetszett pontosan a DLSS5?

Ez a valasz jelentene a valosagot."Miért kérdezel olyat, amiről tudjuk, hogy nincs pontos adat? Ugyanezt tetted a Steam statisztikás csörtédnél. Te sem tudod alátámasztani, hogy pontosan hány embernek tetszik a DLSS 5 és ezt a bizonytalanságod akarod lenyomni a torkomon

Továbbra sem bíróság a fórum, hogy nekem pontosan pecsétes papírral igazolni kell, amit írok és a legjobb tudomásunk szerinti információkból dolgozunk. A legjobb tudomásunk szerint pedig a legtöbb embernek nem tetszett a DLSS 5, mert több erre vonatkozó információ van a neten, mint pozitív vélemény.

Továbbra sem bíróság a fórum, hogy nekem pontosan pecsétes papírral igazolni kell, amit írok és a legjobb tudomásunk szerinti információkból dolgozunk. A legjobb tudomásunk szerint pedig a legtöbb embernek nem tetszett a DLSS 5, mert több erre vonatkozó információ van a neten, mint pozitív vélemény.Máshol nem is találkozok szercsére a PH-n ilyennel csak ebben a topikban van ilyen bírósági hangulat köszönhetően pár embernek

-

X2N

őstag

X2N

őstag

"De tudjuk. Szerinted egy CEO, tehát ebben az esetben Jensen Huang megszólal az ügyben, ha nincs nagy mértékű felháborodás és a többség szerint a DLSS 5 fasza?"

Aha, tehat hany userbol a vilagon hanynak nem tetszett pontosan a DLSS5?

Ez a valasz jelentene a valosagot."Teljesen felesleges egy CEO-nak ezzel foglalkoznia, ha az van, amit te mondasz és mindenki happy"

Na nezzunk egy egyszerubbet, linkeld mar legyszives hol irtam ezt?

Tehat eloszor ferditesz egy barki altal utananezheto forrast, most meg odakepzelsz olyan dolgokat amit en sehol nem irtam fentebb.

Hol irtam, hogy mindenki happy a DLSS5-el kapcsolatban?"Valóságérzékelési gondokat látok itt, mintha nem ugyanazt néznénk."

Es akkor nekem beszelsz valosagerzekelesi problemakrol, amikor ket esetben is pont a valosagot ferdited el.

De ugyanazt neztuk, mind a ketten elolvastuk ugyanazon producer idezetet.

Te masszivan ferditetted, hogy mit mondott, en meg nem.Jensen Huang mért is állít teljesen mást mint ami az nvidia promo anyagban van a DLSS5 működéséről?

-

PuMbA

titán

PuMbA

titán

"De tudjuk. Szerinted egy CEO, tehát ebben az esetben Jensen Huang megszólal az ügyben, ha nincs nagy mértékű felháborodás és a többség szerint a DLSS 5 fasza?"

Aha, tehat hany userbol a vilagon hanynak nem tetszett pontosan a DLSS5?

Ez a valasz jelentene a valosagot."Teljesen felesleges egy CEO-nak ezzel foglalkoznia, ha az van, amit te mondasz és mindenki happy"

Na nezzunk egy egyszerubbet, linkeld mar legyszives hol irtam ezt?

Tehat eloszor ferditesz egy barki altal utananezheto forrast, most meg odakepzelsz olyan dolgokat amit en sehol nem irtam fentebb.

Hol irtam, hogy mindenki happy a DLSS5-el kapcsolatban?"Valóságérzékelési gondokat látok itt, mintha nem ugyanazt néznénk."