- Radeon RX 9060 XT: Ezt aztán jól meghúzták

- Atomenergiával dübörögnek tovább az Amazon adatközpontok, SMR-ek is jöhetnek

- Macron betiltatná az EU-ban a közösségi médiát a 15 év alattiaknak

- Az NVIDIA ipari AI-felhőt épít a németeknek, együtt az OpenAI és a Google

- Két új Ryzen közül választhatnak a kézikonzolok

- Radeon RX 9060 XT: Ezt aztán jól meghúzták

- Vezetékes FÜLhallgatók

- CPU léghűtés kibeszélő

- AMD Ryzen 9 / 7 / 5 7***(X) "Zen 4" (AM5)

- Milyen monitort vegyek?

- Milyen házat vegyek?

- OLED TV topic

- Milyen asztali (teljes vagy fél-) gépet vegyek?

- Milyen videókártyát?

- AMD K6-III, és minden ami RETRO - Oldschool tuning

-

PROHARDVER!

A legtöbb kérdésre (igen, talán arra is amit éppen feltenni készülsz) már jó eséllyel megtalálható a válasz valahol a topikban. Mielőtt írnál, lapozz vagy tekerj kicsit visszább, és/vagy használd bátran a keresőt a kérdésed kulcsszavaival!

Új hozzászólás Aktív témák

-

PuMbA

titán

válasz

Petykemano

#61996

üzenetére

Petykemano

#61996

üzenetére

Én az FSR 2.3-at várom, amiben a kép instabilitást javítják

-

Alogonomus

őstag

válasz

Petykemano

#61998

üzenetére

Petykemano

#61998

üzenetére

A 20% elvileg a sima GDDR6-hoz képest értendő, ha mind a kettő effektív 24 Gbps-on üzemel. A 7% fogyasztási többlet is a 32 Gbps GDDR7 és a 24 Gbps sima GDDR6 között jelentkezik.

A +33% teljesítmény csak a 32 vs. 24 értékből jön, ott mindegy a GDDR6, vagy GDDR6X. -

Petykemano

veterán

válasz

Alogonomus

#61997

üzenetére

Alogonomus

#61997

üzenetére

Akkor ez valami olyasmi, hogy a GDDR6X a GDDR6 bruteforce továbbfejlesztése jelentős felárral, míg a GDDR7 ugyanazokat a képességeket fogja hozni, mint a GDDR6X, csak jobban átgondolt és ennélfogva kevésbé költséges alapokon (PAM3 vs PAM4)?

Vagy a +20% hatékonyság vagy +33% teljesítmény a GDDR6X-hez viszonyítva értendő? -

Alogonomus

őstag

válasz

Petykemano

#61975

üzenetére

Petykemano

#61975

üzenetére

Az azóta kiderült adatok alapján a GDDR7 olyasmi helyzetet hozhat, mint korábban a GDDR6X. A sima 24 Gbps GDDR6-hoz képest azonos sebességen 20%-kal takarékosabb, a 33% sebességelőny mellett pedig 7%-kal éhesebb.

-

Petykemano

veterán

GDC2023 - GPUOpen ismertető videó az FSR-ról: [link]

Megemlítik benne az FSR3-at is. És megemlítik a megnövekedett késleltetés kezelési módját is. (Ez még nem a release)Összefoglaló:

Latest FSR3 details from AMD:

- Non AI frame interpolation

- 2x performance goal

- will be open source

- Runs on all FSR2 compatible GPU

- Built on FSR2 for easy integration

- leverages AMD fluid motion

- will feature advanced latency reduction

Innen -

hahakocka

őstag

Ja S lehet hogy lesz a Gamescomon sima S xt is mindkettőből ki tudja .

-

hahakocka

őstag

7800 mièrt csak a 6800xt hoznà? Elvileg a 4070 S a 4060ti közt lesz erőben 16 GB vrammal. A 7700 meg a 4060ti S a 4070 közt 12 GB vrammal. Sose 3Dmarkkal tippeljetek. Màr annyiszor volt erősebb ez az amaz azt gamek alatt èlesben èg ès föld lett vègül. Ugyanígy M és laptop karikkal tippelni is felelőtlensèg. Tudjuk jól hogy nem egyenlők a pc S tàrsukkal.

-

válasz

Devid_81

#61989

üzenetére

Devid_81

#61989

üzenetére

Nem is csak ez a gond, mert ha 4070 teljesítményű lesz, akkor 50 dolcsival olcsóbb a 7800, ami kb az hogy megint beáraztak egymáshoz szépen és ugyan azt a teljesítményt adják szinte ugyan azon az áron. AMD 50 dollárral olcsóbb lesz ad + 4 GB vramot cserébe RT ben lassabb lesz, valószínűleg 25-30 % kal többet fog enni,a zöld oldalon meg ott a FG és a DLSS meg hát NV a nevével is magyarázhat 50 dollár árkülönbséget, nem tényező piacszerzésben. Nagyjából -ha mérlegelsz- ugyan azt adja a két gyártó, nincs itt semmiféle verseny, csak kartell.

A 7700 teljesítménye bizonytalan de ha 4060 Ti lesz akkor megint ugyan aza szitu, annyi hogy Nvidia ad itt több Vramot 50 dollár felárért de az halottnak a csók,1440P re a 12 GB elég. -

Alogonomus

őstag

Abszolút értékben tényleg 38% és 30% a két kártyával elérhető átlagos fps sebességének a csökkenése. A 14% azt a mértéket jelöli, amennyivel a két kártya között a különbség változott a felbontás változtatásának a hatására. 1080p esetén még kb 2% volt a 4060 előnye, de 1440p esetén már kb 12% lett a 7600 előnye. Vagyis a 7600 összességében kb 14%-kal jobban kezelte a felbontás növekedésével járó extra kihívásokat.

A csapnivaló minimum fps indoka mind a két kártya esetén nyilvánvalóan az elégtelen memória. A tesztútvonal egy bizonyos szakaszán beüt a crach, és feltételezhetően a PCI-Express sín adatátviteli sebessége határozza meg azt az 1% low értéket. -

Devid_81

félisten

RX 6800 MSRP-ert 6800XT teljesitmeny 7800 neven?

A hulyenek is megeri... teljesen ignoralni es nem venni belole

Vicces kedvuek ezek mar megint.

Nyilvan ertjuk, hogy nem adhatjak ingyen, de ez kb a 6700XT-nek az utodja semmi tobb

Majd azzal fognak kampanyolni, hogy nem emeltek arat az RX 6800-hoz kepest

A 7700-at meg passz, hogy mivel akarjak eladni -

válasz

Alogonomus

#61986

üzenetére

Alogonomus

#61986

üzenetére

Az általad linkelt tesztben a 4060 38%,( 38,18)a 7600 pedig 30% esést hoz (29,62%)tehát 8 % a különbség nem 14-15%. és ez szerintem nem igazán kompetens, egyáltalán nem mondható az ki, hogy azt IF cache miatt van, lehet éppen a 4060 kezdeti furcsa energiagazdálkodása miatt van ,amire Igor rávilágított,sőt.

A minimum FPS lenne ebben szerintem mérvadó, de ott mindegyik kártya földbeáll. -

Alogonomus

őstag

A Techspot/HUB tesztjében.

Nagy különbség nincs a két kártya között, de a Plague Tale esetén lényegében nem változik a két kártya erőviszonya a 1080p->1440p váltással, a Last of Us esetén a TPU tesztjében és a HUB tesztjében is 14-15%-al kevesebbet csökken a 7600 teljesítménye a felbontás növelésétől, a Hogwarts Legacy esetén csak a HUB eredményei vannak meg, de ott is 8-9%-kal jobban jön ki a 7600 a több adatot mozgató magasabb felbontásból.

Az nyilvánvaló, hogy a játékokban nem ugyanott mért a két tesztoldal embere, mert mindegyik játék esetén határozottan más értékeket mértek, de mindkét tesztoldal által ugyanott lemért eredmények a két kártyára nézve hasonló tendenciát mutattak. -

Ribi

nagyúr

válasz

Alogonomus

#61983

üzenetére

Alogonomus

#61983

üzenetére

Kinek a tesztjében teljesít rosszabbul? Mert itt gyakorlatilag ugyan olyan.

-

Alogonomus

őstag

A chipek belső kialakításáról kiadott magyarázó die shot kép alapján eléggé nagy az infinity cache helyigénye, a konzolok APU egységeiben pedig nagyon spórolni kellett a helyfoglalásokkal, hogy ne egy 800 mm²-es gigachip legyen. A konzolokhoz hasonló generációt képviselő és hasonló erejű Navi 22 esetén az infinity cache a GPU 20%-át elfoglalja, vagyis a 70 mm²-ével együtt a konzol APU 25%-kal lett volna nagyobb.

A konzoloknál egyébként sem annyira nehéz megoldani a feldolgozó egységek folyamatos "etetését", mert a programozónak annak a konkrét konzolnak a képességeihez kell csak optimalizálnia a folyamatokat, nem eltérő CPU, RAM, merevlemez, alaplap, PCI-E verzió és GPU random kombinációira.

-

Alogonomus

őstag

Az Intel még bőven nem tart ott, hogy ilyen infinity cache típusú finomhangolásokkal foglalkozzon.

Az Nvidia pedig pont arra próbálta terelni a hangsúlyt leginkább a 4060-ak kapcsán, hogy a 16-szorosra felbővített L2 cache 32 MB-ja majd kompenzálja a 128 bites memóriabusz szűkösségét. A tesztek alapján viszont ez nem nyert megerősítést, mert az idei év memóriakapacitás-paráját megalapozó játékokban, mint a Plague Tale: Requiem, Hogwarts Legacy, Last of Us esetén átlagosan rosszabbul teljesített, mint a szintén 128 bites és 8 GB-os hasonló nyers számítási teljesítményű 7600. Szóval az Nvidia nagyon is dolgozik az infinity cache mintájára egy saját cache technológia kifejlesztésén, de eddig még elmaradnak az AMD megoldásának a hatékonyságától. -

Ribi

nagyúr

válasz

Alogonomus

#61977

üzenetére

Alogonomus

#61977

üzenetére

2 gyártó elvan infinity nélkül, a másik meg nyomatja. Amíg nincs úgy megírva a játék hogy tényleg "kell" az oda, addig - és vehető úgy is hogy eddig - nem sok értelme van. Ha meg "kell" akkor kérdés mi lesz a többi gyártóval. Sajna nincs eszköz tesztelni nélküle, így nem tudni mennyire is kell az oda.

-

Alogonomus

őstag

válasz

Petykemano

#61978

üzenetére

Petykemano

#61978

üzenetére

A késleltetést komolyan befolyásolja a fizikai távolság, és az infinity cache garantáltan nagyságrendekkel közelebb lehet a GCD chiplethez - ha nem is egyazon chipleten - , mint amilyen távolságra a GDDR7 chip lehet a PCB-re szerelve.

-

Petykemano

veterán

válasz

Alogonomus

#61977

üzenetére

Alogonomus

#61977

üzenetére

"Az egyre magasabb frekvencián üzemelő GPU számára pedig kiemelten fontos a minél kevesebb üresjárat, amíg az adatra vár."

Hát igen, csak kérdés, hogy ezt az igényt mennyire jól szolgálja ki egy másik chipleten található - relatív kis méretű - cache. -

Alogonomus

őstag

válasz

Petykemano

#61975

üzenetére

Petykemano

#61975

üzenetére

A sebesség csak az infinity cache egyik előnye, a másik előnye a nagyon alacsony késleltetése, amitől valószínűleg a GDDR7 is elmarad. Az egyre magasabb frekvencián üzemelő GPU számára pedig kiemelten fontos a minél kevesebb üresjárat, amíg az adatra vár. Ráadásul várhatóan a következő generációban ugyanúgy komoly fejlesztést kap az infinity cache, ahogy a friss infinity cache is sokkal hatékonyabb, mint az első változata volt.

Szóval az infinity cache szerintem biztosan nagyon lényeges marad a következő generációkban is, mert állítólag egyszerre nagyon energiahatékony, valamint érezhetően javítja a teljes memóriarendszer effektív sávszélességét is. -

Busterftw

nagyúr

válasz

Petykemano

#61975

üzenetére

Petykemano

#61975

üzenetére

Micron 2024 H1-et irt megjelenesre, ez nagyjabol egybeesik a Samsung timeline-nal.

Azt lehet tudni mekkora chipek jonnek? (egybol 2GB vagy nagyobb) -

Petykemano

veterán

Persze a samsung sokszor sokmindent több hónappal azelőtt bejelent, hogy az ténylegesen piackész lenne náluk. De jövőre már biztos ezzel érkeznek kártyák.

Kíváncsi vagyok, hogy a memória fejlődése (sávszélesség) vajon marginalizálja (értsd: csökken-e a MB/CU) az infinity cache-t, ami már az RDNA3-ban is csökkent. Nyilván ez nem azt jelenti, hogy szükségtelenné teszi a cache-t, csak hogy a működését a hatékonyság érdekében (ide értve azt, hogy victim jellegű vagy hogy milyen szinten jelenik meg) át kell szervezni.

Mindenesetre ez is azt sugallja, hogy ha az MCD-t le.lehetne cserélni GDDR7 vezérlősre, akkor a MCD-re stackelt 3D infinity cache némiképp zsákutca. -

válasz

Petykemano

#61971

üzenetére

Petykemano

#61971

üzenetére

Mert valószínűleg a 7800 nak konkurencia lenne itt, ott meg magasabb áron elmegy ez a leeső selejt termék speciális különálló SKu-ként.

Ez az ottani 7800 lesz szerintem csak eltérő GPU val és névvel. -

Busterftw

nagyúr

válasz

Petykemano

#61971

üzenetére

Petykemano

#61971

üzenetére

Szerintem ott van most biztos felvevo piaca es mivel az AMD nem arrol hires, hogy hatalmas wafer mennyiseget foglalna le GPU-kra, fokuszalnak 1 piacra.

Nekem ez a tippem.

-

Petykemano

veterán

Vajon miért csak oda?

- Kína elvileg nagy piac. Ezért nem tűnik valószínűnek, hogy azért kerülne csak ott piacra, mert nagyon kevés van. Egy ilyen SKU-nak biztos máshol is örülnének.

- Kína elvileg nagy piac. Gesztus volna a kínai piac felé?

- Kína elvileg nagy piac. Ott rendelt volna valaki egy ilyen SKU-t nagyobb mennyiségben? -

[AMD Radeon RX 7900 GRE for China]

AMD reportedly working on Radeon RX 7900 GRE with 16GB GDDR6 memory and cut-down Navi 31 GPU

-

S_x96x_S

addikt

akkor nem értünk egyet .. és ez nem baj ..

amúgy én nem látom ennyire drasztikusan versenyellenesnek a jelenlegi helyzetet ..

tény, hogy láthatóan, hogy nem olyan aktív a verseny a consumer gaming - piacon.

és bár a gaming piac is fontos,

de nem a legfontosabb egyik cégnek se, hogy túlzott erőforrásokat elvonjanak más területekről ..> Évek óta a két cég hajszálra pontosan egymáshoz lövi be a termékeit.

> Tehát valahogy tudnak róla, mit hoz a másik.de ez mivel különbözik attól, hogy

egyes nyugdíjasok szerint a hazai élelmiszer boltok összejátszanak,

.. mivel nyilvánvalóan mind egyszerre emelnek árakat ???Mert a GPU-nál is a költségek, a TSMC árak, a Memória árak

és a beszállítói problémák ( covid ) is

egyszerre jelentkeznek mindkét gyártónál.És mivel nem egyszerre jelentik be a termékeket,

mindig a másik bejelentéséhez tudják igazítani az árakat és a kínálatot ..

és ez szerintem normális, régebben is így volt ...amúgy a verseny jó .. és lehetne egy kicsivel nagyobb verseny is ..

-

Yany

addikt

válasz

TESCO-Zsömle

#61967

üzenetére

TESCO-Zsömle

#61967

üzenetére

Szerintem ne a képet nézd, hanem 4k felbontáson kockázd ki magadnak a linkelt videót. Bár ha a képen is rá kell mutatni, akkor az említett gond nem neked szól. Elkezdtem bekarikázni, de rájöttem, hogy semmi értelme, csak azoknak valódi gond ez a minőség, akik enélkül is kiszúrják, nekem pedig egyből feltűnt, szóval fölösleges...

-

Yany

addikt

válasz

Busterftw

#61965

üzenetére

Busterftw

#61965

üzenetére

Az vicces volt, amikor az általam egyébként sokra tartott opimumtech-es gyerek bemondta, hogy tök egyforma az NVENC és a Radeonok AV1-es minősége, majd berakott kb. 0.2s-re egy comparison screenshotot és szénné gyalázta az NV minősége az AMD termékét. Ott varakartam a fejem, hogy a mindig korrekt srác hogy tálalhatta ezt így... Az a fura, hogy az AMD még mindig azt hiszi, hogy az fps/$ az egyetlen mutató, ami alapján az emberek GPU-t választanak. Vajon mikor esik le?

szerk.: megvan, ez volt az a video --> [link]

Ez egy random képkocka a pillanatra bevágott anyagából, több képkockát is megnéztem, nem egy kategória a kettő. -

PuMbA

titán

VR támogatást elvileg 1-2 hete javították:

"Fixed Issues: Certain virtual reality games or applications may encounter suboptimal performance or occasional stuttering on Radeon™ RX 7000 series GPUs."

A szoftveres részt mindenesetre mindenképp fel kell turbóznia Lisa Su-nak, mert ez így gáz, hogy megjelenés után hónappokkal legózzák össze a kártyához a szoftvert. A szoftvernek akkor kell kész lennie, amikor a kártya a boltokba kerül és megengedhetetlen, hogy valamiben is visszalépés legyen, mint az előző generáció, mert nem sikerült időbe megcsinálni. Vegyenek föl több embert, ha ilyen lassúak, ez már nem a felhasználó gondja.

-

X2N

őstag

válasz

Alogonomus

#61960

üzenetére

Alogonomus

#61960

üzenetére

Motion interpolation mint saját technológia?

Ahelyett hogy a fogyasztást javítanák a kártyáiknál vagy a VR támogatást ami miatt mindenki panaszkodik...

Ahelyett hogy a fogyasztást javítanák a kártyáiknál vagy a VR támogatást ami miatt mindenki panaszkodik... -

Alogonomus

őstag

válasz

Petykemano

#61958

üzenetére

Petykemano

#61958

üzenetére

Mostanában több olyan spekulációval találkoztam, hogy az FSR 3-at talán a Starfield kapcsán szeretné bevezetni az AMD, hogy az még jobb eredményeket produkáljon. A Starfield egyértelműen komoly helyen áll az AMD stratégiájában, és talán az lesz az AMD saját "CP:2077" címe, amin keresztül a jövőben is bemutathatja az új technológiáit.

Szóval többek szerint az FSR 3 algoritmusai már bevetésre készek, de a korábbi FSR verziókhoz képest nagyobb csinnadrattával szeretnék majd bemutatni, nem csak simán kiadni egy sima driverfrissítésen keresztül. -

Abu85

HÁZIGAZDA

válasz

Petykemano

#61958

üzenetére

Petykemano

#61958

üzenetére

A srácnak fogalma sincs, hogy mit ír. Eleve a DLSS és az XeSS is alig használ ML-t. A feladat egy hangyafasznyi részében alkalmazzák, a teljes feldolgozás kb. 5%-át, ha kiteszi.

-

Petykemano

veterán

Ez egy érdekes cikk az FSR3-ról. [link]

Nem annyira technológiai leírás. Azt latolgatja, hogy a késés összefüggésben lehet-e azzal, hogy az AMD

- tud-e olyan nem ML alapú algoritmust csinálni, ami az elvárt mértékben jó, miközben megőrzi a visszafelé kompatibilitást és más hardverekkel való kompatibilitást is megőrzi

- vagy kénytelen valamilyen ML alapú algoritmust bevezetni, ami nyilvánvalóan nagyobb számítási teljesítményt igényel, ennek megfelelően szükségessé válhat a hardveres gyorsítás - és itt persze kérdés, hogy az RDNA3-ban található AI accelerator ehhez amúgy használható-e.Szerintem egyébként ebből kár volna eldöntentő kérdést csinálni, hiszen az FSR-nak (is) eleve van P, B, Q erőssége/szintje. Ha ez a nagy eldöntenő kérdés, akkor ezt nyilván úgy lehetne megoldani, hogy a Quality szintre, vagy a meglevő Quality szint fölé vezetik be a ML alapú, jobb minőséget biztosító eljárást, ami megfelelő sebességhez igényli a megfelelő hardveres gyorsítást.

-

válasz

Alogonomus

#61951

üzenetére

Alogonomus

#61951

üzenetére

Nincs ebben semmi meredek azért tettem be a táblázatot hogy az lett volna a normális meder hisz ezt csinálják évek óta és ezért háborog mindenki hogy most eltolták a nevezékeket.

Mit tartasz ezen meredeknek? A normális kerékvágást?

A 3080 Ti az Ampere szériában is 1200 dollár volt. Semmi nem változott volna csak a nevek és a 4080 pedig egy olyan SKU lett volna ami majd talán fog jönni gondolom 4080 Ti néven...

Igen olvastam ezeket az eladatlan készletes dolgokat itt, miközben már januárban sem tudtál nagyon venni 3080 és az fölötti kártyákat. Az RDNA2 most is teljes portfolióval elérhető mindenhol. Ebből kitalálható kit érintett jobban ez a dolog, bárki bármit is állít. -

Alogonomus

őstag

A gondolatmenetedben kicsit meredek feltételezésnek tűnik, hogy a 4080-at 1200$ helyett valóban kiadhatták volna 700$-os áron érdemi nyereség mellett. Ráadásul a 700$-os 4080 esetén a 4070 Ti is csak nagyjából 450$ lehetett volna a 800$ helyett, az eladások tömegét hozó 4070 pedig nagyjából 350$ a 600$ helyett. Mármint a táblázat és a "visszavágottság" alapján kalkulálva.

"AMD elbukta volna az összes kint lévő RDNA2 készletét"

Ezzel kapcsolatban is sokkal többet veszített volna az Nvidia, ha a pénzügyi jelentésében szereplő 5 milliárd dollárnyi eladatlan Ampere készletet nézzük, ami úgy garantáltan minden teljesítménykategóriában eladhatatlanná vált volna.

Ráadásul egy ilyen lépésre válaszként az EVGA-n felül szinte biztosan több másik AIB is beintett volna az Nvidia-nak.Az árak megállapításakor még a Geforce széria bevételeire bőven és jelentősen támaszkodó Nvidia számára ez a lépés a céges szintű nyereséget tekintve is nagy sebet okozott volna, míg az AMD nyugodtan bele tudott volna állni az árversenybe, mert az AMD bevételeinek túlnyomó része a konzolokból, CPU-kból és úgy egészében a HPC piacról származik.

-

Petykemano

veterán

Az Strix APU-k esetén a kódnév tényleg RDNA3.5 jellegű ugrást vesz, ami a korábbiakhoz képest szokatlan.

AMD GFX1150/1151, the GPUs for Ryzen 8000 “Strix” series [link]

-

válasz

S_x96x_S

#61942

üzenetére

S_x96x_S

#61942

üzenetére

"vagyis akkor szerinted az nVidia direkt így tervezte?

- és minden rendben?

- és az Nvidia szerint az AMD nem veszélyes ????"Jó, ez hosszú lesz.

Most akkor menjünk bele az összeesküvés elméletekbe aztán vagy komolyan veszed vagy nem.

Évek óta a két cég hajszálra pontosan egymáshoz lövi be a termékeit. Tehát valahogy tudnak róla, mit hoz a másik.

Évek óta fejlesztik a Chiplet dizájnt, Nvidia monlotikus ugye.

MI történik?: Jön két SKU AMD től a minek a másik oldalon meg van a megfelelő párja szinte centire pontosan, (5 % ilyesmi) az eltérés.

Két lehetőség van.

Nvidia marad az eredeti ütemtervnél és követi a szokásos számozást.

Tehát kiadja a most 4080 nak hívott kártyát 4070 Ti ként 5-699$ áron.

Kihoz a 4090 alá egy SKu-t mert hatalmas hely van ott, 4080 néven 20 GB rammal, 999$ áron a 4090 marad ott ahol van és jön egy 4090 Ti ami 15-20 % kal gyorsabb( vagy a 4090 lesz 4080 Ti 1200 dolláros áron)

AMD ebben az esetben a mostani 7900XTX kártyát 7800 nak tudja eladni maximum 5-600 dolláros áron.

igen ám de 20 % kal gyorsabb csak mint a 6950XT tehát azt le kell vinniük a partnereknek valahova 4-500 dollár közé.

akkor hova adod el a többi RDNA2-t? 300 dollárért 6800 XT ? mert a 4060 akkor kb a mostani 4070 lenne.

AMD ebbukta volna az öszes kint lévő RDNA2 készletét és az RDNA3 ból a 7900XTX en kívül semmit nem tudott volna kihozni. Durva ez így leírva de szerintem így van...

Hatalmas szakadék van a két dizájn között amúgy ha így nézed szinte egy generáció.

Mi a megoldás?

Nvidia eltolja a kártyáinak a nevezékét ,Amd egyből kiadhatja a csúcs RDNA3 at 2 darab 7900 SKu-t néven és kérhet érte 1000 dollárt az alatta lévő RDNA2 meg eladható olcsóbban.

Nvidia több pénzt kereshet ugyan azokon a kártyákon, mert más besorolásba esnek. Így lesz egy 300 dolláros 4060 ból 600 dolláros 4070...

Tehát ahhoz hogy ebben a nevezékben biztosak legyenek tudniuk kellett hogy Nvidia valóban meglépi az SKU eltolást más különben nem merték volna 7900XTX nek hívni a saját megoldásukat.

A Két cég ezt együtt oldotta meg ez 100%, máshogy nem működhetett volna. Tehát igen, Nvida ezt szándékosan tette( lehetet volna ezt máshogy ) hogy segítse magát és kihasználta az RDNA3 gyengeségét és a saját javára fordította ezzel egyidejüleg a konkurenciát is egy kedvezőbb helyzetbe léptette elő.

) hogy segítse magát és kihasználta az RDNA3 gyengeségét és a saját javára fordította ezzel egyidejüleg a konkurenciát is egy kedvezőbb helyzetbe léptette elő.AI , HPC:

AMD veszélyes az Nvidiára.

Nvidia meg ugyan úgy fejleszt. értem én hogy jól néz ki ez a táblázat de gondolod NVidia meg áll és sápítozik közben ?

Már most lereagálták a több ramot PCIE szintjén is.

AMD célja az Hogy függetlenek legyenek tőlük, ne kelljen Nvidia gyorsítót választaniuk a megrendelőiknek a remek CPU felhozataluk mellé.

Nem tudnak pusztán a gyorsítóikkal konkurenciát nyújtani az Nvidiának, nekik egyben kell ezt nézni a teljes ökoszisztémát ás úgy már más a helyzet.

Szerintem aki kizárólagosan gyorsítót keres az nem választ AMD-t, Nvidiát vesz.

Aki AMD ökoszisztmát keres a világ legjjobb CPU-val, az már igen...

Ezért nyernek most egy csomó szuper tendert el amúgy a pirosak, a Zöldek meg a z AI gyorsító tendereket nyerik el...

A zöldeknek 90 % részesedésük van az AI piacon ,és szoftveresen a piac fölött vannak. Tehát egy partnernek jelenleg mérlegelnie kell hogy mit választ a gyengébb gyorsítóval és bizonytalanabb szoftveres háttérrel és a Xilinx eőnyeivel, vagy egy Jobb gyorsítóval és jobb szoftveres háttérrel Mellanox előnyökkel de gyengébb CPU val.

A zöldek azt bukják jelenleg el amire nincs kapacitásuk gyártás miatt vagy az ahol AMD a saját CPU-i mellé a saját gyorsítóit tervezi, de ezzel Nvidia nem tud mit csinálni. Jelenleg professzionális fronton sokkal nagyobb a verseny két cég között és ez meg is látszik és az is ,hogy ez hiányzik a gamer szegmensben .AMI nem mindegy , hogy HPC és AI szinten jelenleg sok projektben kénytelen együtt működni a 3 cég, mert a megrendelő dönt... -

Busterftw

nagyúr

válasz

S_x96x_S

#61944

üzenetére

S_x96x_S

#61944

üzenetére

Valamilyen szempontbol igen, eleg csak arra gondolni, hogy az Nvidia biztosan nem a leheto legjobb fejleszteseket hozza el, hiszen gondolni kell a kovetkezo generaciora.

De ugyanez igaz a legtobb cegre, nagyon kevesszer van az, hogy hatalmasat lepunk elore.Ezzel az Nvidia lenyegeben marad az elso helyen, piaci dominanciaval, de hagyva terver a konkurencianak.

-

Petykemano

veterán

válasz

Busterftw

#61943

üzenetére

Busterftw

#61943

üzenetére

> Semmi konkretumt nem tudni a teljesitmenyrol.

Nemrég volt egy kis buzz a MosaicML által, hogy az általuk kínált szoftverrel hardvergyártófüggetlenséget értek el. A100-zal összehasonlítva 73-80%-os teljestíményszintet értek el. [link]

Ugyanebben a cikkben azt is megemlítik egyébként, hogy a H100 még csak kezd megérkezni az adatközpontokba. Ezzel együtt a lemaradás tény. De sokkal fontosabb szempont, hogy a Mi300 olyan szoftveres környezetbe érkezzen meg - akármilyen teljesítményt is nyújt - ami fogadásra kész, semmint hogy akár nagyobb teljesítménnyel, akár előbb, de úgy legyen elérhető, hogy igazából szoftveres okokból a kutyát sem érdekli. Hosszú még ez az út az AMD-nek.

-

PuMbA

titán

válasz

S_x96x_S

#61945

üzenetére

S_x96x_S

#61945

üzenetére

"as Nvidia will not have a competing product. "

Pff. Akik írják ezeket a cikkeket azok képben vannak egyáltalán a valósággal

Az RTX4090-nel az NVIDIA 1 generáció, azaz 20-30%-os előnyben van fogyasztásban és teljesítményben is. RT-ben meg valamivel nagyobbra. Akármivel kijöhet az AMD, legjobb esetben is maximum 4090 szint lesz.

Az RTX4090-nel az NVIDIA 1 generáció, azaz 20-30%-os előnyben van fogyasztásban és teljesítményben is. RT-ben meg valamivel nagyobbra. Akármivel kijöhet az AMD, legjobb esetben is maximum 4090 szint lesz. -

S_x96x_S

addikt

válasz

Valdez

#61927

üzenetére

Valdez

#61927

üzenetére

> Rdna 4-ről van valami infó, hogy mikorra várható?

1 évvel ezelőtt még 2024 volt a terv, és van erre még esély ...

(2022) AMD RDNA 4 Gaming GPUs Arrive By 2024

"The new Navi 4x lineup is expected to launch in 2024 and will be based on an advanced process node. For its CPU lineup, AMD has announced both 4nm and 3nm so it could be any one of those nodes but I would place my bets on the 4nm node due to its maturity and the fact that it also matches the naming scheme which will make for some good marketing. AMD didn't share any numbers but we at least know that RDNA 4 is a real thing and comes after RDNA 3."

( wccftech - 2022-jun-09 )

( wccftech - 2022-jun-09 )és a mostani spekulációkban még most is 2024 -et emlitenek az AMD-re, legalábbis van valami valószínűsége, hogy hamarabb kijön mint az RTX 50.

"If AMD are able to release next-generation RDNA 4 graphics products in 2024, AMD have the potential to grab a lot of high-end market share from Nvidia, as Nvidia will not have a competing product. This assumes that AMD will be able to deliver significant performance gains with their next-generation graphics cards, allowing AMD to overtake Nvidia's RTX 40 series in key workloads."

( overlock3d - 2023-jun ) -

Busterftw

nagyúr

válasz

S_x96x_S

#61936

üzenetére

S_x96x_S

#61936

üzenetére

Eddig is volt ebben a szegmensben AMD-nek ilyen megoldasa, csak nem volt versenykepes. (MI100/MI200)

Semmi konkretumt nem tudni a teljesitmenyrol.

"Su cherry-picked the performance results, but did not speak about the important benchmark – the overall floating point or integer performance results. AMD representatives did not provide performance benchmarks"Arrol nem is beszelve, hogy Q4-ben kerul majd csak gyartasra, ki tudja mekkora mennyisegben, ekozben a H100 mar lassan 1 eve piacon van.

"AMD is on track to sample MI300X in the next quarter. The GPU’s production will ramp up in the fourth quarter."

Szoval ezt a konkurenciat az Nvidia siman megengedheti, ahogy b. irja. -

S_x96x_S

addikt

> úgy érzem Nv vigyáz az AMD re,mint(számára) megfelelő verseny partnerre.

> ...

> csak a H100 már kint van jó ideje,ősszel jön az új, a Grace és így tovább.nem pontosan értelek ..

- vagyis akkor szerinted az nVidia direkt így tervezte?

- és minden rendben?

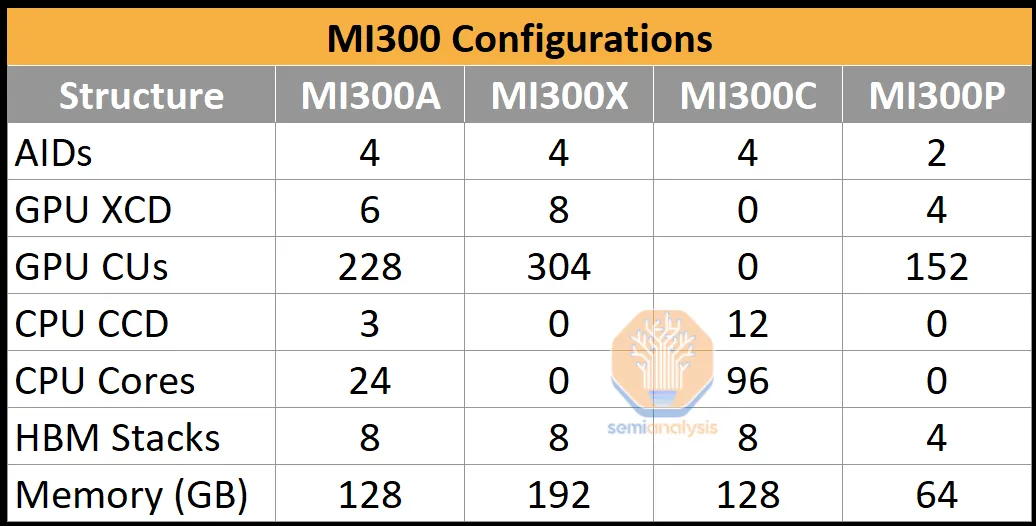

- és az Nvidia szerint az AMD nem veszélyes ????Amúgy ha az AMD az MI300P -t kinyomja az új Threadripperekbe is, ( jövőre? )

akkor az elég erős versenytárs lesz alulról a Grace-nek .. -

-

S_x96x_S

addikt

> úgy érzem Nv vigyáz az AMD re,mint(számára) megfelelő verseny partnerre.

Mi értelme lenne,

hogy az nVidia a saját aranytojást tojó tyúkjának konkurenciát csináljon?

AMD Has a GPU to Rival Nvidia’s H100 ( MI300X )A HPC/AI a fő stratégiai irány ( az aranytojást tojó tyúk )

és a consumer gaming (RDNA) csak a mellékszáll

( persze a gaming fontos .. de nem annyira, hogy a HPC/AI-t roadmap-be bekavarjanak valamilyen apró RDNA3 teljesítmény problémával )A chipletes technológia kritikus az AMD hosszú távú terveihez ..

és a jövőben az XDNA-t is be kell integrálni ..és az MI300-nál már látszik is a terv ...

https://www.semianalysis.com/p/amd-mi300-taming-the-hype-ai-performance

https://www.semianalysis.com/p/amd-mi300-taming-the-hype-ai-performance -

Petykemano

veterán

Szerintem is-is.

Az Infinity Link bizonyára korlátoz és növeli a késleltetést. Egy monolitikus lapka 10-15%-kal is kisebb lehetne (=> Ha az IO nem vagy alig skálázódik már, de az Infinity Link foglal helyet), mint a chipletek méretének összege. Ennek lapkaméretben és illesztésben is nyilván van hozzáadott költsége. miközben, ahogy devast kolléga is kifejtette, komoly előnyt nem húznak le általa. Ez nyilván nem fog javulni.És akkor marad a dual issue, meg az AI accelerator. Ezekhez meg szoftver kell. Kérdés, hogy a dual-issue nem merül-e ki önmagában az RDNA2-höz képest jobb RT-ben.

Én semmi látványosra nem számítanék.

Ebből a szempontból (is) tényleg olyan, mint a Zen2. Architekturálus szempontból a Zen2 sem hozott komoly változást (Kivéve a TAGE predictort, amit a Zen3-ból hoztak le, mert idő előtt elkészült), csak annyit, hogy szétbontották chipletre, meg persze a compute rész már N7-en készült. -

PuMbA

titán

válasz

Petykemano

#61932

üzenetére

Petykemano

#61932

üzenetére

Kérdés, hogy az RDNA3 mennyire rázható gatyába szoftveresen és mennyiben a hardver, azaz a chiplet a gondok okozója. Ha igen, akkor ugyanúgy AMD fine wine kártya lesz belőle 2-3 év múlva, mint most az RDNA2-ből.

Néztem 2021-es teszteket az általam vett kártyáról: [link], ahol VSync 60Hz esetén majdnem kétszeres a 6700XT fogyasztása a 3060Ti-hez képest. Na most én kipróbáltam most a Valorant-ot 144fps-re limitálva és ugyanezen kártya fogyasztása csak körülbelül 10-15W-tal több az előző, sima 3060-omhoz képest. Szóval szoftveresen helyre rázták. Másik kérdés, hogy miért nem lehet kiadni készen egy kártya szoftverét a megjelenéskor. Gondolom nincs annyi erőforrásuk, mint az NVIDIA-nak.

-

Petykemano

veterán

"Nekem teljesen olyan érzésem van, mint a Zen 2 CPU-k esetén, ahol bejött a képbe a chiplet. "

Részben egyetértek. A meghatározó különbség azonban az, hogy a zen2 esetén a chiplettel együtt le is hívták annak skálázhatóságra vonatkozó előnyét: a 16 magos asztali CPU és különösen a 64 magos szerver CPU formájában ezzel legalább bizonyos aspektusból (magszám) előnyre szert téve.

Egész más lett volna a Zen2 esetén a chiplet, ha csupán annyiból áll, hogy külön lapka az IO és a compute, de ugyanúgy limitált 8 magra. Az RDNA3 jelen formájában sajnos leginkább ilyesminek látszik.

Persze reméljük, hogy következő körben meg fog jelenni valami, ami a beépített újításoknak értelmet is ad.

Pl: 2 GCD összekapcsolása az Infinity Linken keresztül úgy, hogy a széleken elhelyezett MCD-k 3D stackelt infinity cache kiegészítést kapnak, hogy kompenzálja a kieső sávszélességet. (elképzelhető, hogy a két GCD-t nem közvetlenül, hanem valami nagy cache-t tartalmazó hídon keresztül érdemes összecsatolni)

Ehhez szerintem nem kellene plusz egy generációt várni. De hogy ez működne out of the box egy GPU-nak látszódva azt nyilván nem tudom megmondani. Nem biztos, hogy a chiplet alapú skálázódásnak mindkét irányát érdemes hajszolni.

a) önmagában is működőképes GPU lapkák összekapcsolása

b) központi egység + számolóegységek külön gyártva)Az RDNA4-től és már a b) megközelítést várom.

-

Alogonomus

őstag

válasz

Valdez

#61927

üzenetére

Valdez

#61927

üzenetére

Az RDNA 4 megjelenése még valószínűleg minimum bő egy évre van. A kriptoboom alatt, de már lecsengést mutató szakaszában tavaly ilyenkor is már 2024-es dátumot tartalmaztak a piros/zöld oldal hivatalos menetrendjei, és az azóta nagyon befékeződött gaming kártyapiac csak tovább halaszthatja a megjelenési dátumot.

Az eredeti 2024-es időpont is szinte biztosan a korábbról megszokott ősz és karácsony közé eső időszakot jelenthette, amitől 2025 eleje - akár első fele - már nincs annyira messze, és a CPU meg AI most sokkal hevesebb "harcszíntér", mint a gaming GPU szektor. -

devast

addikt

válasz

Petykemano

#61922

üzenetére

Petykemano

#61922

üzenetére

A chipletezésnek akkor lenne értelme, ha

- rossz lenne a gyártástechnológia kihozatala

és/vagy

- orbitális méretű chipeket gyártanának

és/vagy

- jelentős eltérés lenne a a különböző chiplet komponensek gyártási költségébenJelenleg ezekből egyik semi áll fent, így előnye jelenleg gyakorlatilag 0, viszont ahogy a teljesítményen látni, hátránya az van bőven.

-

PuMbA

titán

válasz

Valdez

#61927

üzenetére

Valdez

#61927

üzenetére

Semmi, de valószínűleg 2025, hiszen az NVIDIA is akkor jön és az NVIDIA mindig előbb adja ki a kártyáit, mint az AMD

Ahogy a Zen 2 esetén, az AMD most is az árakkal fog harcolni. RX7900-ek árai már nagyot szakadtak a megjelenés óta. Ha az RDNA 4 jó lesz, akkor meg ugyanúgy árat fognak emelni / igazítani a konkurenciához, ahogy a Zen 3-nál. Szerintem vagy kivár az ember vagy vesz egy előző generációs GPU-t. Felső kategóriára ez nem igaz, mert azoknak a termékeknek nincs előző generációs megfelelőjük, ott mást kell mérlegelni.

Ahogy a Zen 2 esetén, az AMD most is az árakkal fog harcolni. RX7900-ek árai már nagyot szakadtak a megjelenés óta. Ha az RDNA 4 jó lesz, akkor meg ugyanúgy árat fognak emelni / igazítani a konkurenciához, ahogy a Zen 3-nál. Szerintem vagy kivár az ember vagy vesz egy előző generációs GPU-t. Felső kategóriára ez nem igaz, mert azoknak a termékeknek nincs előző generációs megfelelőjük, ott mást kell mérlegelni. -

PuMbA

titán

válasz

Petykemano

#61922

üzenetére

Petykemano

#61922

üzenetére

Nekem teljesen olyan érzésem van, mint a Zen 2 CPU-k esetén, ahol bejött a képbe a chiplet. Itt is ez volt az elsődleges megoldandó dolog, hogy chiplet, ami viszont azt eredményezte, hogy minden más a háttérbe szorult. Ütni a Zen 3 ütött igazán, ahol már rendbe szedték a kimaradt dolgokat és tudtak is az Intellel harcolni, mert a Zen 2 teljesítményben kikapott az Inteltől.

RDNA 3 is egy ilyen köztes, próbálgatós architektúra, ez egyértelmű a fogyasztási mizériából. RDNA 4 lesz valószínűleg ütős.

-

válasz

Petykemano

#61922

üzenetére

Petykemano

#61922

üzenetére

Főleg azért,amit írtam már többször.

Mi lett volna,ha NV nem tolja el az SKU kat?Mit tett volna AMD ha a 4080 4070(Ti)ként jött volna ki a 4070 Ti meg 4060 Ti lenne? Ha 600 dollár körül kellett volna kijönnie a 7900 XTX nek és 500 körül az XT nek akkor az RDNA2 6800 tól felfele eladhatatlan lett volna.

Kíváncsi leszek,lesz e ősszel változás mindegyik oldalon,ha elfogytak a régi készletek.sokszor úgy érzem Nv vigyáz az AMD re,mint(számára) megfelelő verseny partnerre.

-

Devid_81

félisten

válasz

Alogonomus

#61920

üzenetére

Alogonomus

#61920

üzenetére

Az viszont nagyon jo eredmeny mobilhoz kepest, csak az a kozel 200Wattos fogyasztas eleg meredek hozza laposban.

-

Petykemano

veterán

Az RDNA3-tól többet vártam. De ezzel szerintem mindenki így van.

Az chipletezés remek lett volna, ha továbbra is nagyon elszállt árakkal és nagyon korlátozott mennyiségben mennének a waferek. De a visszaesés miatt az az előny, hogy nem kell mindennek a legfejlettebb gyártástechnológián készülnie, nem tud érvémyesülni. Cserébe elég sok lapkaméret elmegy a kapcsolódásra.

Azért reméljük, hogy ez csupán az első fecske és idővel kihasználják, hogy chipletek összeillesztésével nagyobb lapkát tudnak összerakni, mintha az monolitikus lenne.

A navi21 520mm2 volt. A navi32-ből származó termékek esetén ~308 (200+108), ~344 (200+144) kerül felhasználásra. A kisebb lapka önmagában, de a chipletezés miatti jobb kihozatali arány, a válogathatóság elvileg jobb gyártósori kihasználtsággal is hozzájárul az olcsóbb előállítási költségekhez.

A navi33 mintájára navi21-ből N6-on gyártva ~450mm2 méretből lehetne kihozni.

Ez a ~300-350mm2-es lapkaméret - ami elég közel van a navi22-höz - elég kicsi ahhoz, hogy ne legyen probléma akár $300-450 szinten árulni.

Csak hát összességében az RDNA3 teljesítménybeli és/vagy hatékonyságbeli előrelépése nem túl látványos.

-

Alogonomus

őstag

válasz

Petykemano

#61917

üzenetére

Petykemano

#61917

üzenetére

Az eredmények passzolnak a hírekhez, de így tényleg nagyon kellene az a 70 CU-s 16 GB-os Navi 31 akár 7900, akár 7800 XT néven, mert a sima 7800 19.000 pontja és a 7900 XT 26.000 pontja között hatalmas a távolság, és így a 4070 Ti teljesítményszintjén hamarosan már nem lenne ajánlata a piros oldalnak, hiszen a 6950 XT az ára emelkedéséből következtetve kezd elfogyni a boltokból.

-

Alogonomus

őstag

Talán a 7800 teljesítményarányos fogyasztása sem is lesz rosszabb a 4070-hez képest. A leaker megosztotta a 7800M XT eredményét is, és a 17842 pont szinte egyezik a 4070 átlagosan 17854 pontjával, ahogy a 7800M XT 189 wattja is körülbelül a 4070 fogyasztását hozza.

Persze az kérdéses, hogy a 7800M XT milyen MCD-t használ, de a 7600M XT az a teljes értékű 7600 asztali chipet használja, csak lejjebb tekerve. -

válasz

Petykemano

#61917

üzenetére

Petykemano

#61917

üzenetére

Akkor a 7800 kb 4070 lesz, kicsit több fogyasztással valószínűleg, cserébe több Vrammal,

langyos víz.

De a 7700 az már érdekesebbnek néz ki, mert szerintem gyorsabb lesz mint a 4060 Ti és ideális lesz 12 GB Vrammal.

Kérdés az árazása, és a fogyasztása, de jó lehet, ha nem cseszik el. -

Devid_81

félisten

válasz

Petykemano

#61917

üzenetére

Petykemano

#61917

üzenetére

Ez kb 6800XT szint lenne?

Nem vittek tulzasba

-

Alogonomus

őstag

Igen, fogyasztásban és RT képességekben biztosan erősebbek lesznek a már chipletes kialakítású nagyobb Navi 3x kártyák, valamint persze az AV1 is hasznos képesség lehet a jövőben.

Az állítólagos szeptemberi megjelenésből kiindulva augusztusban már valószínűleg szivárogni kezdenek majd a különböző eredmények, de a mostani videó alapján - hogy a 7800 is csak valahol 6800 XT és 6900 XT között lehet majd -, egyre valószínűbb, hogy 7900 XT lesz az új gépemben, mert egy erős 6800 XT teljesítmény 1440p esetén szerintem kevés lesz a következő 1-2 generációhoz, és legalább 2 generációig nem szeretném lecserélni a kártyát.

Esetleg a videóban is felvetett 70 "egységes" 7900 non-XT lehet még opció, ha $600 környékén érkezne legalább 6950 XT teljesítménnyel, csak annál erősebb RT potenciállal. -

PuMbA

titán

válasz

Alogonomus

#61914

üzenetére

Alogonomus

#61914

üzenetére

Teljesen igazad van. Kiemelve akartam írni a "jelenlegi generációs VGA-k között"-et

Egyébként az RT teljesítmény kérdéses ezen kártyák esetén, mert jobbat guríthat, mint a regiszter vágott Navi 33. Na meg, ha a fogyasztás / teljesítmény is jobb lesz a Navi 33-hoz képest.

Egyébként az RT teljesítmény kérdéses ezen kártyák esetén, mert jobbat guríthat, mint a regiszter vágott Navi 33. Na meg, ha a fogyasztás / teljesítmény is jobb lesz a Navi 33-hoz képest.Az előző generációs kártyák általános ár / teljesítménye természetesen nem lesz veszélyben. Én is ezért vettem meg az RX6700XT-t, mert 100k-ért kapható és a jelenlegi VGA generáció a gyártási költségek miatt nem előrelépés, hanem csak oldalazás mindkét gyártó részéről. Most jött ki épp egy jó Hardware Unboxed videó erről, hogy az esetek többségében a legjobb, amit tehetünk, hogy nem veszünk új generációs kártyát.

-

Alogonomus

őstag

Feltéve, hogy a 7700 ereje valóban a 6800 környékén lesz, míg a 7800 ereje a 6800 XT környékén lesz, akkor 200 ezerért a 7700 nem lenne nagy szám, mert memóriában még visszalépést is jelentene, míg árban a 6800 most is kapható némileg 200 ezer fölött. A videóban becsült $450 viszont az adókkal tényleg majdnem 200 ezer környékére jönne ki.

A 6800 XT is kapható azon a 230 ezret némileg meghaladó áron, amit a 7800 esetén jósolt $550 jelentene a hazai adókkal megnövelve.

Persze most olcsóak az előző generációs kártyák, de $450 és $550 esetén ugyanúgy csak egy "meh" lesz a 7700 és 7800 tesztjeinek az ítélete, ahogy az a 7600 esetén is történt. -

PuMbA

titán

AMD Navi 32-based Radeon RX 7800/7700 series reportedly targeting September launch

200 ezerért a 7700 nem lenne rossz vétel a jelenlegi generációs VGA-k között.

-

S_x96x_S

addikt

AMD Working To Allow Linux To Handle Up To 128 DRM Devices Per System

https://www.phoronix.com/news/Linux-128-DRM-Devices

"AMD Linux engineers are working on extending the Direct Rendering Manager (DRM) subsystem used by their GPUs/accelerators to allow up to 128 DRM devices per system." -

S_x96x_S

addikt

Az AMD-nek az AI/ML eszközök összeintegrálása (CPU, GPU, FPGA, ..)

azért nem olyan egyszerű, de azért vannak biztató jelek, hogy dolgoznak rajta ..

( habár lehetne nagyobb látszatja is .. )

New ROCm™ 5.6 Release Brings Enhancements and Optimizations for AI and HPC Workloads

https://community.amd.com/t5/rocm/new-rocm-5-6-release-brings-enhancements-and-optimizations-for/ba-p/614745

Unified Inference Frontend (UIF) 1.1 User Guide ( 2023-03 )

https://github.com/amd/UIF"UIF accelerates deep learning inference applications on all AMD compute platforms for popular machine learning frameworks, including TensorFlow, PyTorch, and ONNXRT. It consists of tools, libraries, models, and example designs optimized for AMD platforms that enable deep learning applications and framework developers to improve inference performance across various workloads such as computer vision, natural language processing, and recommender systems."

"UIF 1.1 extends the support to AMD Instinct GPUs in addition to EPYC CPUs starting from UIF 1.0.

IF 1.1 also introduces tools for optimizing inference models. GPU support includes the ability to use AMD GPUs for optimizing inference as well the ability to deploy inference using the AMD ROCm™ platform. Additionally, UIF 1.1 has expanded the set of models available for AMD CPUs and introduces new models for AMD GPUs as well.

" -

S_x96x_S

addikt

(... és mert open-source ... )

"Ray Tracing now possible on Polaris, Vega and RDNA1 on Linux"

https://www.reddit.com/r/Amd/comments/14yhy2a/ray_tracing_now_possible_on_polaris_vega_and/"""

...

Emulating Ray Tracing is now possible on GCN4, GCN5 and RDNA1 with Mesa 23.2-git (and 23.2 final when it's released).

....

Here's my results:

5700 XT, R5 3600, 32 GB, Fedora 38, Kernel 6.3, Mesa 23.2-dev, Proton-GE 8.6 or Wine-GE 8.6

- Quake 2 RTX: maxed settings, 1080p, Path Tracing, 50% rez scale (540p): 60 fps locked

- Hellblade: 1080p, max settings, FSR2 Ultra Performance (360p), RT High: 30 fps locked

- Miles Morales: 1080p, raster options maxed, RT reflections enabled (minim RT enabled), FSR2 Balanced: mostly 60 fps locked

- ....TLDR;

Depending on resolution, FSR2 preset, sharpening added, available VRAM and a tolerance for 30-40 fps, emulated RT is quite playable on 5700 XT. Probably just as usable, if not faster, on Radeon 7.

Depending on game, resolution and RT option, it might be usable on Polaris (RX 590), Vega 56/64, RX 5500 XT 8 GB / 5600XT /5700 non XT

"""és a PR ( mesa ) : RFC: radv: Enable emulated RT by default

-

S_x96x_S

addikt

Lehet, hogy a "Starfield" - lesz az első "FSR 3" támogatott játék?

( mert ha nem, akkor az nem igazán jó hír az FSR 3 -ban reménykedőknek, mert azt jelenti, hogy még nem production ready ... és kell még neki legalább fél-év ..)

Amúgy én 85% - ot tennék az FSR 3 támogatásra.

(2023-05-24 )

"""

Regarding the performance enhancements that FSR 3 is set to bring, they alluded to its capabilities when AMD initially introduced this new iteration last November. In a demonstration utilising Unreal Engine 5, a Radeon RX 7000 achieved 60 FPS with FSR 2, while the frame rate exceeded 110 FPS with FSR 3.

The upcoming generation of FidelityFX Super Resolution is set to incorporate a feature named Fluid Motion Frames. Although specific operational details remain thin, it can be inferred that this function will be akin to NVIDIA DLSS 3's "Optical Flow Accelerators" and "Motion Vectors," which are crucial for creating the so-called "nonexistent frame" in games where NVIDIA's feature is enabled. In addition, AMD has announced the impending HYPR-RX technology, purporting to offer enhanced frame rates and reduced latency, drawing parallels with NVIDIA Reflex with DLSS 3. This feature is yet to be launched. It's also worth mentioning that game development studios, Epic Games and Ubisoft, have expressed intentions to incorporate AMD's FSR 3 in their graphic engines, Unreal Engine 5 and Snow Drop 2.0, respectively.

""" ( via Guru3D - 2023-05-24 ) -

PROHARDVER!

Fejezzétek be az offolást!

-

PuMbA

titán

Hát nem értem a működését. Mintha véletlenszerű lenne. Most visszaraktam az NVIDIA kártyám a gépbe, erre már arra is rakta fel. Amikor az előző AMD-t cseréltem NVIDIA-ra, akkor ott meg nem csinált semmit, míg fel nem raktam a VGA drivert, maradt a Window Basic Graphics Adapter vagy valami hasonló neve az Eszközkezelőben. Na mindegy, ez a Windows hülyeség letudva megint egy jó időre.

-

"Én úgy tudom, hogy ez csak AMD-n probléma"

Hááát az könnyen lehet, otthon is AMD van (5600G), meg ismerős notijában is. Majd megkeresem ezt a beállítást, de default ennek nem így kéne működnie. Csak azért nézem el, mert piros az a szemüveg.

Amúgy nem is érdekelt volna most ismerős gépénél, ha valami 2023-as whql-t rakott volna fel, de valahogy mindig egy 2020-asat sikerült telepítenie magától. Proci 2021. januárban jelent meg. (tudom tudom, Lucienne a 5500U , szóval szegről végről 2020-as proci, ne reklamáljak )

)

Új hozzászólás Aktív témák

Hirdetés

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

MIELŐTT LINKELNÉL VAGY KÉRDEZNÉL, MINDIG OLVASS KICSIT VISSZA!!

A topik témája:

Az AMD éppen érkező, vagy jövőbeni új grafikus processzorainak kivesézése, lehetőleg minél inkább szakmai keretek között maradva. Architektúra, esélylatolgatás, érdekességek, spekulációk, stb.

- BESZÁMÍTÁS! ASRock B550M R5 5600 16GB DDR4 512GB SSD RX 6600 XT 8GB Kolink Observatory LM RGB 600W

- DELL Universal Dock D6000 docking station (452-BCYH) (DisplayLink)

- AKCIÓ! Gigabyte H510M i5 10400F 16GB DDR4 512GB SSD GTX 1080Ti 11GB Rampage SHIVA Zalman 600W

- AKCIÓ! Gigabyte B85-HD3 B85 chipset alaplap garanciával hibátlan működéssel

- DDR5 16GB 8GB 32GB 4800MHz 5600MHz RAM Több db

Állásajánlatok

Cég: PC Trade Systems Kft.

Város: Szeged

Cég: CAMERA-PRO Hungary Kft

Város: Budapest

Nem vicc, tényleg nem tudom.

Nem vicc, tényleg nem tudom.

Ahelyett hogy a fogyasztást javítanák a kártyáiknál vagy a VR támogatást ami miatt mindenki panaszkodik...

Ahelyett hogy a fogyasztást javítanák a kártyáiknál vagy a VR támogatást ami miatt mindenki panaszkodik...

az "AMD"-re?

az "AMD"-re?