- Az NVIDIA szerint a partnereik prémium AI PC-ket kínálnak

- Két Zen 5-ös dizájnjának mintáit is szállítja már az AMD

- A Colorful "fagyosan kompakt" alkatrészekkel megy elébe a nyárnak

- A Keychron ismét egy űr betöltését vállalta magára az egerek szegmensében

- Az átlagnál vaskosabb ventilátorok kandikáltak ki a Corsair vitorlája mögül

- Milyen TV-t vegyek?

- Az NVIDIA szerint a partnereik prémium AI PC-ket kínálnak

- Milyen billentyűzetet vegyek?

- 3D nyomtatás

- Kihívás a középkategóriában: teszten a Radeon RX 7600 XT

- NVIDIA GeForce RTX 4080 /4080S / 4090 (AD103 / 102)

- Fujifilm X

- OLED TV topic

- NVIDIA GeForce RTX 3080 / 3090 / Ti (GA102)

- Bambu Lab X1/X1C, P1P-P1S és A1 mini tulajok

Hirdetés

-

A Colorful "fagyosan kompakt" alkatrészekkel megy elébe a nyárnak

ph A vállalat többek között egy slim profilos léghűtővel, egy helytakarékos táppal és egy ITX-es házzal adott magáról életjelet.

-

Spyra: akkus, nagynyomású, automata vízipuska

lo Type-C port, egy töltéssel 2200 lövés, több, mint 2 kg-os súly, automata víz felszívás... Start the epic! :)

-

Premier előzetest kapott a V Rising

gp Napokon belül befut a teljes PC-s kiadás, az év során pedig megkapjuk a PlayStation 5 változatot.

-

PROHARDVER!

A legtöbb kérdésre (igen, talán arra is amit éppen feltenni készülsz) már jó eséllyel megtalálható a válasz valahol a topikban. Mielőtt írnál, lapozz vagy tekerj kicsit visszább, és/vagy használd bátran a keresőt a kérdésed kulcsszavaival!

Új hozzászólás Aktív témák

-

paprobert

senior tag

válasz

Petykemano

#37644

üzenetére

Petykemano

#37644

üzenetére

Nagyon jó meglátások.

Az N5 feltételezhetően jó kihozatalára azonban volt példa korábban, a 7nm is rekordot döntött kihozatalt tekintve.

Nem igazán volt a termékek árára hatással, mindössze szűkebb termékbeli szórást, kevesebb selejtet, ezáltal nagyobb termékkontrollt és profitot hozott az AMD-nek.A vásárlók nem igazán látják ennek a pozitívumát, sőt van egy inverz hatása is a jó kihozatalnak.

Tegyük fel, a gyártósorról kevés alacsony frekvenciát bíró CPU jön le, mert kicsi a szórás. Így jóval kisebb eséllyel alakul ki felhalmozás, túlkínálat az alacsonyabb minőségű szilíciumból, nehezen válik dömpingárassá egy alsó-középkategóriás termék. CPU-k esetében az R5 2600 és társai voltak utoljára nagy mennyiségben elérhetőek, a GF-nál gyártva.

7nm-en végletekig kitapasztalva, a Zen3-ból, csak most, másfél évvel később kaptunk valódi mennyiséget a hulladék chipekből.Ha megnő a cég kontrollja a portfólió felett, akkor pont csak annyi lesz kínálva belépőből, hogy ne sok vizet zavarjon a termékskála jobban fizető részén.

Ha viszont rossz a kihozatal, akkor tüzet kell oltania dömping árral, hogy mentse a menthetőt.#37645 b.

Hát igen, a megéri-e kérdést elég sokan feltettük magunknak, vagy az asszonynak, vagy csak a pénztárcánknak. Egyelőre az álláspont az, hogy a grafika nem is annyira fontos.

Ilyen elmebeteg TDP-s VGA-kal pedig egyelőre nem édesgetnek közelebb magukhoz a cégek, még az árak helyreállása után sem.[ Szerkesztve ]

640 KB mindenre elég. - Steve Jobs

-

-

GeryFlash

veterán

válasz

T.Peter

#37650

üzenetére

T.Peter

#37650

üzenetére

Az eredeti UE5 demonsk a latvanyat. Ez a multkori The Coalitionös techdemo ez viccnek is rossz. Ilyet egy UE4-gyel hoztak korábban. De tényleg rakjuk már oda a most érkező játékokat a 2015-s Order 1886 mellé. 7 év és 6szoros erőforrás növelés erre volt elég.

Hi, i'm new to APHEX TWIN, so i was wondering how much the IQ requirements was to enjoy his stuff. and understand all the underlying themes, because its really complex stuff. I have IQ of 119 but i heard that you need atleast 120 is it true?

-

T.Peter

őstag

válasz

GeryFlash

#37654

üzenetére

GeryFlash

#37654

üzenetére

Nem hiszem, hogy elvarhato az, hogy egy masik csapat megugorja az epic szintjet. Plusz teljesen mas cellal keszulo tesztekrol van szo. UE 4-gyel a kozeleben sem voltak ennek a szintnek.

Objektiven nezve az order szintjet mar megugrottuk az elozo generacioban is.

Egyebkent jo lenne inkabb azonos studio hasonlo jatekait osszehasonlitani. Pl a Supermassive games jatekait, amikor mar lesz UE 5 alapu jateka is. -

válasz

T.Peter

#37653

üzenetére

T.Peter

#37653

üzenetére

Nincs ezzel baj. nem rossz az UE5 kinézetre és jönnek vele jó játékok. DE egyéni véleményem az róla a kinézete alapján, hogy ÉN speciel nem látom benne azt a nagy méretű előrelépést amivel 5-8 évig ki tudja szolgálni a nextgen pc. játékokatés ezzel hardvereladást generáljon, ahonnan tekintettem rá elsősorban. Még a techdemókban sem.

Például az összes érkező UE5 játékban, pl Hellblade, Black Myth , Redfall, az a jellegzetes plasztikusság ,a csillogó fényes textúrák. életre kelt műanyagbábu effektusa mozgásban is. AZ mellett persze szép a grafika meg van egy két úgy mond látványos effekt de nincs a részemről semmi extra hogy ez mennyire valósághű vagy extra nagy előrelépés pl a Hellblade 1 hez vagy az öreg God of War ps4 pro verzióhoz.

Amúgy például az ( GOW)nem volt plasztikus és annál éreztem jó párszor azt a wow effektet. amiért mondjuk 2018 ban vettem volna új generációs kártyát

A hangzásról ne is beszéljünk, mert azt mondom hogy az utóbbi pár évben 2-3 játék volt méltó arra, hogy a belépőnek azért nem nevezhető házimozi rendszeremre rá merjem kötni. Az a GOW és a GOW volt God of War és a Gears of War( Gears 5) volt

God of War és a Gears of War( Gears 5) volt

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

AD102 is NOT a simple "GA112". When GH202 is cancelled, AD102 has integrated Hopper's new technology. Never underrate your Jensen.

[link]Hoppá.

GH202 ből vajon milyen technológiát integráltak?

jah utolsó mondat ment aláírásba .

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

válasz

FragMaster

#37658

üzenetére

FragMaster

#37658

üzenetére

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

[NVidia is making a DESKTOP CPU]

Coreteks, csak csipetnyi sóval

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Durva tranzisztorszám várható az AD102 ben. [link]

" Thank everyone. Truth is often in the hands of a few people, but this time the truth should be in the hands of the majority."

teljesen a Vega jut eszembe ..a két cég egymás " útjára" lépett.

ha ez igaz és a másik infó is, ami 600mm2 méretet akkor az remek kihasználása a TSMC által megadott 5 nm ben kihozható maximális tranzisztorsűrűségnek.

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Lenyűgöző, hogy ha az RTX 3090Ti 450 helyett 300 Watton üzemel, teljesen felborul az erősorrend energiahatékonyság téren. Bizony a felső és csúcskategóriában messze a legenergiahatékonyabb kártya a 300 Wattos 3090Ti.

Ebből is nagyon jól látszik, hogy az NVIDIA mennyire brutálisan sz*rrá hajtotta ezt a GPU-t néhány százaléknyi plusz tempóért cserébe. Ha viszont észszerű keretek között (sweet-spot) üzemel, akkor nagyon szép eredményeket hoz.

Nekem ebből az látszik, hogy a Samsung 8nm+Ampere kombináció semmivel sincs lemaradva a TSMC 7nm+RDNA2 kombinációtól energiahatékonyság terén.

A 450 Watthoz készített hűtő pedig a sokkal alacsonyabb hőtermelés miatt még teljesen terhelés esetén is csendben marad. Na ilyen lenne az észszerű out of the box termék.Gameplay csatornám: https://www.youtube.com/channel/UCG_2-vD7BIJf56R14CU4iuQ

-

GeryFlash

veterán

válasz

huskydog17

#37664

üzenetére

huskydog17

#37664

üzenetére

De, le van maradva. Ha most az AMD is kihozna ennyi tapasztalatszerzes + node csiszolgatas utan egy 450 wattos szart es leszabalyoznad 300-ra akkor meg az lenne a csucs energiahatekony. Ossze kell vetni a 3070TI perfomance es TDP-jet a 6800-zzal, van lemaradas. De az biztos, hogy ha ugyanolyan nodeon keszulnenek akkor az Nvidia elverne az AMD-t.

Hi, i'm new to APHEX TWIN, so i was wondering how much the IQ requirements was to enjoy his stuff. and understand all the underlying themes, because its really complex stuff. I have IQ of 119 but i heard that you need atleast 120 is it true?

-

válasz

GeryFlash

#37665

üzenetére

GeryFlash

#37665

üzenetére

A 3070 Ti ugyanúgy túl van hajtva, mint az összes többi Ampere kártya. Ahhoz, hogy kiderüljön, melyik architektúra van előnyben, kellene egy méréssorozat mondjuk 25W-os lépésekben. Valószínűleg az AMD kártyák sem a sweet spotjukon üzemelnek, de az NVIDIA-k biztosan alaposan túl vannak tekerve.

Pedro... amigo mio... ma is konzervvért iszunk! Kár lenne ezért a tehetséges gyerekért...

-

Televan74

nagyúr

Lehet itt okosnak lenni, de ha a 3090Ti nem lenne túltolva, nem lenne a leggyorsabb NV kártya és a cég nem kérhetne annyit amennyit kér.

Amikor nincs remény! Jusson eszedbe nincs isten, csak én!

-

válasz

GeryFlash

#37665

üzenetére

GeryFlash

#37665

üzenetére

A 3070 Ti egy utólag kihozott SKU... GA104 GPU párja a Navi 22 az eredeti 3070 hez nézve Átlagosan a 3070 5-11 %- kal gyorsabb felbontás függően és szögre annyit vagy kevesebbet eszik mint a 6700 XT. [link]

A 3070 Kb úgy van túlhúzva és mint ha egy 6700XT versenyezné egy 3080 nal... példának jó a 3070Ti és a 3090Ti de nem általános eset és az egész Ampere generációra igaz....

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

válasz

GeryFlash

#37665

üzenetére

GeryFlash

#37665

üzenetére

"De, le van maradva."

Hol? Én a cikkben leírtakról beszélek."Ha most az AMD is kihozna ennyi tapasztalatszerzes + node csiszolgatas utan egy 450 wattos szart es leszabalyoznad 300-ra akkor meg az lenne a csucs energiahatekony."

Feltételezés. Ilyen nem történt meg és valószínűleg nem is fog már, de ha mégis jönne egy ilyen az RDNA 3 előtt és lesz arról is független teszt, akkor erre térjünk vissza, addig ennek a feltételezésnek semmi értelme."Ossze kell vetni a 3070TI perfomance es TDP-jet a 6800-zzal, van lemaradas."

De miért azokat vessem össze, amikor a linkelt cikk nem arról szól? Amúgy nem csoda, hiszen a 3070Ti agyon van hajtva, de a többletfogyasztás nagy része a GDDR6X-re váltás miatt történt. A 3070Ti-t amúgy én nem sorolnám a csúcskategóriába, főleg mert itt még a GA104-es GPU van jelen, nem pedig a GA102."De az biztos, hogy ha ugyanolyan nodeon keszulnenek akkor az Nvidia elverne az AMD-t."

Megint csak feltételezés, ez sem biztos. Node kérdésben annyit tudunk, hogy az Ampere generáció a Samsung első generációs 8nm-os node-ján készült, míg az RDNA2-es széria a TSMC optimalizált N7P node-ján, ami tekinthető a 3. generációs 7nm-es TSMC node-nak. Többek között ezért is lesz nagyon érdekes az új generáció mindkét oldalon, hiszen a jelenlegi információk szerint az új RTX gen is TSMC node-on fog készülni.E mellett érdemes figyelembe venni azt a szintén nem elhanyagolható tényt, hogy a két csúcs termék (Radeon RX 6900 vs. Geforce RTX 3090Ti) közül a 300 Wattos 3090Ti-on ugye a GDDR6X VRAM miatt jóval kevesebb fogyasztási keretet kap a GA102, mint a Navi21 az RX6900-on és ugye mindkét kártyán a két GPU teljes kiépítésű, egyik sincs vágva (GA102, Navi21).

A teszt arra mutat rá, hogy a két csúcs termék, illetve csúcs-GPU közül az Ampere nyújtja a jobb energiahatékonyságot, hiszen a teljes kiépítésű GA102 úgy gyorsabb és takarékosabb 300W környékén, mint a teljes értékű Navi21, hogy közben a VRAM miatt kisebb a GPU fogyasztási kerete is, aztán ugye a Navi elvileg jóval fejlettebb node-on készül.

Mindezeket figyelembe véve szerintem a legkisebb mértékben sem túlzás azt mondani, hogy az Ampere semmivel nincs lemaradva energiahatékonyság terén a felső és csúcskategóriában (GA102 vs Navi21).

[ Szerkesztve ]

Gameplay csatornám: https://www.youtube.com/channel/UCG_2-vD7BIJf56R14CU4iuQ

-

Komplikato

veterán

Off: Mai Videocardz bejegyzés szerint a teljes Intel Arc desktop széria negyed évvel csúszik. Sokára lesz itt megfizethető gaming kártya.

"Figyelj arra, aki keresi az igazságot és őrizkedj attól, aki hirdeti: megtalálta." - (André Gide)

-

Raymond

félisten

válasz

Komplikato

#37670

üzenetére

Komplikato

#37670

üzenetére

Nem az Arc az ami levinne vagy viszi le az arakat. Honapok ota mennek lefele. Pelda:

MSI GeForce RTX 3060 Ventus 2X 12G OC

Az utolso 6 honap fejlemenye. A december elejei 1000eur csucsrol 4 honap alatt lement az aktualis 449eur szintre es meg mindig mennek lefele az arak.

Vagy a 3070Ti ez ido alatt 1399eur -> 768eur es a tobbi is hasonlo. Igen, ezek meg mindig nem MSRP arak, de messze nem az van ami par honapja vagy hogy ne lenne megfizetheto kartya. A 3050/2060 es 6600 ami az ertelmes teljesitmenyszinten van 350eur korul all most ami nem ugyanaz mint a hosidokben amikor 200-250eur kozott voltak, de nem is az a vilag vege kategoria mint az utobbi honapokban.

Privat velemeny - keretik nem megkovezni...

-

nubreed

veterán

válasz

Raymond

#37671

üzenetére

Raymond

#37671

üzenetére

Csak mindez a magyar webshopokban egyáltalán nem érződik, direkt figyeltem néhányat az elmúlt 2-3 hétben, miközben elvileg tényleg ez a nemzetközi trend, hogy haladunk az MSRP felé, szépen esnek a VGA árak, itthon a legtöbb videokártya (engem csak az nvidia érdekel, így azt néztem) drágább lett most, mint mondjuk 2-3 hete. És olyan szinten drágább, hogy ez nem magyarázható csak az euró erősödésével. Több 10ezer forint drágulásról beszélek akár 2-3 nap alatt is. Tehát a magyar realitás merőben más mint a nemzetközi trendek. Ezt mivel magyarázzuk? Én nem látok bele a hazai nagykerek és webshopok árképzési gyakorlatába, nem tudom mi van a háttérben, maximum csak rosszmájúan feltételezek dolgokat.

We are the first of cyber evolution. We are the first to program your future.

-

Abu85

HÁZIGAZDA

válasz

huskydog17

#37669

üzenetére

huskydog17

#37669

üzenetére

Ugyanúgy tudsz kérni a Radeonra is -50%-os a Power limitet. És nem esik 50%-kal a teljesítmény, hanem inkább 10-15%-kal.

Minél inkább kicentizel egy hardvert, annál rosszabb lesz az energiahatékonysága. Ez így van évek óta minden gyártónál. Amiért nem élnek ezzel az az, hogy a userek többre értékelik a teljesítményt, mint a teljesítmény/wattot. Ettől függetlenül a user dönthet otthon a működésről. Az AMD-nél erre van gyárilag támogatott funkció (Power limit +/-50%), az NV-nél pedig el lehet érni hasonló hatást 3rd party programokon keresztül bizonyos tuningbeállításokkal.

Ha valaki nagyon teljesítmény/watt párti, akkor lehet kérni még Radeon Chillt is. Azzal konkrétan kilő az energiahatékonyság.

Az NV-nél is elérhető a HiAlgo Chill DirectX 9-re. Ezt az AMD még nem vette le.[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

FLATRONW

őstag

válasz

GeryFlash

#37665

üzenetére

GeryFlash

#37665

üzenetére

Az AMD-nek is van egy 375 W-ig eleresztett vizes kártyája, ami nem gyorsabb, mint a sima 3090. Az RDN 2 esetén már felesleges ennél nagyobb fogyasztást engedni, mert már nem hoz teljesítményt.

Ne felejtsük el, hogy az RDN 2 már egy eleve csiszolt 3.generaciós 7nm-re épül, ebből kb. kihozták a maximumot.

Ilyen szempontból nagyon szép, amit az NV kihozott a 8 nm-ből.

Az meg majd kiderül, hogy azonos gyártás mellett mire képesek. Ezek alapján szerintem is az NV lesz a jobb. -

[Nvidia Ada Lovelace Leaked Specifications, Die Sizes, Architecture, Cost, And Performance Analysis]

TSMC 4N

Nvidia ügyesen korrigálja a TSMC drágább gyártását e szerint és jobb ár érték arány várható.[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

GeryFlash

veterán

Wow, nem is 5 hanem 4nm? Gondolom 5nm half nodeja, de nem lesz az nagyon draga? raadasul az egesz paletta azon jon? AMD-nek nagyon alul kell araznia es/vagy a fogyasztast elengednie hogy kompetensek legyenek a midrange kartyak (ott ugye TSMC 6nm).

Hi, i'm new to APHEX TWIN, so i was wondering how much the IQ requirements was to enjoy his stuff. and understand all the underlying themes, because its really complex stuff. I have IQ of 119 but i heard that you need atleast 120 is it true?

-

Abu85

HÁZIGAZDA

válasz

GeryFlash

#37679

üzenetére

GeryFlash

#37679

üzenetére

Az AMD részben épít TSMC 6 nm-re. A nem skálázható elemek vannak azon, illetve a Navi 33-ból a compute elem. A Navi 32 és 31 esetében a compute az 5 nm, amin van a Zen 4 is. A 4 nm-t az AMD csak a HPC lapkához használja, mert nagyon pici a kiépített kapacitás rá.

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

GeryFlash

veterán

Tudom, ezert irtam hogy midrangeknek lesz problemajuk. De akkor ezek szerint a felso kategoriaban is lesz node lemaradas, 4 vs 5nm, bar az kevesbe jelentos. Mindenesetre nem all ossze az tortenet, hogy milyen rohadt draga a waffer, ugy tunik most fordul a kor es az Nvidia lesz nagyvonalu es az AMD szarrago.

Mindenesetre ha valoban N4-en jon az AD107 akkor vagy nagyon draga lesz a 4060TI vagy nem igaz hogy nem lehet midrange VGA-t leading edge nodeon gyartani korrekt arral es haszonnal.Hi, i'm new to APHEX TWIN, so i was wondering how much the IQ requirements was to enjoy his stuff. and understand all the underlying themes, because its really complex stuff. I have IQ of 119 but i heard that you need atleast 120 is it true?

-

Petykemano

veterán

A komplett Nvidia generáció N4-re épül, de az AMD azért nem használja igazán, mert nagyon pici a kiépített kapacitás? Ez hogy lehet?

A RedGamingTech most hintette el, hogy egyes források szerint a Zen5 is N4-en (vagy értelemszerűen valamelyik alvariánsán) készülhet

Találgatunk, aztán majd úgyis kiderül..

-

válasz

GeryFlash

#37679

üzenetére

GeryFlash

#37679

üzenetére

Érdemes azért ezt óvatosan kezelni még. Volt a napokban hír hogy az Nvidia már AI val fejleszt és tesztel GPU kat a mérnökök munkájának megsegítésére. Állítólag ez az AI képes 92 % ban önállóan áttervezni egy kész tervezett vagy gyártott GPU dizájnt egy másik csíkszélre vagy gyártásra baromi gyorsan. Ezzel igazából elég mobilis tud enni Nvidia akár csíkszélek között ha gond lenne, gondlom azért fejlesztették ki. Elég durva dolog ha igaz.

[link]Mondjuk ilyen hírek és IT tartalmú cikkek helyett olyan f@szságok jönnek Nvidia hírnek a PH-n hogy milyen jó a MH / s rátája a 3090 Ti-nekmeg hogy újra bejelentették a z elérhetőséget a 3000 szériának. mert Blikket tolunk és ezeket vesszük át a komoly oldalaktól . és kincs a heti 3-4 nvidia fika hír, ilyenek meg mennek a levesbe.

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

GeryFlash

veterán

Ne is mondd... A 8454. processzorhuto, RGB-s RAM, gamer router es egyeb full erdektelen dolog, lassan heti 2-3 olyan hir van amire kattintok, az erdemi informacio meg az AMD, NVIDIA GPU es AMD/INTEL/NVIDIA 3 forumbol jon kommentekbe

Ertem hogy nem lehet mindenfele spekualciot es hasonlot lehozni, de a technikai cikkek es mindenfele termekbeutatok aranya most mar rohejes aranyban van/

Ertem hogy nem lehet mindenfele spekualciot es hasonlot lehozni, de a technikai cikkek es mindenfele termekbeutatok aranya most mar rohejes aranyban van/[ Szerkesztve ]

Hi, i'm new to APHEX TWIN, so i was wondering how much the IQ requirements was to enjoy his stuff. and understand all the underlying themes, because its really complex stuff. I have IQ of 119 but i heard that you need atleast 120 is it true?

-

Abu85

HÁZIGAZDA

válasz

GeryFlash

#37681

üzenetére

GeryFlash

#37681

üzenetére

Itt a gyártási költség a nagy probléma. Úgy számolj, hogy 5 nm-en kétszer drágább ugyanaz a lapka, mintha kihoznád 6 nm-en. Ez nagyon komoly probléma, és emiatt csinálja az AMD az egyes chipleteket 6 nm-en. Ugyanez az oka annak, hogy a Navi 33-nál a compute chiplet is 6 nm-en jön. Ez lesz egy 200 watt körüli fogyasztású fejlesztés.

A Tom's Hardware táblázata egy vaskalapos bullshit. Eleve a 4 nm az 5 nm-nél is drágább, és kapacitásban kb. az 5 nm-es kapacitás 5%-át, ha kiteszi. Ezen belül a 4 nm-ből a P vagy az X verzió az, amire normális GPU-kat lehet tervezni. A P-n még idén megkezdődik a kísérleti gyártás, és ezt használja Hopper, de ugye itt számításba kell venni, hogy a tömeggyártás csak a következő évben kezdődik meg. Az X esetében még a kísérleti gyártás is 2023-ban kezdődik, és a tömeggyártás leghamarabb a jövő év végén esedékes.

Mindemellett senki se számítson 500 dollár alatti 4 vagy 5 nm-en készülő új kártyákra. Egyszerűen a waferköltség annyira, de annyira magas, hogy nem fér bele. A Navi 33 pont azért marad 6 nm-en, hogy meg tudja támadni az 500 dollár alatti árszintet, ha erre szükség van. Ha 5 nm-en készülne legalább a compute mag, akkor erre a Navi 33 se lenne képes, pedig az a fejlesztés dizájnban egy 128 bites motyó, tehát a rendszer komplexitása valahol a 6600 XT és 6700 XT között van, a teljesítménye pedig 6800 XT és 6900 XT környéki. Egyszerűen még egy ilyen picire tervezett dizájnnál is olyan nagy költség lenne az 5 nm-es waferár, hogy nem fér bele a normális árcédula. Ez meglátszik a fogyasztáson is. A Navi 33 200 watt környéki fogyasztást kínál, mert az a fő célja, hogy a teljesítményt tegye elérhetővé. Az NV-nek a legkisebb 5 nm-es fejlesztése is 300 watt fölött fogyaszt, mert ott az új node ára annyira extrém, hogy muszáj mögé rakni egy komoly teljesítményt, hogy legitimáld vele a 700-800 dolláros árat, amit egy 256 bites dizájnnal reálisan lehet hozni.

Ezt a problémát most nagyon sok pletykagyáros nem érti meg, és még mindig azt hiszik, hogy itt lesznek olcsó új generációs VGA-k.#37682 Petykemano : Nincs elérhető 4 nm-es eljárás, ami nem kísérleti lenne. Ezért is kicsi most a kapacitás. Mint írtam, egy GPU-nál N4P-re van szükség minimum. Ez csak jövőre kerül tömeggyártásba. Az N4X leghamarabb jövő év végén, de inkább 2024-ben. Amíg egy node nem kerül tömeggyártásba, addig csak kis kapacitással érhető el.

Jelenleg a 4 nm, nem teszi ki az 5 nm-es kapacitás 5%-át sem. Ki az a hülye, akik kihoz rá egy nagy mennyiségben készülő fejlesztést? A Hopper az azért 4 nm-es, mert kb. pite mennyiségben készül, annak reális, ha kiadják kísérleti gyártás szintjén, mert annyit úgy sem rendel belőle a piac, hogy kifogyjon. Eleve csak a szerverpiac egy picike, kb. fél százalékát tudja célozni a specifikus interfész miatt. Aztán majd jön a szabványos interfésszel, amikor beindul a tömeggyártás 4 nm-en. A Zen 4 chiplet a Hopperhez viszonyítva egy masszív tömegtermék, aminek milliószor nagyobb a piaca, így jóval több lapkát is kell gyártani belőle.[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

A Tom's táblázata nem bullshit hisz nem azt mondják, hogy ez lesz az Ada , hanem hogy összeszedték táblázatban az eddigi pletykákat és azt összefoglalva kiközölték.

Én valószínűnek tartom, hogy 5 nm-n jön és jön majd egy refresh/ Super majd később kisebb nm-n említve a tegnapi AI tervezést amivel egyszerűbb a folyamat.[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

-

nakos1212

senior tag

Remélem kihoznak egy olyan kártyát ami jó lesz egy "4K budget" cuccnak. Jelenleg nekem az RTX 3070 is bőven elég lenne, de olyan szituációkban, ahol 4K-ban telemegy a VRAM, eléggé lemarad a 6700 XT-hez képest és akadni is kezd. Viszont a Raytracing/DLSS oldala meg sokkal jobb bizonyos játékokban. Remélem az RTX 4050 / TI / RTX 4060 vonal hozza ezt a szintet - legalább 12GB VRAM és 3070 szintű raszter / RT teljesítmény.

-

nakos1212

senior tag

válasz

nakos1212

#37690

üzenetére

nakos1212

#37690

üzenetére

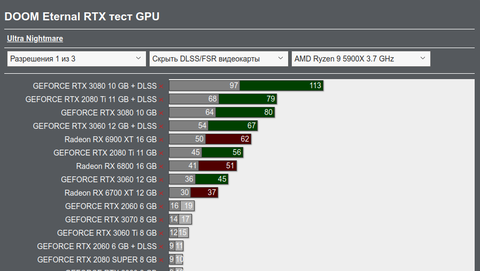

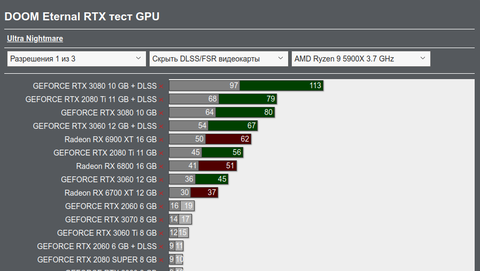

ui: hasonló "anomália" nekem is kijött Doom Eternal-ban., gyakorlatilag 1440p felett muszáj a 10-12GB VRAM, viszont ha levszi az ember a textúra részletességet picit, hogy beleférjen a VRAM-ba akkor már egy 3070 szintű cuccal is tök jól futnak a dolgok még magas felbontásban is, szóval nekem pl. nettó felesleges lenne még a 4K OLED-hez is egy 3070-nél durvább kari, remélem a next-genben nem spórolják le a VRAM-ot a 3070 tier kártyáról.

[ Szerkesztve ]

-

Abu85

HÁZIGAZDA

Egy ilyen szintű újságnak tisztában kellene lennie azzal, hogy melyik pletyka a hülyeség.

Nem akarlak lelombozni téged, de már lassan három éve AI segítséggel terveznek a cégek. Ebben semmi újdonság nincs. A kritikus részeket pedig mindig manuálisan tervezik, mert a gép ezekben szar.

#37688 Petykemano : Nincs sok értelme a monolitikus dizájnnak, ha van chiplet konstrukciód rá.

#37687 Isobutane : Nem, mert itt erősen más irányba történnek a fejlesztések. Az NV specifikus áramköröket rak a lapkába, mint a Tensor feldolgozó, és ezeket nagyon erősíti. Ezzel szemben az AMD sokkal inkább arra költi a tranzisztorokat, hogy fogyasztást spóroljon meg a cache-dizájnnal.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

az Nvcellről [link]2021 Decemberében ben jelent meg erről az első hivatalos tanulmány és 5 napja beszélt erről Bill Dally. [link]

Az hogy elötte voltak már erről infók (hát a PH-n biztos nem) tájékoztatások a technológia fejlesztéséről az nem ugyan az, hogy hivatalosan egy érkező gamer GPU dizájnál használjak már.

Az Ai-t úgy általában persze biztos régebb óta használják tervezésre.[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Abu85

HÁZIGAZDA

Kétlem, hogy az NVIDIA ennyire le lenne maradva, inkább csak most beszélnek róla publikusan. De lassan 15 éve általános a gépi tervezés, nagyjából 10 éve a GPGPU-s, és ezen belül pedig már három éve általánosan beszivárgott az gépi tanulással történő tervezés is.

A piacon lévő legújabb hardvereket már bőven így tervezték. De sok haszna amúgy nincs, mert a kritikus áramkörök tekintetében még mindig sokkal rosszabb a gép, mint az ember. Viszont egy csomó áramkörre meg megéri használni, mert tranzisztorban ugyan szarabb lesz, de időben spórolsz, és nem veszítesz sokat fogyasztásban.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

Kizárt. Ők is ugyanúgy a Synopsys eszközeit használják, ahogy ebben az iparban kb. minden chiptervező. Valószínűleg van Synopsys DSO.ai licencük is, ahogy elég sok cégnek.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Ironizáltam főni.

Valószínűleg piacvezető DGPU gyártókánt és a legnagyobb ML GPU gyártóként van erre megoldásuk és nincsenek elmaradva ezen a téren.

Bill Dally ha azt mondja hogy elég úttörő és egyedülálló az eszközük a gyártás átevezéshez az AI segítségével és pár hónapra lerövidíthető akkor ez így is van.[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Abu85

HÁZIGAZDA

Mindenkinek van. A Synopsys régóta kínál. Egy éve elég modern megoldást is a DSO.ai opcióval, ami kompatibilis a legtöbb EDA eszközzel. Ez egyáltalán nem újdonság, nem értem, hogy miért beszélünk úgy róla, hogy még nem volt ilyen soha. Ezt már egy ideje alkalmazza kb. mindenki, aki top lapkákat tervez.

Ahogy nézem a Cadence is kínál ilyen platformot.A Synopsys és a Cadence eszközei azok, amiket használnak chiptervezésre. Még az NVIDIA sem használ mást, sosem utaztak ilyen területen, így megveszik azoktól a rendszert, akik értenek hozzá.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

Új hozzászólás Aktív témák

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

MIELŐTT LINKELNÉL VAGY KÉRDEZNÉL, MINDIG OLVASS KICSIT VISSZA!!

A topik témája:

Az NVIDIA éppen érkező, vagy jövőbeni új grafikus processzorainak kivesézése, lehetőleg minél inkább szakmai keretek között maradva. Architektúra, esélylatolgatás, érdekességek, spekulációk, stb.

- Milyen TV-t vegyek?

- Gördeszka topic

- Az NVIDIA szerint a partnereik prémium AI PC-ket kínálnak

- Telekom otthoni szolgáltatások (TV, internet, telefon)

- Xbox Series X|S

- Anglia - élmények, tapasztalatok

- Konzolokról KULTURÁLT módon

- BestBuy ruhás topik

- Milyen billentyűzetet vegyek?

- 3D nyomtatás

- További aktív témák...

- Újszerű - POWERCOLOR Radeon RX 5500 XT 8GB GDDR6 VGA videókártya

- Hibátlan - GIGABYTE GTX 1660Ti Windforce OC 6G 6GB GDDR6 VGA videókártya dobozos

- Hibátlan - PALIT GTX 1650 StormX 4GB GDDR5 VGA videókártya - tápcsatlakozó nélküli !!!

- ASUS ProArt GeForce RTX 4080 SUPER 16GB GDDR6X OC (ASUS-VC-PRO-RT4080S-O16G) Bontatlan új 3 év gar!

- XFX RX 6600 XT SPEEDSTER SWFT 210

God of War és a Gears of War( Gears 5) volt

God of War és a Gears of War( Gears 5) volt

![;]](http://cdn.rios.hu/dl/s/v1.gif)

Ertem hogy nem lehet mindenfele spekualciot es hasonlot lehozni, de a technikai cikkek es mindenfele termekbeutatok aranya most mar rohejes aranyban van/

Ertem hogy nem lehet mindenfele spekualciot es hasonlot lehozni, de a technikai cikkek es mindenfele termekbeutatok aranya most mar rohejes aranyban van/