Hirdetés

-

Újabb robottaxis balesetekre derült fény

it Az USA biztonsági vizsgálatot indított a Waymo önvezető autói kapcsán, és újabb balesetekre derült fény.

-

Dobhatja a Google az Exynost és a Samsungot

ma A Tensor G5-öt önállóan fejlesztheti és a TSMC-vel gyárthatja, a G4-et viszont még koreai partnerével.

-

Computex 2024: gamer alaplap és „AI” PC az ECS-től

ph Az Elitegroup új LIVA barebone-nal és a Black alaplapsorozat feltámasztásával készül a tajvani kiállításra.

-

PROHARDVER!

A legtöbb kérdésre (igen, talán arra is amit éppen feltenni készülsz) már jó eséllyel megtalálható a válasz valahol a topikban. Mielőtt írnál, lapozz vagy tekerj kicsit visszább, és/vagy használd bátran a keresőt a kérdésed kulcsszavaival!

Új hozzászólás Aktív témák

-

Alogonomus

őstag

Minden csak a tálaláson múlt volna.

Úgy rossz lett volna az üzenete, hogy az ígért 70% helyett az artifacting kockázata nélkül csak 40% jött össze. Úgy viszont nem lett volna igazán kínos, hogy lám a 70% nem lehetetlen, de még csiszolniuk kell rajta a végső engedélyezés előtt.

Akár még úgy is kiadhatták volna a kártyákat, hogy a felhasználó választhatott volna a korlátozástól mentes driver és a korlátozó driver között. Előbbinél pedig elfogadta volna a felhasználó, hogy a X óránként újra kell indítania a játékát.

Az elmondás alapján valami szinkronizációs hiba lehet az MCD és GCD között, aminek a mértéke hosszú játék alatt a tűrési határ fölé halmozódik. A kiadott driver is állítólag egy pillanatnyi szünetet "stall" illeszt be időnként a végrehajtási sorba, és azalatt az MCD és a GCD valószínűleg újra tudja szinkronizálni az adatkapcsolatát.

Az AMD valószínűleg biztonságosan nagy szünetet tett az első driverbe, és most azt vizsgálják, hogy mekkora hosszúságú szünet mellett tud még biztonságosan működni a kártya, illetve esetleg a driverbe, vagy a kártya BIOS-ába be tudnak-e tenni egy artifacting jelenséget detektáló rutint, és így elég lenne csak az artifacting megjelenésekor újraszinkronizálni a GCD és MCD-k közötti kapcsolatot. Mivel állítólag csak több órányi játék hatására jelenik meg az artifacting, senki sem venné észre, ha mondjuk 2,5 óra játékidőnként egyszer beesne az fps 25%-ra.[ Szerkesztve ]

-

A gyártást belekeverni szerintem felesleges felhasználói szinten, mert nem tudjuk a részleteket.

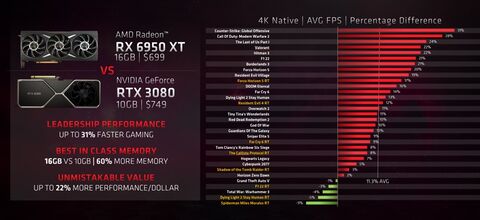

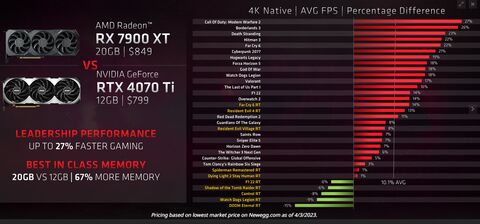

Állítólag AMD olcsóbban gyártja a 7900XT-t.

A többi érthető.[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Persze hogy nem pótolja( nem is ezt írtam) , csak némileg javít rajta, főleg a nagy L2.

500$ lenne a reális ára. ebben a formában. Olyan érzésem van hogy az összes SKU elcsúszott nevezékben egyel feljebb.

Szerintem amikor látták hogy az AMD 20-25 % kal lassabb az előzőleg beharangozotthoz képest fogták aztán a 4060Ti ból lett 4070 Ti a 4070Ti ből 4080 és így tovább , ott lapul még egy 15-20% kal gyorsabb SKU a tarsolyban amire nem volt így szükség behozni.[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Abu85

HÁZIGAZDA

A DirectStorage az csak ront a memória problémáján, mert a GPU-s dekódolás miatt nem csak a dekódolt textúrákat kell tárolni, hanem a kódoltakat is. Tehát az lehet, hogy ez a technika gyorsabb betöltést és jobb streaming képességeket biztosít, de ennek az ára, hogy jobban zabálja majd a VRAM-ot.

Ezen egy olyasmi módszer segítene, hogy lenne egy API a lapalapú menedzsmentre, hogy ne teljes nagy allokációkat, hanem szimplán 4 kB-os lapokat mozgasson a rendszer. De ez PC-n nincs csak konzolon.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

paprobert

senior tag

Tudsz ilyenre példát?

Lassú játékmenet példa: 3rd person sztori alapú játékok. pl Cyberpunk, GTA és társai.

De ide tartozik bármilyen játék, ami Geforce Now-on használható kategóriába esik. Az a játék, ami GF Now latencyjével elviselhető, ahhoz képest a DLSS3 meg se kottyan, vagyis széles a paletta.CPU limites példa: MS Flight Simulator. Illetve egyre több érkező, PS5-XSX only játék ebbe a kategóriába kerül.

Bármilyen játék, amikor megkerülhetetlen CPU limited van, vagy régi platformon ragadtál.Soha nem kapcsolod be:

-50-es képkockaszám alatti tartományban

-multiplayer / kompetitív játékban.#60891 Abu85

Én egyedül attól tartok, hogy univerzális, frame buffer alapú bűvészkedés lesz az AMD verziója, azaz egy átlagos TV smoothness filter. De ne legyen igazam.[ Szerkesztve ]

640 KB mindenre elég. - Steve Jobs

-

Petykemano

veterán

Ha skyjuice tavalyi adatai még ma is helytállóak, akkor ez valóban inkább arra utal hogy Navi31-ből vágták.

Akkor már csak az a kérdés, vajon megjelenik-e ez 256bites változat desktopon is.

És hogy ez tényleg azt jelentené-e, hogy a Navi32-t elkaszálták?Találgatunk, aztán majd úgyis kiderül..

-

S_x96x_S

őstag

na végre .. valami hír ... Április 30;

AMD Ryzen 7040 Phoenix rumored to launch in late April, nearly 5 months after being announced"

The leaker also claims that the Ryzen 7 7840U, the 15W Phoenix, would launch on the 1st of May. It’s claimed it is very likely that all Phoenix APUs will launch within one week.

Interestingly, despite numerous leaks featuring the low-power Phoenix series, AMD has not officially confirmed the Ryzen 7040U SKU lineup yet. The company did mention that 15W Zen4 processors are coming, but thus far, AMD has been reluctant to share the specs.

As of now, we are aware of nine Phoenix SKUs featuring H, HS and U-series models. The series will be divided by the TDP and clocks.

However, the basic core-count and integrated RDNA3 GPU specs should remain similar."

akkor májusban jön a termékcunami ..[ Szerkesztve ]

Mottó: "A verseny jó!"

-

Busterftw

veterán

A 3080 10GB 1440p-ben kb 1%-al marad el a 6800XT-től, 4K-ban pedig kb 3%-al gyorsabb annál. Ennél a 12GB verzió csak pár FPS-el gyorsabb.

Nem értem mi volt előre borítékolható és miért ne merülhetett volna fel, mint opció.

Ahogy kb minden generációban, az AMD több vrammal hozta a kártyáit, teljesen feleslegesen.[ Szerkesztve ]

-

Mert milyen hátránya van egy 3080 12 GB nak egy 6800XT hez nézve ? nehogy azt mond hogy a 12 GB kevés ahhoz nézve. A 10 sem az.

Pont ezekkel a gondolatokkal tudnám neked leírni az én 3080 vásárlásom csak megfordítva... megfordult a fejemben a 6800 XT de aztán gyorsan elvetettem és nem bántam meg soha egy perce sem. sőt..

Ez a "lehetne picit erősebb RT ben 1-2 címben " kb pont olyan elkicsinyítés és túlzás mint a 10-12 GB vramot használhatatlannak minősíteni. Attól hogy a 6800XT-n 16 GB vram van messze elmarad mind RT ben mind felskálázási minőségben az Ampere szériától. Erősebb RT címekben 40 % fölötti elmaradása van egy 3080 hoz képest( CP2077 natívban 60% fölött) a DLSS 2.3 meg ehhez még hozzá tesz egy lapáttal. Kb a 3-400 dolláros 3060 hoz lehet hozzámérni.[link]

Mondjuk úgy hogy mindkét kártya családnak meg van a maga gyengesége és erőssége. Pont a fenti dolgok miatt én a saját értékrendem szerint messze nem érzem a 6000 szériát a jövőre nézve éppen időtállónak a plusz Vram ellenére az Ampere szériával szemben a saját igényeimhez mérten.

Ti elfogadjátok a kisebb RT teljesítményt mi meg a néhol kompromisszumos Vram mennyiséget.

Ettől függetlenül természetesen a mostani 4070 Ti fiaskót ilyen drága GPU nál a vram spórolást én is elítélem. A 4070 TI egy sokkal jobb kártya lehetne 16 GB vrammal.[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

A Witcher 3 mint a legdurvább terhelésű RT játék? ok .

Na én írom azt erre hogy kábíts mást ezzel. kevered azt ,hogy egy utólagos belefoltozott RT nem fut elég gyorsan minden kártyán .

Na én írom azt erre hogy kábíts mást ezzel. kevered azt ,hogy egy utólagos belefoltozott RT nem fut elég gyorsan minden kártyán .

A CP2077 a legdurvább RT játék a piacon és a Portal.

Nincs itt kábítás, ez tény.

Azt hogy neked mi a véleményed és az igényed az a te dolgod attól a tény tény marad a két felskálázás minőségében és külön leírtam hogy az én értékrendszerem szerint amiben :

1, számít az RT

2, és pont ezért számít a felskálázás minősége. Ebben nem fog a 6800XT jobb lenni a plusz Vram miatt , mint a 3080 és pont ezért nem időtálóbb számomra. Anno hány ilyen kommentet olvastam a Turing vs RDNA1 kapcsán.[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

PuMbA

titán

"Ez a rengeteg bug, bénázás és szoftveres kiforratlanságok szerintem sokkal több vásárlót riasztanak el, mint a hardvereik teljesítménye, ami alapvetően rendben lenne."

Ebben egyetértünk

A mostani CPU fiaskó miatt jó pár évig sokan nem fognak AMD CPU-t venni, de a 7900XTX induláskori szoftveres dolgai is megadták sokaknak az irányt. Évek óta ugyanezt csinálják és még mindig nem találják az ellenszert....egyszerre szomorú és hihetetlen.

A mostani CPU fiaskó miatt jó pár évig sokan nem fognak AMD CPU-t venni, de a 7900XTX induláskori szoftveres dolgai is megadták sokaknak az irányt. Évek óta ugyanezt csinálják és még mindig nem találják az ellenszert....egyszerre szomorú és hihetetlen.[ Szerkesztve ]

-

hahakocka

senior tag

Igen viszont a kevès Vram bajt hozhat mert 1.5-2gb Vram többletet kèr a nemrèg linkelt Jedi 2 ben, de Last of Us is, Resi 4 remake , a Hogwarts legacy is ugyanezt adta ki teszteken. S pont az Nv Achilles sarka a kevès Vram akadályozhatja az Rt használatát amiben meg pont jók lennènek önön tökön rúgás esete. 1440p-4K ra vannak kitalàlva az új kártyàk S ezekben eszik 10.5-14 GB közt ez a pár game Rt vel . Necces azèrt.

[ Szerkesztve ]

-

PuMbA

titán

Na ilyenekre gondoltam

Ez a kiváló marketing. A streamerek agyába már el is ültették, hogy megint NVIDIA-t kell venni, ha a legjobb minőséget akarják. Az AMD hol van az Abu által beharangozott világverő AV1 enkódolásával, amit a Xilinx-től szed? Sehol. Az AMD csak magának köszönheti, hogy az NVIDIA legyalulja részesedésben.

Ez a kiváló marketing. A streamerek agyába már el is ültették, hogy megint NVIDIA-t kell venni, ha a legjobb minőséget akarják. Az AMD hol van az Abu által beharangozott világverő AV1 enkódolásával, amit a Xilinx-től szed? Sehol. Az AMD csak magának köszönheti, hogy az NVIDIA legyalulja részesedésben.[ Szerkesztve ]

-

Ez teljesen más jellegű, mint ez, ahol egy Nvidia oldalon egy Nvidia Blogban egy charton megemlítik hogy konkurens GPU miközben alul apró csillagban meg van jelölve hogy milyen konkurens GPu ról van szó.

igen ez nem chart,ez egy finomabb marketing.

Eközben :[link] csak 1-2hónapon belül Sasa a Marketing igazgató:

Szóval nem olyan elveszett báránykák, beleállnak a direkt marketingbe.

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

huskydog17

addikt

Marketing, a TSMC ugyanezt csinálja.

Gameplay csatornám: https://www.youtube.com/channel/UCG_2-vD7BIJf56R14CU4iuQ

-

huskydog17

addikt

A 4nm valójában tovább fejlesztett 5nm, a TSMC saját maga - ahogy láthatod a saját weboldalukon - az 5nm kategóriába sorolja (5nm technology), szóval a 4nm is csak marketing név.

"In addition, TSMC plans to launch 4nm (N4) technology, an enhanced version of N5 technology."

Az, hogy az NV hogyan nevezte, teljesen lényegtelen, akár enhanced N5 (N4) akár nem, a TSMC saját maga 5nm-be sorolja mindkettőt.

A TSMC az Intel korábbi + jelölése helyett inkább másik számot rakott oda, pedig ők is megtehették volna, hogy N5+ jelölést használnak (7nm-nél meg is tették).Gameplay csatornám: https://www.youtube.com/channel/UCG_2-vD7BIJf56R14CU4iuQ

-

PuMbA

titán

Igen. Sima magas beállításokra gondoltam, RT nélkül. Kivétel Fortnite, ahol szoftveres RT-vel együtt is megvan

Azért példálózok a sima 6800-zal, mert magasan a legjobb teljesítmény / fogyasztású kártya az előző generációból A többi alternatíva egy kazán a mostani generációhoz képest, szóval szerintem azok felett erősen eljárt az idő.

[ Szerkesztve ]

-

Yany

addikt

hehehe

Nekem nem magyar a Windows telepítőm sem, de szerintem ilyen már nincs is. Aztán lehet, hogy van default nyelv a Win telepítőben, az enyém eleve angolul szólalt meg (gondolom mivel angol nyelvű m$ siteról szedtem le).

[ Szerkesztve ]

Építs kötélhidat - https://u3d.as/3078

-

PuMbA

titán

Én úgy tudom, hogy nem az NVIDIA féle működéshez van szabva, hanem az NVIDIA elkezdte gyártani a hozzá legjobban passzoló hardvert. Ez eddig még bejött. Az AMD óvatosabb volt, kisebb területet szánt az RT egységnek és a hardver se olyan, ami a DXR-hez idomul. Az AMD arra brazírozik, hogy nagyban változni fognak még az RT dolgok és inkább nem ölt bele annyi pénzt.

Illetve a DXR 1.0 már halott, szóval a DXR alatt csak az 1.1-et értjük már. A Fortnite alatt a HW RT az elvileg ugyanaz, mint a DXR. Abu majd pontosít.

[ Szerkesztve ]

-

Nem íródott semmi arra hardverre, ez urban legend. Az Intel belépett a piacra és az Arc 770 sok esetben hozza a vele egyenrangú Nvidiás társát RT alatt. [link]

A Miértjét leírtam miért nem láthatsz .mert ezek elméleti számok és semelyik gyártó nem saját megoldásra fejleszt( szerencsére), kivéve pár techdemót. Ott a Portal próbáld meg futatni egy 7900XTX-en.[link] hányszoros sebességre képes az RTX 4090 ..[link]

Ha megosztódik a piac ez várható.

Nem értem miért lehetetlen elfogadni itt ezt hogy egyszerűen RT alatt szükséges mérlegelni hogy az AMD hardverek gyengébbek ebben. Lehet elhitetni hogy majd szoftveresen be lehet ezt hozni de csak úgy ha a másik gyártó kártyában benne hagyjuk a sebességet és /vagy a minőséget. Mind a két út szükséges.[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

PuMbA

titán

Nekem is egy 5600X miatt kevés a gépem összfogyasztása. Van beállítva rá egy -15-ös all core alulfeszelés PBO Curve Optimizer-rel és így 80-90%-os terhelésen is a gyári 77W maximum helyett 50-60W körül megáll játék közben 4.6 GHz-es átlagos órajellel. Továbbá a gépemre nincs ráaggatva sok minden. No RGB, 1db NVME SSD-m van, billentyűzet, egér. webcam és ennyi.

[ Szerkesztve ]

-

Alogonomus

őstag

Igen a dual issue kialakítás lehet magyarázat a kiugró értékre, bár olyan híreket hallottunk már, hogy a sugárkövetés hatékonyságában az N33 nem lesz lényegesen jobb, mint amilyen az N23, szóval valószínűleg lesz egyszerűsítés az N31-hez képest a feldolgozóegységek vonatkozásában is.

Mindenesetre ezekkel az értékekkel még a dual issue feltételezése mellett sem a 6650 XT szintjének tűnik a 165 watt esetén jósolt teljesítménye, hanem minimum 6700 XT-nek, de jó eséllyel a 6750 XT is meglehet. Már ahol a memória kapacitása nem jelent majd gondot. -

Yany

addikt

Akkor én is hadd egyszerűsítsek: tehát akkor a piacon másodikak voltak.

Másrészt... innovációnak én azt nevezném, ami előremozdít valamit egy aktuális állapothoz képest. Perpill a chiplet nemhogy nem járt látható előremozdulással, de vannak hangok, amelyek szerint éppen egyik oka a konkurens termékekhez képesti lemaradásnak. Noha nemcsak a chipletes implementációk maradnak le, részben az erre (látszólag, legalábbis egyelőre hiába) fordított erőforrások is magyarázatot adhatnak. Csak gondoljunk bele, ha mindezt energiahatékonysági fejlesztésekre fordították volna, miben lenne más a helyzet... Amúgy az NVIDIA szerintem a Tegra kifejlesztése óta messze többet tud az energiahatékonyságról, mint az AMD. (picit felidézi bennem a Core processzorok izraeli kifejlesztését, amikoris az Intel visszalépett a P4-től ugye és állva hagyta az AMD-t).

Építs kötélhidat - https://u3d.as/3078

-

Az a hardveres Gsync a mai napig az egyik legjobb változó frissítési megoldás amivel a szabvány nem igen tudott még ma sem konkurálni. megszabta hogy az a monitor amibe az belekerült minimum mit tud, és az a mai napig is egyedülállóan széles tartományban működik, 1 FPS- től.

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Busterftw

veterán

Aha, mese habbal.

2013 oktober Montreal eventen bejelentettek a G-Syncet (mukodo prototipussal demozva), decemberben mar voltak tesztek az elso kaphato monitorokrol.

4 honapra ra CES-en az AMD bejelentette, hogy dolgoznak a FreeSyncen.Tehat te azt mondod, hogy az AMD bejelentese utan az Nvidia gyorsan osszelapatolt egy sajat verziot, gyorsan osszelapatolta a hardveres G-Sync modult, gyorsan osszelapatolta a monitor gyartokat akik aztan kijottek sorra a G-Synces monitorokkal.

Ez aztan az alternativ valosag.Mikozben FreeSynces monitor meg 2015 januari cikkben szerint nem is volt piacon.

"AMD offers a similar technology called FreeSync that's compatible with that company's current R7 and R9 series desktop graphics cards. It, too, uses DisplayPort, but requires a monitor with the adaptive sync specification, which is free to use so it could be more widely available than branded G-Sync monitors (although adaptive sync monitors for FreeSync are not yet for sale)."2014 Junius Computex-en az AMD mutatott egy prototipust, 2014 decembereben jelentettek be az elso monitorokat.

Es ez a FreeSync kanyarban sem volt a hardveres G-Synccel, sot, a mai napig nem az, mert a legtobb FreeSynces monitor 48Hz-tol mukodik, nem teljes tartomanyon.Ez nem marketing, hanem innovacio, AMD meg mint kb minden massal, kijott masodikkent.

Yany

A chiplet ugye a DARPA CHIPS-tol szarmazik, csak az AMD hozta le consumer CPU piacra.[ Szerkesztve ]

-

Nem akarok az időrendekbe belemenni,de az a kulcs abban amit írsz. Érdemes utánanézned az akkori szabványnak és a gsync modullal megjelent monitorok akkori tudásának Hz , tartomány stb terén. Tényleg prémiumok voltak. ( árban is)

A szabványos megoldások simán kiszolgálják a hétköznapi igényeket ma már,de apróságokban a gyártói megoldások jobbak és egyfajta tanúsításként működnek ma már. ( ideértve a freesync prémiumot is, ami szintén apróságokban jobb mint a szabványos vesa szerintem ) nem más működési tartomány terén plusz jött az ULMB is.

Amúgy a szabványos HDMI az RTX 3000 kártyákon ugyan úgy működik DP-n át meg már pár éve szintén szabványos megoldásként jelen van . Az RTX 3000 és onnantól felfele tulajdonképpen három féle sync áll rendelkezésre. HDMI 2.1 et támogató szabványos, DP-t támogató szabványos és a Hardveres G-sync.jacek: nem egészen. Ez egy jó cikk.[link]

A Freesynccel nem vagy gyártóhoz kötve, ami jó dolog.[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Busterftw

veterán

"Szerencse, hogy nem kevered össze-vissza az AMD implementációját (FreeSync) az annak alapját képező VESA Adaptive sync technológiájával."

Nem keverem, mindketto Adaptive Sync-re epul, az innovacio itt a G-Sync modul volt es piacon elsoseg. Nem "gyorsan" jott ki ezzel az Nvidia, mar csak a sajat hardveres modult kifejlesztese es gyartasa miatt sem volt ez lehetseges.

Az AMD sajat megoldasaval csak kesobb jott ki, masodikkent.

"Ehhez nem kell G-sync. A széles tartományú szabványos monitorok is tudják, az AMD FreeSync LFC technológiájával (mai nevén AMD FreeSync™ Premium). Ugyanúgy 1FPS-től működik."

A FreeSync Premium 2020-ban debutalt, olyan feature-rel amivel a G-Sync mar 5+ eve piacon volt.

A gond azzal van, hogy hiaba van ez a funkcio a Freesync monitorok tobbsege 48hz-tol mukodik.Szoval adhatjuk hozza a tobbihez, RT, DLSS, esatobbi, amikkel az AMD csak jatsza evek ota a catch-upot.

[ Szerkesztve ]

-

A G-sync 2013 ban debütált amúgy és már akkor is 30 Hz-t írtak minimum majd 1 Hz tól már ment rá pár hónapra. A Vesa 2014 ben, fél évre rá kb jelentette be az Adaptive sync technológiát amire a Freesync épült.

Természetesen jó dolog, hogy a nyomás hatására engedett Nvidia mert őszintén megmondva a hardveres Gsync szuperül működött az Asus monitoromon de a panel önmagában tragédia volt. Kb 3 helyen világított át meg hasonló nyalánkságok. A Samu ebben mérföldekkel jobb.

A Samu ebben mérföldekkel jobb.

Nekem szerencsére jól működik az A-sync a Freesynces monitoron, de erősen gondolkodok, hogy váltok egy HDMI 2.1 vezióra az a biztos. Nem lehet itt megbízni egy cégben sem

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Busterftw

veterán

De most pontosan mit akarsz mondani?

Innen indultunk:

"...továbbra sem látom, hogy mit innovál és miben jár saját(!) utat a cég. Örök másodhegedűs..." - YANY

"Pedig bőven van náluk is, sőt. De valamiért nem tudják ezt megfelelően marketingelni, eladni. A kedvencem a G-sync esete volt, amit gyorsan kiadtak a zöldek, gyakorlatilag egy prototípus szintű megoldással, miközben az AMD azon fáradozott a VESA-n belül, hogy szabványos formában mindenki számára elérhetővé tegyék... Lásd p"Tehat a FreeSynccel itt az AMD mit innovalt, amirol szo van?

"Persze, azért jöttek ki egy kutya közönséges Altera gyártmányú kész FPGA-val"

Ez miben vitatja a G-Sync innovaciojat es elsoseget?

A scaler quality control miatt kellett, mert amig az AMD-nek kb +6 ev kellett a FreeSync premium bevezeteseig, az Nvidia sajat scalerrel megoldotta a teljes tartomanyt."Ugyanúgy 2015-től elérhető volt ez a technológia is"

Tehat 2 evre ra amit a G-Sync mar tudott. Tudod, gyorsan, az Nvidia elott, innovaltak.[ Szerkesztve ]

-

Azért írtam, mert Onnan indultunk, hogy Nvidia szerinted a Freesync miatt összedobta a Gsyncet gyorsan. Az Nvidia 2013 decemberében már kész, legyártott, kereskedelmi forgalomba hozható monitort mutatott be és forgalomba jöttek az Asus gsync monitorjai, majd rá fél évre , 2014 ben az Vesa bejelentette az Adaptive Syncet.

Elkönyvelhetjük hogy 2013 decemberére a monitorokban jelenlévő hardvert már legalább 2012 ben elkezdte Nvidia tervezni azt gondolom az Alterával, és ellátni a hozzá való interfésszel és az egész köré felépíteni a szükséges szoftveres hátteret együttműködve a 4 kezdő monitorgyártóval.Igen tisztában vagyok mi az a szabvány. Ezért írtam hogy most a 2.0 Dp és a HDMi 2.1 megjelenésével kezdi értelmét veszteni valójában a Freesync és a Gsync megnevezés, lassan egy egyszerű tanúsítássá degradálódik szerintem a dolog mindegyik oldalon. Én ennek örülök amúgy.

A HDMI 2.1 azért kell nekem hogy a PS5 mehessen rá frankón.

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Ez egy oltári nagy baromság, már bocs.

Így próbálsz kijönni abból hogy hülyeséget írtál az elején ezt tetézted ezzel.

Elég lett volna annyi hogy fogalmad sem volt a dátumokról , bocs, az is jobb lett volna mint ez a komment.

Én nem írtam hogy oltári nagy innováció volt bármi is vagy kritizáltam AMD-t ilyesmiben. Pont azt írtam hogy rendben van a dolog amit csináltak.

Azt írtam hogy Nvidia elöbb jött ki a szabványnál és Amd nél a saját egyedi megoldásával ami a mai napig az egyik legjobb.[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Nincs mit megcáfolni a nyilvánvaló hülyeségen és ezt tisztelettel írom neked. Nem nekem kellene hozni bármire is cáfolatot. Te állítasz dolgokat a tényekkel szemben és feltételezel.

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

kisfurko

senior tag

-

Busterftw

veterán

Az nem erv, hogy forras nelkul te hasrautve leirtad, hogy a G-Syncet az Nvidia osszedobta, gyorsan az AMD CES elott, ami meg csak bejelentes! volt, mukodo prototipust csak fel evvel kesobb mutatott az AMD.

Ekozben mar lassan 1 eve volt mukodo prototipus Nvidiatol es piacon megjeleno megoldas, tobb monitorgyartotol.

Illetve teljesen irrelevans, mert arrol szolt a vita, hogy az AMD mindig orok masodik, sajat innovacio nelkul.A tenyek pedig azok, hogy az Nvidia elsokent lepett ezzel a piacra, evekkel az AMD elott mar olyan allapotban amit az AMD csak sokkal kesobb tudott lekovetni.

-

Hogyne tudnád :

Amit linkelsz abban is 2014 januári a javaslat Nvidia 2013 Októberben mutatta be a Gsyncet.

[MSA Timing Paramater Ignore ]2014 januárban nyújtotta be AMD a kérelmet a CES -után a DP1.2a szabvány módosítására.

Áprilisban ezt elfogadták, majd 2014 májusában jelentette be a Vesa az A-syncet a DP szabvány részeként, mert igazából minden adott és kész volt, AMD meg leegyszerűsítve erre rávilágított, hogy hülyék vagytok ha ezt nem teszitek bele mikor a saját szabványotok évek óta egy más területen.

Addigra a Gsync már boltok polcain volt, kis túlzással.

Tehát jóval előbb megszültetett a gsync, mint hogy a DP az adaptive szinkronizálást bejelentettete a szabványon belül.

Ezért írtam, hogy nem feltétlenül kell mindig a rossz szándékot feltételezni. Valószínűleg ha ez előbb kiderül, akkor nem öntöttek volna bele egy csomó pénzt a Gsyncbe, de akkor meg már visszatáncolni nem akartak, mert a monitorgyártók egy valag pénzt fecceltek bele állítólag az egyedi gyártásba.. Szóval belekerültek egy elég szar szituációba amihez 3 évig próbáltak ragaszkodni de 2018 őszén már ment a pletyi hogy jön a hivatalos támogatás.[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

bitblueduck

senior tag

van ami sosem változik. HD5850-el egész boldog voltam, de szeretek régi gamekkel is játszani aztán vicces hogy (kis túlzással) minden driver update után máshol volt egy kis grafikai glitch

meg 1000 apróság, hogy pl úgy emlékszem AMD driver után a 2 monitoron a desktopon lévő fájlokat 1 monitorra dobta mindig aztán pakolgathattam. még mintha az R9 280 esetén is így lett volna. NV update után meg most minden marad a helyén miután kész a frissítés. ez már azóta megoldódott, tudja-e valaki?aztán itt fórumon is megy a hiszti, hogy AMD mindig másodhegedűs innovációban, de azt lehetne ellensúlyozni betonstabil szoftverrel. sőt, igazából csak arra lehetne építeni, jó az az asztalos hasonlat. de ez úgy tűnik nem prio.

An open mind is like a fortress with its gates unbarred and unguarded.

Új hozzászólás Aktív témák

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

MIELŐTT LINKELNÉL VAGY KÉRDEZNÉL, MINDIG OLVASS KICSIT VISSZA!!

A topik témája:

Az AMD éppen érkező, vagy jövőbeni új grafikus processzorainak kivesézése, lehetőleg minél inkább szakmai keretek között maradva. Architektúra, esélylatolgatás, érdekességek, spekulációk, stb.

Állásajánlatok

Cég: Ozeki Kft.

Város: Debrecen

Cég: Ozeki Kft.

Város: Debrecen

Na én írom azt erre hogy kábíts mást ezzel. kevered azt ,hogy egy utólagos belefoltozott RT nem fut elég gyorsan minden kártyán .

Na én írom azt erre hogy kábíts mást ezzel. kevered azt ,hogy egy utólagos belefoltozott RT nem fut elég gyorsan minden kártyán .

A mostani CPU fiaskó miatt jó pár évig sokan nem fognak AMD CPU-t venni, de a 7900XTX induláskori szoftveres dolgai is megadták sokaknak az irányt. Évek óta ugyanezt csinálják és még mindig nem találják az ellenszert....egyszerre szomorú és hihetetlen.

A mostani CPU fiaskó miatt jó pár évig sokan nem fognak AMD CPU-t venni, de a 7900XTX induláskori szoftveres dolgai is megadták sokaknak az irányt. Évek óta ugyanezt csinálják és még mindig nem találják az ellenszert....egyszerre szomorú és hihetetlen.

A Samu ebben mérföldekkel jobb.

A Samu ebben mérföldekkel jobb.