- Versenybe hozta magát az új Xeonnal az Intel

- Titan Army P27GR monitor: hogy tud ilyen olcsó lenni?

- ATX 3.1-es Seasonic tápok a picit pénztárcabarátabb szegmensben

- Boldog-boldogtalan kézikonzolt akar kiadni, de egyelőre nincs meg a felvevőpiac

- Megszellőztették az MSI Unify-X alaplapsorozat visszatérését

Hirdetés

-

Wooting 80HE teszt

gp Megérkezett a játékos billentyűzetek koronázatlan királyának nagytestvére, a TKL méretű Wooting 80HE, amelyet az elsők között próbálhattunk ki.

-

Konvektor korszerűsítés - Computherm KonvekPRO felszerelése Q7RF szobatermosztát

lo Működési elv:A gázkonvektorok szerves része a hőmérsékletérzékelő szonda. A szonda egy a termosztáthoz kapilláriscsővel...

-

Ismét a vietnámi OLED-gyártásba fektet a Samsung

it További 1,8 milliárd dollárt fektet be Vietnámban a Samsung az OLED-kijelzők gyártása kapcsán.

-

PROHARDVER!

A legtöbb kérdésre (igen, talán arra is amit éppen feltenni készülsz) már jó eséllyel megtalálható a válasz valahol a topikban. Mielőtt írnál, lapozz vagy tekerj kicsit visszább, és/vagy használd bátran a keresőt a kérdésed kulcsszavaival!

Új hozzászólás Aktív témák

-

jó ez a beszélgetés.

#1 mi volt 2007-ben?

#2 hát 2010 után az a helyzet, hogy ...

#3 goto #1úgy nem nagyon fogunk előremenni, hogy mindig a DX11 problémáit hozod fel, amikor a megelőző időszakról van szó

amúgy meg, ha minden shooterben olyan AI lenne, mint a FEARben, akkor hajlanék rá, hogy valami összefüggést sejtsek, annak ellenére, hogy a négymagosok megjelenésével az egyszálon üzemelő API miatt pont keletkezett extra CPU power, és a mostanában általad rengeteget emlegetett CPU time locknak még híre-hamva nem volt. azonban a legtöbb AI lényegesen ostobább, úgyhogy kénytelen vagyok továbbra is arra gondolni, hogy szartak rá. és a többség most is szarik, maximum a DX11 bajait kényelmes felhozni ürügyként.

"... and with your wicked wishes we will rise again"

-

daveoff

veterán

Valóban van egy-két effekt, ami jól néz ki, füstök, árnyékok tényleg nagyon jók, de összességében szerintem nem üti meg a mai játékok szintjét. Te játszottál már vele? Ez a kép nagyon jó, de ez valami photoshoppolt játék reklámozó képnek néz ki, nálam nem így néz ki a játék FHD kimaxolva. Majd keresek valami jelenetet, ahol van tűz, füst meg minden, és lövök pár képet.

LG 27GL83A 27'' UltraGear™ QHD IPS 1ms Gaming Monitor with G-Sync®

-

Abu85

HÁZIGAZDA

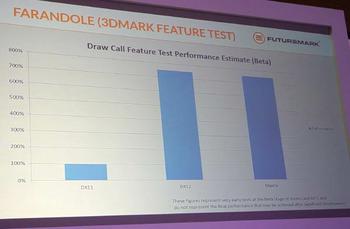

Még annyit tennék hozzá az egész nagy API leváltós vitához, hogy természetesen bizonyos értelemben megbomlott az egyensúly, illetve az a stabil alap, amit a Microsoft és a Khronos biztosított a DX és az OGL API-kkal. Két cég nyerészkedni akar a váltáson, amit egyébként az MS a DX12-vel és a Khronos az új OGL bejelentésével akceptál. Az Apple és az AMD időben felismerte a problémát, és mertek reagálni egy-egy saját API-val. Nyilvánvaló, hogy ennek lesz hatása a piacra olyan értelemben, hogy a többiek nem mertek lépni, mert például nem akarták megbolygatni a piac számukra megfelelően stabilitását. Egy ideje bizonyosan azon megy a vita a konkurenseknél, hogy "van ez a két marha", akik vágtak magunknak egy saját ösvényt, és több fejlesztőpartnerüket beterelik majd.

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

azt nem lehet érteni, hogy miért nem a problémával foglalkozol, és miért az aktuális vesszőparipádat hajtogatod helyette

utoljára: a probléma az, hogy a FEAR óta semmi AI fejlődés nem volt. tegyük fel, hogy a DX11 mostanra tényleg annyira szar lett, mint ahogy lefested - ez akkor sem magyarázat arra, hogy 2006 és 2010 között miért nem volt semmi generál előrelépés AI-ban. számítási erőforrás volt, szakértelem valószínűleg szintén volt - marad az, hogy nem szántak rá pénzt. szinte senki.

utoljára: a probléma az, hogy a FEAR óta semmi AI fejlődés nem volt. tegyük fel, hogy a DX11 mostanra tényleg annyira szar lett, mint ahogy lefested - ez akkor sem magyarázat arra, hogy 2006 és 2010 között miért nem volt semmi generál előrelépés AI-ban. számítási erőforrás volt, szakértelem valószínűleg szintén volt - marad az, hogy nem szántak rá pénzt. szinte senki.[ Szerkesztve ]

"... and with your wicked wishes we will rise again"

-

letepem

aktív tag

Ezt alá tudom támasztani igaz még csak az uncharted 1-gyel játszom, de miden vagy hardon az AI nagyon jól reagál: kitér, máshol bújik ki, pattintva dobja elém a granyót. Szóval meglehetősen szemetek

Pc-n ilyet nem láttam soha pedig egy 2007-es játek (grafikája is f@sza ahhoz képest, hogy 7-8 éves)

Pc-n ilyet nem láttam soha pedig egy 2007-es játek (grafikája is f@sza ahhoz képest, hogy 7-8 éves)gbors részedről pedig csak kötekedés minden kommented, megkapod a választ, de az számodra elfogadhatatlan és szajkózod tovább

látok, hallok, érzek és gondolkodom.

-

a DX11-et akár még el is hiszem (bár jóval kevésbé sarkított formában, mint ahogy itt szerepel), a többit nem, tekintettel arra, hogy évekig azért szidták a DX-et, mert egyetlen szálat használ.

az pedig, hogy az Uncharted és még 1-2 exkluzív játék készítői igényesebbek az átlagnál, nem jelenti azt, hogy a PC-ben van a hiba...(#8679) letepem: komolyan?

feltettem ugyanazt a kérdést kb. 5x 2007-tel kapcsolatban, és 5x visszakaptam, hogy a DX11 ígymegúgy. ha ez Neked válasz, akkor javaslok egy értelmező olvasás tanfolyamot.

feltettem ugyanazt a kérdést kb. 5x 2007-tel kapcsolatban, és 5x visszakaptam, hogy a DX11 ígymegúgy. ha ez Neked válasz, akkor javaslok egy értelmező olvasás tanfolyamot."... and with your wicked wishes we will rise again"

-

na, még a végén eljutunk valahová

Viszont a driverek már 2006-ban több szálon működtek, tehát az erőforrást elvették

tényleg itt a probléma forrása - ez a következtetés ebben a formában nem állja meg a helyét. a többszálúsítás egy lehetőség, egyáltalán nem jár szükségszerűen resource lockkal. ha jól rémlik, kényszerű lockolások nVidia oldalon a FW 300-as szériában bukkantak fel - volt is gond az első driverekkel akkoriban.

"... and with your wicked wishes we will rise again"

-

gondolom, nem szándékosan, de ezzel a hozzászólással némileg felülírtad a korábbi érvelésedet. eddig az volt a mondásod, hogy a driver elveszi az erőforrásokat, és a programok nem férnek hozzá - itt most ez arra módosult, hogy a driver CPU-használata kiszámíthatlan, és ezért a fejlesztők félnek hozzányúlni a CPU-erőforrás egy bizonyos részéhez, mert benne van a pakliban, hogy ütköznek a driverrel, és kontrollálhatatlan belassulások keletkeznek. maradjunk ennél a verziónál?

"... and with your wicked wishes we will rise again"

-

(@HSM: elég komoly a különbség, az alábbiak miatt: )

érdemes lenne a fogalmakat rendbetenni. ha fizikailag nem elérhető az erőforrás (mert valaki lockolta), az egy dolog, ott sok mindent nem lehet tenni. viszont ha "csak" arról van szó, hogy van esély arra, hogy összeakadjon a program a driverrel, akkor ez az esély (nevezzük kockázatnak) számszerűsíthető - mind az összeakadás valószínűsége, mind a hatása (ie. mennyi időt veszít az ütköző processz). sőt, még hierarchizálni is lehet - mennyi az esélye az ütközésnek 1 szálon, 2 szálon, stb. ebből fel lehet építeni egy modellt, amiből kiesik, hogy mennyi CPU-időt érdemes "feláldozni" a driver számára a beakadások minél nagyobb részének elkerülése érdekében (mert ugye Windows-on 100%-os elkerülésről eleve nem beszélhetünk). ez az engine (és részegységei) toleranciájától legalább annyira függ, mint a szóban forgó drivertől - más szóval, nem törvényszerű, hogy a valamelyik lenti ábrán kisraffozott erőforrás senki számára semmilyen célra nem hozzáférhető.

időzítés tekintetében: vélelmezem, hogy csak az utóbbi időben jutottak el odáig a különféle cégek fejlesztői (és nem feltétlen mindenki), hogy már több magot is odadobnak a drivernek. az biztos, hogy a 2013-as Crysis 3 még úgy tekerte az akkori 2500K-m mind a 4 magját, mint a szél. szóval továbbra is marad nyitva a kérdés, hogy 2007-ben mi más okuk lehetett a fejlesztőknek / kiadóknak az AI hanyagolására, mint a spórolás és / vagy a valós user igények hiánya

amúgy meg lehet nézni a kérdést a másik irányból is - lássuk meg, hogy a low level API-k elterjedése után mennyire fog fejlődni az AI. nagy összegben mernék fogadni, hogy néhány lelkes próbálkozáson túl csak kisebb inkrementális előrelépések lesznek. a fizikára több esélyt látok.

[ Szerkesztve ]

"... and with your wicked wishes we will rise again"

-

igen, tudom, milyen egy sokszázezer / többmillió dolláros méretű szoftverprojekt, vezettem párat

minél komplexebb a történet (márpedig egy 3D motor elég komplex), annál inkább érdemes prototípusokat gyártani az elején, és feltérképezni velük a határokat, legalább nagyságrendi jelleggel. ebből (akár mellékhatásként) kijönnek a DX-problémák is, és ez alapján meg lehet hozni a szükséges döntéseket. de már megint a jelenről beszélünk, és nem 6-7 évvel ezelőttről, amikor ez a probléma még minimális szinten létezett

minél komplexebb a történet (márpedig egy 3D motor elég komplex), annál inkább érdemes prototípusokat gyártani az elején, és feltérképezni velük a határokat, legalább nagyságrendi jelleggel. ebből (akár mellékhatásként) kijönnek a DX-problémák is, és ez alapján meg lehet hozni a szükséges döntéseket. de már megint a jelenről beszélünk, és nem 6-7 évvel ezelőttről, amikor ez a probléma még minimális szinten létezett

engem nem nagyon érdekel, hogy ki mennyit szívott a DX11-es kóddal. tudod, hogy miért? amikor megjelent a DX11, akkor a szakma nagy része ujjongott, a pH!-n minden azzal volt tele, hogy kompjútséder hűdekirály. én akkor annyit fűztem a sztorihoz, hogy szerintem egy félmegoldás ez a lépés, meg kellett volna lépni a már akkor is 10+ éves raszterizációs pipeline lerombolását. most végre megtörténik, aminek nagyon örülök - szóval engem felesleges győzködni, hogy jók az új API-k. hoznak majd nyilván új problémákat, de a jelen modell már iszonyú mocsaras, abból kell lépni valamerre.

AI téren nem érdemes mindig az ügyes exkluzívokkal jönni, mert azok a kivételek. a normának kellene javulni, jelentősen.

@Crytek és @ALONSO11: azt nem értem, mit bírtok ennyit kínlódni az AAA-s helyzeten. olyan mennyiségű k**va jó, alacsony gépigényű játék van PC-re, hogy igazi játékosparadicsom most a platform, szerintem sosem volt ennyire jó a helyzet. inkább játsszatok

"... and with your wicked wishes we will rise again"

-

nagyon jó, hogy a "shader lépcső" kifejeztést használtad - pont ez a legnagyobb baj, hogy egyáltalán létezik ilyen fogalom.

most komolyan azt mondod, hogy a DX12-ben kötelező lesz az eddigi merev pipeline, többek között a 3 lépcsős tesszelátorral?

akkor az minden lesz, csak nem low level. az teljesen logikus lépés, ha opcionálisan megmarad a jelen modell, hogy aki nem akar űrhajót építeni, az az eddigi tudásából dolgozhasson, de ha flexibilitásban annyit sem fog tudni, hogy a "csövet" átkonfiguráld, akkor az nagy lószar lesz, nem előrelépés.

akkor az minden lesz, csak nem low level. az teljesen logikus lépés, ha opcionálisan megmarad a jelen modell, hogy aki nem akar űrhajót építeni, az az eddigi tudásából dolgozhasson, de ha flexibilitásban annyit sem fog tudni, hogy a "csövet" átkonfiguráld, akkor az nagy lószar lesz, nem előrelépés.[ Szerkesztve ]

"... and with your wicked wishes we will rise again"

-

TTomax

nagyúr

Aham,tehát gyakorlatilag nem akarnak fejleszteni,illetve az erre szánt összeg tizedéből akarják megúszni a dolgot,lehet így is csak nem biztos hogy sikerre lehet vinni.Nehogy úgy járjanak mint CPU vonalon,mert akkor nem lesz ami kihúzza őket nullszaldóra.

Fejleszteni mindig van mit,és kell is,ha mást nem akkor a fogyasztásból kell lefaragni,hogy a mobil szegmensben is labdába rúghassanak.Én továbbra sem vagyok meggyőzve arról,hogy nekünk kell a low level api... a dx11-röl is pontosan ezeket olvastuk,meg a 10.1-röl is... én még bőven emlékszem amikor ujjongás övezte a DX-et,mert az mindent támogat,egy szűkülő piacnak minden hiányzik csak a fragmentnáció nem.★★★★★ I got too much soul, rhythm and blues R&B ya see, all that's cool, but hip-hop and rap yeah that's where my heart's at Even back when I used to break on a box ★★★★★ "Chief Rocka"

-

Peat;)

veterán

Abu van valami tervezet mikor adják ki az "új" amd kártyákat? Sima 280-as teljesítmény szintet nézegetem, az nvidia 960 majd kiderül milyen, de elég drága lesz és nem csak az árfolyam miatt. Ha AMD is újít mostanában (nem követtem figyelemmel a terveiket) akkor azt is megvárom, hátha minőségibb kártyák születnek. (sima 280-asra majdnem elcsábultam, de nagyon változó adatokat találtam a fogyasztásra vonatkozóan, az én házam meg elég kicsi hogy ez problémát okozzon)

-

7time

senior tag

Az a szoftveres fejlesztés, amit elindítottak valójában sokkal több pénzt emészt fel, mintha új hardvereket hoznának, de jelen pillanatban úgy látják, hogy ennek van értelme, mert csak így tudnak a fejlesztők hozzányúlni azokhoz a tartalékokhoz, amelyeket ma nem lehet elérni.

Hatalmas hibát követ el az AMD ha erre az útra lép ahogy a HSA -t is várjuk 4 éve és van 1-2 szoftver ami használja de ki tud róla, játék az 1 szem se ahogyan a LOW-LEVEL konzolos szoftverek sincsenek sehol, a Mantle API az nagyon jó de azt is kevesen használják és ígéretekkel tele a padlás de szoftvert senki sem szeret írni, ha most leállítják a hardveres fejlesztést és elkezdik nyomatni ezt a "szoftverből megoldjuk" dolgot akkor a VGA piac is megy a CPU után, nem értem miért nem tanulnak az eddig elkövetett hibákból, ez a titkolózás is láthatnák hogy inkább káros mint hasznos az Nvidia -Intel messzire kikürtöli mi fog következni és a vásárlók várnak rá mert tudják mire számítsanak, nem jó úton halad az AMD

-

stratova

veterán

Abu: Tonga eddig elég pepita felállásban került piacra:

R9 M295X: 2048 SP 128 TMU 32 ROP 850 MHz + 256 bit eff. 5448 MHz 4 GB

R9 285: 1792 SP 112 TMU 64 ROP 918 MHz + 256 bit eff. 5600 MHz 2 GB

(OC kép a helyi tesztből)Firepro W7100: 1792 SP 112 TMU 64 ROP ~920 MHz + 256 bit eff. 5 GHz 8 GB

Tehát a teljes lapka 2048/128/64 256 bit lehet, GTX 960 TI ellen illene az "egészet" bevetni nem?

[ Szerkesztve ]

-

7time

senior tag

azt a célt szolgálja majd, hogy a fejlesztők megtanulják hogyan kell vele bánni. És nagyjából fél évre rá jön az igazi generációváltás, amikor már a programokat optimalizálták az új architektúraverzióra. Ilyenkor az eredetileg kiadott lapkát is fel lehet javítan

De jelenleg a fejlesztőknek évekbe telik (lásd a nextgen) ameddig megtanulnak egy architektúrát hogyan fog ez 6 hónapra csökkenni.

-

daveoff

veterán

Tehát tök mindegy, hogy DX12, vagy Mantle, nagyjából azonos sebességre képesek, a fejlesztő eldönti melyiket válassza, és ennyi. Akkor AMD-nek ez nagy előnye lehet a jövőben, hogy mindkét API-t kezeli. Jól gondolom?

Vagy minden program DX12-es lesz, és a Mantle megmarad opciónak? Vagy lesznek only Mantle programok is.

[ Szerkesztve ]

LG 27GL83A 27'' UltraGear™ QHD IPS 1ms Gaming Monitor with G-Sync®

-

HSM

félisten

"De ha ezt a kódot a GM204-en futtatják, akkor az a Hawaii GPU teljesítményének a felére sem képes, holott ugye DX11-ben nagyjából egymás nyakán vannak."

Biztos, hogy ennek semmi köze a GM204 borzalmasan szűkös 256bites buszához? Én nem zárnám ki, hogy míg DX alatt a radeon nem használja ezt ki pariban vannak, de a további gyorsulásnak már útjában áll a busz... -

-

TTomax

nagyúr

-

-Solt-

veterán

Szerintem azt is érdemes körbejárni, hogy miért szűkül ez a piac... lenne igény a multi gpu-ra, csak annyi vele a szívás, hogy nem éri meg a felárat. Ha megoldanák, hogy a 2. gpu mindig 80% felett skálázódjon, és nem lenne a sok egyéb szívás, akkor nem szűkülne ez a piac, sőt...

www.smart-bus.hu

-

daveoff

veterán

Ezt komolyan nem értem, az EA-nak miért érdeke egy olyan API-ra fejleszteni, amit valószínűleg csak a felhasználók töredéke fog használni. Ennek semmi értelme így, hogy ott a DX12 lehetősége, azzal minden felhasználót elérnek. Nekik úgyis az a lényeg, hogy minél több terméket eladjanak. Ismerjük már az EA-t, ez fontosabb nekik, minthogy technológiai lépéselőnyben legyenek más kiadókkal szemben.

A Mantle jövőjét befolyásolja, hogy a DICE-ból kilépett a Frostbite motor fejlesztő csapata? Ha jól tudom kiváltak, és Frostbite Team néven működnek tovább.

LG 27GL83A 27'' UltraGear™ QHD IPS 1ms Gaming Monitor with G-Sync®

-

Az MS-nek fel kell tennie a kérdést magának, hogy mennyire érdekeltek abban, hogy egy maréknyi felhasználóért egy komoly befektetést igénylő funkciót tervezzenek az API-ba

mitől lenne ez komoly befektetés? lehet az egészet transzparensre csinálni (ha már low level API-ról van szó), a fejlesztő meg oldja meg a balancingot és a szinkronizálást.

"... and with your wicked wishes we will rise again"

-

stratova

veterán

Köszönöm a magyarázatot. Túlzás hogy értem, inkább pedzegetem. De akkor egy Dx tesztben nem kellene profilt váltani, vagy tudom is én

Computerbase DirectX SDK - SubD11 tesztjében (918 MHz: GTX 770, R9 285, R9 290, R9 280) Faktor 12-nél Hawaii-tól átveszi a vezetést Tonga, majd 15-nél ő adja át a stafétát GK104-nek.Ha jól rémlik a Metro címek szeretik ilyen szempontból megfektetni a kártyákat. FHD mellett R9 285 egész szépen állja a sarat (R9 285 min 35 fps vs. R9 290: 37, GTX 970: 36, R9 280X: 34, GTX 770: 33, GTX 960: 31). 1080p felett viszont másutt lehet a szűk keresztmetszet (memória stb).

[ Szerkesztve ]

-

HSM

félisten

Véletlenül sem gondoltam hülyének egyik céget sem.

Csak az AMD stratégiája tetszik, az Nv-é pedig nem.

Csak az AMD stratégiája tetszik, az Nv-é pedig nem.

(#9236) Ghoula: X86 licenszük/processzoruk szerintem nekik sosem volt, csak busz-licenszük, amivel a régebbi Intelekhez tudtak csipszeteket eszkábálni.

Amúgy inkább az ARM/Mobil piac van a háttérben, no meg ezekszerint (thx Abu) a felhő.

[ Szerkesztve ]

-

ez mind nagyon szép, viszont ez a post a partneri stratégiáról beszél, eddig pedig a műszakiról szólt a csevej. a kettő elég jól függetleníthető egymástól - ott találkoznak, hogy mindkettőt az üzleti célokból érdemes levezetni, amúgy nem nagyon. megismétlem - az architektúrában hozott innovatív döntéseket egyelőre semmilyen eredménnyel nem sikerült alátámasztani. sem FPS-ekkel, sem USD-kkel

"... and with your wicked wishes we will rise again"

-

proci985

MODERÁTOR

egy eszrevetel:

amig kitalaljak mi lesz a GTX970el, addig visszaraktam a hd3870et a gepbe, "ez legalabb ad kepet addig is" alapon.

anno emlekszem, hogy csomo jatek gyengen futott alacsony gpu terheles mellett is. tegnap megneztem a supreme commandert, 3840x1080@low mellett 30 fps, kartya 60%ot megy, minden mas limit kizarva, proci kb 75%al erosebb egy szalon mint az akkori csucs qx9770, NB nem foghajta meg (alapproblema volt s775on), mem savszel is kb a negyszerese az akkor platformoknak. igazabol nem tudom mitol van, de anno par jatek csinalta. es kizart, hogy vegyeslimites legyen, mert akkor a GTX970 se mehetett volna 60fpssel (meg elotte a 6950 es a 7850ek).

borderlands 1 tekeri 100%on mondjuk.

szoval R600/670 idoben azert AMDnel is voltak bajok. arrol nem is beszelve, hogy flash videok megint nem mennek rendesen (kb minden masodik driverrel keptelen volt a 3870 normalisan lejatszani oket feketedes nelkul, a 6950/7850/7850CF szinten nem volt erintett). olyan szempontbol mondjuk jo, hogy en voltam az, akinek kb semmi baja nem volt a multimonitor + CF komboval. emlekszem mit szivtunk a driverekkel akkoriban, volt nekem is dualbootom tesztelni a drivert mielott ment az eles rendszerre... hala engek ennek mar vege, erre mar nem lennek hajlando.

--- [es most valasz valami egesz masra

]

]370 biztos nem fogja beerni a 980at. a Maxwell nagyon jol sikerult minden szempontbol*, ha olyan 20% kulonbseg lenne a 370-380-390 kozott az mar kb azt jelentene, hogy a 390 nemi kompromisszummal/FC blokkal es tuninggal egyedul mar eleg lenne 4Kra.

* a 980 egyetlen baja az ara, egyebkent kb minden szempontbol kiegyensulyozott, kerek es bivalyeros kartya. a 970 is zsenialisan jo lenne, ha nem piszkaltak volna meg a crossbart, en meg nem akartam volna 5760x1080ra hasznalni. nem tudom mi lesz jatekokban 1-2 ev mulva, de utobbi 5 evet elnezve nem lehet egyik naprol a masikra atkepezni a programozokat, szoval mire az architekturaja miatt problemas lenne, mar a teljesitmenye is elavult lesz szvsz.

---

btw viszont ha a 390x rahuz 20%ot a GTX980ra hasonlo fogyasztas mellett, akkor az multimonitor / 4kra eleg jol hangzik.

--

innovacios tekintetben egyebkent van bleeding edge es cutting edge. a multimonitor tamogatas pl cutting edge volt, mantlet en inkabb bleeding edgenek ereztem (en pl egy jatekkal nem jatszottam kb egy ev alatt, aminel tudtam volna hasznalni a 7850ekkel).

[ Szerkesztve ]

Don't dream it, be it. // Lagom amount.

-

most akkor olvasd újra a postodat, és mutass rá, hogy mi szerepel benne, ami a GCN műszaki tartalmával kapcsolatos

van a VR, ami még igen távoli, azon felül csak piaci lefedettségről és partner-stratégiáról írsz.

van a VR, ami még igen távoli, azon felül csak piaci lefedettségről és partner-stratégiáról írsz.

leírom még egyszer, mert egyetlen szó cáfolatot nem láttam még rá: az architektúrában hozott innovatív döntéseket egyelőre semmilyen eredménnyel nem sikerült alátámasztani - sem FPS-ekkel, sem USD-kkel.csak hogy on is legyen, ismét hangot adok azon reményemnek, hogy a HBM változtatni fog ezen a trenden.

"... and with your wicked wishes we will rise again"

-

a Mantle-t ugyanúgy meg lehetett volna csinálni a Kepleren is (mint ahogy a DX12-es build már megy is rajta), tehát a Nitrous sztori megintcsak független a műszaki tartalomtól. a többi téma pedig ismét a lesz, lesz, lesz műfaj. én kézzel fogható konkrétumot szeretnék látni (FPS) - ha ilyen lesz, akkor majd jön az USD is

"... and with your wicked wishes we will rise again"

-

... és már át is siklottunk ismét valami másra a HW-ről

amúgy persze, folyamatosság über alles - mondjuk a pontszerűen mért minimum-FPS-ek nem túl reprezentatívak, de azt elhiszem, hogy a SE3 folyékonyabb Mantle alatt. a Thief vszleg mindegy. a Civ-ről korábban már beszéltünk, nekem is tetszik, amit csináltak benne. és ez mind szoftver, amit ugyanúgy lehetne Kepleren / Maxwellen is csinálni.

(#9263) HSM: a tranzisztorsűrűség minimális hatással van a fogyasztásra - még azt sem tartom kizártnak, hogy nem csökkenti, ugyanis szűkebb helyen jelentkezik ugyanaz a hőtermelés. az R9 285 amúgy is rossz példa, mert a fogyasztása siralmas.

Ezt jól látod, én úgy gondolom, hogy a fogyasztás drasztikus csökkentése azonos technológia mellett csak a funkcionalitás megnyirbálásával lehetséges.

akkor sztem jobb, ha abbahagyjuk a témát. with all due respect, ez óriási butaság. pont az előbb soroltam fel pár fajsúlyos dolgot....

Itt az a bibi, hogy az AMD nem elég ehhez.

az volt az alapvető felvetésem, hogy az architektúrás innovációt az AMD nem tudja kézzelfogható előnyre váltani. ezek szerint egyetértünk?

"... and with your wicked wishes we will rise again"

-

namaste

tag

A mobilt ne keverd ide, oda sokkal kisebb belső crossbar kell. K1-ben egy SMX, X1-ben két SMM van (plusz a processzorok, videó dekóder, display driver, egyéb I/O, memóriavezérlő: 2x32 bit).

(#9278) HSM

OK, többet fogyaszt, ha ott van a több DP egység, mintha nem lenne ott. De ez nagyon minimális többletfogyasztás, akkor fogyaszt sokat, ha meg is hajtod azokat.

Össze lehet hasonlítani a 780 és a TITAN játék közbeni fogyasztását a TITAN összes DP-egységének engedélyezése mellett. Mennyivel fogyaszt többet a TITAN bekapcsolt, de nem használt DP számolókkal?

Igen, GTX 780/GK110-re gondoltam. A "többet tud" arra vonatkozik amit Abu a #9233-ban írt, a funkcionális tudásra és nem a nyers erőre (több DP).

Nincs a Maxwellnek HPC változata, még. Lesz majd? Nem tudom.Szerintem nincsenek priorizált adatutak. Semmit se lehet vele nyerni.

-

letepem

aktív tag

Miért optimapizálnak akkor nvre? Miért nem elég, ha csak gcn fut a kód gyorsan és így ellehetetlenítik a vidiát! Miért csak az AMD ekkora jótétlélek, hogy megteszi ezt? Az egyszerű user ígyis-úgyis megvenné a játékot míg aki a tesztet is nézi amd-t vesz.

látok, hallok, érzek és gondolkodom.

-

letepem

aktív tag

Nem azt mondom, hogy gtxen meg se mozduljon, hanem azt, hogy csak alávágják a teljesítményét. Legyen az kihasználtság csökkentése vagy kevesebb optimalizálás. Így 290 széria még partyban lehetne a 980-nal és a közösségi megítélés sem lenne ennyire felemás. (Láttunk már erre példát)

látok, hallok, érzek és gondolkodom.

Új hozzászólás Aktív témák

Hirdetés

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

MIELŐTT LINKELNÉL VAGY KÉRDEZNÉL, MINDIG OLVASS KICSIT VISSZA!!

A topik témája:

Az AMD éppen érkező, vagy jövőbeni új grafikus processzorainak kivesézése, lehetőleg minél inkább szakmai keretek között maradva. Architektúra, esélylatolgatás, érdekességek, spekulációk, stb.

- AMD RX 6700 XT 12GB GDDR6 Reference Eladó! 92.000.-

- Pcie 5.0 ATX 3.0 12Pin - 16Pin Moduláris Tápkábelek És Adapterek 12VHPWR Egyedi Harisnya Nvidia

- BESZÁMÍTÁS! ASUS STRIX GeForce RTX 3090 24GB GDDR6X videokártya garanciával hibátlan működéssel

- (Akár komplett PC-vel is eladó!) AORUS GeForce RTX 4090 MASTER 24G - 3+ év garancia

- Geforce GT 520 1GB Videokártya

Állásajánlatok

Cég: Ozeki Kft

Város: Debrecen

Cég: Ozeki Kft

Város: Debrecen

Pc-n ilyet nem láttam soha pedig egy 2007-es játek (grafikája is f@sza ahhoz képest, hogy 7-8 éves)

Pc-n ilyet nem láttam soha pedig egy 2007-es játek (grafikája is f@sza ahhoz képest, hogy 7-8 éves)

akkor az minden lesz, csak nem low level. az teljesen logikus lépés, ha opcionálisan megmarad a jelen modell, hogy aki nem akar űrhajót építeni, az az eddigi tudásából dolgozhasson, de ha flexibilitásban annyit sem fog tudni, hogy a "csövet" átkonfiguráld, akkor az nagy lószar lesz, nem előrelépés.

akkor az minden lesz, csak nem low level. az teljesen logikus lépés, ha opcionálisan megmarad a jelen modell, hogy aki nem akar űrhajót építeni, az az eddigi tudásából dolgozhasson, de ha flexibilitásban annyit sem fog tudni, hogy a "csövet" átkonfiguráld, akkor az nagy lószar lesz, nem előrelépés.