- Karácsonyfaként világíthat a Thermaltake új CPU-hűtője

- Az USA vizsgálja a RISC-V kínai terjedésének kockázatát

- Kicsit extrémre sikerült a Hyte belépője a készre szerelt vízhűtések világába

- Egészen nagy teljesítményspektrumon fedné le a mobil piacot az AMD

- Kihívás a középkategóriában: teszten a Radeon RX 7600 XT

- Audiokultúra - Hi-Fi-ről hifisen

- AMD K6-III, és minden ami RETRO - Oldschool tuning

- E-book olvasók

- Magyarországra is megérkezik az LG új okosmonitora

- Samsung LCD és LED TV-k

- AMD vs. INTEL vs. NVIDIA

- Milyen notebookot vegyek?

- Azonnali alaplapos kérdések órája

- Modern monitorokra köthető 3dfx Voodoo kártya a fészerből

- Házimozi haladó szinten

Hirdetés

-

Premier előzetesen a Gray Zone Warfare

gp A mai naptól hivatalosan is elrajtol a játék korai kiadása PC-n.

-

Saját Redmi Note 13 Pro+ a világbajnok focicsapatnak (és indiai rajongóiknak)

ma Argentína nemzeti válogatottjának mezével díszítik az új Redmi különkiadást.

-

Karácsonyfaként világíthat a Thermaltake új CPU-hűtője

ph Az ASTRIA 600 ARGB ráadásul a hűtési teljesítmény szempontjából sem szégyenkezhet.

Új hozzászólás Aktív témák

-

Abu85

HÁZIGAZDA

Mi 8x-es élsimítással tesztelünk, ahol ez lehetséges. Ezeknél a kártyáknál már alap, hogy nem 4x-et használunk. Mivel felsőkategóriás termékekről van szó, így minél jobban szeretnénk őket terhelni. A linkelt tesztekben 4xAA-t használtak.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

Majd úgyis újrateszteljük őket jövőre. Lesz még kártya ebben a generációban, és akkor már új drivert is használunk. Most ez volt az elérhető legfrissebb. Valószínű, hogy ott lehet javulás, ahol nagyon gyengén teljesít. pl.: BattleForge.

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

válasz

Alaktomos

#36

üzenetére

Alaktomos

#36

üzenetére

Miért van elírva a fogyasztási adat? Az AMD és az NV ezeket adta meg.

Azt nem tudjuk. Mi sosem szeretünk RC driverrel tesztelni, de ez volt, akkor a legfrissebb. Nem tudtunk más tenni.

Persze, mert más nem 8xAA-val teszteli a kártyákat (gyanítom nem is RC2 driver volt a megjelenés pillanatában). Szerintünk a felsőkategóriában már minimum elvárható, hogy maxra húzzunk mindent, amit lehet. De mond meg, ha nem értesz egyet.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

válasz

DeathAdder

#41

üzenetére

DeathAdder

#41

üzenetére

Mert Full HD felett, vagy extrémebb terhelésnél elfogy. Tekintve, hogy felsőkategóriában van minimum három olyan kártya, aminél ez nem következik be, így nem lehet ajánlani már. Király termék volt, de van már jobb.

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

Mindkettő javítva. köszi.

Hatvan9: Pontosan. Ezért van ott.

Aztán mindenki eldönti, hogy mennyire szereti.

Aztán mindenki eldönti, hogy mennyire szereti.(#44) DeathAdder: Kérdés mennyire csökken az ára. Az ajánlás, vagyis ezesetben nem ajánlás

nagyon függött ettől. Egyszerűen drága, de egy bizonyos szint alatt már nem az.

nagyon függött ettől. Egyszerűen drága, de egy bizonyos szint alatt már nem az.[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

válasz

Alaktomos

#49

üzenetére

Alaktomos

#49

üzenetére

Mert annyit ad meg az AMD a TGP-re, ami a TDP új értelmezése. Valójában az egyik TDP érték sem reális ebben a táblázatban, de ezért van a másik oldalon fogyasztásmérés.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

válasz

Alaktomos

#52

üzenetére

Alaktomos

#52

üzenetére

A táblázatban a hivatalos speckók vannak. Azokon nem szeretnénk változtatni, mert ott lényegében mindig a gyártó értékeit másoljuk át. A lényeg úgyis a mérés. A gyártó, meg felőlünk azt mond, amit akar. Minden eredmény a mért fogyasztással van számolva, szóval a táblázatban az utolsó sor nem jelent semmit. Mindenki alálő a TDP-ben, ha megnézed a fogyasztási tesztet.

Mondjuk az AMD-nél jó lenne érteni, az új mérési metodikát, mert a PowerTune bekavarhat.

Mondjuk az AMD-nél jó lenne érteni, az új mérési metodikát, mert a PowerTune bekavarhat.[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

válasz

[CS]Blade2

#58

üzenetére

[CS]Blade2

#58

üzenetére

Aki így gondolkodik, az nem felsőkateógirás kártyában gondolkodik.

Egyébként nem mindenhol alkalmaztunk 8xAA-t, mert van ahol visszavettük 4x-re. Valamikor a sebesség növelése miatt, és valamikor azért, mert a játék nem engedte a 8x-et mindkét kártyán. Ahol nem jelentett észrevehető sebességcsökkenést a 8x ott beállítottuk.

Egyébként nem mindenhol alkalmaztunk 8xAA-t, mert van ahol visszavettük 4x-re. Valamikor a sebesség növelése miatt, és valamikor azért, mert a játék nem engedte a 8x-et mindkét kártyán. Ahol nem jelentett észrevehető sebességcsökkenést a 8x ott beállítottuk.(#61) DeathAdder: Köszönjük a reklámot a nevükben is.

![;]](//cdn.rios.hu/dl/s/v1.gif)

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

válasz

Kotomicuki

#59

üzenetére

Kotomicuki

#59

üzenetére

Itt először azt kellene definiálni, hogy a jövő játékai milyenek lesznek.

Azt feltételezem, hogy az MSAA teljesen el fog tűnni, vagyis az MLAA teljesítmény lesz a döntő az élsimítás szempontjából.

Azt feltételezem, hogy az MSAA teljesen el fog tűnni, vagyis az MLAA teljesítmény lesz a döntő az élsimítás szempontjából.  A többit nem tudni.

A többit nem tudni.(#63) |nsane: Fuuuuuuuu

Köszi.

Köszi.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

válasz

[CS]Blade2

#65

üzenetére

[CS]Blade2

#65

üzenetére

Nem hiszem, hogy akadozva játszik egy ilyen kártyával.

Ahol engedélyezve volt a 8x, ott ezeknek a termékeknek nem volt téma.

Ahol engedélyezve volt a 8x, ott ezeknek a termékeknek nem volt téma.

(#66) Giot: Bírja az. Láthatod a GTX 580-at. A GTX 570 alól néhol kifogyott a RAM, de amúgy semmi jelentős.

A Sapphire alkalmazta elsőként VGA-knál. Én is úgy tudom.[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

Ez valószínűleg az újrakonfigurált ROP miatt van. A Cayman ebből a szempontból a legfejlettebb rendszer. Nyilván ha valamin újítanak, akkor az kedvező szokott lenni az AA-ra. PErsze messze nem fog ez annyit számítani. A jövőben az MLAA teljesítménye lesz a lényeges, mert az MSAA már szinte alkalmazhatatlan. El kell dobni, mert csak a gond van vele. Valami jobb megoldás kell.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

Egy dolog a driveres megoldás valamire, és egy másik a fejlesztői. A drivernél neked végső képpontjaid vannak, és abból kell dolgoznod. Semmilyen részinformációd nincs, vagyis az eredmény nem lesz tökéletes, de még mindig jobb, mintha nem lenne AA-d. Nem mellesleg az algoritmus bármikor javítható.

A fejlesztői AA támogatás már sokkal jobb. Az AVP-ben tökéletes a hatás. Arra még senki sem panaszkodott. És itt jön képbe az, hogy az algoritmust a motorra szabhatod.

És itt jön képbe az, hogy az algoritmust a motorra szabhatod.

Az MSAA biztos nem marad. Egyrészt már minimum több tucat olyan eljárás van, amin nem működik, másrészt ha tesszellálsz, akkor eljutsz oda, hogy annyi az él, hogy sokat esik a teljesítmény. Az MLAA minden ilyen problémától mentes. Minden felülettel kompatibilis, és nem számít neki, hogy milyen rendered van. Az egyetlen dolog, ami negatív lehet, hogy igényli a nyers számítási teljesítményt. Szerintem az NV ezért is ódzkodik az MLAA driveres implementálásától, mert a Radeonok nyers TFLOPS-ban agyonverik a GeForce-okat, és az MLAA egy piszkosul jól párhuzamosítható eljárás, ahol ez kihasználható.[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

Miért nem szelektálod ki azokat a játékokat, amelyek téged érdekelnek? Nyilván a tesztben a végső konklúzió egy ömlesztett eredmény, de külön ki vannak részletezve a játékok, így te is levonhatod a konzekvenciát.

(#80) |nsane: Ugyan semmi probléma. Nem tudhattad, hogy nem bakiztunk. Főleg azután, hogy ennyire belemerültél a hibakeresésbe.

A Metro 2033 egy brutálisan eltorzult játék a gépigény szempontjából. Nem érdemes vele foglalkozni. Ez az eredménye, ha a fejlesztők szabad kezet adnak a VGA-gyártó programozóinak a gépigény kialakításában. Az említett felbontásnál, már nagyon kell a 2 GB+ VRAM, ami teljesen abszurd dolog szerintem.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

Lesz még Turks és Caicos. Azok lesznek az alsóbb szintekre, és megmarad jó sokáig a Juniper is. 2011 egy nagyon kényes év lesz. Az AMD sem tudja megjósolni, hogy mennyit esnek majd a VGA eladások az integráció miatt. Ezért lesz ennyire sűrű a paletta, mert most még minden kiszámíthatatlan. A gyártópartnerek is fel lettek szólítva, hogy ha nem akarnak "szerencsejátékozni", akkor ott a Brazos Fusion, és mehet az alaplapgyártás. Kis extra invesztálást jelent mindenkinek, de ha nagyon bedőlnek a VGA eladások, akkor az egy fix bevételforrás.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

PowerTune. 4. oldal.

Szerk.: Nem kell aggódni, megoldják. Nézz két HD 6950 CF-et. Az csak 10-15 wattra van a 300 wattos határtól.

(#95) kpetyke: Nálunk más játékok vannak. Például, mi nem tesztelünk UE3-mal, mert minden kártya tud 60 FPS-t. A Far Cry 2 is lecseréltük az Avatarra a modernebb Dunia motor miatt. Továbbá mi a DX9-es játékokat hanyagoljuk, így DX11-seket raktunk a helyükre.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

Az LP2 esetében nem tudjuk, miért fut a Radeon DX11-ben gyorsabban egy GeForce Device ID-vel. Amíg erre nem kapok választ a fejlesztőktől, addig nem szeretnénk ezt boncolgatni.

A lényeget ez a teszt mutatja: [link]

A DX9-nél a Radeon és a GeForce x-et teljesít, míg DX11-ben a GeForce pusztán a váltástól gyorsul, addig a Radeon lassul. A programkód nyilván ugyanaz, mint DX9-ben. Ami érdekes, hpgy a Device ID átírásával a gyorsulás nálam ugyanúgy megvolt, pusztán a DX11 aktiválásától.

Szerintem erre sosem kapok választ, így sosem lesz tesztben a tesztprogram, ami annyira nem gond, mert a játék finoman szólva is fos. Egyjátékos módban végig se lehet vinni, ami szerintem űbergáz kategória egy olyan előd után, mint az Lost Planet.Mivel DX 11-es gyorsítókról van szó, azt szeretnénk tudni, hogy DX11-ben hogyan teljesítenek. Főleg, hogy DX11-re jönnek a játékok. A DX9-ben nem lehet normálisan mérni, mert sok játékban az AA sem aktiválható vagy hibás eredményt ad, illetve a Radeonon van lehetőség MLAA-ra, de a GeForce-on még nincs.

Semmi gond szerintem a 8xAA-val. Amíg a kártyák tudják, és felsőkategóriás kártyákról beszélünk, addig a lehető legnagyobb terhelést szeretnénk rájuk sózni.(#100) Dano58: Pontosan azért mert bugos. Bennem felmerült egyébként, de túl nagy előnye lenne a Radeonnak a 2 GB VRAM miatt. Ráadásul eléggé rétegjáték. A tesztjátékok összeállításánál pár szabályt követünk. Az első és a legfontosabb, hogy legyen minimum DX10-es módja. Ezután ugyanaz a kód fusson mindkét gyártó hardverén. Majd legyen jó játék (értsd jó értékeléseket kapott/kedvelt), vagy egy olyan motort használjon, ami meglehetősen jó adottságokkal rendelkezik, és potenciális licenszelési lehetőség a fejlesztőknek. Mindezt szem előtt tartva próbálunk a stílusokban is mindenki kedvére adni. Egy autóverseny, egy stratégia ...

(#103) kpetyke: Látod, nem is olyan nehéz dönteni, csak számolgatni kell, és egy fontossági sorrend sem árt.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

Már 15 darab DX11-es játék van a piacon, és még hét fejlesztésről tudok, amelyek a következő év első felében esedékesek (legalábbis az előzetes megjelenési dátumok szerint).

Miért ne adna képet a kártyák teljesítményéről? Szinte minden játékstílusból van egy játék a tesztben. Sőt igyekeztünk kedvelt programot választani. A 8xAA meg nem értem miért zavar? Ha a kártyáknak van elég ereje ehhez a módhoz, akkor, miért ne kapcsolnánk be? Mindkét gyártó támogatja az eljárást.

Szubjektív, hogy kinek mi tetszik, de DX11-ből jelenleg a legjobb az F1 2010, személyes véleményem szerint. Jelentős különbség van a DX9 módhoz képest. A játék még nincs benne a tesztben, de valszeg felváltja a Dirt 2-őt, hiszen ugyanaz a motor.

Ha a jövőre vagy kíváncsi, akkor a Deus Ex: Human Revolution nagyon szépen használja a DX11-et, kaptam már belőle pár technikai anyagot.(#109) kenwood3: Mert nem játék.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

válasz

kenwood3

#112

üzenetére

kenwood3

#112

üzenetére

fLeSsel beszéld meg. Ő a 3DMark ellenes.

Én alapvetően nem ellenzem, de nem is támogatom. Ha a 3DMarkot teszteljük, akkor egy játékkal kevesebbre van kapacitás. A játéknak pedig tapasztalataink szerint jobban örülnek az olvasók.

Én alapvetően nem ellenzem, de nem is támogatom. Ha a 3DMarkot teszteljük, akkor egy játékkal kevesebbre van kapacitás. A játéknak pedig tapasztalataink szerint jobban örülnek az olvasók.[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

Én a Dirt 2-ben is láttam a különbséget. A DX9 homályosabb volt, mint a DX11. Nyilván precízebb a post process. A víznél rögtön látszott, hogy mélyebbek a hullámok, továbbá a kocsinak volt önárnyéka. Az F1 2010-ben is látszik. Bár ott inkább teljesebb az érzés. Szebbek a színek, szintén élesebb, és jobb minőségűek az effektek.

Nem tudom mennyi DX9-es játék jelent meg, de úgy gondolom, hogy a jövőt nem a múlt API-jaival kell szemléltetni. Amit viszont bőven látni lehet, hogy a DX9-es játékoknak semmi problémájuk ezekkel a kártyákkal. A Just Cause 2 azért van a tesztben, mert az NV javasolta. Mivel kedvelt és szép játék, mi is javasoltuk magunknak. Lehet, hogy egyszer kikerül, de egyelőre nincs baj vele. Még nem beszéltünk arról, hogy a jövő évi frissítésnél melyik játék megy és melyik jön. A Dirt 2 valószínűleg leváltja az F1 2010, ez ami biztosnak látszik.

Lehet, hogy egyszer kikerül, de egyelőre nincs baj vele. Még nem beszéltünk arról, hogy a jövő évi frissítésnél melyik játék megy és melyik jön. A Dirt 2 valószínűleg leváltja az F1 2010, ez ami biztosnak látszik.Sajnálom, aki még XP-t használ. A Windows 7-re készül el minden friss dolog a gyártói támogatásból. Használhat bárki XP-t, de ne várd el, hogy mi a múltban ragadjunk.

Őszintén gratulálok nekik. Mi a felsőkategóriában továbbra is szeretnénk a VGA-kat leterhelni. Ahol nem jelent terhet a 8xAA ott az lesz. Ahol teher vagy valami akadálya van ott 4xAA van. Láthatod a tesztelt játékoknál. pl.: Crysis, AVP, BF: BC2, mind 4xAA

Mi a felsőkategóriában továbbra is szeretnénk a VGA-kat leterhelni. Ahol nem jelent terhet a 8xAA ott az lesz. Ahol teher vagy valami akadálya van ott 4xAA van. Láthatod a tesztelt játékoknál. pl.: Crysis, AVP, BF: BC2, mind 4xAA[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

A jelen a Windows 7, és a technológiai újítások. Használja 15 darab játék a DX11-et, és még hét biztosan készül. Arról sajnos nem tudok, hogy az NV mennyit készít, de ők is hozhatnak új DX11-es címeket. De a kedvedért, ha lesz valami olyan DX9-es játék, ami tényleg megterhelő, akkor berakjuk.

Igen ezek a kártyák már szeretik a memória-sávszélességet. Ezért is van melléjük rakva 5+ GHz-es GDDR5.

Mivel a PowerTune alatt bármilyen valós idejű fojtást beállíthat az AMD, így nem kell törekedni a letiltásokra. A TSMC kihozatala már nagyon jó, alig van hibás chip a 40 nm-es node-on. Az NV is teljes lapkát hoz ki az óriási GF110-ből. Az órajel is lényegtelen belőhetik 900 MHz-re, aztán majd a PowerTune oda állítja, ahol jó. Ez abból a szempontból előny, hogy ha nem működik a CF, akkor megadható a kártyának, hogy az egyik GPU tekerjen, és akkor aztán adjon bele mindent 900 MHz-cel.

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

Sajna ez van. Én sem örülök neki, de folyamatosan csak baj van az MSAA-val. Eddig foltozgattuk, így eljutottunk a DX11-ig, de most újabb gondok vannak, így radikális változás kell. Az MLAA mellett van még számos opció. Nem én fogok dönteni, de szerintem az analitikus és a morfológikus algoritmus közül kerül ki a győztes. Az előbbi gyorsabb, míg az utóbbi jobb képminőséget ad. Mindkettő mellett hatalmas pro, hogy minden felületen működnek kivétel nélkül.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

Passz. Nem én teszteltem. Csak az elméleti részt írtam.

Őszintén megmondom nem kérdeztem utána.

Igazából nálunk nincs is sok értelme, mert 50k fölött egy kézen lehet számolni a heti eladásokat.

Igazából nálunk nincs is sok értelme, mert 50k fölött egy kézen lehet számolni a heti eladásokat.

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

válasz

goodboy007

#148

üzenetére

goodboy007

#148

üzenetére

A GTA4-et nem lehet beállítani. Nem tudok olyan parancsról, ami az automatikus skálázást kiütné a motorból. Így lényegében minden kártyán más lenne a részletesség. Minél több a memória, annál nagyobbak a texture map méretek.

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

A 8xAA-t főleg azért használjuk, mert a kártyák bírják, és a különbség is kimutatható. De ha megnézed a tesztet nem minden ment 8xAA-val, csak azok a játékok, ahol ez nem jelent problémát, vagy érzékelhető sebességvesztést.

8xAA-val ment az Avatar, a Dirt2, a JC2, a BattleForge és a HAWX. A többi játéknál 4xAA volt, míg a Metronál analitikus AA. A 8xAA-t csak akkor aktiváljuk, amikor már tényleg a fellegekben vannak az FPS-ek, mert terhelni szeretnénk a felsőkategóriás termékeket.

Ilyen árazású termékeknél ezen nem szeretnénk változtatni, mert meggyőződésünk, hogy a 80 és a 100 FPS közötti különbség nem tényező, így a terhelésre megyünk rá.[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

válasz

goodboy007

#229

üzenetére

goodboy007

#229

üzenetére

A motor elméleti működése alapján igen. Ráadásul a felbontás növelése is dinamikusan állítja például az Environment map méretét.

Én értem, hogy a Rockstar mit akart, és isten látja lelkem valahol még egyet is értek vele, csak ez így teljesen alkalmatlan játékot eredményez a tesztelés szempontjából, mert nem ugyanaz a grafika, még akkor sem, ha a csúszkák ugyanott vannak.Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

válasz

planbmokus

#243

üzenetére

planbmokus

#243

üzenetére

Valójában nem csalják le a dolgokat a Fermis kártyák, csak nem tesztelték rajtuk a játékot. A fejlesztők mondták, hogy hibás a megjelenítés a Fermin bizonyos beállítások mellett, de elismerték, hogy ez nem az NVIDIA sara. A gond, hogy nem foglalkozik az 1C a javítással, így ilyen marad. Nem hiszem, amúgy hogy sokat dobna a részletesebb textúra a Radeonokon. A számítás ugyanannyi. Az persze kétségtelen, hogy a Metro 2033 csak DX11-es Radeonon jelenít meg mindent.

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

Arra gondoltál már, hogy írsz az Apple-nek, hogy problémád van? Mert az AMD nem sokat tehet érted, hiszen az Apple a géped beszállítója. Ők adják ki a termékhez a drivert.

Ha az AMD gyári támogatását akarod élvezni, akkor PC-t kell venned.Nem kell ennyire kétségbe esni az AMD üzletpolitikájától. Attól, hogy idén első helyre törtek fel a VGA-eladásokban, még nem fog az NV tönkremenni. A Tegra 2 sok nyereséget fog termelni. Persze később dönthetnek úgy, hogy dobják a PC-t, mert a Tegra ellátja azt a feladatot, amit a GeForce, de ez legalább egy évig nem fog megtörténni, mert a Tegra üzletből legalább 600-700 millió dolláros bevételt kell elérni. Ehhez idő kell.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

Ezért mondtam, hogy írj az Apple-nek, mert a gondod megoldható, csak fel kell hívni rá az érintett cég figyelmét.

Megy a HD3D az AMD-nél. Fel kell rakni az egyik kezelőszoftvert. Vagy az iZ3D-t, vagy a DDD-t. Mivel filmezni akar DLP-vel, így javaslom az iZ3D megvásárlását. Azt nem tudom, hogy a lejátszóprogramok mennyire vannak a DLP projektorokra felkészítve, de elvileg mennie kell, ha benne van a programban a megfelelő funkció. Persze azt jó lenne tudni, hogy az a projektor, amit vásárolt zárt-e. Ha van rajta HDMI 1.4a-es vagy DisplayPort 1.2-es port, akkor vinnie kell a 3D-t, mivel a keretrendszer a driverben adott, ez működik is. Ellenkező esetben olyan projektort kell venni, amin a fenti két port egyike megtalálható. Feltételezve persze, hogy a kártya kezeli a HDMI 1.4-et és a Displayport 1.2-t, mert ez sem derült ki. Így nehéz rájönni a probléma forrására.

Nem. Az Apple nem vásárol drivert az AMD-től. Saját meghajtókat készítenek. Csak a rutinokat veszik át, de minden más saját, a vezérlőpulttól kezdve, a monitorkezelésig. Ez az NV-nél is így volt. Például az Apple nem is kérte az Optimust sem, mert saját megoldást fejlesztettek helyette. Az AMD így nem tudja megoldani a gondod, mert nem támogathatja az Apple rendszereit natívan. Ezért nincs külön letölthető driver az Apple gépeihez az AMD weboldalán. Mindent az Apple vállal. Persze nyilván ez nem gond. A gyártó egyéni döntése, hogy milyen terméktámogatási formát választ. Tekintve, hogy az AMD számára az Apple az ügyfél, így minden úgy van, ahogy az Apple akarja.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

válasz

schwartz

#282

üzenetére

schwartz

#282

üzenetére

Ez már presztízskérdés. Itt a bank nem segít. A VGA-piac, amúgy sem a magas haszonkulcsról híres. Már a noti GPU-kon sincs valami nagyon komoly nyereség. Az IGP az ami egy kegyetlenül zsíros terület. Nyergel is mindenki a rendszerszintű integráció felé.

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

Nem. A CCC-ben egy keretprogram van, ami aktiválható egy vezérlő segítségével. Ez lényegében a Quad Buffer driver, semmi más. Ezt tudja aktiválni az iZ3D, a DDD vagy ha van támogatás, akkor a lejátszóprogram (a Cyberlink szoftvereknek biztos van támogatása, a többit nem tudom, de nyilván ők sem akarnak lemaradni, így kell lennie támogatásnak).

Az NV-nél a keretprogramot és a vezérlőt is megkapod a driverrel, de a vezérlő csak akkor működik, ha megveszed a 3D Vision csomagot, amiben van egy szemcsi (asszem vannak már több szemüveges TV-s kiszerelések). A 3D Vision más szemüveggel nem is működik, csak az NVIDIA sajátjával.

Lényegében a két dolog ugyanaz. Az NV-nél a szemüvegnél kérik el a pénzt, míg az AMD-nél bármilyen szemüveg jó, de a vezérlőprogramért fizetni kell.Az AMD egy PC-s gyártó. Az Apple pedig egy ügyfél. Majd, ha az Apple javítani akar a driveren, akkor javít. Az AMD számára annyi a lényeges, hogy a szerződés rájuk eső részét biztosítsa, vagyis legyen készlet az Apple gépekhez, és a rutinokon végrehajtott fejlesztéseket leadják. Az innentől kezdve teljesen az Apple reszortja. Aki az AMD-től akar közvetlen terméktámogatást vegyen PC-t.

Nem értem miért kevesebb. A GeForce-ok pont azért lettek az Apple kínálatából kirakva, mert nem volt megfelelő a cég hozzáállása. Megpróbálhatod ezt megmagyarázni, de a tények magukért beszélnek. Vásárolj egy új Mac Prót vagy egy új iMac-et GeForce-szal, ha tudsz.

Na ugye, hogy nincs. Innentől kezdve miről beszélünk?

Na ugye, hogy nincs. Innentől kezdve miről beszélünk?

Kész van a HD3D szolgáltatása is. Megy minden HDMI 1.4-et vagy DisplayPort 1.2-őt ismerő Radeonon és megjelenítőn. Még extra szemüveg sem kell hozzá. Kérdezd meg az ismerősöd, hogy a fenti portokat támogatja-e a kártyája, vagy a projektora?

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

Pipálni sem kell. Fel kell rakni a drivert (ez gondolom megvan), és a megfelelő programot ... például a PowerDVD10 biztosan tud 3D-s Blu-ray filmet kezelni. Innentől kezdve a program érzékeli a Quad Buffer drivert, és megy. Ami levághatja a tartalmat az a megfelelő csatlakozó hiánya. A film működni fog, de a HDMI 1.4 vagy a DisplayPort 1.2 hiánya miatt nem lesz 3D-s, mert a védett tartalom csak a megfelelő DRM-et tartalmazó csatin megy át.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

Ennyire van kalibrálva a rendszer. Ha nem szeretnéd, hogy ennyin menjen, akkor ott a PowerTune. -10%-on szinte nem látható a lassulás.

Nyilván a GTX 480 300 wattot fogyasztott, nagyon hangos volt, és alig volt mögötte teljesítmény. Nézd meg a GTX 580-at. Ugyanannyit fogyaszt, de már kisebb a hangja, és nagyobb a teljesítménye. Senki sem károg.

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

Ilyen tartalom. [link]

A 3D Blu-ray csak HDMI 1.4-en megy át, mert a HDMI 1.4 tartalmazza a 3D szabványokat.A GeForce-hoz is kell HDMI 1.4. HDMI 1.3-on csak akkor megy át a Blu-ray film 3D-ben, ha a TV támogatja a HDMI 1.4-et, és kezeli a 3D Visiont. Ha az egyik feltétel nem teljesül, akkor a HDMI 1.3-as GeForce-on sincs 3D.

(#295) dezz: Jap. A vezérlőnek kell támogatnia. Ezért nem megy a 3D-s Blu-ray HDMI 1.3-on. A HDMI 1.4 kell ehhez, még akkor is, ha ez egy szoftveres beavatkozás. Ezen van a vita, hogy priti szerint erre nincs szükség.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

Aki nem szereti a 90 fokos GPU-t, az eleve nem vesz felsőkategóriás kártyát. Nyilván ez felhasználói döntés kérdése. Természetesen lehet a jobb fogyasztás/teljesítmény mutató mellett is voksolni, erre is választ ad a cikk.

(#299) priti: Ez egy másik előnye a HDMI 1.4-nek. De ettől HDMI 1.4 alatt te nem fogsz 3D-s Blu-ray filmet nézni. Ezen nem tudsz változtatni. Lehet rá mondani, hogy marketingfogás, de ez van.

Nyilván kellett egy szabványosítás a 3D-s tartalmakhoz, amit a HDMI 1.4 biztosít, hiszen egy ilyen csatival szerelt kártya és TV vagy megjelenítő biztos, hogy üzemképes lesz.

Nyilván kellett egy szabványosítás a 3D-s tartalmakhoz, amit a HDMI 1.4 biztosít, hiszen egy ilyen csatival szerelt kártya és TV vagy megjelenítő biztos, hogy üzemképes lesz.[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

Én csúsztatok. Jelen esetben én hoztam hivatalos mérést egy neves oldalról.

Miközben te dobálod a számokat, úgy hogy HD 6970-ed sem volt még. Ennyire ne érvelj jól, mert nem tudom hova tenni, az általad közölt nagy mennyiségű tényhalmazt.

Miközben te dobálod a számokat, úgy hogy HD 6970-ed sem volt még. Ennyire ne érvelj jól, mert nem tudom hova tenni, az általad közölt nagy mennyiségű tényhalmazt.

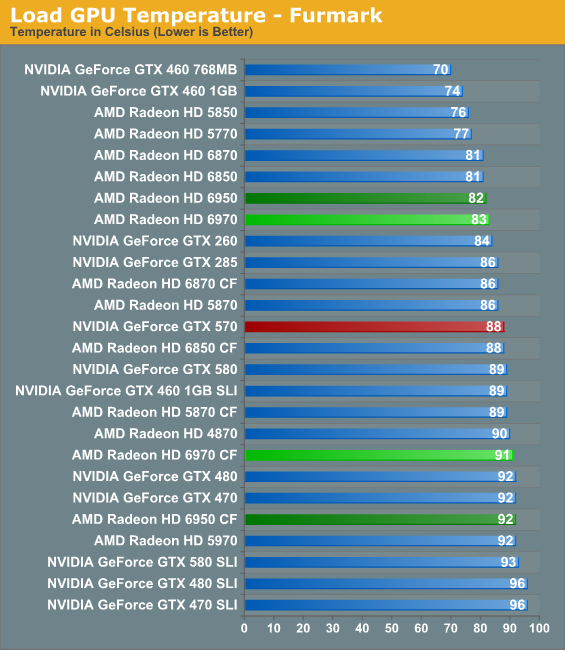

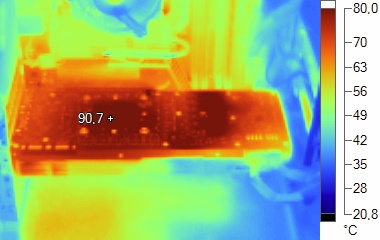

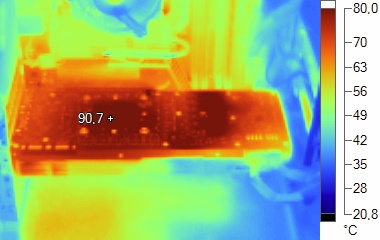

Hoztam hőtérképes anyagot. Ez a legjobb ebből a szempontból, mert tökéletesen mutatja, hogy melyik kártya melegszik jobban.

Mérést valszeg szoftveresen csinálják az említett oldalak. Ez nem szoftveres.

Mérést valszeg szoftveresen csinálják az említett oldalak. Ez nem szoftveres.

GeForce GTX 580:

Radeon HD 6970:

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

A rip nem egyenlő a 3D Blu-ray-jel.

Azt minden hardver tudja. A 3D Blu-ray-hez viszont mindenképpen HDMI 1.4 kell. Más dolgokhoz elég a korábbi HDMI is, csak figyelni kell, hogy a HDMI 1.4-es megjelenítő támogassa azt a tartalmat, amit a VGA továbbít.

Azt minden hardver tudja. A 3D Blu-ray-hez viszont mindenképpen HDMI 1.4 kell. Más dolgokhoz elég a korábbi HDMI is, csak figyelni kell, hogy a HDMI 1.4-es megjelenítő támogassa azt a tartalmat, amit a VGA továbbít.Az NV-nél is HDMI 1.4 kell a biztos Blu-ray 3D-hez. A HDMI 1.3 csak akkor elég, ha a megjelnítő HDMI 1.4-es és támogatja a 3D Vision szabványt. Ha az egyik feltétel nem igaz, akkor a 3D-s Blu-ray nem jeleníthető meg.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

A VRM jól tenné, ha nem menne 100 fok főlé, mert a szilícium még kibír 150 fokot, de a VRM és a nyák már nem. Bár a HD 6970 annyiban kedvezőbb, hogy digitális PWM-je van, ami látható a hőtérképről, hogy alig melegszik. [link]

(#312) Oliverda: Hülye deeplink védelem. Most már jó.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

Persze, hogy nem. Ezért van a hővédelem 110-120 foknál meghúzva. Azt még biztonságban túlélik a termékek. Bár az AMD kártyáiban ez a védelem sosem aktiválódhat, mert a PowerTune és a belső túlterhelésvédelem valós időben kezeli az órajelet, vagyis a kártyát lehetetlen a magas hőmérséklet miatt kifagyasztani.

Forrás: [link] A szenzoros mérés szart sem ér, mert az egy szoftveres mérés. Ezért nincs a tesztjeinkben hőmérsékletes összehasonlítás, mert nincs megfelelő hardverünk erre. A szenzoros érték pedig még egyazon kártyáknál is tévedhet +/-20 fokot.

Éppen a szomszédnak van ilyen GTX 460-ja. Mérés szerint 45 fok terhelve, de olyan forró, hogy hozzá nem lehet érni. Idle-ben 15-20 fok a GPU (25 fokos szobahőmérsékleten).![;]](//cdn.rios.hu/dl/s/v1.gif) BIOS-ban lehet korrigálni ezt, de a hardveres védelem úgy sem a szoftveres mérésből dolgozik, így a probléma csak esztétikai kellemetlenség. A hardver tökéletesen működik ettől.

BIOS-ban lehet korrigálni ezt, de a hardveres védelem úgy sem a szoftveres mérésből dolgozik, így a probléma csak esztétikai kellemetlenség. A hardver tökéletesen működik ettől.[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Új hozzászólás Aktív témák

ph Az AMD Radeon HD 6950 és a HD 6970 tette tiszteletét nálunk.

- Súlyos adatvédelmi botrányba kerülhet a ChatGPT az EU-ban

- Audiokultúra - Hi-Fi-ről hifisen

- LEGO klub

- Megjelentek az első HMD okostelefonok, ezek a magyar áraik

- Helldivers 2 (PC, PS5)

- Politika

- D1Rect: Nagy "hülyétkapokazapróktól" topik

- Ukrajnai háború

- gban: Ingyen kellene, de tegnapra

- AMD K6-III, és minden ami RETRO - Oldschool tuning

- További aktív témák...

nagyon függött ettől. Egyszerűen drága, de egy bizonyos szint alatt már nem az.

nagyon függött ettől. Egyszerűen drága, de egy bizonyos szint alatt már nem az. Mondjuk az AMD-nél jó lenne érteni, az új mérési metodikát, mert a PowerTune bekavarhat.

Mondjuk az AMD-nél jó lenne érteni, az új mérési metodikát, mert a PowerTune bekavarhat.

![;]](http://cdn.rios.hu/dl/s/v1.gif)