- AMD Ryzen 9 / 7 / 5 / 3 3***(X) "Zen 2" (AM4)

- Milyen billentyűzetet vegyek?

- Vezetékes FÜLhallgatók

- Léghűtés topik

- Érkezik Magyarországa az LG szuper dizájnos hordozható projektora

- AMD K6-III, és minden ami RETRO - Oldschool tuning

- Így építsd a billentyűzeted!

- Házimozi belépő szinten

- Milyen egeret válasszak?

- Hobby elektronika

Hirdetés

-

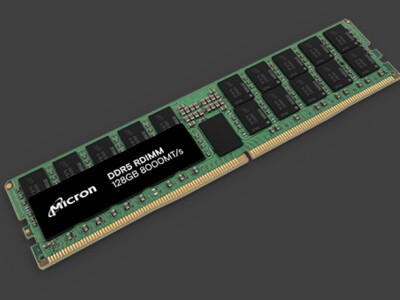

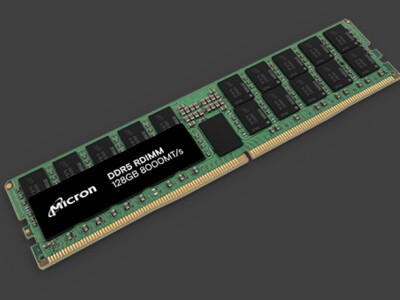

Alacsony fogyasztású, 128 GB-os szervermemóriát kínál a Micron

ph Az új RDIMM TSV technológia alkalmazása nélkül éri el a címben említett tárkapacitást.

-

Free Play Days 2024 - 18. hét: Headbangers: Rythm Royale

gp Extraként a Star Wars Jedi: Survort is kipróbálhatjuk 5 óra erejéig.

-

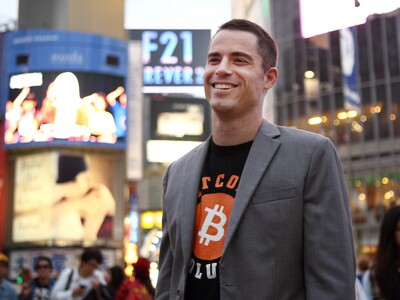

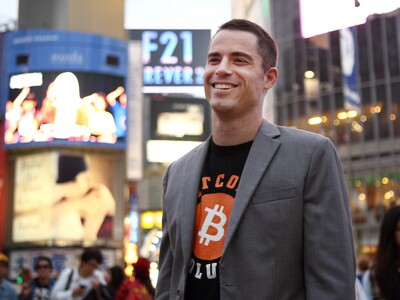

Letartóztatták a bitcoin-Jézust

it Amerikai adókerülés vádjával, Spanyolországban tartóztatták le a bitcoin-Jézusként ismert Roger Vert.

Új hozzászólás Aktív témák

-

Cassi

senior tag

Jónak tűnik, nekem biztosan ez lesz. Elfogadható upgrade 3060 Ti után.

-

GAbre

veterán

Gondolom akkor 2db 8as pin-t raknak rá.

Reméljük ehhez is adnak játékot,azért 230-250ezertől már nem lesz rossz az ára,+ajándék game-el.

Főleg,hogy a használt 3080ak mennek majdnem ennyibe most.

Gyanús nekem ez.3000es széria megjelenésénél voltak olcsók az nvidia kártyák.Aztán úgy lett,ahogy lett. :S

Azért méretben még érdekelne,ezt is túltolják-e,és alig fér el kis házakban,vagy visszafogottabb méretet kap?[ Szerkesztve ]

Avatar

-

GeryFlash

veterán

Ez kvazi az ami regen a x60 kesobb az x60 Ti volt. Nem lenne ezzel baj ha nem 600 dollarba kerulne. De meg igy is inkabb mint a 4070Ti ami VRAM limites.

Erdemes lett volna tajekoztato jeleggel beleirni a cikkbe, hogy teljesitmenyre hova varhato, konkretan egy 3070Ti + 5% de a 3080 alatt. Ennyit ugye arrol hogy majd az Ada minden generacioja kb 90-100%kal lesz gyorsabb az elodnel. Itt latunk egy komoly 10-15% gyorsulast a 3070hez kepest, de oruljunk mert a tularazott 3070-hez kepest csak 100 dollarral nott az ara

Vicc, de hat az AMD se tud egyertelmuen jobb (RT perfomance) alternativat felmutatni az uj generacioval.

Nagyon bizom benne hogy a kovetkezo negeydevekben meg nagyobb eseseket fogunk latni VGA eladasok szamaban, mert szanalom ami megy. Az a baj hogy az AI orulet miatt tokmind1, potolva lesz a kieso gaming bevetel. Marmint az Nvidianal, AMD gyorsitot kb senki nem vesz.Hi, i'm new to APHEX TWIN, so i was wondering how much the IQ requirements was to enjoy his stuff. and understand all the underlying themes, because its really complex stuff. I have IQ of 119 but i heard that you need atleast 120 is it true?

-

1440p-ben a 3080 teljesítményét tudja TPU és HUB tesztek alapján.

6800xt érdekes lehet, mert ez is ezen a szinten van és már kapható 250-260-ért (és ennek megfelelően aprón egész szépen lemennek az árak).

Ez annyi mint a 600 dolcsi x forint x áfa.[ Szerkesztve ]

-

CptAdamica

veterán

Ahogy várható volt a 4070Ti után egy vicc a maga 21%-os javulásával 1440p-ben egy 3070-hez képest 600 dollárért, ami itthon simán lesz 300 ezer környékén.

[ Szerkesztve ]

Megyen!

-

Alogonomus

őstag

Na ez akár nagy volumenben eladott Lovelace kártya is lehet majd a boltokban, mert az AMD oldaláról a Navi 32 valószínűleg még több hónap múlva érkezik csak, a korábbi sorozatok hasonló teljesítményű kártyái pedig sokkal nagyobb fogyasztásból hozzák ugyanezt a teljesítményt.

-

GeryFlash

veterán

Az a 4070Ti ellenfele, teljesitmenyben es arban is.

Hi, i'm new to APHEX TWIN, so i was wondering how much the IQ requirements was to enjoy his stuff. and understand all the underlying themes, because its really complex stuff. I have IQ of 119 but i heard that you need atleast 120 is it true?

-

UMbikes

csendes tag

660 eur az eu-s msrp ami valahol 250000 környéke. Namost aprón kicsit többért kapsz 3090-et 24gb vrammal, és kb 10%al több teljestménnyel. (csak jelezném hogy mostanában a friss címek valahogy nem igazán érik be 1440p-n 12gb vrammal...) Meg oké, 200w helyett 350w fogyasztással. Ennyiért határozottan nem éri meg, ha ilyen ársávban gondolkoznék kártyán simán vállalnám a nagyobb étvágyat, meg a rizikót a használt állapotra.

Az emberi hülyeség határtalan... De ha megfigyelő vagy egész szórakoztató.

-

D55

aktív tag

Nincsenek hardveres akadályai, a 30-as szériában is van OFA. Annyi van csak, hogy állítólag a 30-as szérián nem lenne eléggé hatékony, ennyi amit hivatalosan eddig nyilatkoztak. Viszont pont azért kell, hogy megkapjuk minél hamarabb, mert úgy akkor lenyugszanak a kedélyek (ahogyan az RT-t is odaadták annak idején olyan kártyákra, amiknél viszont tényleg "hardveres akadályai" lettek volna, mégis megoldották, hogy senki se hitetlenkedjen). Ha mégsem kapjuk meg végül, az viszont akkor ennek a logikának mentén felér egy beismeréssel, hogy szándékos avultatás, mert ezúttal nem merik odaadni, hogy a saját szemünkkel láthassuk, hogy mi a helyzet. Még nyár végéig húzhatják kb. az időt ezzel, vagy legrosszabb esetben az 5000-es széria bemutatkozásáig. Ha addig sem lépnek, annak már következményei lesznek tekintve a 3000-es széria piaci pályafutását, beleértve a

speku...bányászós-chiphiányos árazásos időszakot. -

IgorKGB

csendes tag

az intel arc 770 jobb választás ennél, nagyobb a memória 16 GB, a sávszélesség ugyanannyi 500 GB/sec

az ára meg a fele -

Ed3r_X_

nagyúr

Hát nem tudom, szép és jó, de sokkal inkább mozgatná a fantáziám egy RTX 4050 Ti, vagy 4060..

“Songbird, Songbird, see him fly, drop the children from the sky. When the young ones misbehave, escorts children to their grave. Never back-talk, never lie, or he'll drop you from the sky!”

-

Ed3r_X_

nagyúr

Fogyasztásra leszek kíváncsi, egy 4050 kalibernek jó lenne 120W köré beférnie. Na meg hogy valóban 96 bit lesz az asztali is..

“Songbird, Songbird, see him fly, drop the children from the sky. When the young ones misbehave, escorts children to their grave. Never back-talk, never lie, or he'll drop you from the sky!”

-

adr0001

tag

A, és konkrétan A DLSS 3 frame gen nem megy csak a korábbi vasakon. Mivel egy niche cuccról van szó nem mindenkinek tiszta hogy OpenCL/CUDA-ból is simán megy, sőt CPU-ból is, és manapság nevetséges hardverigénnyel. Meglévő képinformációk copy-paste-jénél sokkal többet ez sem csinál az artifactok alapján.

Már leírtam párszor, leírom ide is

A "nem megy", az egy ordas kamu,

és mesterséges avultatás a neve."If you think [***]* was a Grade A asshole liar, wait 'til you get gaslit by a mainframe"

-

GeryFlash

veterán

Az ne zavarjon hogy az Arc 770 egy kb 3060/3060TI szintu kartya ez meg egy 3080 kb, tehat korbehugyozza az Inteles csodat. Mondjuk az teny hogy a 70%-kal kisebb teljesitmeny ellenere az Intel meg tobbet is fogyaszt.

DE LEGALABB 16GB VRAM

Hi, i'm new to APHEX TWIN, so i was wondering how much the IQ requirements was to enjoy his stuff. and understand all the underlying themes, because its really complex stuff. I have IQ of 119 but i heard that you need atleast 120 is it true?

-

mindhunter

csendes tag

Ez a DLSS 3.0 mekkora jó már. Nekem 4070Ti van, és 4K-ban játszom. Pl. Cyberpunk 2077 igencsak megfingatja a kártyát 4K natívban, átlépem a 12GB-os vram határt, meg kb 20-24 fps-t produkál. DLSS 3.0-val meg csinálok 80-100 fps közt, és a memóriahasználat is beesik 10 GB-ra.

[ Szerkesztve ]

-

pandras83

senior tag

válasz

mindhunter

#25

üzenetére

mindhunter

#25

üzenetére

és az input lagot/latency-t megoldja az nvidia reflex?

[ Szerkesztve ]

Cyberfuck Patchrunner

-

GAbre

veterán

válasz

mindhunter

#27

üzenetére

mindhunter

#27

üzenetére

Mi köze a reflexnek a lagghoz,meg esetleg anomáliákhoz?

Alapba nem vészes,főleg,hogy nem is tudok fps multi játékról,amibe berakták volna dlss3.0-át,hogy fontos lenne ott a reflex szükségessége,mert olyan laggja van,hogy az zavarja az embert.

De lehet csak én nem vettem észre.

Azt értem,hogy jó dolog,ezért mondtam,hogy ha 3080at el tudja érni,akkor jó vétel lehet kb.

Leszámítva gondolom olcsóbb amd kártyákat,nem tudom,nem nézek árakat seAvatar

-

Semplar

őstag

Mindenki nyugodjon le a pincébe!

Drágább lesz, mint a 4090.![;]](//cdn.rios.hu/dl/s/v1.gif)

“Don’t worry, nothing gets away here, the place belongs to the Mafia.”

-

pandras83

senior tag

"Compared to last generation's RTX 3070, the performance uplift is 27%—a relatively small gen-over-gen gain (RTX 3090 V 4090: +64%, RTX 3080 V 4080: +49%, RTX 3070ti V 4070 Ti: +44%)."

forrásJensen papa és a részvényesek közben

Cyberfuck Patchrunner

-

Kansas

addikt

Input laghoz óriási. Kb minden - arra van kitalálva, hogy azt javítsa.

Mert ahogy fent is látod, hiába told be kamu képkockákat, nem lesz olyan reszponzív tőle a játék mintha azok valódi képkockák lennének, de cserébe artifaktol mint állat, ha nincs meg a kellő natív fps. Igazából, ha megvan, akkor is, csak akkor jelentősen kevésbé venni észre, mert az artifaktos kamu képkockák rövidebb ideig látszanak.

Kompetitív FPS-be nem véletlenül nem teszik be a framegen-t, erősen ellenjavallott.Nincs olyan MI, ami képes lenne szimulálni az emberi hülyeséget... ha valaha lesz, annak tuti az emberi hülyeség lesz az oka... A Föld erőforrásai közül a legjobban az ész van elosztva - mindenki meg van róla győződve, hogy több jutott neki, mint másoknak.

-

D55

aktív tag

"Kompetitív FPS-be nem véletlenül nem teszik be a framegen-t, erősen ellenjavallott."

Így van, minek is még az oda pluszba, amikor pl. a Source engine eleve spekulatív interpolációt használ a player modellek kliensoldali pozícionálásához

És más engine / netcode működésébe ilyen mélységekben nem ástam bele magam, de gondolom nem is egyedi megoldás... -

Kansas

addikt

"a Source engine eleve spekulatív interpolációt használ a player modellek kliensoldali pozícionálásához"

Na frankó, ezt nem is tudtam... akkor ez már egészségtelen halmozása az "élvezeteknek"Bár akármi ami tud DLSS3 framegen-t, aligha kerül olyan helyzetbe hogy nem jön ki belőle 500+ fps... azért a Source nem kifejezetten igényli a 4000-es RTX-eken a DLSS-t... itt inkább az UE4-UE5 ami érdekesebb framegen szempontjából...

[ Szerkesztve ]

Nincs olyan MI, ami képes lenne szimulálni az emberi hülyeséget... ha valaha lesz, annak tuti az emberi hülyeség lesz az oka... A Föld erőforrásai közül a legjobban az ész van elosztva - mindenki meg van róla győződve, hogy több jutott neki, mint másoknak.

-

Prof

addikt

Brillians az Ngreedia marketing osztalya.

A kivaloan sikerult 1000-es sorozat utan kitalaltak, hogy eladjak a sok banyasz ,AI jomunkas kartya selejtet jatekoskartyanak RTX-kent.

A birkak raharaptak a jatekok 1%-anal se mukodo RT, DLSS "funkciora". A compute kartyakan meg degeszre keresik magukat a Bitcoin es AI marketingnek koszonhetoen.Majd latvan, hogy rengeteg penzert is veszik oket kitalatak eltoljak a termekpalettat, szamozast generaciokon keresztul a Super/Ti taget bevezetve. Igy mara megkaptuk a 4070-et ami valojaban a 4060

es meg a sok nagyokos mediapartner is dicseri milyen jo aron van 600 dollarert, amiert par eve top VGA-t adtak

es meg a sok nagyokos mediapartner is dicseri milyen jo aron van 600 dollarert, amiert par eve top VGA-t adtak

Ennek koszonhetoen aki Nvidia reszvenyt vett fele eve az megduplazta a penzet

Aki meg az RTX megjelenes elott vett 2018-ban es 3 ev mulva eladta az megtizszerezte

Mindezt egy olyan kornyzeteben ahol a mobil / konzol allitolag tonkreteszi a PC piacot

Jensen egy zseni.

Jensen egy zseni.

-

GeryFlash

veterán

Ezzel szemben az AMD-nek olyan remek ajanlatai vannak... Ja varjal

Vicces ezzel jonni hogy szemet Ngreedia, csak tudod amig a masik is ugyanoda araz addig teljesen invalid ez a frocsogesed, vagy erdemes lenne leirnod az AMD-vel is. 7900XT-nek nevezett 6800XT. Mindket ceg elmehetne a p*csaba.

Vicces ezzel jonni hogy szemet Ngreedia, csak tudod amig a masik is ugyanoda araz addig teljesen invalid ez a frocsogesed, vagy erdemes lenne leirnod az AMD-vel is. 7900XT-nek nevezett 6800XT. Mindket ceg elmehetne a p*csaba.

Az AI amugy szerintem pont nem marketingesek altal felvert hype. Van az is benne, de a GPT speciel nem az.[ Szerkesztve ]

Hi, i'm new to APHEX TWIN, so i was wondering how much the IQ requirements was to enjoy his stuff. and understand all the underlying themes, because its really complex stuff. I have IQ of 119 but i heard that you need atleast 120 is it true?

-

Kansas

addikt

válasz

GeryFlash

#39

üzenetére

GeryFlash

#39

üzenetére

"7900XT-nek nevezett 6800XT"

??? Mit szívtál?Nincs olyan MI, ami képes lenne szimulálni az emberi hülyeséget... ha valaha lesz, annak tuti az emberi hülyeség lesz az oka... A Föld erőforrásai közül a legjobban az ész van elosztva - mindenki meg van róla győződve, hogy több jutott neki, mint másoknak.

-

GeryFlash

veterán

Nem ugy ertem hogy atcimkezes, hanem az utodja lett a 7900XT. Nezd meg szepen mekkora a difi a 6800XT es a 7900XT kozott. 33%. A 3080 es 4080 kozott 50%. Ennyinek kene lennie a generaciok kozti kulonbsegnek. A 7900XT meg a 6800XT viszonylataban se tudta hozni ezt a szintet. Tetszikerteni? Lehet itt utni jogosan az Nvidiat, hogy a 4070 igazabol a 3060TI utodja lett, de akkor mondjuk el ezt a maisk oldalon is, hogy milyen kartya kapott 900-as megnevezest.

[ Szerkesztve ]

Hi, i'm new to APHEX TWIN, so i was wondering how much the IQ requirements was to enjoy his stuff. and understand all the underlying themes, because its really complex stuff. I have IQ of 119 but i heard that you need atleast 120 is it true?

-

GeryFlash

veterán

válasz

GeryFlash

#41

üzenetére

GeryFlash

#41

üzenetére

Közben megnéztem, a 3070 és a 4070 közt 30-35%ot mér a legtöbb teszt, ez pont annyi mint amennyi a 6800XT és a 7900XT között van

Szóval ennek fejében külön vicces az AMD fanboyok felhánytorgatása, az NV legalább ekkora perf difire ugyanazt a számozást adta, ellenben az AMD-nek volt pofája 7900nak nevezni a 6800XT utódott.

Szóval ennek fejében külön vicces az AMD fanboyok felhánytorgatása, az NV legalább ekkora perf difire ugyanazt a számozást adta, ellenben az AMD-nek volt pofája 7900nak nevezni a 6800XT utódott.

De hozzáteszem, mindkét cég elmehet a p*csába, 80-90% gainekről ment a szédítés, a 3080/3090 vs 4080/4090 esetében legalább kaptunk +50-60%ot többinél meg ez a 30-35% illetve az AMD-nél még kevesebb is lesz a 7800XT megjelenésével

Hi, i'm new to APHEX TWIN, so i was wondering how much the IQ requirements was to enjoy his stuff. and understand all the underlying themes, because its really complex stuff. I have IQ of 119 but i heard that you need atleast 120 is it true?

-

Kansas

addikt

válasz

GeryFlash

#41

üzenetére

GeryFlash

#41

üzenetére

Akkor írd azt, hogy mi is úgy értsük.

Arra meg nincs szabály, hogy 30-40%-nál többnek kell lenni a fejlődésnek 1-1,5 év alatt a a generációk hasonlóan elnevezett tagjai közt. "80-90% gainekről ment a szédítés" igen, és? Csak nem bevetted?A "szédítés" szó arra utal nekem, hogy nem... Ha nem, akkor miért kéred számon?

Amúgy meg a nevezéktan tök mindegy, a teljesítmény és annak az ára számít(aka. bang/buck), aki a dobozra írt nevet veszi meg, az megérdemli, amit kap.Nincs olyan MI, ami képes lenne szimulálni az emberi hülyeséget... ha valaha lesz, annak tuti az emberi hülyeség lesz az oka... A Föld erőforrásai közül a legjobban az ész van elosztva - mindenki meg van róla győződve, hogy több jutott neki, mint másoknak.

-

GeryFlash

veterán

Prof kollega kommentjere valaszoltam, aki nehezmenyezte hogy a 4070 inkabb 4060. Jeleztem neki hogy akkor a 7900XT is a 6800XT utodja lehetne. Illetve nem is, mert ebben az esetben, ha 35% difi nem jelent szerinte teljes gen valtast ugyanabban a kategoriaban akkor a 7900XT inkabb 7700XT lenne.

Hi, i'm new to APHEX TWIN, so i was wondering how much the IQ requirements was to enjoy his stuff. and understand all the underlying themes, because its really complex stuff. I have IQ of 119 but i heard that you need atleast 120 is it true?

-

D55

aktív tag

Nem is feltétlenül a Source-ra akartam itt a hangsúlyt helyezni, csak arról konkrétan tudom, hogy így működik, ezért könnyen el tudom képzelni, hogy más fejlesztők is alkalmaztak hasonlót már más engine-ekben.

Amúgy az még hozzátartozik, hogy pont a latency "csökkentése" érdekében folyamodtak ehhez, hogy a player kb. ott látszódjon a te monitorodon, ahol majd akkor lesz picivel később, amikorra a te gépedről odaér a szerverre a csomag, hogy te X helyre célozva eleresztettél egy lövést. Bizonyos körülmények esetén jól működött a dolog, bizonyos körülmények esetén annyira nem

(CS:S idejéről vannak az infóim, azt már nem tudom, hogy utána a GO-ban is maradt -e így, azzal már csak játszottam amióta kint van, bár most a CS2 beharangozott újdonságaiból visszavezetve gyanítható, hogy sokat még a GO-nál sem változtattak a logikán)

[ Szerkesztve ]

-

Alogonomus

őstag

válasz

GeryFlash

#44

üzenetére

GeryFlash

#44

üzenetére

Bár nyilván túlzás volt Prof kolléga megállapítása, de annyiból mindenképpen jogos a felvetése, hogy a 3070 inkább tartozott az aktuális kártyageneráció 7-es kategóriába, mint amennyire a 4070 oda tartozik. Bevezetésekor a 8 GB-os 3070 még nem futott bele "beszakadó" eredménybe még 4k felbontás mellett sem, míg a 4070-hez hasonlóan 12 GB-os 4070 Ti már a megjelenésekor is beleszaladt pár látványos memóriakapacitásból eredő problémába.

Sőt mint a friss videóból kiderült, a probléma elfedésére az Nvidia kártyákon már jelenleg is működik a memóriaigény kordában tartására egy textúra betöltődést felülvezérlő módszer, vagyis a helyzet még jelentősebb lehet, de a többi esetben kezelte a problémát a megoldás, így azoknál nem bukott ki a memóriahiány.

Szóval bár nyilván sokkal erősebb, mint a majd érkező 8 GB-os 4060-as, de azért a korábbi 3070-eshez képest egyértelműen kevésbé jövőálló a 4070-es, és akár már az idei karácsonyi szezon címei esetén is gyakran szükség lehet a valamilyen szintű DLSS bekapcsolására már 1440p esetén is, és nem annyira az átlagos fps feltornázásához, hanem az alacsony 1% low, vagyis a stuttering kiküszöböléséhez. Illetve alternatívaként rá lehet majd hagyni a probléma kezelését a driverre, csak akkor néha "salátafák" lesznek a képernyőn.[ Szerkesztve ]

-

D55

aktív tag

"A birkak raharaptak a jatekok 1%-anal se mukodo RT, DLSS "funkciora"."

Azért ezzel óvatosabban. Lehet abban valami talán, amit mondasz, ezt nem zárom ki (hogy két legyet egy csapásra született az RTX generáció és a húsos compute modellek).De ha így is van, mind a DLSS, mind a DXR támogatás valós előrelépés grafikai minőség terén. Először is a DLSS nem csak teljesítménynövelésre jó/való, hanem szimpla élsimításként quality preseten gyönyörű eredményt biztosít minimális kompromisszumokkal. Az alternatívák, amiknek szerintem mindegyikét veri:

- FXAA: 100Ft-os nyugdíjasvásár kategória. Homályosak lesznek tőle a textúrák is.

- MSAA: Nem működik az alpha channel miatt létrejövő textúrán belüli éleknél, plusz a minőség a 4x-es szinten kezdődik, aminek viszont már jelentősebb teljesítményigénye van

- SSAA: Hibátlan, a legtisztább nyers megközelítést alkalmazó technika. Ja, de tegyél alá hardware-t.

- SMAA: Ügyes megoldás, de a nagy kontrasztú éleknél és bizonyos szögeknél feltűnőbben karcolós.

- SMAA+TAA: Ez volt az elmúlt évtizedben talán legelterjedtebb megoldás, szép a végeredmény, vállalható a teljesítményigény, de jár hozzá ajándékba motion blur vagy artifactolás, ki melyiket akarja jobban észrevenni

A DXR meg olyan, hogy kapcsold be egyszer árnyékokra / AO-ra, nézd meg alaposan, aztán kapcsold ki és kínozd a látóközpontodat... És igen, hozzá tartozik, hogy nagy vonalakban nem feltűnő, nem az amire látatlanba sokan számítanak eleinte és a reflection implementációkkal lőttek már mellé pár játékban. De egyszer tényleg nézd meg az árnyékok vetülését és hidd el, hogy utána rendesen zavarni fog, műanyagosnak, rajzfilmszerűnek fog hatni a hiánya.

-

Kansas

addikt

Azzal ugye mindenki tisztában van, hogy a DLSS 2 nem használ egyáltalán Tensor magokat, és erősen kétlem, hogy a DLSS3 framegen különbözne tőle ezen a téren...

"A DXR meg olyan, hogy kapcsold be egyszer árnyékokra / AO-ra, nézd meg alaposan, aztán kapcsold ki és kínozd a látóközpontodat..."

És akkor mi van, ha engem a DXR-t ilyen szinten használó 2-3 játék egyike se érdekel?[ Szerkesztve ]

Nincs olyan MI, ami képes lenne szimulálni az emberi hülyeséget... ha valaha lesz, annak tuti az emberi hülyeség lesz az oka... A Föld erőforrásai közül a legjobban az ész van elosztva - mindenki meg van róla győződve, hogy több jutott neki, mint másoknak.

-

Busterftw

veterán

Nincs semmi, de teljesen egyértelmű, hogy az Prof által marketing bullshitnek titulált RT és az AI-n alapuló tech itt van és marad is.

Szóval lehet itt leszolni az első RTX széria és a technológia early-adoptereket birkázni, csak aztán nagyon nem így alakult végül, mert beállt mögé az egész iparág és a számok alapján a játékosok is.

[ Szerkesztve ]

-

GeryFlash

veterán

válasz

Alogonomus

#46

üzenetére

Alogonomus

#46

üzenetére

Teljesen egyetertek ezzel, ha visszaolvasod nem is ezt kifogasoltam hanem azt, hogy elfelejtette megemliteni a 7900XT-t, ami olyan relacioban van 6800XT-vel (ami ugye a 3080 konkurensenek lett inditva) mint a 3070 es a 4070, tehat ha azt mondjuk (jogosan), hogy a 4070 egy 3060 utod akkor tegyuk hozza hogy a 7900XT-nek meg a 7800XT is tulzas, inkabb 7700XT esetleg sima 7800. Vagy hagyjuk beken a 4070-et es akkor a 7900XT lehetne 7800XT.

De ahogy irtam, mindket ceg elmehet a francba.

Hi, i'm new to APHEX TWIN, so i was wondering how much the IQ requirements was to enjoy his stuff. and understand all the underlying themes, because its really complex stuff. I have IQ of 119 but i heard that you need atleast 120 is it true?

-

Kansas

addikt

válasz

Busterftw

#49

üzenetére

Busterftw

#49

üzenetére

"mert beállt mögé az egész iparág és a számok alapján a játékosok is."

Igen, a hardvergyártók(Intel, AMD) egy, a játék-gyártók két generációval a megjelenés után. Ahogy az a kezdetektől fogva sejthető is volt...Aki az első generációs hardverből vett az kb. mostanság gondolkodik el azon, hogy cserélnie kéne, és hát őket bizony nagyobbrészt palira vették, az első RTX kártyák megjelenése óta eltelt 4,5(!) évben ha nem kifejezetten vadásztál az RT-támogatott játékokra akkor alig volt valami amin a frankó eyecandy-t megkaptad, ráadásul ami volt, annak a többsége is részleges implementáció, élen az olyan "ál-RT" játékokkal, mint a Dirt 5, amin olyan mértékben "üt" az RT, hogy ha bekapcsolod, alig vesztesz valamit a sebességből, és a képernyőn se nagyon venni észre, de a játékot lehet vele marketingelni.

Cserébe csórikám vagy többet fizetett azonos teljesítményért, vagy ugyanazért a pénzért gyengébb kártyát kapott a konkurenciához képest.Az elmúlt pár hónapban kezdenek valóban látható mennyiségben jönni a DXR-es játékok, fekszenek is tőle a framerate-ek meg a framebufferek erősen.

Attól pedig, hogy az RT a játékmenet szerves része legyen, messze vagyunk még, mint Makó vitéz Jeruzsálemtől. Ahhoz ugyanis az kell, hogy a többségnek RT-képes kártyája legyen, amihez meg az kell majd, hogy a középkategóriás(árú, ez ugye 350-450 USD MSRP) kártyák is potens RT-képességekkel rendelkezzenek(2060, 3050 szint nem elég, az én 6700XT-m RT képessége szintén elég vézna).Ezzel együtt az RT a jövő, csak győzzük kivárni, mikor pedig eljön, kifizetni...

Az AI-n alapuló tech-ben annyira azért nem lennék biztos, hogy hosszú életű lesz a grafika terén...[ Szerkesztve ]

Nincs olyan MI, ami képes lenne szimulálni az emberi hülyeséget... ha valaha lesz, annak tuti az emberi hülyeség lesz az oka... A Föld erőforrásai közül a legjobban az ész van elosztva - mindenki meg van róla győződve, hogy több jutott neki, mint másoknak.

-

Busterftw

veterán

Jó és szerinted ennek hogy kellett volna működnie?

A dx12 vga-k se úgy jöttek ki, hogy launchkor minden játék dx12 volt.Ha nincs első generációs hardver, ha nem indul el a dolog, akkor nincs 2.,3. generációs hardver se.

Egyáltalán nem vették őket palira, mert raszterben hozták a generációs kötelezőt.

Ha a konkurenciát nézzük, az RTX 2080 annyiba került boltokban anno mint a RadeonVII, szóval még a sokat emlegetett "RT felár" sem volt igaz.Az AI implementációt a gyártók máshogy képzelik el, de mindhárom vga gyártó dolgozik rajta, legyen az DLSS vagy AI optimalizált driverek.

-

Kansas

addikt

válasz

Busterftw

#52

üzenetére

Busterftw

#52

üzenetére

Az AMD FSR pl nyomokban sem tartalmaz AI-t, ahogy mondják, ők inkább AI-ra használnák.

A DLSS se tartalmaz gyorsított AI-t, amilyen van benne, az elméletben simán futhatna GTX-en is.

Az Intel cuccát nem ismerem, de nekik a komplett architektúrájuk bejáratós, nem csak a DXR.A 2070S átlag 25-30%-kal került többe(160e vs 200e Ft), mint egy RX5700XT és nem volt igazából gyorsabb, a 2060S kb ugyanannyiba került, mint az 5700XT, de érezhetően lassabb. A szimpla RX5700 pedig erősebb a sima 2060-nál... A középkategória a mérvadó, nem a csúcs. Az RX5700 alatti GPU-k pedig GTX-ekkel versenyeztek, nem RTX-ekkel.

[ Szerkesztve ]

Nincs olyan MI, ami képes lenne szimulálni az emberi hülyeséget... ha valaha lesz, annak tuti az emberi hülyeség lesz az oka... A Föld erőforrásai közül a legjobban az ész van elosztva - mindenki meg van róla győződve, hogy több jutott neki, mint másoknak.

-

D55

aktív tag

"a DXR-es játékok, fekszenek is tőle a framerate-ek meg a framebufferek erősen"

3060 Ti-m van 165Hz-es (de 120Hz-en járatom általában) 1440p monitorral... Fogalmazzunk úgy, hogy ezekkel könnyű észrevennem ha fekvés van. De annyira nem szörnyű azért a helyzet, én eddig arra jutottam, hogy azon múlik mennyire dolgoznak igényesen a fejlesztők, mennyire van értelmesen optimalizálva a játék:

- Cyberpunkot még nem is próbáltam a 13600K-val, de már előtte a hazaáruló Ryzen 5-tel a tömegjelenetes küldetés kivételével 1.6-ban medium RT-vel DLSS mellett már simán tartott stabil 70-90fps-t. Előtte viszont az 1.5-ben ugyanezzel a settinggel még rendszeresen benézett 45fps köré.

- Witcher 3 CE nem az igazi, kicsit 60 alá bemegy a 13600K-val is, viszont a Ryzennel előtte inkább 30-40 körül nézelődött. RT nélkül mindegyikkel 100 fölött lazán. Egyértelmű CPU limit csak bekapcsolt RT esetén, ami megint csak súlyosan hanyag optimalizációra vall.

- A Plague Tale: Requirement-nek csúfolt Requiem ellenben könnyedén tartja a 70-90 körüli tartományt (DLSS mellett természetesen itt is), csak tengernyi patkány esetén szokott 60 környékére beesni és ilyenkor hihetetlen mód 50% fölé viszi a 20 szálas 13600K-t is, ami megint csak határozott CPU limitre vall.

- Metro Exodus EE átlagban 80-100FPS körül fut, ultra részletesség, medium RT. Minimum így kéne minden játékot megírni, amiért valaki pénzt mer kérni.

- Hogwarts Legacy RT-vel össze-vissza fut, van amikor tart 90fps-t, van amikor 45 köré bezuhan. A Ryzennel RT nélkül is ilyen volt, most az i5-tel úgy már viszont 120Hz-es vsyncet tart pályarészváltások kivételével zökkenőmentesen, 1% low 80-90fps körül.Mondjuk egy kis undervolttal meg van küldve a kártyám stabil 2GHz turbora, de benchmarkok szerint ez csak olyan 5-6% lehet stockhoz képest. Egyedül a Passmark féle ami egy 3080 szintjére hozza ki, de szerintem az már nincs észnél teljesen manapság.

-

Kansas

addikt

Magyarul FHD-ban játszol(vagy alatta, nem írtad, milyen DLSS szintet használsz, Quality mellett FHD, Performance esetén 720p a renderelési felbontás), az összes komolyabb RT tartalmú játékod így is bekarcol bőven 60fps alá, és meglepő módon CPU limited van(a procin futtatod a DLSS-t vagy mi?)... wow!

CP2077-en be van kapcsolva a path tracing? Vagy az RT-nek is csak a felét/kétharmadát használod, nem csak a felbontásnak?

Mondjuk LFC-képes monitorral ez kétségtelenül kevésbé zavaró, mint nélküle(gondolom a GSync/AdaptiveSync-et bekapcsolva tartod).[ Szerkesztve ]

Nincs olyan MI, ami képes lenne szimulálni az emberi hülyeséget... ha valaha lesz, annak tuti az emberi hülyeség lesz az oka... A Föld erőforrásai közül a legjobban az ész van elosztva - mindenki meg van róla győződve, hogy több jutott neki, mint másoknak.

-

GeryFlash

veterán

Ja persze, elozo generacios kozep kategorias VGA-val szemere vetjuk hogy nem path-tracinggel futtatja a Cyberpunkot

Elkepeszto amugy hogy az ember normal esetben csak szeretne nyugodtan utalni mindket ceget, de az AMD fanok mindig tesznek rola hogy a vitaban az ember az ,,NV partjara alljon". Nem eleg hogy az AMD marketing csapata talan az egesz indrustryban az egyik ha nem leggyengebb, meg a szimpatizansok is loknek rajta egyet a szakadek fele.

Hi, i'm new to APHEX TWIN, so i was wondering how much the IQ requirements was to enjoy his stuff. and understand all the underlying themes, because its really complex stuff. I have IQ of 119 but i heard that you need atleast 120 is it true?

-

D55

aktív tag

A DLSS szint játékfüggő, a minimum 75fps-t szoktam megcélozni.

CPU limitnek már a Ryzennel sem igen kellett volna lennie, pont ezért megdöbbentő, hogy egyes játékok RT-vel a végtelenül erős 13600K-t is képesek láthatóan megdolgoztatni valamiért RT offhoz viszonyítva.

CP2077 most nincs fent, még az i5-ön sem próbáltam amióta megvan, így még az RT Overdrive-ot sem értelemszerűen.

VRR-t természetesen használok, ha rajtam múlna nem is engednék anélkül monitort gyártani már...

És nyilván nem azt akartam ebből kihozni, hogy egy 3060 Ti már elég lenne tökéletesen kihajtani mindent natív 1440p-ben, csak azt, hogy a rendelkezésreálló technológiák kihasználásával egy igényesen megírt játék egy középkategóriás VGA-n igen is elfuthat akár bekapcsolt, érdemi RT-vel is teljesen élvezhető képkockaszámot és szépnek mondható képtartalmat eredményezve. Viszont ha annyira lusták voltak egy játékot optimalizálni, hogy az még egy enyhén szólva nem túl szerényre sikerült Raptor Lake procival is CPU limit jeleiről árulkodjon, ráadásul a DXR featureset használatával összevágó mértékben, akkor ott nem biztos, hogy a GPU erőforrásainak szűkösségét kell egyből bűnösnek kikiálltani.

Ettől függetlenül az ál-RT témát adom, nekem a BF V ahol ez eddig szembejött. -

Kansas

addikt

válasz

GeryFlash

#56

üzenetére

GeryFlash

#56

üzenetére

Nem igazán. Azt "vetem a szemére"/azzal próbálom szembesíteni, hogy önmagának is beadja(sok mással együtt), hogy érdemben RT-képes kártyája van, bár persze megfelelő távolságból megfelelően hunyorítva(értsd: az RT effektek felét kikapcsolva, csökkentett felbontáson renderelve) valóban képes élvezhető framerate-et produkálni(egy 2060-hoz, 3050-hez képest sokkal jobb, elvileg a 6700XT-t is lehagyja), még az sem biztos hogy mindent egybe vetve nem jobb a végeredmény, mint RT-t/DLSS-t teljesen kikapcsolva, 100% raszterizálással.

De ezt érdemi RT-nek hívni olyan, mintha azt akarnád beadni, hogy egy soros négyhengeres városi autó már majdnem olyan mint egy V8-as sportkupé...

Légy nyugodt, jelen pillanatban én is jelentős ellenérzésekkel viseltetek mindkét (mindhárom) cég iránt, de jelen érveim gyártófüggetlenek, csak annyiban érintik valamivel erősebben az NVidiát, amennyivel nyálasabb szájjal fröcsköli az "az RT az Isten, itt, most" marketinghazugságot, amit te sem tagadhatsz, hogy az AMD-hez képest 11-re csavartan tesz.#57 D55: OK, túlnyomó részt egyetértünk akkor, ebből az egészből én csak az általad használt beállítások "érdemi RT"-nek nevezésével nem kifejezetten értek egyet.

[ Szerkesztve ]

Nincs olyan MI, ami képes lenne szimulálni az emberi hülyeséget... ha valaha lesz, annak tuti az emberi hülyeség lesz az oka... A Föld erőforrásai közül a legjobban az ész van elosztva - mindenki meg van róla győződve, hogy több jutott neki, mint másoknak.

-

Alogonomus

őstag

válasz

Busterftw

#52

üzenetére

Busterftw

#52

üzenetére

A dx12 vga-k se úgy jöttek ki, hogy launchkor minden játék dx12 volt.

Az első RT-képes kártyák plusz képessége lényegében ugyanannyira nem jelentett valós előny, amennyire az első dx12-es kártyák plusz képessége sem. A dx12-es kártyákat nem is árazták hirtelen negyedével drágábbra arra hivatkozva, hogy már a dx12-es funkciókat is kezelni tudják. Csak javította a kártya értékét, majd idővel már valós hasznot is jelentett, de addig is a kártya fine wine értékét növelte. -

Busterftw

veterán

válasz

Alogonomus

#59

üzenetére

Alogonomus

#59

üzenetére

Nem volt RT felár, az RTX 2080 boltokban annyiba került mint az ellenfél RadeonVII.

A valós (plus) előny az RT és DLSS képesség volt, ami más kártyákon nem volt akkor. -

Alogonomus

őstag

válasz

Busterftw

#60

üzenetére

Busterftw

#60

üzenetére

Az RTX 2060 perf/watt értéke legalább nem volt rosszabb, mint a GTX 1060 értéke, de az RTX 2070 értéke már a GTX 1070 Ti értékével volt egy szinten, az RTX 2080 perf/$ értéke pedig majdnem a GTX 1080 Ti értékénél volt. Az RTX 2080 Ti értéke pedig egy teljes szinttel volt rosszabb a GTX 1080 Ti-hoz képest.

A gyengébb értéket pedig az akkor még szinte kihasználhatatlan DLSS és RT képességgel magyarázta az Nvidia.A Radeon VII professzionális kártya volt, így a Quadro kártyákkal reális összemérni.

-

Gave

addikt

US tojás shopban mondjuk 3070 $500 helyett még most is 550-570+on megy, a 4070 meg tényleg 599 start áron megy, ami teljes spektrumon jobb deal mint a 3080, azért na... szóval, ha valóban a javasolt áron mentek volna kezdetben, mostanra meg esett volna 500 alá, akkor talán nem ragad be a készlet ennyire. TLDR; a kereskedők is szeretik az ingyen pénzt

-

Kansas

addikt

válasz

Busterftw

#60

üzenetére

Busterftw

#60

üzenetére

Csak baromira nem a 2080 ára a mérvadó, pláne nem a Radeon VII-é... tudom, hogy az RTX-ek előbb jöttek ki kicsivel, mint az RDNA, de akkor se a legagyatlanabb GCN kártyához kéne mérni... csak nem rosszabbul festene egyy RX580-hoz képest bang/buck-ban?

"A valós (plus) előny az RT és DLSS képesség volt, ami más kártyákon nem volt akkor."

Tekintve, hogy akkoriban techdemókon kívül játékokban sem igazán voltak, erősen véleményes(vagy szemellenzős) ezt előnynek tekinteni. Még most, több mint 4 évvel később is egy kézen meg tudod számolni a játékokat amiknek nem csak részleges a DXR implementációja...A DLSS-t/FSR-t pedig én a magam részéről nem vagyok hajlandó előnynek tekinteni ma sem. Tudod, hogy hívják azt a játékgépet, ahol a felskálázós technológiák alapértelmezetten használtban vannak? Konzolnak. És a GPCMR tagjainak évtizedes tracíciója lenézni a konzol "butított" grafikus megjelenítését... bezzeg most hogy a képbutítás szükségessé vált PC-n is hogy az RT brutális teljesítményigényét ellensúlyozzák, most már ünnepelni kéne?

Kösz, én inkább továbbra is szükséges rossznak tekintem őket, és mellőzöm a használatukat, ha tehetem.[ Szerkesztve ]

Nincs olyan MI, ami képes lenne szimulálni az emberi hülyeséget... ha valaha lesz, annak tuti az emberi hülyeség lesz az oka... A Föld erőforrásai közül a legjobban az ész van elosztva - mindenki meg van róla győződve, hogy több jutott neki, mint másoknak.

-

Kansas

addikt

Tudod, mi a legköltséghatékonyabb módja FHD/1440p-ben némileg butított grafikával RT-vel játszani? Úgy hívják, XBOX Series S, és az egész mindenestül kevesebbe kerül, mint neked csak a procid, nulla driver issue, az igazi plug&play... megfelelő játékok esetén még a 120Hz-et is tudja.

Nincs olyan MI, ami képes lenne szimulálni az emberi hülyeséget... ha valaha lesz, annak tuti az emberi hülyeség lesz az oka... A Föld erőforrásai közül a legjobban az ész van elosztva - mindenki meg van róla győződve, hogy több jutott neki, mint másoknak.

-

Busterftw

veterán

válasz

Alogonomus

#61

üzenetére

Alogonomus

#61

üzenetére

"A Radeon VII professzionális kártya volt, így a Quadro kártyákkal reális összemérni."

Errol szoltal az AMD-nek is?

AMD Unveils World’s First 7nm Gaming GPU

“AMD Radeon VII is the highest-performance gaming graphics card we ever created,” said Scott Herkelman, corporate vice president and general manager, Radeon Technologies Group at AMD. “It is designed for gamers, creators and enthusiasts who demand ultra-high quality visuals, uncompromising performance and immersive gaming experiences.”AMD Youtube reveal szinten gaming. RadeonVII honlapjan szinten gaming focus.

A Quadro ellen az Instinct MI a konkurencia. -

Busterftw

veterán

A 2080 ara mervado, mert a RadeonVII volt az ellenfele teljesitmenyben/arban.

"Még most, több mint 4 évvel később is egy kézen meg tudod számolni a játékokat amiknek nem csak részleges a DXR implementációja..."

En ezt ertem, viszont mast nem tudok mondani, valahol el kellett kezdeni, mert maskulonben nem epul ra semmi es nem tortenik semmi elorelepes, legyen az hardver vagy szoftver.Ez a szam mostanra sokkal nagyobb es a jatekosok is nagy %-ban hasznaljak:

"bezzeg most hogy a képbutítás"

Nem ertek ezzel egyet, hiszen nagyon sok esetben jobb kepminoseget produkal a DLSS vs nativ. Foleg ha elsimitasrol van szo, a DLAA barmi skalaz nelkul elsimit AI-val.

A DLDSR pedig epp a forditott mukodest hozta be, magasabb felbontason renderel es azt skalazzal vissza nativra."most már ünnepelni kéne?"

Nem kell unnepelni, csupan ez van, az RT es AI cuccok itt vannak es maradnak, mert ez a jelen es a jovo. Ezert allt be az AMD es az Intel is, a studiok, konzolgyartok, mindenki.Kikapcsolhato, szoval nyugodtan mellozheted oket.

Viszont ne legyen mar gond, ha a tobbseg ezeket hasznalja.[ Szerkesztve ]

-

Kansas

addikt

válasz

Busterftw

#66

üzenetére

Busterftw

#66

üzenetére

"En ezt ertem, viszont mast nem tudok mondani, valahol el kellett kezdeni, mert maskulonben nem epul ra semmi es nem tortenik semmi elorelepes, legyen az hardver vagy szoftver."

Ezzel 100%-ban egyet is értek, egy pillanatig sem vitattam.

Csak azt mondom, hogy ezen a ponton még nem lehet azt mondani, hogy "ez a jelen", mert nem az.

A fent linkelt képeden nem az az érdekes infó, hogy az RTX40xx kártyák birtokosai 83%-ban bekapcsolják az RT-t, hanem hogy 17% még mindig nem, ami főleg azért fura, mert ezek között leginkább 4080 és 4090 tulajok vannak, kétlem hogy a 4070-ek túlzottan elterjedtek volna mára. Szóval vajon miért van az hogy átlag 6 új bivaly RTX kártya tulaj közül egy nem kapcsolja be az RT-t, pedig tehetné?" DLSS vs nativ. Foleg ha elsimitasrol van szo, a DLAA barmi skalaz nelkul elsimit AI-val."

Egyrészt ez leginkább az AA funkciója miatt van, másrészt nincs benne AI. A machine learning nem egyenlő az AI-val... ha kellően laza definiciót használsz az AI-ra, akkor a ML az AI egyik részterülete."A DLDSR pedig epp a forditott mukodest hozta be, magasabb felbontason renderel es azt skalazzal vissza nativra."

Ezt hívják úgy más néven, hogy SSAA. Nem atomfizika, csak a meleg vizet találták fel újra, innentől nem tűzzel, hanem maghasadással fűtve.Az "AI" mögé grafikus felhasználásra senki nem állt be az NV kivételével. Az általad sorolt cégek az RT mögé álltak be(nagyon helyesen). AI téren pedig a generatív AI mögé(aminek azért én látom némi veszélyét, nem biztos, hogy az kellene legyen a jövő).

"Viszont ne legyen mar gond, ha a tobbseg ezeket hasznalja."

Nem gond. Az a gond, amikor a szükséges rosszat előnyösnek akarják eladni. De együnk szart, annyi rovar nem tévedhet...[ Szerkesztve ]

Nincs olyan MI, ami képes lenne szimulálni az emberi hülyeséget... ha valaha lesz, annak tuti az emberi hülyeség lesz az oka... A Föld erőforrásai közül a legjobban az ész van elosztva - mindenki meg van róla győződve, hogy több jutott neki, mint másoknak.

-

D55

aktív tag

De én közel sem csak játékra használom a PC-met... Meg ha már GPCMR-t emlegetsz, az egy kultúra, sőt szinte egy vallás ha úgy nézzük, még a maga kis szertartásai is megvannak. Ha vannak is időszakok, amikor épp nem 100%-ig konzekvensek az ezen belüli nézetek, attól még nem fog hirtelen egy csomó ember "megtérni".

-

Kansas

addikt

Én se, de a nem játék célú felhasználásra nincs szükség 300e-s videokátyára az esetek többségében. Az más kérdés, hogy sokan profi kártya helyett is azt vesznek, mert tényleg mindent ugyanazzal a géppel akarnak megoldani és vállalkozóként céges számlára jobban szeretnek gamer hardvert venni, mint saját zsebre(ezt egyébként akár adócsalásnak is hívhatnák a törvény betűje helyett a szellemét is nézők).

A GPCMR nem vallás, hanem a PC gamerek egy olyan részhalmaza, akik a PC-n kívül minden mást lenéznek, és ennek hangot is adnak, leginkább a PH fórumhoz hasonló helyeken.[ Szerkesztve ]

Nincs olyan MI, ami képes lenne szimulálni az emberi hülyeséget... ha valaha lesz, annak tuti az emberi hülyeség lesz az oka... A Föld erőforrásai közül a legjobban az ész van elosztva - mindenki meg van róla győződve, hogy több jutott neki, mint másoknak.

-

Alogonomus

őstag

válasz

Busterftw

#65

üzenetére

Busterftw

#65

üzenetére

A marketingszövegekből kiindulni eleve hiba.

A Radeon VII ugyanaz a kategória, ami az "A" valahány ezres kártyák az Nvidia kínálatában, amik másik elnevezése a Quadro. Lehet rajtuk játszani, de elsődlegesen nem arra készült egyik sem.Az Instinct megfelelője az Nvidia oldalán a GA100 és GH100 alapokra épülő gyorsítók.

-

Busterftw

veterán

"Szóval vajon miért van az hogy átlag 6 új bivaly RTX kártya tulaj közül egy nem kapcsolja be az RT-t, pedig tehetné?"

Sok oka lehet, nem játszanak RT-s játékokkal, nem érdekli őket az RT."Ezt hívják úgy más néven, hogy SSAA. "

Kivéve a neurális hálót, amit az Nvidia mögé tett és folyamatosan javul. Persze nem kell jobbra törekedni, maradhatunk még 40 ÉVIG az SSAA-n.Én nem látom ezt szükséges rossznak, mert például a DLSS olyan játékokat tesz sokkal jobban játszhatóvá azoknak akiknek amúgy nincs csúcs/elég erős hardvere.

4080 kell egy natív 90fps-hez ami 3060 10fps produkálna?

DLSS-el játszhat 60fps-el és nem kell a 4080. -

Busterftw

veterán

válasz

Alogonomus

#70

üzenetére

Alogonomus

#70

üzenetére

Ez nem marketing szöveg, hanem piaci szegmensben a gyártó által elhelyezett termék.

A RadeonVII játékra volt, hiszen teljes volt a support, az összes oldal úgy tesztelte, AMD gaming linup akkori csúcsa.

Az professzionális gyorsítók az Instict linup vs Quadro volt.

Nvidianál csak időközben annyi történt, hogy elhagyták a Quadro márkanevet.

Ne ferditsünk már ilyen triviális dolgokat. -

Kansas

addikt

válasz

Busterftw

#72

üzenetére

Busterftw

#72

üzenetére

OK, lovagolj még a GCN-en, azon a (némi túlzással) 5-10 Radeon VII-en amit gyártottak és el tudtak adni agyatlan pénzért... mert persze, releváns... de akkor miért nem a 1080Ti-al hasonlítod össze, aminek valójában az ellenfele volt?

Nincs olyan MI, ami képes lenne szimulálni az emberi hülyeséget... ha valaha lesz, annak tuti az emberi hülyeség lesz az oka... A Föld erőforrásai közül a legjobban az ész van elosztva - mindenki meg van róla győződve, hogy több jutott neki, mint másoknak.

-

Kansas

addikt

válasz

Busterftw

#71

üzenetére

Busterftw

#71

üzenetére

"Kivéve a neurális hálót, amit az Nvidia mögé tett és folyamatosan javul."

Aha, szóval te is azok közé a buzzword-vezérelt vásárlók közé tartozol, aki elhiszi, hogy minden ami mögé neurális hálót tesznek, jobb lesz tőle... rossz hírem van, nem lesz. Hasznos marketing-maszlag, de nem varázsfűszer, amit bármire rászórva jobb lesz tőle hirtelen. Valahogy út közben a Tensor magok használatát is elfelejtette az NVidia-féle DL... meg kijött egy FSR, ami nulla varázsfűszerrel, vendor-függetlenül közel olyan jó eredményt ad, mint a DLSS... nem egészen, különösen alacsony felbontáson nem, de majdnem."Persze nem kell jobbra törekedni, maradhatunk még 40 ÉVIG az SSAA-n."

Az SSAA nem hogy nem marad velünk még 40 évig, de gyakorlatilag kiveszett a piacról, alig lehet találni olyan modern játékot, amibe implementálva van. van pár játék, mint pl az Assassin's Creed sorozat és a Truck Simulator sorozat, ahol túlskálázásként megjelenik még, ha elég erős a VGA-d akkor akár hasznos is lehet, de a játékok túlnyomó része egyszerűen dobta a TXAA/FXAA páros kedvéért.Nincs olyan MI, ami képes lenne szimulálni az emberi hülyeséget... ha valaha lesz, annak tuti az emberi hülyeség lesz az oka... A Föld erőforrásai közül a legjobban az ész van elosztva - mindenki meg van róla győződve, hogy több jutott neki, mint másoknak.

-

Busterftw

veterán

Nem lesz minden jobb a neuralis halotol, de a DLDSR jobb mint az SSAA, buzzword ide vagy oda.

"FSR, ami nulla varázsfűszerrel, vendor-függetlenül közel olyan jó eredményt ad, mint a DLSS"

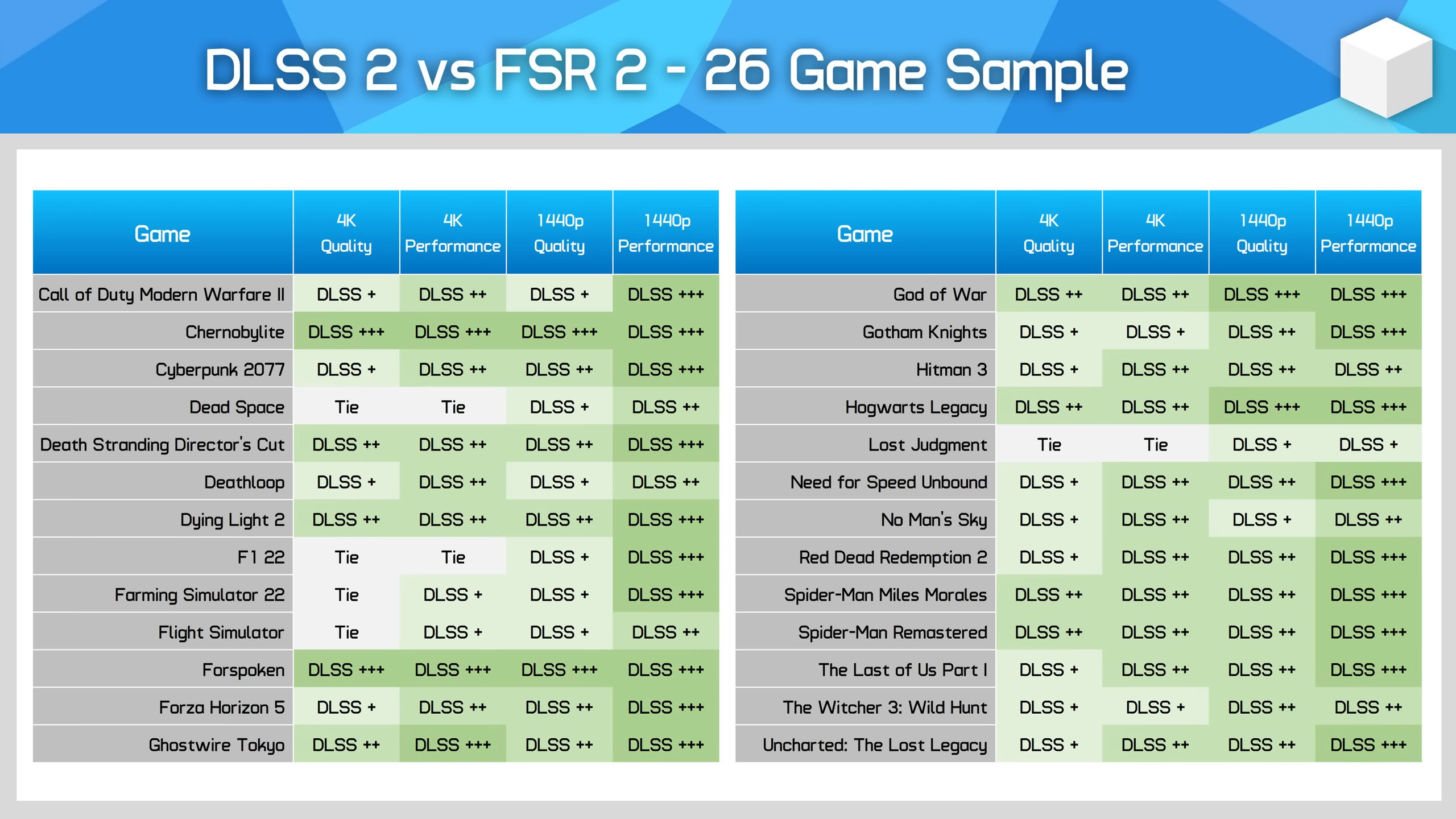

Pontosan a training mellozese miatt nem ad olyan eredmenyt. Na pont az FSR-ra kellene azt mondanod, hogy marketing es nem talaltak fel a spanyol viaszt.

Hirtelen kellett valami a DLSS ellen, szokasos AMD felgozos modon osszetakoltak valamit, aminek meg is van az eredmenye:

-

D55

aktív tag

"A GPCMR nem vallás, hanem a PC gamerek egy olyan részhalmaza, akik a PC-n kívül minden mást lenéznek, és ennek hangot is adnak, leginkább a PH fórumhoz hasonló helyeken."

Hát majdnem...

Az eredeti meme sok-sok éve valóban kb. erről szólt, de aztán sokaknak megtetszett a dolog, akik élvezetüket lelik a PC Gaming világában és kissé poénosan magukra vették a jelzőt. Bár a konzolosok primitívebbnek tekintése talán tényleg ott lehet sokakban belül, ezzel nem vitatkozom, de közösségi szinten nem a méregetésről szól a dolog a gyakorlatban, hanem sokkal inkább csak szimplán a PC-s világ csodálatáról.

Az eredeti meme sok-sok éve valóban kb. erről szólt, de aztán sokaknak megtetszett a dolog, akik élvezetüket lelik a PC Gaming világában és kissé poénosan magukra vették a jelzőt. Bár a konzolosok primitívebbnek tekintése talán tényleg ott lehet sokakban belül, ezzel nem vitatkozom, de közösségi szinten nem a méregetésről szól a dolog a gyakorlatban, hanem sokkal inkább csak szimplán a PC-s világ csodálatáról. -

D55

aktív tag

válasz

Busterftw

#76

üzenetére

Busterftw

#76

üzenetére

W3-ban próbálgattam végig pont nemrég az FSR vs. DLSS kérdést amikor keveselltem az átlag 60 fps-t RT mellett és én is azt tapasztaltam, hogy mind minőségben picit szebb az azonos preseteket egymás mellé téve a DLSS (sőt, ultra performance esetén már egész feltűnően), mind pedig teljesítményben 10-15% előnye van.

Szerk: #76-ra akart menni, nem tudom miért a #77-re rakta be válaszként a rendszer

[ Szerkesztve ]

Új hozzászólás Aktív témák

ph A GeForce RTX 4070 a 4070 Ti kistestvérének számít, ami a paraméterein is jól látszik.

- Legújabb Nvidia Quadro RTX 4000 Ada Generation 20 GB új garis eladó

- 10x R5 430 2GB DDR5 egybe (zörgő ventis)

- ELADÓ 32 DB Nvidia RTX 3060 Ti és 8 DB Zotac Gaming Geforce RTX 3080 Trinity / KOMPLETT BÁNYAGÉP

- Eladó ASUS GeForce GTX 1660 Super 6GB Phoenix videokártya (PH-GTX1660S-6G)

- EVGA GeForce GTX 1080 Ti FTW3 GAMING 11GB GDDR5X 352bit (11G-P4-6696-KR) Videokártya

Állásajánlatok

Cég: Promenade Publishing House Kft.

Város: Budapest

Cég: Ozeki Kft.

Város: Debrecen

.

.

(7900XT - bivalyerős)

(7900XT - bivalyerős)

![;]](http://cdn.rios.hu/dl/s/v1.gif)

Az eredeti meme sok-sok éve valóban kb. erről szólt, de aztán sokaknak megtetszett a dolog, akik élvezetüket lelik a PC Gaming világában és kissé poénosan magukra vették a jelzőt. Bár a konzolosok primitívebbnek tekintése talán tényleg ott lehet sokakban belül, ezzel nem vitatkozom, de közösségi szinten nem a méregetésről szól a dolog a gyakorlatban, hanem sokkal inkább csak szimplán a PC-s világ csodálatáról.

Az eredeti meme sok-sok éve valóban kb. erről szólt, de aztán sokaknak megtetszett a dolog, akik élvezetüket lelik a PC Gaming világában és kissé poénosan magukra vették a jelzőt. Bár a konzolosok primitívebbnek tekintése talán tényleg ott lehet sokakban belül, ezzel nem vitatkozom, de közösségi szinten nem a méregetésről szól a dolog a gyakorlatban, hanem sokkal inkább csak szimplán a PC-s világ csodálatáról.