Hirdetés

-

Játékosbarát frissítést kapott az ASUS ROG Ally

ph A vállalat engedélyezte az AMD Fluid Motion Frames eljárását.

-

Idén elmarad a BlizzCon

gp A hírek szerint más eseményeken lehet számítani a Blizzard idei bejelentéseire.

-

Világító alma helyett világító tok és szíj az almákra

ma Megjelent a Glow 2.0, a Nomad fluoreszkáló iPhone védőtokjának és Apple Watch szíjának második generációja.

Új hozzászólás Aktív témák

-

tibaimp

nagyúr

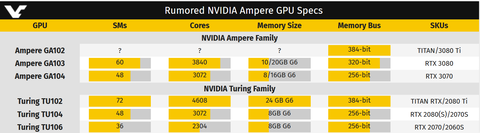

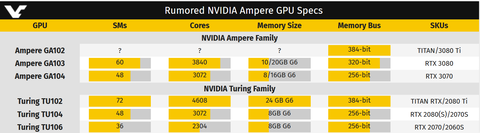

Ha ez így igaz, akkor nem lesz semmi. Az én 2070-ben van 2304 cuda mag, a 3070-ben meg 3072. Jelenleg a 2080 Super-ben van ennyi, ehhez még hozzá jön egy kis optimalizáció plusz órajelek, és simán +40-50% gyorsulás az előző generációs 2070-hez képest. De lehet keveset írtam...

A tehén egy bonyolult állat, de ÉN megfejtem...| 2016-tól az tuti, hogy az angyalok is esznek babot...

-

Puma K

veterán

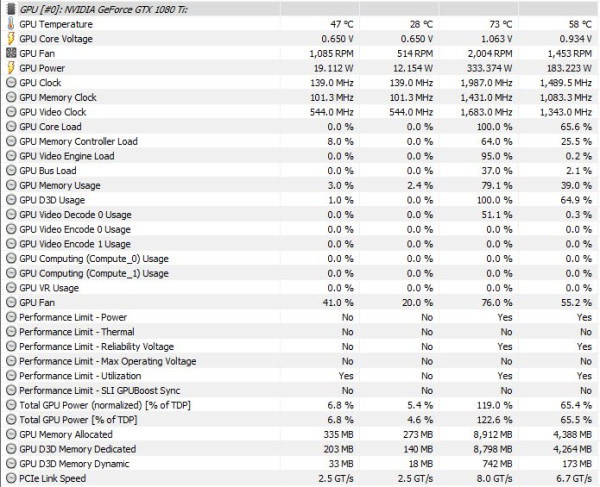

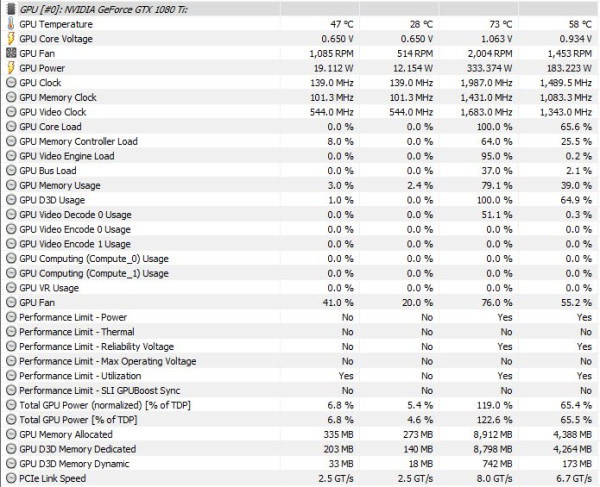

Múltkor arra lettem figyelmes, hogy a Division 2 képes majdnem 9GB-nyi VRAM-ot használni:

15 órás nyúzás során más-más játékkal játszva jöttek ki ezek a maximum értékek a VGA-nál.

Overwatch inkább a GPU hőmérsékletet tornássza fel 70°C környékére, viszont a VRAM-ot tuti a Div2 hozta össze.

"Cuccok: csattogós lepke és tiki-taki" └[ʘヘʘ]┘

-

GreatL

őstag

Fele fogyasztás lesz (a kocsmában), dupla teljesítmény (a munkahelyen) és harmadannyiba fog kerülni (használtan)!

Intel Core i9-9900K víz | 32 GB | GBT RTX 3080 Ti Gaming OC | 48" LG C1 TV | Samsung(.hu) Galaxy S22+ 256 Vodával | Voda Samsung Galaxy A54 | Pocketbook Inkpad 3 Pro

-

-25% fogyasztás lesz idle-ben, másfélszeres teljesítmény úgy, hogy megint elcsúsztatják egymáshoz képest az árérzékeny kategóriákat (mint ahogy pl. sokkal inkább az RTX2060 volt a GTX170 utódja, mintsem az RTX2070), és olcsóbb lesz annyival, hogy most talán nem emelik meg az egyes kategóriák nyitóárait, és a félgenerációs frissítéskor sem, így egy év múlva egész megfizethetőnek néznek majd ki az eredeti modellek ... használtan.

TV/monitor kalibrálást vállalok. ||| "All right , Thom. But understand this: I do care for you. I care for all the lost souls than end up up here."

-

Puma K

veterán

-

tibaimp

nagyúr

válasz

Televan74

#58

üzenetére

Televan74

#58

üzenetére

Sajnos igazad lehet!

Puma K: az OK, de az LG monitor ami a leírásodban szerepel, ha jól látom 1440p-s, vagyis azon a natív felbontásán nyomtad gondolom, vagy valamit elnéztem?

[ Szerkesztve ]

A tehén egy bonyolult állat, de ÉN megfejtem...| 2016-tól az tuti, hogy az angyalok is esznek babot...

-

Puma K

veterán

A 2560x1440 a monitorom natív felbontása.

De az Nvidia driver-ből lehet szorzókat állítani a DSR részen adott játékra-program vonatkozóan ami adott mértékben az adott monitor natív felbontását felskálázza.

Így tudok 2560x1440 felbontás helyett 5120x2880-as felbontásban játszani a GTA IV-gyel.

De ha az adott játék grafikai beállításainál ott a lehetőség a felskálázásra, akkor azt használom.

A GTA V-öt így futtatom 2560x1440 helyett 1,750 szeres felskálázással 4480x2520-as felbontáson.

"Cuccok: csattogós lepke és tiki-taki" └[ʘヘʘ]┘

-

Ragnar_

addikt

"De leszarom.

Hasznalj amd-t.

Csak ne terits.

Nekem volt anno 6 egymas utan.

Azert olcso mert szar..."Melyik piacvezető Intel is felezte a teljes HEDT termékpalettája árát , mert az AMD asztali teteje 3900x verte a teljes Intel HEDT felhozatalt ? Ott ahol nem a 4-6 magig skálázódó konzolport játékok vannak, hanem olyan szoftverek amik kihasználják a korszerűbb gyártástechnológiát ?

"Tele a youtube 9900kf vs ryzen 3800x osszehasonlitokkal.

A battlefiled 1-ben 50+ fpst vert a ryzenre. Pedig jo sok szalat kepes hasznalni a frostbyte.

A cinebench amit mutogatni lehet csak."Első video Youtubeon 9900k oc vs 3800x BF1 188vs184 FPS.. RTX 2080OC-val Ultrán. Oke én értem, hogy ott a 2080Ti is, de már a 2080OC is 250k egy Ti pedig már 400.

És nagyságrendileg ugyanez a helyzet a többi játékban is. Mindez biztonsági rések nélkül olcsóbban. De nem akarlak semmire rábeszélni, ha Intel fan lennék lehet, hogy én is inkább sima 6 magos i5-öt vennék HT-s 6/12-s R5 helyett 65k-ért. (Ami meg ugye olyan, mint a 8700k)![;]](//cdn.rios.hu/dl/s/v1.gif)

[link][ Szerkesztve ]

Ryzen R5 1600X - ASUS PIRME-B350 PLUS - 2x8Gb G.Skill Aegis 3GHz - Gigabyte 1070 G1 Gaming

-

sb

veterán

Igen, kicsit el van tévedve a kolléga.

CB single-ben R20-ban konkrétan gyorsabb a 3900X 4.6-os max boosttal mint a 9900K 5GHz-en. CB15-ben meg 1-2% a lemaradása.Szóval nem előny az 5GHz, jobb az IPC a másik oldalon és így kisebb órajelen lassan fele annyi fogyasztásból hozza a csúcsot is. Az optimumot 3-4GHz között (rohadt sok magnál) meg még nagyobb perf/W aránnyal hozza.

Ezen kívül érdemes még megnézni a multitasking teszteket is, Compterbase-en mérték, ott is gyorsabb volt az AMD két feladattal, azonos magszámmal, mint az Intel. Nem nagyon van már olyan terület ahol nemhogy kikapnának, de egál helyett ne húznának el.

A játék optimalizáltság még igaz. 200fps felett meg 3-5%-nyi előnyre ott még lehet "verni".

-

Puma K

veterán

válasz

Black-core

#64

üzenetére

Black-core

#64

üzenetére

Milyen VGA kártyád van?

"Cuccok: csattogós lepke és tiki-taki" └[ʘヘʘ]┘

-

-

Prof

addikt

válasz

antikomcsi

#21

üzenetére

antikomcsi

#21

üzenetére

Jatekok latvanyvilagat mindig a mainstream olcso gepek teljesitmenye szabja meg, es az utobbi evekben mar nagyon regen a konzoloke. Ha jonnek erosebb konzolok akkor par eve mulva lesz pozitiv valtozas es nem csak az fps/felbontas hajhaszas megy majd.

Kb. 80% Pc jatek konzolport, sot lassan mar rengeteg mobilport.

Ennek ellenere veszik a hulladek Rdr2-t, igy is sok evvel a konzol megjelenes utan. Ami amd hardverre tervezett jatek ellenere pcn rosszabbul megy amd-n, mint nvidian vmi csoda folytan.. -

-

M107

addikt

válasz

Televan74

#70

üzenetére

Televan74

#70

üzenetére

Elég gépigényes game is, tegyük hozzá bár nem az én világom ettől persze lehet imádni.

megnéztem High preset, 880K 16 GB DDR3 1866 mhz, ITX Sapphire Pulse 570 4GB 22-35 Fps stabilan.A fórumon, bármit leírhatsz, én csak az igazat írom le. :) Utálom ha hülyének néznek ! - Addikt - vissza az őstag címet :) )

-

"22-35 Fps stabilan" -> LOL Mióta stabil az, ami (35-22) / ((35+22)/2) = 45, tehát kb. +/- 22%-ot ingadozik fel/le az átlagtól, illetve a minimum érték felétől (12) nagyobb a mozgástere (13)? Vagy úgy érted, hogy nem fagyott ki a program?

TV/monitor kalibrálást vállalok. ||| "All right , Thom. But understand this: I do care for you. I care for all the lost souls than end up up here."

-

Puma K

veterán

-

X Factor

addikt

Ha a 8/16 helyett tényleg 10/20-as felállásban is lesznek elérhető kártyák, akkor a renderfarmok nem csekély mennyiségű 1080-at és 1080ti-t boritanak a használt piacra

Make things work

-

carl18

addikt

Ha a RTX 3060 tudja a RTX 2080 szintjét már nagyon jó kártya lesz. 8 gig a ramot tuti megkapja...+ Főként az árazás lesz a lényeg.

Pont valamelyik nap néztem a GTX 1660 jelenleg olyan gyors mint egy GTX 980TI. Szerintem az elég jónak számit

Hiába szúr, itt Ryzen a úr!

-

<Lacy85>

addikt

"Pont valamelyik nap néztem a GTX 1660 jelenleg olyan gyors mint egy GTX 980TI. Szerintem az elég jónak számit"

Ez kb. mindig is így volt. Az aktuális széria tagja mindig olyan teljesítményű, mint előző generációban az egyel nagyobb számozású.GTX 980 = 1070 = 1660Ti

GTX 780 = 970 = 1060

GTX 770 = 960 = 1050Ti, stb. -

A GTX 980 teljesítményét az 1060 hozta, nem az 1070. az a 980 Ti-t hozta.

Ha Pascal szintű előrelépést szeretnénk akkor a 3070 nek a 2080 Ti-t kellene hoznia.[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

#00137984

törölt tag

Megint Nvidia videókártyára leszek kénytelen váltani, de remélem a GTX 1070 Ti még évekig állja majd a sarat. Amig a játékok fejlődése nem olyan látványos, miközben a játékélmény alig változott, és még ez a Ray Tracing sem érdekel...

-

#00137984

törölt tag

Csak halványan megjegyezném, hogy minden más CPU-t mellőző témát elemző cikkben (Nvidia videókártya) a Ryzen procikról olvasni nekem már nagyon unalmas és alkalmasint átugrom ezeken... Nem igazán érdekel.

[ Szerkesztve ]

-

Prof

addikt

Sajnos a jelenelgi 2060 learazas nekem azt sejteti nem akarnak ezek egyhamar 3060at kiadni, csak a 3070,3080 fog jonni. Valoszinu sokkal jobb raytracing miatt nem akarnak a 2070/2080-nak konkurrenciat egy dragabban 7nm-en gyartott kartyaval ha AMD nem kenyszeriti oket.

En ugy latom az NVidia ul a piros gomb elott amin az van gyartas indit 7nm-en, azonnal megnyomjak ha kijon megbizhato info a Nagy Navirol (felteve ha versenytars a highend szinten nekik). Addig is gyujtik a zsetont az olcson 12nmen gyartott kartyakkal es soprik a keszletet. -

Prof

addikt

válasz

#00137984

#80

üzenetére

#00137984

#80

üzenetére

Azert vard ki az uj 7nm-es Nvidiat/ illetve Nagy Navit. Valoszinu atrendezi az ar/ertek feature kategoriakat.

Amig jelenlegi konzolgenre tervezik jatekokat, sokat ne varj olyan 2-3 ev mig kovetkezo konzolgenre, illetve Stadia/egyeb cloud streamszerverre (5g elterjedesere idozitik) tervezett jatekok jonnek. Hiaba csinalt MS "szuper eros" Xbox One X konzolt ott malmoznak es alig van ra jatek ami kihasznalja, mert nem az az elterjedt etalon mainstream konzol.

Szerintem az Intel is akar 2-3 ev mulva ertekelheto cloud szerverbe rakhato gpukat gyartani, akar multigpu tamogatassal.

2020 a hype eve, igazi valtozasokat kb. 2022-23 fog hozni, ha minden terv szerint megy. -

Prof

addikt

válasz

Televan74

#70

üzenetére

Televan74

#70

üzenetére

Megneznek vmi frame per frame osszehasonlitast AMD-n es NV-n adott grafikai beallitasok mellett szerintem valami susmus van, nem azonos dolgok futnak le egyik ill. masik kartyan.

Nagyon sok fpst lehet nyerni szinte lathatatlan grafikai reszletesseg butitasokkal, amit mondjuk a Geforce driver szinten megcsinal ha detektalj a jatekot.

Amikor jonnek az Intel igp ilyen megy olyan gyros mar az AMD APUval szemben ott altalaban rosszabb a grafika az intelen nem csoda, hogy gyorsult... -

MeszesKPT

őstag

A cloud gaming már 10 éve hype szinten van és még vagy addig az is marad, semmi több. Google-nek sem sikerült megugrani a lécet, érdemes olvasni a felhasználói számokról.

Amperet illetően szerintem aki eleve nem a mostani középkategóriában nézelődik, annak érdemes most már kivárni.

-

egyedülülő

őstag

Izgalmas dolgok ezek. A 2070-emet szeretném váltani akár Superre vagy sima 2080-ra. Nem tudom milyen árban lesznek ezek az új kártyák, megéri e várni.

"Ha lenéznénk az űrből a földre, nem látnánk az országhatárokat. Csak egyetlen kis bolygót látnánk."

-

BeZol

őstag

Tetszenek az 1% és 0.1% Low értékek... Néhol 1/3 annyi, mint Intelnél. Ez pont az, hogy be-beakad a játék érzésre, mert olyan kevés fps-re ugrik le. EZ PONT AZ, AMIT MINDENKI UTÁL! Vesz egy drága gépet, és be-beakad neki a játék, szánalmas. Aláírom, sok játékban rendben van a dolog, DE ha TE épp azzal játszol rendszeresen, aminél ezt produkálja?! Vagy kijön egy új játék amivel tolni akarod és épp nincs normálisan optimalizálva AMD-re és hasonló mikrolaggokat érzel, akkor kb. felgyújtanád a gépedet... EZ ÍGY LUTRI!

Tudom, hogy nincsenek egy árban a procik (bár cserébe alaplapoknál amd drágább), de INKÁBB költenék egy olyan gépre többet, aminél nincsen mikrolagg/stuttering ÉS minden játékban hozza ezeket a jó értékeket, minthogy majd xy játéknál ami épp érdekel szívjam a fogamat... És ez nem csak AMD processzorokra igaz, hanem AMD videókártyákra is. Elég olvasni a navi-s topikot, mennyi driver probléma van a kártyákkal MÉG MINDIG! (szeptember óta!!!) Szóval ha valaki a nyers benchmarkokat nézegeti és mellé az árakat, akkor AMD-t vesz, viszont kicsit a dolgok mélyére ásva már problémás az egész.Nekem volt AMD videókártyám még anno 4870+4890 hibrid crossfire-ben. CS:Source alatt nuke-on fényproblémák voltak (sose javították ki), Battlefield Bad Company 2 béta még tökéletesen ment, mikor kijött a végleges játék, már nem ment a crossfire. 1,5!!!! évvel később jött egy driver, amivel működött, de a rákövetkező driverrel már nem ment! Jött ki később másik játék ami miatt kellett az újabb driver, és nem tudtál egyszerre a két játékkal játszani, mert más vga driverrel mentek rendesen a kártyák... Az új 5xxx széria topikjába beleolvasgatva pontosan ugyanezek a problémák vannak most is, csak már crossfire nélkül 1 kártyával... A legjobban azon röhögtem, mikor vki nem tudott LoL-ozni, mert a launcher crashelt a vga driver miatt

, érdemes végigolvasni a problémákat, kinek épp mi jön elő, BOTRÁNY!

, érdemes végigolvasni a problémákat, kinek épp mi jön elő, BOTRÁNY!Volt Ryzen 7 1700X-em is, ami mint már tudjuk nem egy fényes széria (de akkoriban a benchmarkok kb. nem ezt mutatták, az tegyük hozzá!), az is botrányos volt több játékban, mert az átlag fps is pocsék volt sok helyütt. Konkrét példa nekem a World of Warcraft (amit csak több millióan tolnak napi szinten, régi játék, és nem egy új AAA cím ami jobb esetben 3 hétig van nyüstölve és megy a levesbe). Gondoltam 8mag16szál, tökéletes lesz x264 alapú streamelésre a proci, a probléma csak az volt, hogy míg questelgetéskor és 5fős instákban tulajdonképpen rendben volt az fps (talán 75 alá nem ment és 100-120 körül voltam), addig raideken 20fővel (mythic raid) ÁTLAG 38fps-em volt!!! Ki kellett kapcsolnom az SMT-t, hogy 8/8 legyen, fel kellett pöckölnöm 3.85GHz-re (3.9ghz-en már eldobta magát), és így 55 körüli fps-re tudtam feltornászni, akkora CPU limitem volt (mert inkább 1-2szálat használt csak a játék), mindezt 1080Ti-vel! Aztán így már gondoltam mehet a streamelés, igazából 3.7ghz-en is eldobta magát a gép x264 kódolással olyan 2 óra játék után, és az fps is botrányos volt már így is, úgyhogy hagytam a fenébe. Az új 3xxx széria már aláírom egész jó lett, de az igazi konkurencia (játékok szempontjából) a 4xxx széria érkezésével érkezhet meg az Intellel szemben, mert akkor az IPC + órajelnövekedés + javított memóriakezelés következtében pariban kellene lenniük, már csak a minimum fps-ek lehetnek problémásak. Ha még ott is pocsék lesz, akkor játékra továbbra is felejtős, mert visszatérve, mi van ha épp abban a játékban szerencsétlenkedik a proci, amivel rendszeresen játszanék?

BF V-nél bejön a single player benchmark... Gondolom te sem nyomod neten 64 fővel. Ezeket a beépített benchmarkokat lehet nézegetni meg postolgatni az eredményeit, de hogy a játékban töltött idő 99%-ában nem single playerben fognak az emberek ilyen és ehhez haosnló játékokat nyomni, az is biztos. Itt egy régebbi BF V ryzenes teszt 1080p-ben, ahol pl. látni érdemes, h ez a 2xxx-es ryzen képtelen volt 130as átlagfps-nél többre, ergo már egy RTX 2070-essel "kimaxoltad" a játékot (minimum fps alapján látni, h 5% körül még abban is hagyott!), kár volt RTX 2080 v. 2080Ti-t vásárolni, mert képtelen volt kihajtani. De ez csak egy BF V, ami köztudottan jól optimalizált játék, és már van 3xxx ryzen és fél éven belül itt a 4xxx, viszont minden egyes játéknál utána kell nézni, hogy mit alakít az adott processzor xy videókártyával "VALÓS" játékkörülmények között!

Nekem pl. a WoW fontos, és ott nem minden virít úgy, ahogy kéne, még az olcsó 8700K sem (4.2ghz-es proci, 40% körül kihajtott RTX 2060 és 40 fps körüli érték... és ez még nem a raid része a dolgoknak, AHOL KRITIKUS h akad-e a játék vagy sem)!

PUBG sem fenékig tejfel: Ryzen 1080p-ben 2080Ti-vel (tudom túlzás, nem átlagos kártya) csak 60-70%-on hajtja ki a videókártyát, az Intel pedig 85%+, és 120 helyett 180 fps-ek vannak...A lényeg, h vásárlás előtt tájékozódni kell, h xy játékkal van-e probléma vagy sem. Aki nem akar tájékozódni, az vegyen Intelt és Nvidiát, mert ott minden úgy megy, ahogy mennie kell. Azóta nincs driver problémám, random beakadozgatás, semmi idegeskedés, minden úgy működik ahogy működnie kell, és ennek így kéne lennie AMD-nél is, de "még" nem sikerült nekik.

Mindenkinek tájokozódnia kell, hogy a saját felhasználásához mi a jó vétel, és nem szabad minden benchmarknak hinni!!! És igen, lesz amihez AMD-t érdemesebb vásárolni, és lesz amihez Intelt, DE be kell látni, hogy annak ellenére, hogy papíron azonos v. jobb teljesítményt olcsóbban kínál az AMD, annak bizony van árnyoldala is, ahogy fentebb is leírtam pár példát, de aki meg munkára használja, ott megint programonként változhat, hogy most melyik gyártó a nyerő választás.

-

nuke7

veterán

hát, a 0.1% nem érzed semmennyire, én legalábbis biztos nem...

az 1%-ok meg elég közel vannak egymáshoz a linkelt videóban... szóval lehet magyarázni bizonyítványt, de nem véletlenül van most az intel lépés kényszerben

Én witcher 3-al sokat játszom, direkt visszatekertem a videót, nem látom egyszerűen azt a 0.1% "mikro-lag"-ot..

Szerintem az AMD + nvidia a nyerő páros

[ Szerkesztve ]

https://youtube.com/user/nuke7

-

BeZol

őstag

Én is ebben reménykedek, pont pár napja számolgattam haverommal, hogy nyers feldolgozóegységek alapján +20%-ot mindenképp tud a 3070-es egy 2070 Super-hez képest (nem a sima 2070-hez képest!). Ehhez jön még, hogy jobb órajelek várhatóak.

Anno 980Ti és 1070 viszonylatban (28nm vs 16nm) a memória GDDR5 maradt (GDDR5X-et 1080 és felette kaptak, 1070Ti GDDR5 maradt), csak 1750MHz helyett 2000MHz (+14%), a CUDA magok száma 2816-ról 1920-ra csökkent (+46% gtx 980Ti-nek), és az alap gpu clock 1000MHz-ről 1500 fölé ment (+50%), közben a turbó is pöttyet jobb lett persze, fogyasztás is csökkent, ÉS egyforma erősek lettek! Tehát hiába csökkent a feldolgozóegységek száma, ezt órajellel ellensúlyozni tudták.Most jönnek a kérdések, hogy vajon GDDR6-ban mennyi tartalék lehet órajelnövelésre (talán semennyi

), de ha szimplán azt nézzük, 28nm-ről 16nm-re ugrásnál (57,14%-osra kicsinyítés) tudtak kb. +50% órajeltöbbletet adni a gpu-nak, akkor 12nm-ről 7nm-re ugrásnál (58,33%-osra kicsinyítés, tehát majdnem ugyanakkora előrelépés!) is képesek lehetnek erre, hiszen minden egyes nm-beli ugrásnál magasabb órajeleket kaptunk kisebb fogyasztással párosítva (980Ti 250W, 1070 160W, ami egyben kb. a kicsinyítés mértéke úgy, hogy h a kevesebb nyers erőt +50% órajellel megpakolták és kb. egyforma a két kártya).

), de ha szimplán azt nézzük, 28nm-ről 16nm-re ugrásnál (57,14%-osra kicsinyítés) tudtak kb. +50% órajeltöbbletet adni a gpu-nak, akkor 12nm-ről 7nm-re ugrásnál (58,33%-osra kicsinyítés, tehát majdnem ugyanakkora előrelépés!) is képesek lehetnek erre, hiszen minden egyes nm-beli ugrásnál magasabb órajeleket kaptunk kisebb fogyasztással párosítva (980Ti 250W, 1070 160W, ami egyben kb. a kicsinyítés mértéke úgy, hogy h a kevesebb nyers erőt +50% órajellel megpakolták és kb. egyforma a két kártya).Tehát a kicsinyítés mértéke közel azonos lesz a gyártástechnológiának köszönhetően, csak 28nm -> 16nm helyett 12nm -> 7nm.

Azt már tudjuk, hogy 2070 Super-hez képest +20% nyers erő biztosan lesz a 3070-esben (legalábbis pletykák alapján).

Ha 980Ti kontra 1070 horderejű váltás lenne, akkor az RTX 2070 Super 2560 CUDA magja = 1742 CUDA magú 3xxx szériájú kártyáéval +50%-os órajel mellett (210W helyett 140W-tal), ergo az RTX 2070 Super utódja 1742 CUDA magos 3xxx lehet +50% gpu clock-cal (1605MHz-es Base Clock-ról 2400MHz-es Base Clock, és ezekre jön a turbó érték), ami így leírva a "hihetetlen" kategória, de gtx 9xx széria 1000-1100MHz-es base clockjai után az 1070-es 1500 feletti értéke is annak tűnhetett!

Az RTX 3070 pletykált 3072 CUDA magja az RTX 2070 Super erejének megfelelőjű 3xxx szériás 1742-höz képest +76%.A nagy kérdés, hogy az órajeleket mennyire tudják feltornászni. Nyers erő alapján +20% a minimum előrelépés 2070 super -> 3070 viszonylatban, a fentebbi kalkuláció alapján pedig +76% is lehetséges. A végeredmény valahol a kettő közé várható.

Techpowerup-os összesítések alapján a founders edition-ös 2080 Ti a founders edition-ös 2070 Super-re 1080p-ben 24%-ot, 1440p-ben 31%-ot, 4k-ban 37%-ot ver.

HA csak 20%-kal lenne erősebb a 3070-es, akkor 2080 Super környékén tanyázna a teljesítménye, HA viszont 76%-kal lesz erősebb, akkor 2080Ti-t is kenterbe veri.

HA abból indulunk ki, hogy anno a 980Ti teljesítményét hozta az 1070-es, akkor legalább 24-37%-kal kéne erősebbnek lennie a 3070-esnek a 2070 Super-nél.A kérdés az, hogy mennyire tudják és akarják kiaknázni a gyártástechnológia nyújtotta lehetőségeket, mert piacra dobhatnak "csupán" RTX 2080 Ti erejű kártyát is 270W körüli fogyasztás helyett 180W-tal, 2/3 annyi feldolgozóegységgel és 50%-kal gyorsabb base clockkal.

Az RTX 3080-as specifikációi alapján, hogy 3840 CUDA magja lesz, ott pedig a 2070 Super-hez képest akár 2,2-szeres teljesítménybeli ugrás is lehetséges.

Ez 1440p értékek alapján

RTX 2070 Super: 100fps

RTX 2080 Ti: 131fps

RTX 3070: 176fps

RTX 3080: 220fpsA pletykák alapján "According to Taipei Times, the new GPU based on the Ampere architecture would use 7-nanometer chips, which would boost performance by 50% and halve power consumption" nem fognak 76%-ot gyorsulni, hanem csak 50%-ot, DE a 3070-esben +20% CUDA mag lehet, ergo már majdnem meg is van a 76%

Lesz itt gyorsulás kérem szépen , csak ne legyen az, hogy megint drágul minden és 600ezer Ft lesz egy 3080 Ti...

, csak ne legyen az, hogy megint drágul minden és 600ezer Ft lesz egy 3080 Ti... -

szerintem nem szabad nagyon sokat várni,ha valóban nem lesz áramemelés ahogy pletykálnak róla. egészséges 30-35 % -t érdemes várni RT ben pedig ennél jóval több gyorsulást remélek.

Bizakodásra ad okot, hogy a Turinggal ellentétben újra xx4 GPu-t kap a 3070, mint a Pascal esetében, azaz azt amit most a 2080 kapott így a 3060 képes lehet egy 2080 sebességére.Már persze ha a pletykák igazak.

Videocardz.[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

egyedülülő

őstag

Ezt a 3060 hozza a 2080 szintet enyhe túlzásnak érzem.

"Ha lenéznénk az űrből a földre, nem látnánk az országhatárokat. Csak egyetlen kis bolygót látnánk."

-

válasz

egyedülülő

#94

üzenetére

egyedülülő

#94

üzenetére

pedig azt hoznia kellene 350 dollárért( ha annyi lesz mint ahogy mondják, hogy nem változik az ár az alsó szegmensben a felsőben pedig csökken valamelyest) ha versenyképes akar lenni a 400 dolláros 5700 XT vel.

Pascalnál már volt erre példa.[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Ragnar_

addikt

Szerintem a16-20Gb VRAM lehet, hogy nem is a 4K-hoz kell majd, hanem az RTX teljesítményhez.. De ez csak tipp. Manapság valóban semmi nem eszik 12Gb VRAM-nál sokkal többet 4K-ban sem.

[ Szerkesztve ]

Ryzen R5 1600X - ASUS PIRME-B350 PLUS - 2x8Gb G.Skill Aegis 3GHz - Gigabyte 1070 G1 Gaming

Új hozzászólás Aktív témák

ph Az NVIDIA következő GPU-generációjáról egyre több információ lát napvilágot, az más kérdés, hogy mennyi igaz ezekből.

- BESZÁMÍTÁS! GIGABYTE WindForce 2X GTX 960 4GB GDDR5 videokártya garanciával hibátlan működéssel

- BESZÁMÍTÁS! SAPPHIRE RX 460 2GB GDDR5 videokártya garanciával hibátlan működéssel

- BESZÁMÍTÁS! Gigabyte AORUS MASTER RX 6800XT 16GB GDDR6 videokártya garanciával hibátlan működéssel

- GIGABYTE RX 6700 XT 12GB GDDR6 AORUS ELITE Eladó! 102.000.-

- PowerColor RX 6700 XT 12GB GDDR6 RED DEVIL Eladó! 105.000.-

![;]](http://cdn.rios.hu/dl/s/v1.gif)