- HiFi műszaki szemmel - sztereó hangrendszerek

- Fejhallgató erősítő és DAC topik

- NVIDIA GeForce RTX 4060 / 4070 S/Ti/TiS (AD104/103)

- Hobby elektronika

- VR topik (Oculus Rift, stb.)

- Canon MILC: EOS R és M topik

- ZIDOO médialejátszók

- OLED TV topic

- Hogy is néznek ki a gépeink?

- Kormányok / autós szimulátorok topicja

Hirdetés

-

Toyota Corolla Touring Sport 2.0 teszt és az autóipar

lo Némi autóipari kitekintés után egy középkategóriás autót mutatok be, ami az észszerűség műhelyében készül.

-

LG 34GS95QE-B: OLED paneles, ívelt gamer monitor

ph Félmillió forintba kerül az LG új, 240 Hz-es gamer monitora. Megnéztük, mit tud!

-

Lopják az LG akkutitkait

it Inkább licenceli ezentúl az akkumulátoros szabadalmait az LG Energy Solution, mert túl sok a jogsértés. Az LGES mellett az UMC is az autóipar egyre lassuló keresletére figyelmeztet.

Új hozzászólás Aktív témák

-

Tigerclaw

nagyúr

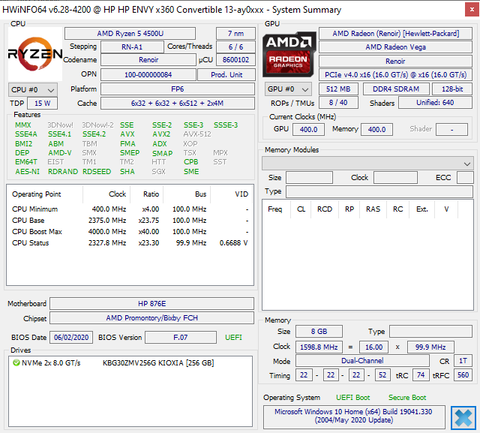

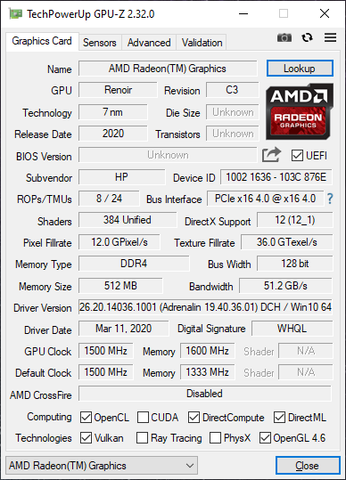

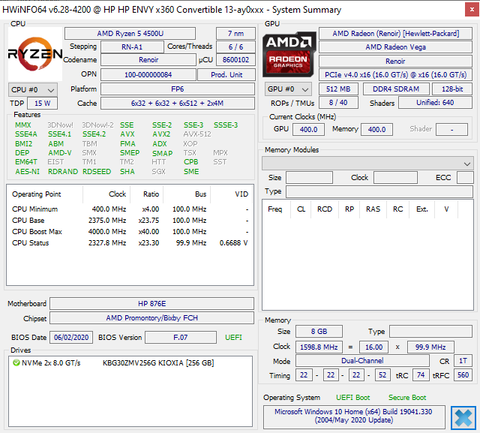

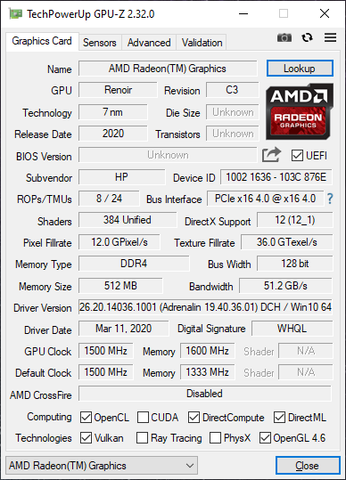

Ha nincs dGPU, csak a SoC-ban levo IGP akkor ez nem limital semmit ugye?

Masik kerdes: A Renoir eseten van mod beallitani hogy mennyit kapjon VRAM-kent a rendszermemoriabol? Van ahol azt irtak a BIOS-ban allithato, van aki szerint csak keves RAM-ot lehet atadni, mas meg azt irja, hogy az OS automatikusan ad tobbet, ha kell. Melyik az igaz?

Az a baj a világgal, hogy a hülyék mindenben holtbiztosak, az okosak meg tele vannak kételyekkel.

-

Abu85

HÁZIGAZDA

Nincs valós hatása, hogy mennyi RAM-ot állítasz be a BIOS-ban. Amelyik program nem köti a beállításokat a VRAM mennyiségéhez, akkor 64 MB-ot is beállíthatsz, és ugyanúgy fog futni, mintha mondjuk 2 GB-ot állítanál be. Az a BIOS paraméter csak a jelentéshez kell, de valójában UMA a rendszer. Viszont sokat nem éri meg beállítani, mert amit lecsípsz azt nem érheti el a CPU. A 64 MB is elég dobni neki, a mai modern programok felismerik, hogy UMA rendszeren futnak, és úgy is kezelik őket.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Geri Bátyó

őstag

Én ahogy az ismerőseimtől hallom és itt az oldalon olvasom ,a vékonyság csak a gyártók marketing marhasága és a legkevésbé sem a vevők igénye. A vevők inkább jobb hűtést (ezért csöndesebb gépet), nagyobb aksit, több és többféle csatlakozót, esetleg bővíthetőséget szeretnének és pont nem érdekli őket, hogy a 8 PCI-E sáv elhagyásával megint vékonyabb lett a gép 0.1 mm-el.

"Ki a büdös istennyila vagy te bohócképű!?" SzŐr Geri, birodalmi poéta és főszakács (:L topic)

-

Tigerclaw

nagyúr

-

Armagedown

őstag

válasz

Geri Bátyó

#3

üzenetére

Geri Bátyó

#3

üzenetére

Ugyanúgy van ez a dolog, mint a nagyméretű mobilokkal, ott a kissebb mobilokra volna igény, legalábbis sokan szeretnének ilyet venni.

“If you don't read the newspaper, you're uninformed. If you read the newspaper, you're mis-informed.”

-

Abu85

HÁZIGAZDA

Ezért nem szabad a játékokban ellenőriztetni a VRAM méretét. Ilyenkor fel kell rakni 2 GB-ra és menni fog, de akkor is ugyanúgy egy UMA mód lesz, mint 64 MB-tal, csak kevesebb CPU memóriát kapsz.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Tigerclaw

nagyúr

válasz

Geri Bátyó

#3

üzenetére

Geri Bátyó

#3

üzenetére

Ez gondolom a gep tipusatol fugg, meg a usertol, de a fontos az lenne, hogy a vekonyitasnak, sulycsokkentesnek ne legyen hatranya es ez az amit sok gyarto nem tart be. Egyre tobb notiban futnak 90-100C fokon a processzorok es throttlingolnak, mert sporolnak a hutesen. Talan az Intel is erolteti ezt a vonalat. Van ahol premium ar eseten is nyaklik-nyeklik a noti, mert tul sok anyagot sporoltak ki. Ultrabooknal is ternek at a vastagabb, merevebb aluhazakrol, hibrid vekony muanyag/fem hazra, ami kb. az jelenti szinte hogy a munyagon van egy femfolia.

A turbo orajel miatt meg a user azt se tudja mit kap es sokan nem is gondoljak hogy a gyenge hutes miatt alig hasznalhato ki a dragabb, papiron magasabb orajelu processzor.

Az a baj a világgal, hogy a hülyék mindenben holtbiztosak, az okosak meg tele vannak kételyekkel.

-

Duck663

őstag

válasz

Armagedown

#5

üzenetére

Armagedown

#5

üzenetére

Egy csomó dolgot lehet találni. Erőlködnek a hajlított kijelzőkkel, TV, monitor, eszement baromság mindkettő, nem egyedül nézünk TV-t, monitor elé is gyakran többen kerülünk. Engem pl.: a hajlított kijelző kifejezetten zavar, 10 perc után elég is volt belőle. Egyik barátom volt oly bátor és vett egy hajlított TV-t, valami Samu, nem tudom a típust, a párja meg megkérdezte, hogy ugye azért ő is nézheti majd a TV-t...

Lehet így akarják, közelebb vinni az párokat egymáshoz?

Lehet így akarják, közelebb vinni az párokat egymáshoz?  Telefonok, lukas kijelző, bakker, ha már annyit fizetek egy telefonért, nem akarok megrágott kijelzőt látni, azért mert valamit meg lehet csinálni még nem kell megcsinálni, csak ha észszerű, vagy a vékonyság, az a menő, a nagy büdös ló....szt, annak örülnék, ha a telefon kibírja egy egész napot, anélkül, hogy töltőre kéne tennem, teszek a vastagságára. Szóval vannak marketing agyrémek. Ilyenkor látszik igazán az, hogy semmiféle valós igényfelmérést nem végeznek a gyártók. Csak a baromságaikat igyekeznek ráerőltetni a felhasználókra/vásárlókra.

Telefonok, lukas kijelző, bakker, ha már annyit fizetek egy telefonért, nem akarok megrágott kijelzőt látni, azért mert valamit meg lehet csinálni még nem kell megcsinálni, csak ha észszerű, vagy a vékonyság, az a menő, a nagy büdös ló....szt, annak örülnék, ha a telefon kibírja egy egész napot, anélkül, hogy töltőre kéne tennem, teszek a vastagságára. Szóval vannak marketing agyrémek. Ilyenkor látszik igazán az, hogy semmiféle valós igényfelmérést nem végeznek a gyártók. Csak a baromságaikat igyekeznek ráerőltetni a felhasználókra/vásárlókra.Igen-igen, még mindig Win7-et használok, és ha így haladunk még 2030-ban is így lesz.

-

Geri Bátyó

őstag

-

tasiadam

veterán

válasz

Geri Bátyó

#9

üzenetére

Geri Bátyó

#9

üzenetére

Valamibol nekik is meg kell elniuk. Es nem te vagy en leszek az, hanem az, akinek eleg ha fenyes, eleg ha vekony, eleg ha 10 percel tovabb birja az akkisja, vagy eleg ha alma van rajta. 🤷

Gyermektelen, nem házas, másodrangú állampolgár

-

sb

veterán

válasz

Geri Bátyó

#3

üzenetére

Geri Bátyó

#3

üzenetére

Ez biztos nincs így.

Eleve a bővíthetőség rétegigény, 10-ből 9.8 ember nem fogja szétszedni a laptopját.

A portok már határeset... ott az egyszerűbb ha több van, de egységsugarú user meg pont nem fog sok vackot ráakasztani.A méret, de főleg a súly meg számít. Kb mindenkinek mivel egy mobil eszközről van szó.

Én azzal kezdek, hogy alufeszelem meg a biosban turkálok de ezek még nekem is számítanak. Nemhogy átlagusernek. Mivel használati tárgy a kinézete is számít valamennyit. Na jó, nekem az a legkevesebbet, de ha lehet azért ne nézzen ki úgy mint egy 20 évesnek kinéző mai Thinkpad.

Nemhogy átlagusernek. Mivel használati tárgy a kinézete is számít valamennyit. Na jó, nekem az a legkevesebbet, de ha lehet azért ne nézzen ki úgy mint egy 20 évesnek kinéző mai Thinkpad.

-

L3zl13

nagyúr

válasz

Armagedown

#5

üzenetére

Armagedown

#5

üzenetére

Mindkét esetre vonatkozóan: gondolom nem az reklamál akiknek megfelel a jelenlegi trend, hanem azok akiknek nem. Tehát pusztán a negatív hozzászólásokból itélve, vagy egy olyan, nem reprezentatív körre alapozva, mint az oldal közönsége még nem lehet tényként kezelni, hogy nem erre vágynak az emberek.

Az mondjuk egy másik kérdés, hogy sokan csak az után szembesülnek a kompromisszumokkal, miután megvették a csili-vili szupervékony gépüket.Aki hülye, haljon meg!

-

arabus

addikt

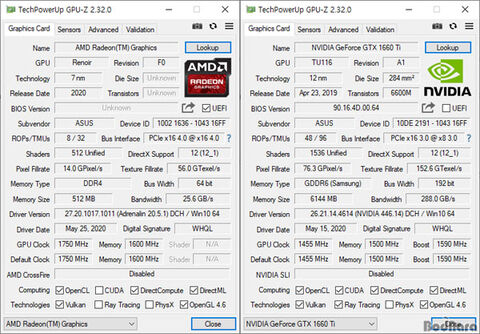

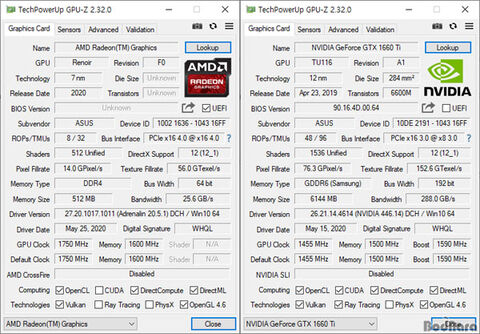

Nem kellett volna az NV lobbinak ráerőltetni a gyártókra az olcsón odatukmált

dvga-kat.

hogy a drága 2060 és 1660Ti csak x8-on megy?

minek rakatták bele?

ja hogy a procit majd jobban viszik mint az Intelét de a sok vga meg akkor hogy fogy el?

persze azért muszáj az AMD-nek azt mondani pcie 3.0 tud.

De senkinek nem kell megijedni mert a Vega ugy néz ki megy benne Pcie 4.0-án.

Xeon Platinum 8468,Ryzen 7500F,Gigabyte B650M K,Xeon Phi,i9 7960X,i9 7920X,Xeon w2135,Gskill royal 4400,Gskill Trident Z,Pico 4,Red Devil 7900XTX,Asrock W790 WS,Fury Pro RDIMM 6000,Z590,Intel Cryo,Intel 11900F,Ryzen 5600,Radeon 7600,Radeon 6800...

-

arabus

addikt

ez a számok háborúja de a végeredményt mindig az adott sin valós sebessége adja meg.

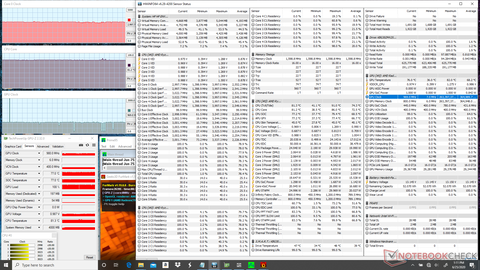

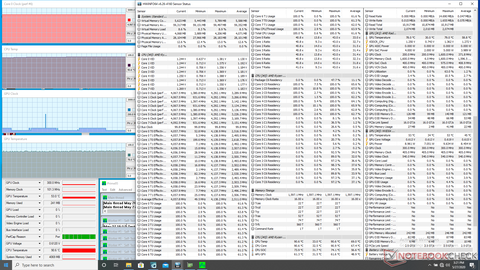

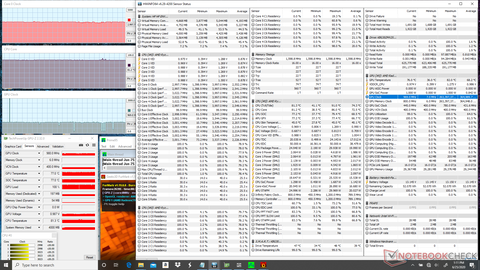

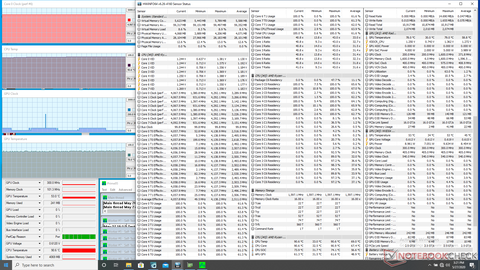

hwinfo amugy a sensors értékek közt a grafikus vezérlö rész alján pontosan jelzi.

de itt nem rx580-ról van szó.

pl.ez itt 2.5 GT/s azért az már huzós mig a vega kap 16 GT/s-t

Xeon Platinum 8468,Ryzen 7500F,Gigabyte B650M K,Xeon Phi,i9 7960X,i9 7920X,Xeon w2135,Gskill royal 4400,Gskill Trident Z,Pico 4,Red Devil 7900XTX,Asrock W790 WS,Fury Pro RDIMM 6000,Z590,Intel Cryo,Intel 11900F,Ryzen 5600,Radeon 7600,Radeon 6800...

-

Kansas

addikt

Úgy csináltok, mintha nem tudnátok, hogy VGA-szinten ha van elég VRAM, nem nagyon van szükség PCIe v3 X8-nál nagyobb sávszélességre - pl GamersNexus kimérte egy GTX1080-nal, és dual Titan V-vel is... utóbbinál látszott némi különbség. Egy másik csapat 2080Ti SLI-vel mérte, alig volt különbség(3-4%). Radeon VII esetében valamiért nagyobb a diffi, illetve az RX5500XT-nek is kell a sávszél(különösen 4GB-tal), igaz, mivel x8-ra van limitálva, a PCIe v4-ből tudja beszerezni.

Azért eget rengető különbség egyik esetben sincs, akkora semmiképp, mint a sávszélesség-diffi, szóval én baromira nem aggódnék APU-k vagy akár mobil GPU-k esetében... sokkal többet buksz a csökkentett TDP keret miatt.

[ Szerkesztve ]

Nincs olyan MI, ami képes lenne szimulálni az emberi hülyeséget... ha valaha lesz, annak tuti az emberi hülyeség lesz az oka... A Föld erőforrásai közül a legjobban az ész van elosztva - mindenki meg van róla győződve, hogy több jutott neki, mint másoknak.

-

tasiadam

veterán

Eppen ezt mondtam en is fentebb, hogy egy RX580 8x 3.0-n rohogve elvan, hiaba sirankozik a 16x-ert. 2.0bol lehet hogy 16x kell neki, de 3.0bol meg 8x. Es egy 1660 super meg rx5500 sem olyan betyar kartya, hogy kene neki 8x-nel tobb, akar 3.0-bol is.

Ha olyan nagy bottleneck a 3.0, van ertelme 5600xt-re valtanom az 580at a kesobbiekben?Gyermektelen, nem házas, másodrangú állampolgár

-

Kansas

addikt

Az RX580-at van értelme RX5600XT-re váltani, de nem a PCIe bottleneck miatt, mert az egyiken sincs észrevehető - inkább azért, mert az RX 5600 XT egy jóval erősebb kártya, FHD-ra még huzamosabb ideig jó lesz, míg at RX580-ról ezt nem lehet elmondani.

A régebbi kártya egyetlen előnye, hogy stabilabb rá a driver. Én RX480-ról váltottam Navi-ra, és jelentősen megsokasodtak a problémák driver oldalon - mostanra jó részüket kivasalták ugyan(az engem sújtók majd' mindegyikét) de még mindig vannak itt-ott megbújó bugok(bár Adrenalin drivert nem használtam Polarisra, addigra már nem volt meg a régi karim...).[ Szerkesztve ]

Nincs olyan MI, ami képes lenne szimulálni az emberi hülyeséget... ha valaha lesz, annak tuti az emberi hülyeség lesz az oka... A Föld erőforrásai közül a legjobban az ész van elosztva - mindenki meg van róla győződve, hogy több jutott neki, mint másoknak.

-

Kansas

addikt

A Navi szériából csak az RX5500XT szív a PCIe miatt, az is csak azért, mert fizikailag csak X8 van rajta kivezetve, így a PCIe v3-as lapokban kevés tud lenni(v4-es lapokban annak sincs gondja).

A többi Navinál ez fel sem merül, mert azokon mind a 16 csatorna be van kötve. Az 5600XT-nél se tudok ilyen gondról.Nincs olyan MI, ami képes lenne szimulálni az emberi hülyeséget... ha valaha lesz, annak tuti az emberi hülyeség lesz az oka... A Föld erőforrásai közül a legjobban az ész van elosztva - mindenki meg van róla győződve, hogy több jutott neki, mint másoknak.

-

#16939776

törölt tag

Mire olyan feladatot kapna a dGPU notiban amire folyamatosan indokolt lenne 16x sávszélesség a CPU és a GPU között, arra a felhasználásra nem lenne elég a CPU/GPU TDP-je, nem bírná a hűtésük kiszolgálni a folyamatos hőtermelést, és az akku sem bírná a fokozott energia igényt.

Ergo teljesen jól van, hogy csak 8 sávot tesznek közéjük, mert ahova szánják az adott terméket(laptop), ott nem fordul elő olyan eset, ahol bármilyen kézzel fogható előnye lenne a +8 sávnak, megléte viszont állandóan sújtaná az üzemidőt.Nekem ha egyszer lesz laptopom, tuti nem dVGA-s lesz, mert csak a kínlódás van vele (megbízhatóság-hűtés-zaj-üzemidő-méret), ha megoldják azt, hogy egy Apu is képes alacsony órajelen elkezelni egy "nagy felbontású" kijelzőt, akkor kivezethetik a lapos oldalára mind a 8/16 PCI-ex sávot, és arra azt dugok rá amit akarok, ha éppen valami sokkal komolyabbat szeretnék használni, mint a fedél alatt lévő hardverelemek.

[ Szerkesztve ]

-

Béééla

őstag

A bővíthetőség nem csak azért kell mert valaki majd 8 helyett 32 giga ramot akar, hanem megdöglik a vinyó és cserélni kéne, esetleg takaríthatónak kéne lennie, ilyesmik. Notiban értelmetlen a "bővítés" mert nem tud nagyon hova, a hűtés egységnyi úgyhogy úgyse fogod az erősebb procit lehűteni.

Bélabá

-

Kansas

addikt

Ezért terjednek el egyre jobban az m.2 SSD-k laptopokban, azoknak nem kell sok hely és cserélhetőek is.

Nekem a Legion Y540-emben van m.2 SSD meg egy extra 2,5" hely HDD-nek vagy SSD-nek és nem túl vaskos/nehéz a cuccos(360 x 267 x 26 mm, 2,3kg), bár valóban nem ultrabook...Nincs olyan MI, ami képes lenne szimulálni az emberi hülyeséget... ha valaha lesz, annak tuti az emberi hülyeség lesz az oka... A Föld erőforrásai közül a legjobban az ész van elosztva - mindenki meg van róla győződve, hogy több jutott neki, mint másoknak.

-

#16939776

törölt tag

Az a szervizelhetőség, nem szokták ezt a userre hagyni, ezért nem is alap kritérium, hogy te otthon fél óra egy óra alatt szét tudd szedni, kitakarítani és újrapasztázni a gépet, majd összerakni. Vannak olyan gépek amik közel alkalmasak erre, de azokat meg nem veszed meg otthonra, az ágyból filmet nézni, netezgetni.

-

sb

veterán

Értem. De én azt írtam ezzel nem foglalkozik átlagember.

Az SSD azért még cserélhető kb. minden esetben, de így is szervizben fogják kicserélni a legtöbb esetben.@Duracellm

Így van. Szóba került máshol a PCIe 4.0 támogatás hiánya is. aminek ugye SSD-knél lenne értelme... már ha van.Viszont régóta írom, hogy SSD-ben notiban is tök más a helyzet mint desktopon.

Már desktop gépben sincs kegyetlen nagy 4k iops-od ha nem fullon pörög a proci mellete. Már az is limitálja ha energiatakarékosabb sémával fut. És akkor most képzeljünk el egy 15W-os, eleve így belőtt és azonnal falba ütköző cpu-t.

Aztán második körben ott egy rakás energiagazdálkodási feature magában az SSD-ben is ami alapból aktív. Így ha a cpu nem fogná meg akkor ő maga belassít. Harmadrészt jöhet a notiban jellemzőbb hűtési gond/throttling.Anno SATA SSD-vel is szenvedtem, hogy akksiról ugyan ne lassuljon már negyed-ötöd sebességre...

Ennek tükrében érdemes nézni, hogy mennyire kell NVMe, x2 helyett x4, PCIe 3 helyet 4.0 a notikba... vagy ha be is lehet hekkelni, hogy fullon menjen, akkor az akkuidő/melegedés lesz kérdéses.[ Szerkesztve ]

-

#16939776

törölt tag

Ezzel a "Túl nagy elméleti sávszélesség - alacsony kihasználáság - ezért az energiagazdálkodás lefojtja a teljesítményt töredékére" problémával én is szembesültem, és a "megoldása" mobil eszközön tényleg nem járható.

Talán abban lehet majd haszna a 4.0-nak, hogy kevesebb vezetéken tudnak bekötni 10G-s hálókártyát, vagy TB/USB vezérlőt, kevesebb sávot kell egyszerre ébren tartani, ELVILEG ezzel lehet majd a hatásfokon javítani. Ezzel és a nagyobb sávszélességgel, ELMÉLETILEG többet lehet idle állapotban a CPU. Gyakorlatban meg ettől többet vár a CPU az adatra/eszközre, csak addig is IDLE pörög, nem tud aludni az adatra váró mag, cserébe a háttértár elalvása miatt alacsonyabb a teljes rendszer átlag fogyasztása.[ Szerkesztve ]

-

sb

veterán

válasz

#16939776

#26

üzenetére

#16939776

#26

üzenetére

Nem csak ez okozza. Vannak sokkal prózaibb megoldások.

Volt SSD-m ami simán más állapotba váltott akksiról. Így volt gyárilag belőve.Nem figyelt az semmit a kihasználtságon.

Talán írtam anno - ilyennel azóta sem találkoztam - konkrétan a win10 betöltő karika forgása lelassult ahogy kihúztad a töltőt.

Meg persze a töltési idő is, nem kicsit. Konkrétan azt nézegettem mi baja a gépnek amikor 10 helyett 30mp-ig indul a win10. De a látványosabb és viccesebb a karika volt.

Teljesítményarányos visszavétellel most épp a fordítottjával találkoztam Ryzenen.

70-75W körül eszik a gép idle. A régi (modern) gépnél már 30-40W körüli idlehez van szokva az ember. Azt láttam, hogy a ram+IF tuning eléggé meglöki az idle fogyasztást de í]y is soknak tűnt.

Most kilőttem 1-2 tray-en futó programot - köztük olat ami lóf*szt se csinál csak ott áll az állapotjelző ikonja. Hirtelen leugrott a fogyasztás 55W-ra.Azóta úgy tűnik mégsem a ram+IF okozza. Egyszerűen 1-2% terhelésre is elkezd pörögni... ill. van 1-2 program ami valószínűleg vmit szarul csinál a háttérben, lásd a fent írtat, mert azokat kilőve azért inkább visszaesik a fogyasztás és az átlagos usage nem nagyon változik. Marad ez a 0-1-2% körüli tipikus idle. De nyilván ez amúgy sem pontos kijelzés ebben a range-ben. Ami érdekes, hogy az energiatakarékos séma is segít, de önmagában nem elég. Az 1-2 progi kilövésére visszaáll de nyilván a többi fel-feléledése sokszor visszatolja 60-70W-ra. Mellé ha az energiatakarékos séma IS be van lőve akkor azzal már többet marad lent.

Persze, hogy ez hogy hat a reszponzivitásra az megint más kérdés. valószínűleg nem jól.

Mindenesetre érdekes.[ Szerkesztve ]

-

sb

veterán

válasz

#16939776

#28

üzenetére

#16939776

#28

üzenetére

Simán lehet.

Az egy használhatatlan szint volt egyébként is. HDD-s sebességekre lőtt vissza az időben. Nem csak win betöltés, bárminek az elindításán érezni lehetett. Az SSD-s ráböksz és elindul helyett a HDD-s 3-4-5mp mire megjelenik feeling volt.

Szóval az mindenképp el volt szabva a kedves gyártó (sk hynix) által. -

#16939776

törölt tag

Ezt valóban az SSD Fw.-je csinálja, de be lehet folyásrolni a "power Plan"-ben registry-ben vagy energiagazdálkodás fülön keresztül, hogy ne vegye figyelembe ha akkumulátorról üzemel a gép.

Nekem más jellegű problémám volt, desktopon, olyan hardverrel aminek eleve nem volt battery módja, sőt gyárilag nem volt energiagazdálkodása sem, mert 99.99%-os rendelkezésre állásra készült. Olyan, hogy magát a !sata kapcsolatot! low power állapotba kényszerítette az OS. ASPM

Amitől 200ms-ekre megfagyott a gép egy Alt+tab-nál, vagy ha játék közben elém spawn-olt valaki és be kellett volna tölteni egy textúrát.

Eléggé ciki ez is.

[ Szerkesztve ]

-

makkmarce

őstag

-

Abu85

HÁZIGAZDA

válasz

makkmarce

#31

üzenetére

makkmarce

#31

üzenetére

Nem a játék kezeli. Az csak ellenőrzi, hogy van-e egy bizonyos mennyiségű memória, de a Microsoft már évek óta papolja, hogy ne csinálják ezt, mert hülyeség. A működés szintjén az UMA hardverek ugyanúgy működnek 64 MB-tal és 2 GB-tal is. Mindegy, hogy a játék ellenőrzi-e, hogy van-e 2 GB memória az IGP-nek. Az újabb játékoknál szerencsére normálisan van kezelve. Ott nincs ellenőrzés.

Ugye a probléma itt az, hogy a hardver mindenképpen UMA-ként működik. Tehát a BIOS-ban meg lehetne adni, hogy csípjen le 8 GB-ot az IGP-nek, de akkor annyi történne, hogy van mondjuk 16 GB memóriád. Abból elvesz 8 GB-ot, és a maradék 8 GB-ba ír az IGP. Tehát nem oda, amit elvett. Az 99%-ban üresen fog állni.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

makkmarce

őstag

hmm.. kimentek a divatból a kikérek egy nagy területet és saját magam rendezem típusu engine-ek? konzolon ez nálunk bevett szokás volt, hogy kérünk majdnem mindent, ami van, aztán hajrá

mostanra már úgy is elfedi a 3rd party game-engine az egészet, de azt el tudom képzelni, hogy saját vram managerrel dolgozzon valaki, vagy erről már leszoktak?

mostanra már úgy is elfedi a 3rd party game-engine az egészet, de azt el tudom képzelni, hogy saját vram managerrel dolgozzon valaki, vagy erről már leszoktak?

és ha nem kap egyben memóriát, akkor hisztizik, és mondjuk 1 giga kellene neki egybe egy 4 gb memóriás gépen, ami már simán szétfragmentálódhatott.okoskodom, tehát vagyok

-

Abu85

HÁZIGAZDA

válasz

makkmarce

#33

üzenetére

makkmarce

#33

üzenetére

Konzolon eleve nem szól bele az operációs rendszer a memória elérésébe. Tehát az teljesen más téma.

A PC-n az explicit API-kkal máshogy kell a VRAM-ot kezelni, de az AMD az IGP-re más heapeket generál, mint a dGPU-kra. Az IGP azért UMA, hogy ne kelljen külön kezelni a memóriáját. Egyszerűen legyen shared az egész. Sokkal egyszerűbb emiatt az IGP-kre memóriamenedzsmentet írni. A legtöbben egyébként ezt eleve leszarják. Leszedik a githubról az AMD-nek a D3D12MA vagy VMA headerjeit. Copy-paste és ezek igazából megoldanak mindent. Szóval a közvetlenebb memóriamenedzsmenttel azt értük el, hogy nem a driver felel érte, hanem egy headert másolgatnak a fejlesztők.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

Új hozzászólás Aktív témák

ph 16-tól 24-ig már mindenféle verzió volt, de mi az igazság?

Lehet így akarják, közelebb vinni az párokat egymáshoz?

Lehet így akarják, közelebb vinni az párokat egymáshoz?  Telefonok, lukas kijelző, bakker, ha már annyit fizetek egy telefonért, nem akarok megrágott kijelzőt látni, azért mert valamit meg lehet csinálni még nem kell megcsinálni, csak ha észszerű, vagy a vékonyság, az a menő, a nagy büdös ló....szt, annak örülnék, ha a telefon kibírja egy egész napot, anélkül, hogy töltőre kéne tennem, teszek a vastagságára. Szóval vannak marketing agyrémek. Ilyenkor látszik igazán az, hogy semmiféle valós igényfelmérést nem végeznek a gyártók. Csak a baromságaikat igyekeznek ráerőltetni a felhasználókra/vásárlókra.

Telefonok, lukas kijelző, bakker, ha már annyit fizetek egy telefonért, nem akarok megrágott kijelzőt látni, azért mert valamit meg lehet csinálni még nem kell megcsinálni, csak ha észszerű, vagy a vékonyság, az a menő, a nagy büdös ló....szt, annak örülnék, ha a telefon kibírja egy egész napot, anélkül, hogy töltőre kéne tennem, teszek a vastagságára. Szóval vannak marketing agyrémek. Ilyenkor látszik igazán az, hogy semmiféle valós igényfelmérést nem végeznek a gyártók. Csak a baromságaikat igyekeznek ráerőltetni a felhasználókra/vásárlókra.