- HiFi műszaki szemmel - sztereó hangrendszerek

- Gaming notebook topik

- NVIDIA® driverek topikja

- Intel Core i5 / i7 / i9 "Alder Lake-Raptor Lake/Refresh" (LGA1700)

- Billentyűzet gondom van

- Soundbar, soundplate, hangprojektor

- Philips LCD és LED TV-k

- LG LCD és LED TV-k

- Sony Inzone M3: 27 hüvelykes gamer monitor a tesztpadon

- Milyen TV-t vegyek?

Hirdetés

-

Frissítette a DDR5 specifikációját a JEDEC

ph A JESD79-5C kiegészítés nagyobb sebességet és biztonságot hoz.

-

PlayStation konzolokra is megjelenik a Darkest Dungeon 2

gp A korábban PC exkluzív játék hamarosan végre játszható lesz konzolon is.

-

AMD Radeon undervolt/overclock

lo Minden egy hideg, téli estén kezdődött, mikor rájöttem, hogy már kicsit kevés az RTX2060...

Új hozzászólás Aktív témák

-

Ha csak renderelesrol van szo, akkor az AMD miert nem GPU-ban gondolkodik?

A 32 magos TR render teljesitmenye hogy viszonyul pl. a Vega-hoz?

Errol van teszt? En nem talaltam.

[ Szerkesztve ]

Eladó régi hardverek: https://hardverapro.hu/apro/sok_regi_kutyu/friss.html

-

QG

tag

Mert jelenleg a programok CPUra vannak megírva, és átírni ilyen kis piacra nem éri meg.

“Anti-intellectualism has been a constant thread winding its way through our political and cultural life, nurtured by the false notion that democracy means that 'my ignorance is just as good as your knowledge.'” ― Isaac Asimov

-

tibaimp

nagyúr

Lehet ebben valami. Csak magamból indulok ki! Én mostanában kezdtem követni a youtube-on több hazai stream-es csapatot, például a VR srácokat, már ők is valami 10 magos állat pc-t használnak a rendereléshez, és ők még "kicsik" is a nagy nemzetközi videósokhoz képest, és ahogy nézem, egyre többen vannak, akik ezzel kezdenek el foglalkozni. Szóval elhiszem, hogy nekik jó lehet ez a platform.

A tehén egy bonyolult állat, de ÉN megfejtem...| 2016-tól az tuti, hogy az angyalok is esznek babot...

-

Peter13

senior tag

Tudom, hogy merő perverzió, de azért úgy megnézném hogy hogy szalad egy ilyenen mondjuk egy 50+ gigás blu-ray film átkódolása Handbrake alatt

![;]](//cdn.rios.hu/dl/s/v1.gif)

(nálam most pl az van, hogy ha megveszem a lemezt, és sikerül is megetetnem a géppel, akkor 8-10 órát is simán elnyammog rajta az átkódolás, medium 265-ös beállítás mellett. Tudom, egy 2700x is sokkal gyorsabban végezne, de azért az csak más amikor mondjuk 32 mag zizereg a kupak alatt )

)"No, I'm not immortal: I'm just not good at dying..."

-

-

Fecniii

tag

Nem csak video renderelés létezik, a teljes CGI piac (film és reklám) raytracing render motorokat használ, akik közül a piacvezetők egyre inkább a GPU renderelésre kezdenek átállni és pont ezt a célcsoportot vette célba az Nvidia az új kártyákkal. Ezek a nagyon sok magos procik ezekkel a render VGA-kkal próbálják felvenni a versenyt.

-

Abu85

HÁZIGAZDA

A piacvezetők leginkább még mindig CPU-n dolgoznak, mert a tartalomvizualizációhoz egyszerűen nem akarják felvágni a tartalmat, hanem mondjuk Hollywoodban van akkora pénzügyi háttér, hogy vegyenek egy szervert 2 TB rendszermemóriával, és abba befér a tartalom. A legtöbb professzionális VGA meg sem közelíti a 2 TB-os rendszermemóriát. Egyedül a HBCC-s Vega, ami ezen a problémán túltesz, de az csak egy termék, bár elérhető belőle 2 TB memóriás verzió. Viszont a VGA-k döntő többségének a tudománya megáll 16-24 GB körüli modelleknél. Utána csak egy "out of memory"-ra képesek.

Ugyan a marketing szereti ezt a TFLOPS-okra tolni, de hiába minden TFLOPS, ha a modelled nem fér be a fedélzeti tárba. Akkor pedig jöhet a manuális munka, ami már eléggé növeli a költségeket.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Fecniii

tag

Nem vagyok a filmes részben expert de kisebb léptéknél amiben én is mozgok valamennyire sokan a GPU renderelésre kezdenek átállni, és a 48GB VRAM azért már ezen a szinten igen csak jónak mondható főleg ha NV-linken keresztül a memória megosztható, akkor 4 ilyen kártyával már elég nagy modelleket lehet kezelni. Építészeti látványterveknél meg reklám piacon nem dolgoznak giga modellekkel és azért ez is elég nagy piac.

-

Meteorhead

aktív tag

Ez nagyon szép és jó, de mikor fognak odáig eljutni, hogy rájöjjenek: általában a szerver piac szolgáltatások felére egyáltalán nincs szükség? Mi van, ha nem munkaállomásba, hanem rack-be szeretnék rakni pofátlan mennyiségű GPU-t? Nem kell a CAD hitelesítés, nem kell ECC, nem kell profi support… Szerintem nem vagyok ezzel egyedül. Igen, teljesítményben szeretnék egy munkaállomás fölé lőni, de nem kell a rengeteg maszlag. IPMI hasznos, de lehet nélküle létezni.

Azt már tudjuk, hogy ha GPU-ra kerül a sor, akkor Nvidia ugye nem is olyan rég tiltotta meg a GTX-ek adatközpontokba való telepítését. A tiltás helyett én inkább meglovagoltam volna a helyzetet. Inkább kiadtam volna, hogy ilyen felhasználásra egyedül a gyártótól lehet venni kártyát (ahogy Teslából sincs Asus vagy Gigabyte) és csináltam volna a Tesláknál olcsóbb anyagokból kártyát, de nem belesüppedve a konzúmer árversenybe és túlságosan gagyi cuccokat rakni a kártyára, cserébe viszont passzív hűtésű bordát tennék. Mindezt lehetne árulni a gamer kártyák másfél-kétszereséért és nem a tízszereséért, mint a mostani Teslákat, és a gamer kártyákhoz képest sokkal nagyobb haszonkulccsal lehetne dolgozni.

-

Abu85

HÁZIGAZDA

Hollywoodban a többség inkább saját, CPU-s szerverekkel dolgozik, illetve egyedi szoftverekkel is. De a kisebb stúdiók például bérelhetnek gépidő az AMD hollywoodi stúdiójánál, az Vegával és EPYC-kel dolgozik, és direkt azért lett odatelepítve, hogy felgyorsítsa Hollywood átállását a GPU-k felé, mert például sokkal kisebb kockázat gépidőt bérelni, mint teljesen új hardvert kiépíteni.

Bollywood az, ami főleg GPU-kra épít, mert eleve pénzhiány van ott, és nekik nem volt hozzáférésük azokhoz a hardverekhez, amelyek Hollywood számára megfizethetők. Emiatt ez a filmgyártó terület már eleve GPU-ra specializálódott. A Baahubali főleg GPU-s háttérrel készült. Múlt évben be is töltötték a teljes, 250 milliárd háromszögből álló adathalmazt egy Vegán, illetve megpróbálták egy 32 GB-os szimpla VGA-n is. [link] - 4:07-kor meg is jegyzi Rajamouli, hogy azt a fehér képernyőt látja már évek óta, mert nekik ugye a GPU-val meg kellett küzdeni azzal, hogy marhára limitált a VRAM, és a teljes adathalmaznak csak a ~0,0...01%-át tudják egyszerre betölteni. Hollywood ezzel annyira nem küzd. Vesznek 1-2 TB-os CPU-s szervereket és mehet a munka.[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

Kisebb léptékben bármi oké. Amint beférsz a memóriába rögtön jó a GPU, persze ha megfelel a biztosított minőség, meg ugye lehet venni 2 TB-os VGA-t is. Opciók tehát vannak, de ez nem jelenti azt, hogy a GPU minden területen ki tudja váltani a CPU-kat. Előbb-utóbb meg eljutunk oda, hogy ez az egész eleve összeolvad a tokozás szintjén, tehát a CPU és a GPU előnyeit egyben fel lehet használni.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

flashpointer

őstag

"Maga a renderelés igen számításigényes, és amíg egy mai HEDT processzorral nem ritka, hogy egy elindított feladat csak másnap ad eredményt, addig például a Ryzen Threadripper 2990WX még aznap végez ugyanazzal a munkával."

Remelem a jovoben legalabb blikk szinvonalra sikerul felltornazni az oldalt mert igy az ehhez kepest szepirodalom.

-

wsanyi

aktív tag

válasz

flashpointer

#14

üzenetére

flashpointer

#14

üzenetére

Szerintem ide az intel drága lesz. A lap és a CPU is sokkal drágább lesz, mint AMD TR esetében.

Az éltető nap mindig süt, még akkor is, ha néha nem látjuk, mert eltakarják a felhők, vagy mert éppen éjszaka van.

-

#06658560

törölt tag

Ezen a piacon te nem hardvert vásárolsz paraméterek alapján, hanem van egy szoftvered, és az alá veszel hardvert. hiába lenne fantasztikus GPU-val dolgozni, vagy mondjuk NV helyett Intel CPU-s rendszeren, ha az adott program valamit használ és úgy sokkal gyorsabb, akkor ahhoz igazodsz. Pl. AVX-512, ha kihasználja egy program, ellenben GPGPU-t nem, akkor nem fogsz NV vagy AMD kártyákkal a minimálisnál jobban foglalkozni. De ha nincs adott hardverre a szoftver oldaláról hivatalos támogatás, megint nem állsz le vele bohóckodni.

-

#25068288

törölt tag

Megint hülyeségeket böfögsz...

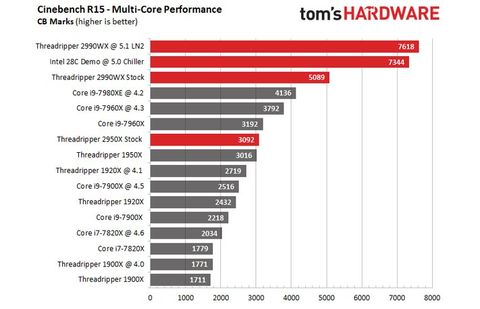

Téged ismerve, nálad a "küzd" szó, azt jelenti, hogy az AMD maradt alul és különben is az AMD szar.Holott az igazság az, hogy a TR-2990WX a 32magjával, egyenesen a pincesor alá döngölte az intelt és az AMD ezzel meg is alkotta a legerősebb desktop CPU-t.

-

#25068288

törölt tag

válasz

flashpointer

#14

üzenetére

flashpointer

#14

üzenetére

Mi ebben a bulvár?

Te is csak egy "intel a király" -huszár lehetsz...

Eszed semmi, fogd meg jól.

Miért okoz fájdalmat, hogy az AMD jót és erősebbet alkotott, mint szeretett intelecskéd?

...ne válaszolj, mert nem érdekelsz.

-

kisbalázs

tag

Most kb 7 éve bolyongok hollandiában mint látványtervező és leginkább Vray t használunk. Ennek ugyan van olyan változata ami a gpu-t használja de nem tud annyit mint a cpu verzió. Lehet bizonyos dologban gyorsabb de sokszor hiba csúszik a számolásba ezer maximum előnézethez használjuk mert ha ki kell számolni egy képet és biztos akarsz lenni benne hogy reggel azt kapod amit szeretnél akkor cpu számolás. Már hosszú évek óta hallom hogy igen mostantól a videokártyán számolunk de nagy jelenet még mindig kétséges. Autókhoz jó lehet ez

Johnny Mnemonic 2021:320gb-t töltött az agyába és majdnem meghalt, inkább pendrive a s?ggébe!

-

Mr. Spock

kezdő

Biztosan lesz igény ilyen sok magos processzorokra is néhány célterületen. Ez biztos nem az átlag felhasználót jelenti. Még jó pár évig, ugyan is mire a szoftverek skálázódnak ennyi magra, az még jó sok fejlesztési idő... meg jó lenne ha valami gyakorlati hasznát is látnánk majd a dolognak! pl. játékok alatt így már lenne bőven erőforrás normális fizikára / A.I.-ra.

egy kis off is ami eléggé aktuális,

az ilyen durván személyeskedő hozzászólások amit jack-666 megenged itt magának (18, 19) nincsennek moderálva? eléggé kimerít mindent amiért büntetés jár a szabályzat szerint!

-

Simid

senior tag

Sikerült linkelned 4 olyan esetet, amikor biztos nem fog senki sem Skylake-X procit venni (és persze Threadrippert sem), mert egy 8700K is elveri (ok, az egyikben csak megközelíti...). Nagyon nagy baj van az intel HEDT/WS szériájával ha csak ott bizonyulnak jobbnak ahol házon belül is leverik őket.

Ezzel szemben - ahogy azt egy másik topicban már leírtam - a TR kb az összes render feladat és a tömörítő, konvertáló programok egy részében toronymagasan üt mindent. Akinek pont ezekre kell, annak linkelhetsz te millió másik tesztet, akkor is ezt fogja venni. Ez egy workstation proci, aszerint kellene megítélni.

[ Szerkesztve ]

-

#25068288

törölt tag

4 olyan tesztet linkeltél sikeresen, amit a célközönség pont le se sz@r...

Ha a te szemeddel nézné mindenki, akkor nem csak a 7960, de egy 8700k is eldöngöl mindent.

Holott ez így pont nagy bullshit.

Komolyan, nem csak én, de rengeteg normális forumozó, olvasó egyszerűen nem tud téged megérteni, miért vagy egy ekkora mocskos fan és ez mellé még szélsőségesen hülye is.

Ha ezért még kapnál valami pénzt, hogy pár 'hülyét' meggyőzz a butaságaidról a hazugságaiddal, akkor nem gondolnánk azt, hogy egy fanatikus idióta vagy. Sajnos ez nem így van, te önmagadtól vagy ilyen

Kedvedért lemegyek egy kicsit a te szintedre...nézd:

-

flashpointer

őstag

válasz

#25068288

#19

üzenetére

#25068288

#19

üzenetére

Annak ellenere hogy ilyen tamadhatatlan erveket hoztal fel megis batorkodom kommentelni mivel valoszinuleg te nem ertetted hogy mi a hozzaszolasom lenyege es igy lehet hogy mas sem(habar szerintem egyedul vagy vele), ezert nekik kifejtem a problemat:

Ez a mondat bullshit, fikcio, nem mesebeli tortenetek kellenek meg a mellebeszeles hanem adatok, azzal kell ervelni hogy X feladatot Y procinal Z szazalekkal gyorsabban vegzi el nem ilyen megfoghatatlan baromsagokkal.

Azt azert megtehetned hogy a frusztralt kommenteiddel nem szennyezed legkozelebb a forumot, koszi.

-

SLYM

veterán

Ha a sötétség fájna barátom... Fogalmad nincs mire használják ezeket a CPU-kat.

Az meg, hogy nem lehet úgy elolvasni 30 kommentet, hogy azokban ne szerepelne a "blikk" szó leírva, hihetetlen. Moderátor lennék, nálam insta bann lenne minden ilyen posztoló. Lassan ugyanúgy nem fog senki itt sem kommenteket olvasni/fórumozni, mint régen az index fórumon, most meg a youtube-on.

[ Szerkesztve ]

-

#25068288

törölt tag

válasz

flashpointer

#29

üzenetére

flashpointer

#29

üzenetére

Ember olvasd el azt a pár hsz.-t is amit utánam írtak, hogy miről is beszélünk.

Rögtön megtalálnád a szuper felfogásoddal, hogy 'mi hülyék' válaszoltunk is az igényeidre.Azt sem te fogod eldönteni, hogy ki ír ide és ki nem.

Szerinted idióta vagyok és Dandris meg normális?

Akkor boruljatok össze és inkább ti ketten menjetek máshova, mert épp ti vagytok kevesebben a felfogásotokkal. -

papi77

addikt

Mindig rácsodálkozom,hogy egyesek fejében mekkora a sötétség...

Úgy védik az intelt,meg az nvidiát,mintha legalábbis az életük múlna rajta!

Fel kellene fogni; ha nincs verseny,akkor 3x os árat fog a végfelhasználó fizetni a termékért!Ja,és írom ezt úgy,hogy intel procim van!

Az első: NOKIA 1611

-

wwenigma

Jómunkásember

De fogyasztásban leveri mint vak a poharat.

Vegulis csak alig kajalt 2,2kW-ot a hutessel egyutt az intel

Vegulis csak alig kajalt 2,2kW-ot a hutessel egyutt az intel csodaprocikazán.

Steam: http://bit.ly/1rRuf8p , Origin: wwenigma -- | -- Jiayu F1 / G3C / OT995 cuccok: http://bit.ly/1w44CI2 -- | -- ZTE V5 Red Bull -> http://bit.ly/1mgtfrd -- | -- Xiaomi RN3SE -> http://bit.ly/2r8DlV7 -- | -- Live Stream: twitch.tv/wwenigma

-

#54625216

törölt tag

CG animációs cégnél dolgozom Bécsben, így első kézből tudok beszámolni arról, hogy miért is van létjogosultsága a sok magos workstation CPU-knak.

Van egy kb. 100 gépes renderfarmunk, amit 4 éve építettek, 4GHz i7 7700K procikkal.

A workflow-t kb. úgy kell elképzelni, hogy az emberek beadagolják a render feladatokat egy render managernek, az meg adott prioritások alapján kiosztja a munkát a farmnak. Mondjuk egy 160 kockás jelenetet szétszed 16 jobra, azokat kiosztja 16 gépnek, azaz egy gépre 10 kocka jut.

Ennek a megoldásnak több baja is van:

1. baromi sokat fogyaszt: 100 gép nem csak száz CPU, de ugyanannyi alaplap, táp, memória, hűtő, ssd, stb.

2. nagyon nagy az IO igény: egyszerre 100 gép lóg a szerveren (+ humanok) és még ha nem is mozgatnak hatalmas adatmennyiséget, a metadat forgalom brutális terhelést ró a rendszerre, mert egy renderjob rengeteg apró log file-t és egyebeket generál

3. a nagy fogyasztás nagy hőt is termel, ehhez külön kialakított helységek kellenek, amiben a klíma teljesítménye nagyobb, mint a renderre felhasznált energia. Értsd: ami KW energia bemegy, annak ki is kell jönnie, de mivel tökéletes hatásfokú klíma nincs, így 1KW hőre 1.5KW klíma teljesítménnyel kell számolni.

4. nehezen skálázható: ha hirtelen megugrik a render igény, akkor nem lehet egyik napról a másikra még 100 gépet csatasorba állítani, mert ahhoz újabb klimatizált helység kell, elektromos és adathálózat bővítés, stb.Na most egy 32 fizikai magos workstation ugyebár 16db. 4 magos i7 munkáját tudja átvenni. Ez azt jelenti, hogy ha az emberünk a jelenetét a saját gépén a háttérben rendereli mondjuk 28 magon, még mindig marad egy "i7-nyi" erő a gépben, hogy a következő jeleneten dolgozzon. Így elméletileg ugyan veszít némi render kapacitást, de ez időben nem jelentkezik, mert nem kell várnia arra, hogy a renderjob-ja sorra kerüljön, illetve maga a render managelése is időt vesz igénybe.

Ezen kívül ha felvesznek még 10 embert, akkor 10 új workstation-el ki lejet elégíteni a megnövekedett render igényt, nem kell +100 géppel növelni a farmot.

Sőt, egyes munkákat akár outsource-olni is lehet, mert az emberünk otthon is le tudja renderelni a jelenetet, nem kell hozzá komplett renderfarm struktúrát építenie.Persze ez még nem jelenti azt, hogy a renderfarmok innentől feleslegesek, sőt. A Blinn törvény alapján biztosra vehető, hogy a render igény az elérhető renderkapacitással együtt nő. Ha erősebb a gép, húzósabb feladatokat adnak neki.

Csakhogy a renderfarm fejlesztések is sokkal egyszerűbbé válnak: az i7-eket le lehet cserélni TR4-ekre és máris 16szorosára növelik a renderfarm kapacitását, miközben a többi összetevő, mint fogyasztás, hálózati forgalom nem változik jelentősen.Miért nem GPU:

A GPU render előtt hatalmas jövő áll, de még nem tartunk ott, hogy egy komoly projectet nagyobb áldozatok nélkül teljesen GPU alapokra lehessen helyezni. A legtöbb GPU renderelő tudása limitált, egyes fícsöröket nem támogatnak, sok esetben komplex shader és plugin környezet áll egy-egy project mögött, amit nem lehet egyik napról a másikra GPU-ra implementálni. (Illetve lehet, csak túl sokba kerülne.)

Ráadásul ha bármilyen új render algoritmus, shader jelenik meg, azt elsőként CPU-n fogják kihozni.Ezen kívül egy 32 magos CPU-val szemben csak egy több GPU-s rendszer tud érdemben annyival többet nyújtani, hogy érdemes legyen bevállalni a vele járó limitációkat és extra költségeket.

Márpedig egy 3-4 1080Ti-s rendszer kiépítése, hűtése és irodai környezetben való üzemeltetése nem egyszerű, költségben pedig jóval a CPU rendszerek fölött van. Egyelőre tehát jobban megéri sokmagos CPU-kat használni és ha az nem elég, akkor pár node-al kibővíteni a farmot, mint az egész céget átállítani GPU-ra.[ Szerkesztve ]

-

Shin Chen

tag

A szoftveres támogatás itt is kétes igaz?

Akkor mi szerint lehetne egyenlő egy mérés, ha még a szoftver is optimalizálatlan?

Sok sok teszt és tapasztalat kell ahhoz, hogy véglegeshez közelítő(!) eredményeket kaphassunk...Szerk.: Mármint Intel CPU vs AMD CPU teljesítménye közti különbség szerint egyes programokban! Felhasználás válogatja ahogy többen is írták.

Bocsi az OFFért[ Szerkesztve ]

"A tudomány az vagy hülyeség, vagy az elit trükkös módszere az egyszerű emberek átverésére."

-

#54625216

törölt tag

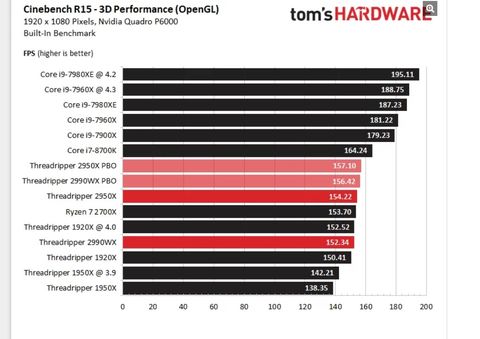

Az általad linkelt teszteken mind opengl teljesítményt mérnek. Azaz nem a CPU nettó számítási teljesítményét tesztelik, hanem hogy milyen hatékonysággal tudja kiszolgálni a GPU-t.

A CPU render feladatoknál viszont az opengl teljesítmény lényegtelen, farm gépekben még vga sincs.

Tehát nem szarják le az autocad-et és a solidworks-öt, csaképpen a vizualizációhoz nem opengl-t, hanem CPU renderelőket használnak.

Ha pedig egyes feladatokhoz opengl kell, akkor nem ők a célcsoportja ennek a termék kategóriának, így a cpu teljesítményeket is hülyeség összehasonlítani.

Linkelj be mondjuk egy V-ray, Arnold, Cycles, Renderman, Mentalray tesztet és lássuk azokban hogy teljesít a TR4 az i9-ekhez képest. -

wsanyi

aktív tag

Úgy, hogy elszámolta magát az illető. 8-at akart írni.

+1 gondolat. 4 éve nem volt i7 7700K, maximum 4770K.

@(#38) kpbendeguz

Nektek a Projekt47-hez hasonló megoldás lenne jó, vagy valami ilyennek a bérlése?

Az éltető nap mindig süt, még akkor is, ha néha nem látjuk, mert eltakarják a felhők, vagy mert éppen éjszaka van.

-

MiklosSaS

nagyúr

@Abu: hol a TR teszt? Errõl is lecsúsztatok? Most sem küldött nektek az AMD semmit?

~~~~~~ Privatban NINCS szakmai tanacs! ~~~~~~

-

Abu85

HÁZIGAZDA

válasz

MiklosSaS

#45

üzenetére

MiklosSaS

#45

üzenetére

He küldenek leteszteljük, de a 2000 dollárhoz közelítő prociknak nem Magyarország a célpiaca. Összemérni sem tudnánk semmivel. Meg nincs is nagyon értelme, ahova ezt a procit veszik, ott nincs ellenfele. A Skylake-SP lehet opció, de az Intel sem hiszen, hogy küld majd 28-magos procit hungarishbe.

Az alaplapgyártókon múlik ez leginkább, mert ha nekik lesz, akkor ide szokták adni, de az Intel és az AMD direkten nem foglalkozik a HEDT vonallal Magyarországon.[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

válasz

#06658560

#47

üzenetére

#06658560

#47

üzenetére

Több program könnyen megoldható, elvégre a Blender, Luxrender, Indigo letölthető, a Cinema 4D-nak a tesztprogramja gyakorlatilag a Cinebench. Emellett minden más beszerezhető, ha akarjuk. Szóval nem a programok jelentik a problémát.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

Új hozzászólás Aktív témák

ph A munkaállomásokba szánt processzorok nagyon speciálisnak tekinthetők, de a SIGGRAPH alapján a renderelés és szimuláció szempontjából hatalmas az igény.

- Politika

- Adrian Mole: Friss konfig, Win 11, gyere rám

- DIGI internet

- Gyúrósok ide!

- Formula-1

- Folyószámla, bankszámla, bankváltás, külföldi kártyahasználat

- lezso6: Miért veszünk SUV-okat?

- WoW avagy World of Warcraft -=MMORPG=-

- Wise (ex-TransferWise)

- HiFi műszaki szemmel - sztereó hangrendszerek

- További aktív témák...

![;]](http://cdn.rios.hu/dl/s/v1.gif)

)

)