- Épített vízhűtés (nem kompakt) topic

- Azonnali VGA-s kérdések órája

- A régi node-okra koncentrál a szankciók miatt Kína

- Házimozi belépő szinten

- Milyen egeret válasszak?

- Azonnali informatikai kérdések órája

- Házimozi haladó szinten

- Nyár közepén jön az AOC 540 Hz-es gaming monitora

- Hogy is néznek ki a gépeink?

- Canon MILC: EOS R és M topik

Hirdetés

-

Engedélygyűjtésbe kezdett a Poco táblagépe

ma 33 wattos töltéssel és 8 megapixeles kamerákkal várható a Poco Pad.

-

Érkezik Magyarországa az LG szuper dizájnos hordozható projektora

ph A szokatlan külsejű CineBeam Q képes a 4K felbontás megjelenítésére.

-

20 ezer új munkást visz Eindhovenbe az ASML

it Hatalmas politikai feszültséget okozott az ASML és a holland kormány nézeteltérése, de most úgy néz ki, hogy jelentős bővítésbe kezdenek Eindhovenben.

Új hozzászólás Aktív témák

-

ribizly

veterán

Na ez már rendkívül szimpatikusan néz ki.

Ha majd lesz RTX kártyám élvezhetem is.

Addig meg nyalja meg NVidia...

|•| https://hardverapro.hu/tag/ribizly |•|

-

nkmedve

őstag

A Hardware Unboxed/Techspot már teszteltegette: video: [link] , cikk: [link]

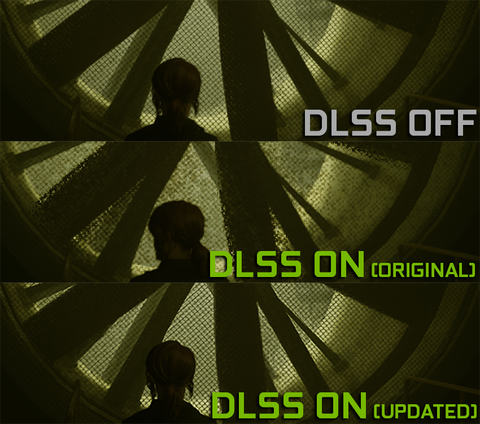

A Wolfenstein Young Blood-ban már állítólag ez dolgozik, valamint a Control-ban is valami hasonló eljárás van, de ott még DLSS 1.9-nek hívták.Azok után, hogy az első generációs DLSS-t nagyon leszólták (és úgy általában minden RTX-el kapcsolatos dolgot), most elég jó véleményük van róla, úgyhogy talán ez már tényleg használható lesz.

Remélem az elkövetkező 1-2 évben annyira kiforr a dolog, hogy az akkor már korosodó 2080 használhatóságát kitolja még 1-2 évvel QHD-ben.[ Szerkesztve ]

-

ribizly

veterán

Aki leszólta a RT-et az simán nem érti miről van szó. Amit le lehetett szólni az az részleges implementáció, meg a performance.

A DLSS viszont már más tészta. Az összes támogatott játékban anomáliák voltak. Ha sikerült tényleg hozni az eddig ígért sebességet hozni anomáliák nélkül, akkor az frankó. Ráadásul pl. DOOM Ethernal-ban már az RTX2080 ~20%-al tud többet a GTX1080Ti-tól, ami azt is jelenti, hogy egyre többet hoznak ki ezekből az RTX kártyákból az új engine-ek.[ Szerkesztve ]

|•| https://hardverapro.hu/tag/ribizly |•|

-

#82819712

törölt tag

Ez valóban jobban néz ki.

Jöhet a kémény a sodrott acéldrót és a sátor problémája amiben múltkor elvérzett. (F.F.)

Ezt a tréningelnek egy neuronhálót isten bizony nem értem, szerintem kamu az egész

Nem arról van szó hogy fognak két képet egy 4Ksat meg egy full HDset és ráengednek egy AI algoritmust hogy mossa össze és akkor így ugrál a minőség csak a szemünkkel nem vesszük észre?

Lehet pont mindig a 4k-sat veszik ki

Ugyanitt neuronhólóból szőtt pulóver eladó, a zöld feláras.

-

egyetértek. Ép tegnap nézegettem hogy a 2070 karim , igaz a z Asus Strix beépített kapcsolós megoldásával,de bizony az 1080 Ti- nyakában liheg az új címekben DLSS nélkül is, ezzel meg simán hozza.

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

mpioca

tag

"Nem arról van szó hogy fognak két képet egy 4Ksat meg egy full HDset és ráengednek egy AI algoritmust hogy mossa össze és akkor így ugrál a minőség csak a szemünkkel nem vesszük észre?"

Azt akarod mondani, hogy ha bekapcsoljuk a DLSS-t egy játékban, akkor a PC lerendereli ugyanazt a képkockát 1080p-ben és 4K-ban is, majd összemossa a kettőt, és így kapjuk meg a monitorra kivetített képet? Nagyon jó kérdés, de április elseje még kicsit odébb van!

-

ribizly

veterán

De ezért nem szabad leszólni. A Ray-tracing mindennek az alapja. Azt elérni a nemes cél. Persze az Nvidia-nál kicsit elb@szták ennek a jelentését sajnos, mert ezt soha nem szabadott volna marketing célokra felhasználni. Dedikált lineup-hoz kötni meg aztán főleg nem.

Ez egy rettenetesen erőforrásigényes dolog. Ha valaki tanult számítógépes grafikát (Helló Dr. Szirmay-Kalos László és minden kedves volt BME-s sorstársam) vagy foglalkozott 3D engine-ekkel, akkor találkozhatott vele és tudja, hogy ezt tulajdonképpen nem arra találták ki, hogy ezt (kis túlzással élve) a mi életünkben realtime alkalmazzák. Már az is nagyon dícséretes, hogy egyáltalán gondoltak rá. De ennek a kiváltására annyira jó közelítő algoritmusok születtek már, hogy kár volt ennyire előreszaladni vele. Amit meg a közelítő megoldások nem tudnak ma rendesen, azokat is meg lehet ennek implementációja nélkül oldalni (pl. tükröződés az éppen nem látható dolgokra, lásd RDR2, No One Lives Forever, DOOM3, DN3D...). Csak erre senki sem veszi általában a fáradtságot.

Mindenki kiakadt, hogy egy olyan világban, amikor az összes engine arra megy rá, hogy a lehető legkevesebb dolgot kelljen kiszámolnia (éppen takarásban vagy FOV limitáció okán nem látható objektumok, fényforrások, stb.) akkor behúzunk egy olyan technológiát, ahol ezek közül mindent, állandóan figyelembe kell(ene) venni és az alapján 100+ fps-el renderelni.Melyikhez mennyit kell számolni mondjuk egy PUBG esetében?

a. Amit nem látni azt nem számoljuk (egymást takaró objektumok, a FOV-on kívüleső dolgok), minden fényforrás statikus, vagy előre leprogramozott és csak néhány fényforrás (fényszórás nélkül, tehát az első "útjába eső" objektumot még megvilágítja és csá) van ami dinamikus (mondjuk mozgó plafonról lógó lámpatest, mint DOOM3, Far Cry) vannak jelen. Az árnyékokat objektumonjént előre lenyomjuk, max a karakterek saját árnyékát és a saját lámpánk által vetett árnyékokat kell odapattintani.

b. Mindennek dinamikus fénye van. Tehát a teljes játékteret folyamatosan számolni kell, mivel előfordulhat az, hogy valami előttünk csak azért lesz látható, mert egy mögöttünk álló (akár másik objektum mögött lévő) fényforrás fénye valahonnan odaverődik/szóródik. Ahány objektum és fényforrás van a "pályán", akkor azokat 100kép/mp kellene kiszámolni (különben nem lesz meg a 100fps).Na befejeztem, mert már így is túl sokat írtam, de a b. megoldás a sokkal jobb, élethűbb, stb, ám az a.-val tudunk létezni még (szerintem legalább) évtizedekig.

|•| https://hardverapro.hu/tag/ribizly |•|

-

mpioca

tag

Egyébként le a kalappal, ez már tényleg innováció! Ezt a kis bemutatót megtekintve engem teljesen meggyőzött a technológia. Amellett, hogy képminőségben a DLSS által felskálázott kép megegyezik az eredetivel (bizonyos esetben gyengébb, máshol jobb is, mint a natív kép), még a temporális mintavételezési hibákat is csökkenti. Zseniális.

[ Szerkesztve ]

-

Azért egy 450-750mm2 terjedő GPu-t , aminek drága a gyártása,nehéz nem marketing célra felhasználni,hisz ezért is lett ilyen hatalmas és brutális, mert a felépítését ennek szentelték és 3 éve lassan kizárólag náluk elérhető gaming célra a technológia .hülyék lettek volna nem erre építeni, hisz elég merész húzás. Nem igazán dolgoztok vagy értitek hogy működnek az ilyen jellegű cégek . ha nem lehetett volna erre építeni az egészet akkor nem lenne a mai napig raytracing képes hardver a piacon. Én más területen, de ebben dolgozok 10 éve.

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

yorgashx

tag

Szerintem ez még rátesz egy évet arra, hogy meddig tudjuk wqhd fullon hajtani a 2080S és társait.

A promó meggyőző, most már lehet, hogy ki is próbálom. -

aginor

addikt

Azért nem mindenki csodálkozik ezen. Viszont az RT őrületből jól látható, hogy nem tudott hova fejleszteni az Nvidia ezért nyúlhattak ehhez az eszközhöz. Bízom benne, hogy a másik gyártó is mihamarabb belép a klubba, ami a tartalomkészítők hathatós támogatásával akár még érhet is valamit még a mi életünkben.

Szarkazmus off.

Szarkazmus off.

Ugyanakkor annak nem örülök, hogy megint a saját zárt szabványukat erőltetik, ahelyett, hogy beállnának egy nyílt és mindenki számára használható megoldás mögé, ami jelentősen gyorsítaná a technológia terjedését és elfogadottságát.

Azért vagyunk a világon,hogy valahol vegyünk egy ATI Radeon-t :))) by: LADA VFTS http://www.flickr.com/photos/40852488@N03/

-

a Direct ML és a DLSS 2.0 nem zárja ki egymást. Ugye szabványos hasonló megoldásnak ott a Direct ML ez meg az Nvidia felhasználóknak készül, tensor magokat használva , ilyen mag/ hardverelem jelenleg nincs más hardverben ezért nem is tudná szerintem támogatni.

Az RT ben is egy teljesen szabványos eljárást használnak és mint láttad az az új Dx 12 . Ultimate [link] nagyon sok szempontból közösen építkezik az Nvidia megoldásaival( vagy fordítva). Azért mostanában elég szépen nyitott az Nvidia az előző évekhez képest.

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

ribizly

veterán

Nem is állítom, hogy rossz dolog ennek a bevezetése. Csak oda kellett volna figyelni a marketing-nél, hogy ezt hogyan adagolják.

Ha mondjuk akkor elárulták volna, hogy 1-1 játékban valós árnyékok (Metro Exodus), vagy valós tükröződés (BFV) lesz csupán ettől és mellette az RTX2080Ti megjelenésekor kikerült volna a full RT támogatott Quake II RTX meg a még mindig magára várató RT-s Minecraft a Control mellett, akkor mindenki tudná miről is van itt szó. De nem így volt.

Szóval elbagatelizálták a legnagyobb ütőkártyájukat, mert nem volt semmi, amivel használni lehetett volna, mostanra meg már a laikusok "leírták".|•| https://hardverapro.hu/tag/ribizly |•|

-

ribizly

veterán

válasz

gainwardgs

#15

üzenetére

gainwardgs

#15

üzenetére

Nem is cseréltem le és még mindig elegendő 1440p@144Hz-es monitor alá. Terveim szerint az új széria megjelenésekor le lesz váltva egy RTX2080Ti-ra és akkor kb. a monitorom cseréjéig nem kell nagyon VGA-val foglalkozni már.

|•| https://hardverapro.hu/tag/ribizly |•|

-

persze ilyen szempontból ez igaz, ennek idő és rengeteg pénz kell.

Ugye az az igazi ha egy játékba már az alapoktól beleépítik, a meg 2-3 év , lásd Control..Az igazán nagy áttörés most fog jönni az új Dx 12 bevezetésével,de ezzel az RTX kártyák életciklusa szépen kitolódik, hisz az egyetlen hardver a piacon jelenleg ami teljesen támogatja az érkező új Dx 12 szolgáltatásait. Ha ezt megfűszerezed a DLSS 2.0 val marketing ide vagy oda azért egyre jobb vételnek tűnik némelyik RTX kártya. ( persze nem mind)

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

abéla

senior tag

válasz

gainwardgs

#15

üzenetére

gainwardgs

#15

üzenetére

Igazándiból lassan senki nem mond már semmit az 1080 Ti-kről... jó volt, szép volt még akár igaz is volt

Jelenleg viszont egy vadiúj, 3-4 év garis "alap" 2070s vagy akár egy OC 2060s is jobb alternatíva.

szerk: nyilván ezek nem 1080Ti váltókártyák

(pandémia előtt ugye inkább 3050-3060, ami viszont jelen állapot szerint, ki tudja mikorra tolódik)... persze ha az öntudatos Ti tulajok a nagyrabecsült használt cuccaikért nem 130-140e-et kérnének, felülvizsgálnám az álláspontom

[ Szerkesztve ]

hootka!

-

aginor

addikt

Az igaz, hogy nyitott, de az is, hogy nem eléggé, bár a kevés is több, mint a semmi. Ezek az "effektek" akkor tudnak jól terjedni, ha van szabvány hozzájuk és ennek megfelelő az implementáció. Mire gondolok? Arra, hogy ha egy effekt megvalósításához gyártóspecifikus megoldás kell, akkor az lesz leprogramozva, miért fizetnek, viszont ez lassítja a technológia terjedését. Az RT-nél ez alapvetően rendben van, de a DLSS megvalósítása -vagy ezzel egyenértékű megoldásé- is ilyennek kellene, hogy legyen. Láttuk mi lett a Hairworkssel, vagy a Physx-el (a másik oldalon szintén a hajas móka pl.). Alig használják, mert kötött megoldás, csak bizonyos hardvereken működik, azokon is csak a gyártótól kapott változatban. A piacnak -nekünk- az a jó, ha az ilyenek minden hardveren futnak -jól- és mihamarabb vagy általánossá tid válni, vagy a játékmechanika szerves részét tudja képezni.

Azért vagyunk a világon,hogy valahol vegyünk egy ATI Radeon-t :))) by: LADA VFTS http://www.flickr.com/photos/40852488@N03/

-

GodGamer5

addikt

Egész jónal tűnik a DLSS2 képminősége. 1080ti árban meg nyilván egy 2060s vagy egy 2070-es sokkal jobb alternatíva. Minél jobban rámennek a dx12/Vulkan használatára, úgy fognak lassulni a régi kártyák.

[ Szerkesztve ]

"Többször látsz Game Over képernyőt, mint Michelle Wild f@szt." "It's not a Loop, it's a Spiral"

-

Na igen csak itt a a DLSS egy hardverelem segítségével működik, a tensor magokkal megfelelő sebességgel. Ha ilyen nincs akkor kell egy másik megoldás amire megszületett a Direct ML de ez sem egy általános megoldás mert pl Vulkan vagy Linux alatt nem működik, míg pl a DLSS igen. AMD nél ilyen volt a HBCC ami csak bizonyos hardvereken működik.

persze jó lenne ha minden nyitott lenne és minden ugyan olyan és nem próbálná előtérbe helyezni a saját hardvereket , hogy azt vedd, de ez a piacgazdaságban nehezen kivitelezhető.

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

ribizly

veterán

válasz

gainwardgs

#25

üzenetére

gainwardgs

#25

üzenetére

Az tuti. De én még egy RTX2080-ra sem látom értelmét onnan.

Aki jó áron vett (vagy vesz, mert van aprón nem kevés) GTX1080Ti-t, az nem fog egyhamar cserélni.|•| https://hardverapro.hu/tag/ribizly |•|

-

Kansas

addikt

Aki rossz áron vett, az meg nem tud, mert nem tudja annyiért eladni, hogy megérje neki a váltás...

@(#24) b.: nekem egyre inkább úgy tűnik, hogy azért kell csak DLSS, hogy legyen mit csinálni a Tensor magokkal, mert másra(consumer/gamer szempontból) nem jók, de a marketing épített rájuk(is). Nem rég még az volt a hír, hogy a DLSS halott, és az NVidia elindult egy, a RIS-hez hasonló irányba helyette... aztán alighanem rájöttek, hogy úgy nem lehet eladni, mennyire kúlak a Tensor magok, amik a HW támogatás ellenére is több fps-t buknak az eljáráson, pedig az eredmény gyakran így sem valami fényes...

A DLSS2 valamivel jobbnak tűnik, de én azért megvárnám, míg 3rd party teszterek élesben(in-game) is ki tudják próbálni és írnak róla. Igaz, engem utána se fog érinteni, mert egyik videokártyám se támogatja(RX5700XT, GTX1650).[ Szerkesztve ]

Nincs olyan MI, ami képes lenne szimulálni az emberi hülyeséget... ha valaha lesz, annak tuti az emberi hülyeség lesz az oka... A Föld erőforrásai közül a legjobban az ész van elosztva - mindenki meg van róla győződve, hogy több jutott neki, mint másoknak.

-

arty

veterán

pont ezek miatt ilyen értékelhetetlen a pécés helyzet

korábban fizix, aztán gameworks, most dlss... (a másik oldali mantle és hbcc simán kiröhöghető volt, szerencsére, piaci részesedésből adódóan)

és most majd lesz majd nyilván inteles patkánykodás is

gsync-freesync-vrr

(és a piaci rész miatt nv masszivan "sikerre" is vitte a saját megoldásait )

)emellé a steam, epicstore, blizzardstore szegregáció már csak a hab a tortán

"ugyanitt hazájából elüldözött nigériai herceg aranybányájának tulajdonjogát megtestesítő NFT jegyezhető."

-

Kansas

addikt

Én ezért megyek általában a bang-for-buck sweet spot-ra(ami az esetek 90%-ában közép- vagy felső közép kategóriában található az adott generáción belül) - bár mostanság nem foglalkozok sokat azzal hogy mennyiért lehet később eladni, mert az esetek nagy részében családon belül vagy a baráti körben adom tovább a levetett HW-eimet, nyilván a feltétlen szükségesnél nagyobb bukóval.

[ Szerkesztve ]

Nincs olyan MI, ami képes lenne szimulálni az emberi hülyeséget... ha valaha lesz, annak tuti az emberi hülyeség lesz az oka... A Föld erőforrásai közül a legjobban az ész van elosztva - mindenki meg van róla győződve, hogy több jutott neki, mint másoknak.

-

már eleve a cikk is hülyeség ahol a DLSS-t hasonlította egy RIS hez amikor teljesen más a két eljárás lényege és másra való. Már akkor is kibuktam ezen.

A RIS és az image sharpening ugyan arra szolgáló a két eljárás és a DLSS és a Direct ML hasonlítható össze. Ennyire bugyuta cikket rég nem láttam.

A tensor magokra épül nagyon sok eljárás a Dx12 Ultimate most bevezetésre kerülő eljárásaiból az RTx kátyákon, gyorsítja őket.amivel pontosan a kártya élettartalma hosszabbodik meg.[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Kansas

addikt

Az, hogy nem érted, miért a RIS-hez hasonlítják az eredeti DLSS-t a cikkben, téged minősít, ha rendesen végiggondolod, abszolút van értelme az összevetésnak, de, már megbocsáss, nem fogom a szádba rágni(segítségül azért: a kulcsszó a "big picture").

Nincs olyan MI, ami képes lenne szimulálni az emberi hülyeséget... ha valaha lesz, annak tuti az emberi hülyeség lesz az oka... A Föld erőforrásai közül a legjobban az ész van elosztva - mindenki meg van róla győződve, hogy több jutott neki, mint másoknak.

-

gV

őstag

ha rám hallgatsz a Techspoton nem húzod fel magad, nem ér annyit: csak nézd meg a DX12U-s cikküket, meg sem említik, hogy a Turing támogatja [link] az új DLSS cikkükben is feleslegesen sokat írnak a Controlról, ahelyett, hogy megnéznék a Bright Memoryt is, na vicc amit művelnek

-

Kansas

addikt

Mi a fenének említenék meg külön, hogy a Turing támogatja? Azzal, hogy a DXR-t említik, nyilvánvalónak kell legyen, hogy egyedüli RT HW-ként más per pillanat nem támogathatja, de Turingból is csak a 2xxx-széria, a 16xx széria nem...

Az sem tiszta egyébként, hogy a Turing már most támogatja, vagy csak támogatni fogja egy későbbi driverben...A Bright Memory meg early access-ben van, talán nem hallottak róla... abban egyetértünk, hogy túl sokat foglalkoznak a Controllal, főleg azután, hogy az elején említik, hogy nem is a fullos implementációja van benne a DLSS2-nek.

Ezért mondom, hogy bár nagyon ígéretes, én megvárnám, míg egy normális játékban láthatjuk a fullos implementációt.[ Szerkesztve ]

Nincs olyan MI, ami képes lenne szimulálni az emberi hülyeséget... ha valaha lesz, annak tuti az emberi hülyeség lesz az oka... A Föld erőforrásai közül a legjobban az ész van elosztva - mindenki meg van róla győződve, hogy több jutott neki, mint másoknak.

-

Miért minősítene engem? Minek személyeskedsz olyan dolgon amit nagyon egyszerű megérteni és józan paraszti ésszel felfogható?

A DLSS nem RIS elvén és céljából működik, az az image sharpening... A RIS és az Image sharpenig nem növeli az FPS-t és nem nyúl a felbontáshoz. Teljesen másra való két eljárás

Nem nehéz megérteni, hogy a RIS-re válaszul Nvidia az image sharpeninget hozta-,ami a fenti cikk megjelenésekor még nem volt,- ami egy képjavító eljárás a DLSS pedig egy sebesség növelő eljárás mamire a Direct ML van válaszul... az egyik egy textúra szűrő a másik pedig egy felbontás felskálázó eljárás.

Vonatkoztass el egy kicsit az AMD vs Nvidia részétől és próbáld józan paraszti ésszel végig gondolnia két eljárást ,rájössz hogy a DLSS mire való és az Image sharpening mire való és hogy működik, és melyiknek megfelelően működik a RIS, amivel a cikk összeveti hibásan.A Dx 12 U minden újítását egyenlőre csak az Nvidia RTX széria támogatja PC-n..

Ezzel kapcsolatban korrekt cikk az azért valami ilyesmi [link] ebből a szempontból, mert úgy néz ki az alapjait nagyon erősen az Nvidával is és AMD vel is együtt dolgozták ki a mostani frissítésnek és igen támogatja teljesen,de egyedüliként az RTX széria majd év végén az RDNA 2 AMD is. [linkgV: +1

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

gV

őstag

DX12U: DXR 1.0-ról volt tudott 1 hete még, hogy támogatja a Turing, azt, hogy 1.1-est is nem és nem is volt kézenfekvő. GTX vs RTX Turing különbségek miatt pláne aggályos, hogy mellőzi a cikk a megemlítésüket.

DLSS: ha már cikket írnak valamiről akkor illene utánajárni miben van, nekem az nem érv, hogy EA. -

Kansas

addikt

OK, akkor megfejtem a talányodat: a RIS és a DLSS is használható arra, hogy alacsonyabb(és utána felskálázott) felbontás esetén javítsa a képminőséget.

Ráadásul mindkettőnek köze van az antialiasing-hoz: a DLSS egy antialiasing metódus, a RIS pedig korrigálja a túl elmosott AA negatív hatását, ami tipikus a kisebb teljesítmény-igényű AA metódusok esetében(igaz, a túlzásba vitt SSAA-nál is, pedig az eszi a vasat).

Végső soron mindkettő arról szól, hogyan hehet minél több képminőséget megőrizni miközben teljesítményt spórolunk. Jó minőségű képre a sharpeninget ráengedve csak ronthatunk a dolgon, ezt az esetet ezért nem veszem figyelembe.Így már világosabb a kapcsolat?

Egyébként nem személyeskedtem, az ugyanis a személyes tulajdonságaidra alapozva támadta volna az érveid érvényességét, én azonban az érveid minőségét direktben támadtam, és abból vontam le minimális mennyiségű konzekvenciát a személyes kognitív képességeidre nézve(ezt hívják empirikus megfigyelésnek)... amit egyébként azóta sem cáfoltál meg, láthatólag továbbra sem érted, miről van szó. Vagy csak látszólag?

[ Szerkesztve ]

Nincs olyan MI, ami képes lenne szimulálni az emberi hülyeséget... ha valaha lesz, annak tuti az emberi hülyeség lesz az oka... A Föld erőforrásai közül a legjobban az ész van elosztva - mindenki meg van róla győződve, hogy több jutott neki, mint másoknak.

-

abéla

senior tag

válasz

gainwardgs

#25

üzenetére

gainwardgs

#25

üzenetére

Láthatod a korábbi hsz-emben "szerk: nyilván ezek nem 1080Ti váltókártyák"... mármint a 2060-70-80, tehát igen, nem gondolom, hogy ma 1080Ti-ről érdemes ezekre váltani, de ezt venni sem helyettük.

Egyébként együttérzek a 1080ti tulajokkal, az én 980Ti-m jelenleg kb ér 50-60-at, annyiért el sem adom ,

,

megy a csöndesgépbe, óccóvizzel alulfeszelve; hogy buktam-e rajta? Fene tudja, ~4.5 évig kb heti 35 órát biztos nyüstöltem(~8200óra), buktam kb 200-at (ugye 220(nyú vga)+30(víz) - maradványérték), az játékóránként 24ft... ennyiért egy órát jó régen csócsóztam

[ Szerkesztve ]

hootka!

-

Kansas

addikt

Az továbbra sem világos, hogy jelen állapotában a Turing RTX támogatja-e a DXR 1.1-et, vagy csak támogatni fogja.

EA=open beta, innentől szvsz nem kvalifikált. Még a WoWs sincs EA-ban, pedig még messze nem érte el a v1.0-t...Szerk.: de, már tiszta a DXR 1.1 támogatottság:

"NVIDIA will be ready on the day of Windows 10 20H1 release with full driver support for all the new and updated DirectX 12 Ultimate capabilities."[ Szerkesztve ]

Nincs olyan MI, ami képes lenne szimulálni az emberi hülyeséget... ha valaha lesz, annak tuti az emberi hülyeség lesz az oka... A Föld erőforrásai közül a legjobban az ész van elosztva - mindenki meg van róla győződve, hogy több jutott neki, mint másoknak.

-

-

Kansas

addikt

Az jött át, hogy le vagy ragadva a low-level technikai részletekben, és nem érted, mit/hogy/mire(is) használnak.

Ha mégis érted, akkor Oscart neked, jól adod az értetlent...

[ Szerkesztve ]

Nincs olyan MI, ami képes lenne szimulálni az emberi hülyeséget... ha valaha lesz, annak tuti az emberi hülyeség lesz az oka... A Föld erőforrásai közül a legjobban az ész van elosztva - mindenki meg van róla győződve, hogy több jutott neki, mint másoknak.

-

Én pontosan azt gondolom hogy te nem érted egészen mire való a DLSS és hogy működik. hogy ez mellé az image sharpening ugyan úgy még pluszban alkalmazható ezért a 75 % render és RIS nem ugyan az minta DLSS + Image sharpening sem sebességben sem minőségben.

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Kansas

addikt

"75 % render + RIS nem ugyan az mint a DLSS ." - nem, valóban nem ugyanaz, a végeredményt tekintve több fps-veszteségért rosszabb képminőséget nyújt a DLSS, és ez tovább romlik, ha még image sharpeninggel is nyakon öntöd, mert bár a képminőség javul, a teljesítményvesztés is vészesen közel kerül a natív 4K renderinghez.

Pontosan tudom, hogy a DLSS hogy működik, de az összehasonlítás szempontjából ez lényegtelen - erre mondtam, hogy leragadsz a low-level részleteknél.

Lényegét tekintve a DLSS egy NVidia-only AA metódus, tehát ha úgy nézed, hogy:

- 75% render + DLSS + Freestyle image sharpening

- 75% render + AA + RIS

mindjárt teljesen almát az almával összehasonlítás lesz.És mielőtt a dedikált HW(Tensor) támogatással jönnél, megjegyzem, hogy az AMD is HW-ből támogatja az AA-t, csak ez a hardver nem fixfunkciós, hanem a normál shader magok.

Az kétségtelen, hogy a Tensor magok másra is jók, csak épp nem játékos kontextusban.A DLSS2 minden szempontból jobb lesz, ráadásul nem lesz 4K-hoz kötve. Ahogy a TechSpot is írja, a DLSS2 tudja azt, amit a DLSS-nél ígértek.

[ Szerkesztve ]

Nincs olyan MI, ami képes lenne szimulálni az emberi hülyeséget... ha valaha lesz, annak tuti az emberi hülyeség lesz az oka... A Föld erőforrásai közül a legjobban az ész van elosztva - mindenki meg van róla győződve, hogy több jutott neki, mint másoknak.

-

na igen de a tesztben nem így volt ez a gondom vele és vissza értünk ahhoz miért mondtam amit...a DLSS mellé alkalmazhatod az Image shapreninget ezért nem ugyan az.

A RIS és az Image sharpening hasonló elven működik, míg a 75 % render nem ugyan az Mint a DLSS képbutítása. Az egyik egy fix 75 %( vagy az általad beállított) lebutított renderrel dolgozik, míg a DLSS egy neuronhálós szakaszos képminőségi eljárást alkalmaz azaz nem általánosan ront a felbontás minőségen.

Tehát a teszt úgy lenne fair,hogy 75 % render + RIS és DLSS + Image sharpening vagy 75 % render és simán DLSS képjavítók nélkül.... nem csak úgy simán a DLSS mert az úgy soha nem lesz ugyan az, mint egy textúra szűrő/ javító eljárással támogatnám a képet a butítás mellett... a DLSS 2.0 meg főleg jobb lesz sharpeninggel megtámogatva.

Az élsimítást kihagynám mindkét esetben a dologból, ha összemérném a két eljárást.

A 2.0 nak ez a lényege hogy te szabályozhatod még ezt a minőségi romlást is amit amúgy is csak a neuronháló bizonyos részleteknél alkalmaz, nem mindenhol, itt ebből adódóan az image sharpenig a kép bizonyos szakaszain a natív felbontásra dolgozik rá.

Egyébként javít a képminőségen natív felbontáson is a RIS is és az Image sharpening is szerintem, bár ez szubjektív.[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Kansas

addikt

Kihagynád az élsimítást? A DLSS(Deep Learning Super Sampling) az egy élsimítási metódus

Nincs olyan MI, ami képes lenne szimulálni az emberi hülyeséget... ha valaha lesz, annak tuti az emberi hülyeség lesz az oka... A Föld erőforrásai közül a legjobban az ész van elosztva - mindenki meg van róla győződve, hogy több jutott neki, mint másoknak.

-

A sebességet csak úgy tudod összevetni, ha a RIS és 75 % rendernél nem alkalmazol plusz élsimítási eljárást mert a DLSS esetében ezt a neuronhálón számoltatják ki.

Egyébként a neve csalóka, a neuronhálós tanításnál használnak 64x SSAA-t és az AI ebből próbál meg előállítani egy ahhoz hasonló képet,de a GPU itt nem számolja ki ezt a részletet.[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Kansas

addikt

OK, adom, ez igaz.

A trükk az, hogy egy leskálázott kép megjelenítésekor a monitorba épített interpolációs algoritmust használod a megjelenítéshez, ami a használt algoritmustól függően effektíve jelent egy AA-hoz hasonló elmosó hatást(ugye ezért jelent meg az Integer scaling minden gyártónál, hogy natív felbontásban küldjék ki a képet a monitorra az egész számú skálázást lehetővé tevő esetekben).

Tehát a megspórolt teljesítményt gyakorlatilag átterheled a monitorra... érdekes lenne tudni, nem növeli-e meg ez az input lagot... illetve hogy az egyes monitortípusok között van-e jelentős képminőségbeli eltérés, vagy mind ugyanazt az algoritmust használja.Nincs olyan MI, ami képes lenne szimulálni az emberi hülyeséget... ha valaha lesz, annak tuti az emberi hülyeség lesz az oka... A Föld erőforrásai közül a legjobban az ész van elosztva - mindenki meg van róla győződve, hogy több jutott neki, mint másoknak.

-

con_di_B

tag

Én azt nem értem csak, hogy egy ilyen jellegű sztorit miért kell gyártói szinten tolni? Egy valamilyen image super-resolutiont összerakni annyira nem nehéz (az emberek többségének a bicubic+sharpenignek valami mozgásérzékebyebb változata tök elég lehetne), abszolút lehet nyerni rengeteget a játékba történt mélyebb integrációval (pl. HUD mehetne natívban, textúra felbontás lehetne más, screen space cuccokhoz is lehet hozzáférés) ha meg annyira fontos, hogy Tensor magokon fusson, akkor legrosszabb esetben is CUDA-ból megoldható simán, valamilyen interop meg csak van. Miért foglalkozik bárki is ilyen black box cuccokkal? Ha önmagában kevésbé kotorék a 2.0 mint az 1.0 volt, attól ez még mindig indokolatlan bloatware. (Az alapötlet jó, csak ilyenekkel foglalkozzanak azok, akik motorokat írnak, ez még menjen ki open source a GPU Gemsbe.)

-

con_di_B

tag

Eleve ott kezdődik ez a téma, hogy 1) állóképes super resolution mindig okádék lesz mozgóképen 2) mozgó részen nem látsz 4K-t. Ilyesmikből is lehetne szépeket spórolni, pl. statikus részen időben változó sampling pozíció, minden másra ott a motion blur.

(Disclaimer: DLSS 2.0 papert még nem olvastam.)

Új hozzászólás Aktív témák

ph A vállalat számost előnyt ígér az első verzióhoz képest, de szakítottak a korábbi megközelítésükkel.

- Épített vízhűtés (nem kompakt) topic

- Azonnali VGA-s kérdések órája

- Crypto Trade

- A régi node-okra koncentrál a szankciók miatt Kína

- Samsung Galaxy S21 Ultra - vákuumcsomagolás

- Házimozi belépő szinten

- Milyen egeret válasszak?

- PlayStation 5

- Vivid - Let your money grow!

- OFF TOPIC 44 - Te mondd, hogy offtopic, a te hangod mélyebb!

- További aktív témák...

nemazért mert "ronda" (mert nem az)

nemazért mert "ronda" (mert nem az)

Szarkazmus off.

Szarkazmus off.

,

,