Hirdetés

-

Közel 1 billió dollárt vesztettek a big tech óriásai

it Nagyot kaszáltak a shortolók, az úgynevezett Magnificent 7 közel 1 billió dollárt veszített a piaci értékéből a múlt héten.

-

Friss előzetesen a Destiny 2: The Final Shape

gp Érkezik az utolsó nagy kiegészítő, azonban a fejlesztők szerint ettől még nem lesz vége a franchise-nak.

-

AMD Radeon undervolt/overclock

lo Minden egy hideg, téli estén kezdődött, mikor rájöttem, hogy már kicsit kevés az RTX2060...

-

PROHARDVER!

A legtöbb kérdésre (igen, talán arra is amit éppen feltenni készülsz) már jó eséllyel megtalálható a válasz valahol a topikban. Mielőtt írnál, lapozz vagy tekerj kicsit visszább, és/vagy használd bátran a keresőt a kérdésed kulcsszavaival!

Új hozzászólás Aktív témák

-

zuchy

őstag

válasz

Ricco_hun

#1000

üzenetére

Ricco_hun

#1000

üzenetére

A fogyasztás azért nőtt, mert a legrosszabb csipek kerülnek rá, így a 800MHz-ért cserébe több fesz kell neki. Az egy két túl alacsony eredmény szerintem a felezett ROP-oknak köszönhető. Pixel Fillrate, Z/Stencil lecsökkent erősen. Bár ott a HD5850 se muzsikált jól.

Crysis-t rossz irányba fejlesztették, a hardverek mennek más felé. Aki Crysisozni akar maxon, az fizessen. Trabanttól nem várhatod el, hogy 200-el menjen.

De 40-ér van aprón HD4890 Vapor-x, közel azonos teljesítménnyel.[ Szerkesztve ]

PC-STYLE.hu

-

lsc

nagyúr

Az élet kegyetlen .

-

Balller

tag

GTX295 még mindig jól tartja magát az Atik közt

Balage

-

ThaBoss

senior tag

válasz

Balller

#1004

üzenetére

Balller

#1004

üzenetére

Ez így igaz, de a villanyszámlán is külön kiemelt tételként szerepel majd

szerk: XFX oldalán bukkantam a saját 5830-ukra: [link]

Ugyanaz mindkét kártyájuk, csak más a csomag tartalma: egyikhez Assassin's C. másikhoz AvP jár. Maga a NYÁK is jóval rövidebb, mint az eddigiek.[ Szerkesztve ]

-

Oliverda

félisten

AMD's REAL answer to GeForce GTX 480: AIB Custom 5970s

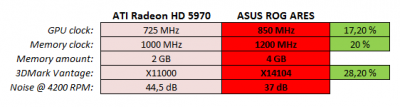

AMD will be offering new board spec to AIBs including Dual Cypress XT ultra low leakage GPU’s. One of the first models will be Asus ROG ARES which will feature 850MHz core clock, 1200MHz memory clock and 4GB of GDDR5. Asus ROG ARES thermal specification includes 100mm wide fan, 32mm thick, 600% higher air-flow, 100% pure copper and 8 ultra-wide heat-pipes. Also the noise level should be significantly lower @ 4200rpm; ARES 37dB; ref hemlock; 44,5dB.

Asus says performance in 3DMark Vantage Extreme-preset is ~28% better than ATI Radeon HD 5970 reference design.

Asus ROG ARES will be Limited Edition and on display at Cebit.

PS. Real pics of PCB & cooling solution coming tomorrow, stay tuned.

[ Szerkesztve ]

"Minden negyedik-ötödik magyar funkcionális analfabéta – derült ki a nemzetközi felmérésekből."

-

rocket

nagyúr

válasz

ThaBoss

#1005

üzenetére

ThaBoss

#1005

üzenetére

Review Samplek becsaposak lehetnek, kinai tesztben XFX HD5830 hosszu nyakos verzio van, amin megy szepen 950mhz-et a GPU, mig a Retail (legalabbis a kepek alapjan) joval egyszerubb nyakra epul, a Computerbase tesztben meg AMD Review Sample van ami a HD5870 nyakjara epul (referencia kartya hivatalosan nem lesz bolti forgalomban), az meg 900mhz-et ment.

Termesztesen a rovidebb nyaknak is megvannak az elonyei, es lesz olyan reteg aki viszont ennek fog orulni, azert a HD5770 meretben egy joval gyorsabb kartya nem rossz, es olcsobb is lesz biztosan mint a hosszabb nyakos verzio. (ebbol lehet nem is lesz Retail), de kevesbe fogja birni a tuningot, sot lehet mar eleve a GPU is kisebb feszultseget fog kapni mint a Review Sample kartyakon, es akkor a fogyasztas is csokkenhet.CB tesztben 1 wattal kevesebbet fogyaszt load alatt mint a HD5870, az azert nem a TSMC-t dicseri, hogy a selejt GPU-kban ennyire szivarog az aram, es mindezt ugy, hogy 6 SIMD es a ROP-ok fele levan tiltva, plusz meg a HD5870-nel alacsonyabb (-50mhz)orajelen jarnak.

#1007: Akkor lehet megis bedarlja a HD5970-et a GTX480, vagy csak biztosra akarnak menni.

A tervezoi kep a kartyarol nagyon szep

Mondjuk a cim rosszul van irva, mert ez nem az AMD valasza, hanem az AIB partnereike (bar a cikk csak az ASUS-rol szol), akkor viszont lehet atlepik a 300wattos TDP lmitet, mint a GTX285 MARS-nal.[ Szerkesztve ]

"A lower resolution generally means that there can be more quality per pixel."

-

Oliverda

félisten

"Like I said, one of the first will be from Asus, other manufactures should follow soon with their own designs or based on AMD's recommendation spec (of enhanced 5970).."

[ Szerkesztve ]

"Minden negyedik-ötödik magyar funkcionális analfabéta – derült ki a nemzetközi felmérésekből."

-

rocket

nagyúr

válasz

Oliverda

#1009

üzenetére

Oliverda

#1009

üzenetére

Nehez elkepzelni az AMD barmit is ajanlana egy olyan termekkel kapcsolatban ami akarmennyire is valogatott GPU-kra epul nagy esellyel atfogja lepni a PCI-SIG jelenlegi 300wattos TDP limitet, ezert tunik inkabb ez az AIB partner(ek) amokfutasanak.

"you cannot fight dominance with micro stutter"

Ez az AMD top VGA strategiajanak az egyik nagy hatranya, ha nem is lesz gyorsabb a GTX480 mint a HD5970, nincs CF es micro lag se.

"A lower resolution generally means that there can be more quality per pixel."

-

nkmedve

őstag

Mostmár biztos, hogy nem ez lesz a 4830-am utódja, messze nem olyan jó "népkártya" mint az volt. Pedig reménykedtem... DX11 egyelőre nem érdekel ez pedig puszta teljesitményben nem valami eget rengető, fogyasztásban egyenesen katasztrofális (árról nem beszéltünk).

Maradok még egy darabig a mostani kártyámnál, egy új hűtővel (a régi néha vacakol) még sokáig ki fog szolgálni. Majd ha lennebb jön az 5850 ára (fél év mulva

) akkor veszek azt esetleg.

) akkor veszek azt esetleg. -

Abu85

HÁZIGAZDA

A mikroakadást tudod mi okozta? Mindkét gyártó az energiagazdálkodási sémába futott bele. Egyszerűen néha visszakapcsolt az egyik GPU a lassabb órajelre. Ez már nem fordulhat elő, mert be van építve egy multi-GPU mód, ami 3D-s program futtatása esetén szinkronizálja az órajeleket.

Látom ma is bal lábbal keltél fel, de ha nem hiszed el nekem kérdezd meg, Gbors-ot, hogy ez a mikroakadás egy teljesen kezelhető probléma volt. Ma már nem is létezik.

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

rocket

nagyúr

Latszik fogalmad nincs a temarol, csak megint megakarod magyarazni a megmagyarazhatatlant, mert keptelen vagy megerteni, hogy van az eremnek masik fele is.

Micro StutteringMeglehet szuntetni a AFR mod eseteben a micro lagot, de ahoz ki kell kapcsolni a V-Syncet es nagyobb teljesitmeny kell ilyen esetben, hogy tobb legyen atlag fps, ami ugye ujabb problemat hoz azzal, hogy viszintesen "szetesik" a kep, es az nem nagy titok, hogy az Entsusiast felhasznalok nem turik jol az ilyen dolgokat.

Magyarul tokeletes megoldas AFR mod eseteben nincsen a micro lag eltuntetesere, es ezt hasznalja alapbol a CF.

Ezt a bal labbas baromsagot meg hagyhatnad mar, azert mert keptelen vagy felfogni bizonyos dolgokat, es csak azert is megakarod magyarazni, meg nem mindenben neked lesz igazad.

Sajnalom az embereket akik a hozzaszolasaid alapjan tajakozodnak, mert olyan szinten elvesztek mar az erdoben, hogy az eletben nem talalnak mar vissza realitasok talajara.

Tobben is szoltak mar neked, hogy rossz uton jarsz, talan ideje lenne magadba nezni, de ha nem teszed az se gond, majd megirja mas az erem masik felet, szerencsere akadnak azert akik kepesek latni mindketott

"A lower resolution generally means that there can be more quality per pixel."

-

Oliverda

félisten

Nem vagyok benne annyira biztos hogy túl fogja lépni de majd kiderül. Pár hónap alatt valszeg sokat fejlődött a TSMC féle 40nm. Van rá esély hogy ki tudnak válogatni olyan GPU-kat ezekhez a kártyákhoz amelyek már jóval alacsonyabb feszültséggel is vinni fogják a szükséges órajeleket.

"AMD will be offering new board spec to AIBs including Dual Cypress XT ultra low leakage GPU’s."

[ Szerkesztve ]

"Minden negyedik-ötödik magyar funkcionális analfabéta – derült ki a nemzetközi felmérésekből."

-

rocket

nagyúr

válasz

Oliverda

#1014

üzenetére

Oliverda

#1014

üzenetére

Esely az van ra, de 2x8pin, es 1x6pin csatlakozo lesz az ASUS kartyajan, ami ugye szinten PCI-SIG bukta lenne, PCI-E slot 75watt, 2x8pin 2x150watt, 1x6pin 75watt ez osszesen 450watt (ez nem a tenyleges fogyasztas), es ugye ha alaporajelen a kartyanak 300watt alatti TDP-je lenne, akkor kicsit tulzonak tunik a hely amit meghagytak, meg tuning esetere is. (foleg mivel a HD5970 is valojaban siman beeri 220watt kornyeken, hiaba 297watt a TDP-je.)

3 slot magas is lesz (a tervezoi kep alapjan) az meg ha jol remlik ATX szabvany buko.Termesztesen a PCI-SIG "pecset" hianya nem a vilagveget jelentene, ez nem egy torveny amit ha nem tartanak be annak buntetojogi kovetkezmenye lesz, viszont az AMD-nek ilyenhez a nevet adni csak akkor lenne ertelme ha muszaj, ami azt jelenti, hogy kozel (~5%)/egalban van a GTX480 a HD5970-nel, vagy gyorsabb nala. (ennek az eselye a Heaven benchmarkot leszamitva nem tul nagy)

Az eredeti cikk alapjan ami finnul van az ASUS kartyaja limitalt peldanyszamu lesz, ez is inkabb azt tukrozi, hogy ez az AIB-ok gerilla akcioja, es a celja igazabol az, hogy lehessen valami extrat arulni 800-1000$-ert is.

Latszik kozeleg a Cebit, akkor szoktak ilyen "csak azert is" termekek elokerulni, foleg az ASUS a nagy mestere ennek

[ Szerkesztve ]

"A lower resolution generally means that there can be more quality per pixel."

-

Abu85

HÁZIGAZDA

Micro Stuttering már mondtam, hogy az órajel szinkronizáció problémája teljesen kezelhető szoftveres oldalról, de mondtam, hogy kérdezd meg Gbors-ot ha nekem nem hiszel. Egyik gyártót sem érinti már a probléma. Egyszerű képszinkronizációt kell alkalmazni. Ez be van építve a CF és SLI algoritmusokba. A Hd 5970 esetében azért nem mérték ezt, mert már nem látható a diferencia, így nincs min rágódni. Természetesen a 9.7-es drivertől minden CF kártya megkapta a szinkronizációs AFR rendszert. Az NV a 185-ös driverben építette be.

Az a baj, hogy az AFR igazi problémájával nem foglalkozik senki, mindenki csak rég kijavított dolgokat ubán legendál.

A V-sync más, az nem javítja az alap problémát. A multi-gpu algoritmusban kellett ezt javítani.

Kinek a hozzászólásai alapján tájékozódjanak. Te minden nap más véleményt formálsz meg. Most éppen a Fermi az isten, de nemrég még azt mondtad, hogy félő, hogy R600 story lesz belőle. Szerinted ez következetes gondolkodásmód?

Persze nem baj, ha így próbálsz az AMD és az NV oldal között egyensúlyt tartani, csak ez nem következetes. Sőt vicces.

Persze nem baj, ha így próbálsz az AMD és az NV oldal között egyensúlyt tartani, csak ez nem következetes. Sőt vicces.  Ezzel csak megzavarod az embereket.

Ezzel csak megzavarod az embereket.

Olyan dolgokat hozol fel a Hd 5970 ellen, amiket már rég javítottak. Ellenben az AFR lényegi problémáját, még nem hallottam tőled.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Thrawn

félisten

Different songs for different moods. łłł DIII Thrawn#2856 łłł Look! More hidden footprints! łłł D4BAD łłł WoT: s_thrawn łłł

-

Oliverda

félisten

"...viszont az AMD-nek ilyenhez a nevet adni csak akkor lenne ertelme ha muszaj, ami azt jelenti, hogy kozel (~5%)/egalban van a GTX480 a HD5970-nel,"

Márpedig nem lesz egálban legalábbis nagyon úgy fest. Lehet hogy az ASUS sem erőlködne most egy ilyen kártyával ha már nem lennének tisztában azzal hogy mit fog tudni a Fermi.

Kíváncsi vagyok a többi gyártó hasonló megoldására. Az hogy az ASUS ilyen tápcsatlakozókat rakott rá még nem feltétlenül jelenti azt hogy a többi gyártó is így fog eljárni.

"Minden negyedik-ötödik magyar funkcionális analfabéta – derült ki a nemzetközi felmérésekből."

-

Abu85

HÁZIGAZDA

Látom ez sok embernek nem világos. Jó elmagyarázom. Két GPU-nál az AFR módban a jelenetek felváltva kerülnek a GPU-khoz. Ez azt eredményezi, hogy a két GPU gyakorlatilag egyszerre dolgozik két egymástól eltérő képkockán. Nyilván logikailag úgy a helyes, hogy amint kész a képkocka, megy ki a kép a monitorra. AFR-nél ez azt jelenteni, hogy rövid időn belül két képkocka lesz kiírva, míg a harmadikra várni kell egy nagyobb időt. Na most ez nagyon egyszerűen kezelhető szoftveresen. A két GPU-t úgy kell futtatni, hogy a képkockák kirajzolása között közel egyenletes időkülönbség legyen.

A témát pár fórumon futtatják és jönnek a grafikonokkal, de gyakorlati szinten már nem látható a különbség. Amikor legelőször felmerült a micro stuttering még semmi ilyen beállítás nem volt az AFR algoritmusokban, sőt komoly probléma volt, hogy az egyes GPU-k néha visszaváltották az órajelet, ami erős akadozást eredményezett bizonyos programokban. Innen indult az egész történet és azóta grafikonokon tartja fent magát.Az a vicces, hogy az input laggal nem foglalkozik senki, ami szoftveres oldalról kezelhetetlen, ezért valós probléma, a micro stutteringgel ellentétben. A baj az, hogy nem lehet szép színes grafikonokkal bolondítani a népet, és így nehéz urban legendákat gyártani.

Csak, hogy az input lagról is legyen képetek. Itt arról van szó, hogy AFR a jelenet előrébb tart a tényleges képkockánál. Ez igaz egy GPU-ra is, de az időkülönbség annyira kicsi, hogy ember fel nem fogja. A könnyebb értelmezéshez tegyük fel, hogy a futtatott program nem ütközik CPU-limitbe, azaz a tökéletes egyensúly valósul meg az erőforrások között. Amennyiben az előbbi állításunk teljesül, akkor négy grafikus processzor esetén a monitoron megjelenő képkocka nem az aktuális virtuális állapotot prezentálja, hanem a négy jelenettel előbbit. Érdemes megjegyezni, hogy itt rendkívül kis időkülönbségekről beszélünk, két GPU esetén gyakorlatilag az emberi elmével észrevehetetlen. A harmadik és a negyedik grafikus vezérlő befogása esetén is csak kevesen képesek a jelenséget realizálni. Nagyon fontos megjegyezni, hogy a nagymértékű input lag csak akkor áll fenn, ha a CPU és a GPU-k képességei az adott program szempontjából tökéletesen egyensúlyban vannak. CPU-limit esetén gyakorlatilag eleve limitálva van az AFR mód működése, míg a GPU erejének hiányában az input lag csak akkor jöhet elő, amikor már játszhatatlan sebességet produkál a beállított részletesség.

Valószínűleg az egész téma azért nem kapott még nagyobb visszhangot, mert nehéz megteremteni a szükséges feltételeket. Meg ugye nem lehet gyártani színes, és informatív grafikonokat belőle.

Remélem ezek után világos a lényeg. Két probléma lehetséges mindig, a kezelhető (micro stuttering) és a nem kezelhető (input lag). Előbbi nem probléma, mert van rá megoldás. Utóbbi gáz, mert a technológia mellékterméke.

Ha a multi-GPU ellen akar valaki felszólalni. Az input lagra helyezze a mondandóját.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

rocket

nagyúr

Mar megint magyarazkodsz, pedig ott van a lenyeg a linken, az nem tud kodde valni.

"Te minden nap más véleményt formálsz meg. Most éppen a Fermi az isten, de nemrég még azt mondtad, hogy félő, hogy R600 story lesz belőle. Szerinted ez következetes gondolkodásmód?"

En nem naponta valtogatom valamirol a velemenyem (nem is irtam soha olyat a Fermi az isten), kovetem az esemenyeket, es ha ugy gondolom az informaciok alapjan, hogy megkell valtoztassam a velemenyem, akkor megteszem szemrebbenes nelkul, ez az amire te keptelen vagy ha 180 fokot fordul ettol a kocka.

Nem azert, hogy magamat fenyezzem, de magasabb a hit:miss aranyom mint neked, pedig en csak egy forum felhasznalo vagyok, nem a hazigazda."Persze nem baj, ha így próbálsz az AMD és az NV oldal között egyensúlyt tartani, csak ez nem következetes.Ezzel csak megzavarod az embereket."

En a velemenyem irom le amit gondolok (vagy ha tudok valamit azt is megosztom), nem torekszek semmilyen egyensulyra.

Ezzel nem lehet senkit megzavarni, foleg mivel nem is ram figyelnek az emberek.

Az urban legendak krealasaval lehet megzavarni az embereket, ez meg a te specialitasod, raadasul mindig az erme ugyanazon oldalarol szarmaznak.Sokan probaltak mar veled megertetni a lenyeget, de ugytunik egyik fuleden be, masikon ki. (pontosabban szemeden be, fuleden ki

)

)The End.

"A lower resolution generally means that there can be more quality per pixel."

-

Oliverda

félisten

"Minden negyedik-ötödik magyar funkcionális analfabéta – derült ki a nemzetközi felmérésekből."

-

rocket

nagyúr

válasz

Oliverda

#1022

üzenetére

Oliverda

#1022

üzenetére

"IHW: Ever since the launch of 2000 series, we’ve been hearing about tessellation, but up to now, that technology has only been used in a tech demo, while we’re still waiting for games using the tessellation method. Unfortunately, when the demo was actually run, we noticed a major drop in performance when tessellation is on, with just the explanation that the drop is dependent on the implementation, i.e. the quantity of calculations needed for the tessellation process. We had the impression that tessellation will be very important for the visual quality of upcoming games, but that the performance drop wouldn’t be as drastic. Is that possible with the current generation of DirectX 11 GPUs?

RB: Tessellation is a postprocessing effect which should depend on the implementation, but my technical knowledge on the subject is not on the required level for me to give you a clear answer. It’s a good standard that’s been used on the Xbox 360 for years and will only advance and be more and more used in the future, now that it’s an integral part of DirectX 11."

Feltettek az arany kerdest, de sajnos egy sablon valasszal elintezte a dolgot.

Az ATi egyengeti a tesszelaciot (anno meg TrueForm-kent kezdte a palyafutasat) es agyon hypeoltak, foleg azota miota a DX11 API resze lett, szoval erdekelt volna most eppen mit gondolnak, hogy ugytunik nem nekik all a zaszlo.

Azert gratula a kerdezonek, hogy fel merte tenni a kerdest

"A lower resolution generally means that there can be more quality per pixel."

-

Oliverda

félisten

Általában az ilyen fejesek nincsenek teljesen képeben a legapróbb technikai részletekkel, tehát ez a sablon válasz várható volt.

"...szoval erdekelt volna most eppen mit gondolnak, hogy ugytunik nem nekik all a zaszlo."

Ma pont nem nekik áll de holnap vagy talán holnapután már lehet hogy nekik fog.

[ Szerkesztve ]

"Minden negyedik-ötödik magyar funkcionális analfabéta – derült ki a nemzetközi felmérésekből."

-

jé, távollétemben micro-stutter szakértő lettem

sokat lehet feszegetni ezt a témát elméleti oldalról, Abunak alapvetően igaza van, a fő problémák ki lettek gyomlálva. biztosan most is lehet mérni eltérést a két GPU képelőállítási idői között - de azt zárójelek között megjegyezném, hogy ugyanez mérhető 1 GPU esetén is. a gyakorlatban én sem az 5770CF-en, sem az 5970-en nem érzékeltem a jelenséget.

input lag kapcsán mindenkinek ajánlom ezt az anand cikket - és annyit tennék hozzá, hogy azonos fps mellett két GPU-val dupla input lagról beszélünk, mint eggyel. kettő felett meg sztem csak kirakat van, 4 GPU-val 60fps mellett az input lag 240ms körül alakul...

Pedro... amigo mio... ma is konzervvért iszunk! Kár lenne ezért a tehetséges gyerekért...

-

Oliverda

félisten

"Minden negyedik-ötödik magyar funkcionális analfabéta – derült ki a nemzetközi felmérésekből."

-

Abu85

HÁZIGAZDA

Elmagyaráztam, hogy mi a Micro stuttering lényege, és miért nem probléma. Aki ezt a kezelt problémát tekinti a multi-GPU legnagyobb nyűgjének, annak halvány fogalma sincs a valós gondokról. A frame számítás között egy GPU-val is merhető bőven különbség. Mint írtam a Micro stuttering azért kapott nagy figyelmet, mert lehet belőle színes grafikonokat rajzolni. Aki nem érti a lényegét, az nyilván előhozakodik vele, hogy mekkora baj.

Ezek szerint elfelejtetted, hogy két napja a Fermit fényezed.

Na de majd a hétvégén a másik oldalra állsz az egyensúly végett. Oliverda is megjegyezte, hogy mókás a dolog. Engem is szórakoztat. Főleg a magyarázkodással együtt.

Na de majd a hétvégén a másik oldalra állsz az egyensúly végett. Oliverda is megjegyezte, hogy mókás a dolog. Engem is szórakoztat. Főleg a magyarázkodással együtt.Kérlek ... a Micro stuttering egy urban legend.

Ki hozta fel? ... Nincs több kérdésem. Ha az input lagot hoztad volna fel, akkor mélységesen egyet értenék, de egy több éves, régóta kezelt problémát, aktívan legendálni.

Ki hozta fel? ... Nincs több kérdésem. Ha az input lagot hoztad volna fel, akkor mélységesen egyet értenék, de egy több éves, régóta kezelt problémát, aktívan legendálni.

Ja és még én gyártom a legendákat.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

rocket

nagyúr

Ott vannak a linkek, leirtam a lenyeget, ennel tobbet nem tudok tenni.

Nem engem kell meggyozzel egyebkent ennek az ellenkezojerol, hanem azokat akik emiatt akarnak valtani pl. a HD5970-rol a GTX480-ra

Szelektiven olvasol, en nem fenyezek semmit hanem leirom a velemenyem, erre valo a forum, ha egy informaciotol megvaltozik a velemenyem, akkor azt is leirom.

Itt olvashatod mit gondolok most a jelenleg rendelkezesre allo infok alapjan, ha szerinted ez fenyezes, akkor a problema nalad van.Szerintem rajtad tobben rohognek mint rajtam, annyi zoldseget hordtal mar ossze, hogy dunat lehetne vele rekeszteni.

A szakmai hozzaertesed a GPU-khoz melyviz szinte senki nem kerdojelezte meg soha, a latasmododdal van gond, hogy szinte keptelen vagy elvonatkoztatni az AMD-tol, es vannak temak amikben jobb lenne ha kepben lennek mielott leirsz valamit, mert hazigazda vagy.En is irtam mar zoldseget, es olyat is ami nem lett vegul igaz, es volt, hogy egyetertettem veled (pl. anno amikor az elso pletykak elojottek az akkor meg GT300-nak hivott valamirol, es ugy tunt ezek alapjan, hogy bizony az akkor mar agyon hypeolt tesszelacioban gyenge lesz), de aztan valtoztak a dolgok, es a tesszelacio ugyanugy fontos maradt, igy megvaltozott a velemenyem, te meg temat valtottal, es mostmar a tesszelacio nem szamit, csak mert eppen nem az AMD-nek all a zaszlo. (az egeszet ugye kezdted anno a 20millio vs 100millio tranzisztoros baromsaggal, ami a mai napig mosolyt csal az arcomra

)

)

Nincs miert egyensulyt tartsak mert lesz@rom magasrol az osszes ceget, mindig a velemenyem irom le.Van jopar micro stutteringgel kapcsolatos leiras, teszt, urban legenda akkor lehetne, ha a konkulzio az lenne nem letezik, de nem ez.

[ Szerkesztve ]

"A lower resolution generally means that there can be more quality per pixel."

-

Abu85

HÁZIGAZDA

Elolvastam, és számos probléma van a linken. Például egy GPU-val is lesznek ilyen eredmények. Ez abból következik, hogy az egyes framek számítása nem azonos ideig tart. Két GPU-val csak szinkronizáció kell, ezt leírtam, hogy évek óta létezik, és megfelelően működik. Volt CF rendszerem, láttam, hogy nincs gond. Gbors is leírta, hogy nem éérzett problémát CF esetén. A PH tesztekben is említettük volna ha gond lenne. De, ha nem értesz velünk egyet, akkor terjeszd tovább a rég kijavított micro stuttering urban legendjét. Engem nem zavar. Egyébként senki sem tagadja, hogy létezett. De azt világosan leírták, hogy az órajelek folyamatos, nem szinkronos változása okozta. Ilyenkor annyira elcsúszott a két frame, hogy akár 70-80 ms is volt közöttük, ami észrevehető volt. Azóta bőven jó tartományon belül mozognak az értékek, ahogy ezt Thrawn által linkelt tesztek is alátámasztják. Nincs ilyen magas eltérés. Persze a legenda tovább él.

Linkeld azt a játékot, ami olyan szintű tesszellációt használ, mint az Unigine Heaven benchmark.

Látod, nem én döntöm el, hogy mi lesz, hanem a fejlesztők. Én csak annyit tehetek, hogy leírom a véleményem, és hozzá a fejlesztők véleményét. Előbbire: Szerintem a tesszelláció fontos, és innovatív. Hasonlóan gondolkodom, mint a geometry shader idején sok dologra jó, és használni kellene. A fejlesztők ezzel szemben nem igazán alkalmazzák. Egyrészt a tesszellált felület logikai szinten nem létezik, így okosan kell vele bánni, hogy ne legyen hatással a játékmenetre. Értsd tesszellálva falat marhára nem jó öltél felhúzni, mert jelenetszámítás szintjén simán átlősz rajta, hiszen a fal csak a frame számításnál jön létre. További probléma, hogy az ütközésdetektálás is csak az eredeti modellre vonatkozik, a tesszellált esetén érdekes eredmények születhetnek. Itt is figyelni kell, az előbb említett okból kifolyólag. Jelenleg ezért korlátozódik az egész rendszer a karakterekre, mert egyelőre sok a nyitott kérdés, amit még nem volt idő alaposan átrágni.

Látod, nem én döntöm el, hogy mi lesz, hanem a fejlesztők. Én csak annyit tehetek, hogy leírom a véleményem, és hozzá a fejlesztők véleményét. Előbbire: Szerintem a tesszelláció fontos, és innovatív. Hasonlóan gondolkodom, mint a geometry shader idején sok dologra jó, és használni kellene. A fejlesztők ezzel szemben nem igazán alkalmazzák. Egyrészt a tesszellált felület logikai szinten nem létezik, így okosan kell vele bánni, hogy ne legyen hatással a játékmenetre. Értsd tesszellálva falat marhára nem jó öltél felhúzni, mert jelenetszámítás szintjén simán átlősz rajta, hiszen a fal csak a frame számításnál jön létre. További probléma, hogy az ütközésdetektálás is csak az eredeti modellre vonatkozik, a tesszellált esetén érdekes eredmények születhetnek. Itt is figyelni kell, az előbb említett okból kifolyólag. Jelenleg ezért korlátozódik az egész rendszer a karakterekre, mert egyelőre sok a nyitott kérdés, amit még nem volt idő alaposan átrágni.

Ja a teljesítmény is probléma. Az a sok kicsi háromszög nemcsak a setupot, hanem a geometry shadertől kezdve, minden más logikai futószalagot terhel. Ez főleg nagyon fáj az árnyalás és a textúrázás folyamán. Ez annyit jelent, hogy a fejlesztők kitörölhetik a seggüket egy erős setup motorral, ha nincs elég kraft a GPU-ban a háromszögek feldolgozására. Egyelőre egyik GPU-ban sincs. Várhatóan még legalább egy generációig nem lesz, de ez annyira nem lényeg, mert még legalább egy generáció, amíg megtanulják használni a rendszert. Addig effektekre és karakterekre, jó lesz. Esetleg pár felület még mehet. Az AVP-ben nem okozott gondot, legalábbis nem tűnt fel.Gondolom stratégiailag tudod, hogy miben különbözik az NV és az AMD fejlesztési elgondolása. A Fermi az NV tervezett csúcsmegoldása, míg az AMD-é a Hemlock. Az Unigine Heaven-ben is nehéz lesz a legerősebb Radeont befogni. Ebből nyilván látható, hogy a setup motor, harmad akkora textúrázó és számítókapacitás nélkül nem sokat ér. Nyilván a tranzisztorszám jól szemlélteti a dolgot, lehetett volna feleolyan erős setup motort csinálni, és jobban gyúrni a textúrázásra, vagy más helyen keresni egy kis plusz erőt, ami nem csak egy benchmark alatt jön ki. Itt hibázott anno az AMD az R600-nál. Olyan helyre fektetett elképesztő tranzisztormennyiséget, ami nem éreztette hatását. Akkor persze nem voltál ilyen lelkes a geometry shader kapcsán. A benchmark és tesztprogramokban be lett alázva minden NV-s megoldás. Volt valami érdemi hatása? A fejlesztők hozzányúltak olyan mértékben, hogy az káros legyen a GeForce-ra?

Ne essél ugyanabba a hibába, amibe én. Egy technika csak akkor ér valamit, ha kihasználják. Ettől lehet innovatívnak tekinteni az R600-at és a GF100-at, mert mindkét lapka olyat mutatott, amit eddig egyetlen elődje sem. Megmutatta az utat, hogy mi a jó egy új eljáráshoz. Lelkesedni is lehet a geometry shaderért és a tesszellátorért, de érdemes fél szemmel figyelni a fejlesztők véleményét ezekről, mert ez lesz a döntő, nem a lelkesedés.Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

rocket

nagyúr

Oke, meggyoztel, a micro-stuttering nem letezo problema, es akinek SLI/CF kartyaja van mindenki kitalalta, mert nem volt jobb dolguk.

Az a nev, hogy 3DMark mond neked valamit?

Tudod egy szintetikus benchmark aminek a teljesitmenye alapjan rengeteg ember vasarol, itt PH-n fenyevek ota nem hasznaljak a tesztekben, megis itt is slager.

Mar megint olyat magyarazol a temaba amirol nem volt szo, arrol van szo, hogy a hardvernek fekszik valami, akkor azt tudjak-e szoftverekkel parositani, es mivel az NV-rol van szo, nagyobb az esely ra mint az AMD-nel volt az R600-zal.Ezt irta a HD5830-rol Anandtech a teszt konkluzioban: (HD4890-hez kepest irja az elso mondatot)

"Meanwhile there’s a separate argument entirely over whether the 5830 is more future-proof (disregarding DX11) due to its higher shader throughput. Historically speaking this is a reasonable argument, but it’s also one that I’m not convinced will hold up when NVIDIA is going to be pushing tessellation instead of shading – you can’t ignore what NVIDIA’s doing given their clearly stronger developer relations."

A lenyeg benne van.

Ismerem a strategiakat, ha elolvastad volna szorol-szora a hozzaszolast amit linkeltem, akkor te is tudnad, hogy ismerem

"Itt hibázott anno az AMD az R600-nál. Olyan helyre fektetett elképesztő tranzisztormennyiséget, ami nem éreztette hatását."

Az NV ~80millioval (20 vs 100) tobb tranzisztort hasznal a tesszelaciora mint az AMD, es ~3.1milliard tranzisztorbol all a GPU, nem tunik elkepesztonek a kulonbseg.

"Akkor persze nem voltál ilyen lelkes a geometry shader kapcsán."

Rosszul emlekszel

"A benchmark és tesztprogramokban be lett alázva minden NV-s megoldás. Volt valami érdemi hatása?"

Volt, segitett a HD2xxx eladasokban (3DMarkban is jol szerepelt a HD2900XT), de ezen kivul szoftver supportot mar nem adott melle az AMD, az NV-nek meg van ilyen, es diszkret VGA piac vezetok, szerintem erezheto a kulonbseg.

(mielott megint kiforgatnad a szavakat, nem azt mondom biztoan ez fog tortenni, hanem, hogy megvan az eselyt ra, hogy az NV tud olyan iranyt mutatni ami az architekturajuknak jobban fekszik, amihez nehany jatek, es a kore epitett hype eleg, az AMD altal prezentalt DX11 jatekokban meg vigan elmennek majd a kartyak, teljesitmeny problema, es bugok nelkul.

Erre szoktam irni, hogy felkene vegye az AMD a kesztyut ha mashogy nem megy."A fejlesztők hozzányúltak olyan mértékben, hogy az káros legyen a GeForce-ra?"

Nem, mert az AMD-nek nem letezett szoftver tamogatasa, csak remeltek a sultgalamb majd magatol a szajukba repul.

"Ne essél ugyanabba a hibába, amibe én. Egy technika csak akkor ér valamit, ha kihasználják."

Beleestem ne aggodj, R600 kapcsan igen hasonlo allasponton voltunk anno, nekem ugy nagyabol 8-10 honappal kesobb kezdett buzleni a dolog, hogy az AMD nem csinal szoftver oldalon semmit se a helyzettel, aztan ugye ma mar tudni, hogy igy is lett amig szamitott volna valamit.

(R520 es az R580 is volt hasonlo, ott is pazaroltak a tranzisztorokat a Dynamic Branching teljesitmenyre, es szintetikus benchmarkban alaztak az NV G70/G71 chipjeit, de megse tudtak semmi extrat profitalni jatekokban belole.)"Lelkesedni is lehet a geometry shaderért és a tesszellátorért, de érdemes fél szemmel figyelni a fejlesztők véleményét ezekről, mert ez lesz a döntő, nem a lelkesedés."

Nem szamit a velemenyuk, meglehet oket gyozni mi legyen a fontos.

Szerintem nem letezik olyan fejleszto akihez odaallitanak egy valag penzzel es meg esetleg hardverekkel/emberi erovel is tamogatjak es azt mondja, hogy kivul tagasabb, ezt megtehetne az AMD is, nincs az NV-hez kotve.

Ha igazam lesz, akkor majd ne az NV-re menjen megint a mutogatas, hanem az legyen a kerdes inkabb, hogy az AMD miert nem kepes ugyanerre.[ Szerkesztve ]

"A lower resolution generally means that there can be more quality per pixel."

-

Shufny

őstag

Nem elképzelhető, hogy azért alakították így az arányt (mármint, hogy nagyobb a hangsúly a setup motoron), mert későbbiekben nem kell áttérni másik felépítésre, és a textúrázókat pedig egyszerűbben lehet hízlalni? Csak mert fogalmam sincs technikailag az ehhez képest fele olyan erős setup motor hogyan képződik.

-

Abu85

HÁZIGAZDA

Végre belátod. Ideje volt már. Gondolom hatott rád, hogy Gbors is mondta, a micro-stuttering nem valós probléma.

Ellenben az input lagról dumizhatunk, az lényeges.

Ellenben az input lagról dumizhatunk, az lényeges.

Nem nem szoktam 3Dmark-ot nézni. Csak a játékokkal játszom.

Ha az NV-nek olyan erős a dev support-ja, miért rohant a fejlesztők többsége az AMD-hez a DX11 okán? Kicsit ellentmondásos.

Arról is megfelejtkezünk, hogy az AMD eddig több DX11-es címet hozott, mint az NV. Kezd a buli kiegyenlítődni ... nem? Apropó hallottad, hogy az AMD a Modern Warfare 2 kapcsán csinált egy marketingszerződést. Mostantól lehet csomagolni a Radeonokhoz.

Arról is megfelejtkezünk, hogy az AMD eddig több DX11-es címet hozott, mint az NV. Kezd a buli kiegyenlítődni ... nem? Apropó hallottad, hogy az AMD a Modern Warfare 2 kapcsán csinált egy marketingszerződést. Mostantól lehet csomagolni a Radeonokhoz.

Pár dolgot megint elfelejtesz a trenzisztorszám kapcsán. Ugye, mint informálódtam az AMD egy 20 millió tranyós egységet használ, míg az NV összesítve 80 milliósat, ami ugye 16 egységre leosztva 5 millió/egység. Nyilván az egyes SM-eknek nem kell olyan erős rendszer, mint egy egész GPU-nak. Na most itt jön még a setup motor, ami az AMD-nél egy van. Ez egészíti ki a tesszellátort, egyébként ez elég sok tranyó. Az NV-nek ebből van 4 raszter motor, és 16 geometriai motor, ergó rengeteg egység sokkal többször van. Ez összességében sokkal több tranzisztor 100 milliós nagyságrendekkel. Ebbe is érdemes belegondolni. A setup szétlövése hatalmas ár a tranzisztormennyiségben. Nem véletlen csökkent a textúrázókapacitás. Nem volt több hely.

A 3Dmarkban mikor lett bealázva az NV. Kb. Soha. Nem is épült pipe GS-re a Vantage. Ahol megpusztult az NV az Emil Person GI demója. Szép volt, de mégsem játék.

Khm. Ez nem teljesen van így a fejlesztőknél. A STALKER-es srácok írták, hogy a Clear Sky-ban azért nem alkalmaztak GS-t, mert sok volt a GeForce felhasználó. Mindig a célközönség számít. Sok GeForce volt a piacon és nem lehetett őket kifektetni.

A tesszellátornál más a helyzet, mint a GS-nél. A GS-be a GeForce belehal, míg a tesszellálásba a Radeonok nem. Persze nem ez a fő probléma, hanem a keletkező háromszögek árnyalása és textúrázása. Odaállíthatsz pénzzel, de miért jó egy fejlesztőnek, ha olyan játékot gyárt, ami semmin sem fut max. grafikán. Még a Fermin sem. Mondtam, hogy a setup erőssége nem elég. Amit ott megnyer, azt elveszti a sok millió háromszög feldolgozásán.

Nem teheti meg az AMD. Nem szarhatnak rá arra a piacra, amiből meg akarnak a jövőben élni. Régebben az NV sosem akciózott ilyen erős lefizetésekkel, meg kizárásokkal, effektek úgymond megvásárlásával. A durvább akciók nemrég kezdődtek. egy éve kb. Tudják, hogy ez árt a PC-s játékiparnak. Most azért csinálják, mert látják, hogy itt nincs hosszútávú jövőjük, így nem baj ártalmas a piacra, amíg szükségük van rá, addig el lesznek adva a termékek. Azután meg marhára mindegy lesz, hogy mit hagynak ott az AMD-nek és az Intelnek.

Shufny: A setup motort azért alakíthatták így, mert a Fermi új piacokat fog megtámadni. A filmek animációjához pont ez kell. A professzionális szinten a voxeles technikák is előnyt kovácsolhatnak belőle.

A játékpiacra sok lenne fele ilyen erős is, és maradna hely a 128 textúrázó csatornára. Az meg, hogy "more effencient" textúrázók. Ez eléggé marketingszöveg. Amit alakítottak, az a gyorsított Jittered Sampling. Ez a gyorsítás nélküli eredményhez képest 2x-es teljesítmény a vektoros feldolgozás miatt. Teljes képkockára levetítve ez 5-10% plusz FPS-ben. Jittered Samplingot használnak a 3D markok. Abban előnyös lesz. Játékot hirtelen nem tudok mondani, de majd utánanézek.[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Shufny

őstag

"Új" piac? Nem úgy volt, hogy a prof. piacon az nV méginkább uralkodik? Vagy ezeket eddig inkább CPU -val csinálták?

Ezek fényében tippek a következő generációval kapcsolatban? Pl: ha bírni fog értelmes órajelet, és kibővíthetik a textúrázó részt. Mennyire megvalósítható ez, illetve elég-e arra, hogy megfordítsa a jelenlegi felállást? Vagy sokkal valószínűbb, hogy nem fektetnek rá akkora hangsúlyt, csak adják amég lehet, játékos GPU -ként? Az az igazság, hogy az nV nagyon nagy márkává tette a GF -et, és pláne ilyen erős marketinggel, mint az övék simán ellenfele lehet a PC a konzoloknak a rendszerintegrációval. Szóval az, hogy jelenleg a PC játékpiac leágazóban van, nem jelenti azt, hogy később nem lesz nagyon jövedelmező.

Szerintem nem egyértelmű, hogy az nV -nek hagynia kéne elsüllyedni a GeForce -ot, nagyon jövedelmező befektetés lehet még. -

Abu85

HÁZIGAZDA

Számos olyan részpiac van, ami bevehető, és a Fermi be is fogja venni. Ez a cél ... GPU-t mindenhova.

Évek óta egyre kevesebb diszkrét kártyát adnak el. A legjobb piacok már nem ezek. A mobil piac kezd feltörni, míg az asztali nem az igazi. Bár még használható.Ha a GF100 bírná a tervezett órajeleket, akkor ezzel a rendszerrel sem lenne baj (leszámítva, hogy késett). A textúrázókat áttették a magórajelről a shader órajel felére. A pletykák alapján a tervezett szerint ez 1 GHz-es frekit jelentett volna, de mivel ez nincs meg, így baj van. Jelenleg a reálisan elérhető magórajel-shaderórajel aránya 1:2. Tervszinten 1:3-3,5-höz lenne megfelelő.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Shufny

őstag

Úgy értettem, hogy köv. generációnak elég-e? (Fermi 2 ha úgy tetszik) Tudom, hogy nagyon attól függ közben mi van a piacon software illetve ATi ügyileg, de elvégre ez találgatós topic

. Az már látszik, hogy 5-ös széria ellen vesztett a helyzet, szóval a következő ellen ki tudják-e pofozni annyira a Fermit, hogy ütős legyen.

. Az már látszik, hogy 5-ös széria ellen vesztett a helyzet, szóval a következő ellen ki tudják-e pofozni annyira a Fermit, hogy ütős legyen.Mobil piac szerintem relatíve gyorsan telítődni fog, az asztalit pedig fel lehetne lendíteni, azért van leágazóban, mert nincs egy óriás aki reklámozná. (mint a konzolok illetve Mac esetében)

[ Szerkesztve ]

-

ez egy olyan lépés volt, amit szerintem mindkét gyártó régóta fontolgatott, és az nVidiának volt előbb mersze meglépni. biztosan sokba került tranzisztorban, viszont lényegesen rugalmasabbá teszi a GPU-t - amellett, amiket Abu írt, azokat a játék-oldali törekvéseket is segíti, akik unják a jelenlegi begyöpösödött fix futószalagot. persze, ha ugyanezt az AMD is megcsinálja a következő generációban, akkor ezzel az nVidia pont semmit nem ért el, mert annyira még nem járunk közel egy szoftver-futószalagos Unreal Engine-hez vagy ID Tech-engine-hez.

microstuttering: azért just for the record, olyat nem írtam, hogy sosem volt probléma. nagyon egyszerű gyakorlati példát hozni, hogy mikor fordul ilyen elő - ha a CPU sokkal gyorsabb, mint a két GPU együtt, akkor kihány magából két frame-et, aztán pihen. ezért ha nincs szinkronizáció, akkor az első frame kevés ideig lesz a képernyőn, a második meg sokáig.

Pedro... amigo mio... ma is konzervvért iszunk! Kár lenne ezért a tehetséges gyerekért...

-

Abu85

HÁZIGAZDA

Persze. Valós probléma volt, de már rég nem az, mert az multi-GPU algoritmusokban ott a kezelés rá. Ellenben az input lagról sosem beszélünk, ami azért valljuk be sokkal komolyabb dolog. Függetlenül attól, hogy erről nem lehet színes grafikonokat gyártani. Ja és ráadásul kezelni sem lehet, mert nincs rá megoldás. Illetve az AFR leváltása, de hát ez még ebben a generációban nem téma.

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

rocket

nagyúr

En is, de tudhatod jol nem az ilyen emberek teszik ki a jelentos tobbseget, csak nezzel itt korbe, pedig ugye PH (nagyon helyesen) evek ota nem favorizalja a szintetikus benchmarkokat.

"Ha az NV-nek olyan erős a dev support-ja, miért rohant a fejlesztők többsége az AMD-hez a DX11 okán?"

Mert az AMD-nek elobb volt DX11 hardvere, hogy ebbol az elonybol profital-e az AMD, vagy siman elfog futni az NV DX11 kartyain majd kiderul.

Tovabbra se arrol van szo nem tamogat az AMD jatekokat, hanem, hogy mikent teszi azt.

Persze lehet majd kiderul a GF100 megjelensekor piacon levo DX11 jatekok AMD altali szekcioja nem az NV-nek fog kedvezni, de ha elfutnak normalisan,bugok nelkul, mig a tuloldalon amit az NV DX11 projecttel csak a szivas lesz, az nem az AMD dicserete lesz.

Metro2033 az osszes AMD altal penzelt jateknal nagyobb hypeot kapott mar, es meg van kicsit tobb mint 2 het a megjelenesig.

Nem nagyon frissul az AMD DX11 tablazata, itt az uj, es itt az elotte levo,a BC2 ami napokon belul megjelenik (amihez mar ugye az NV-nek is volt 1-2 szava), 3 MMO amikbol nem lesz benchmark jatek (ez is nagyon fontos marketing szempont), kettohoz patch formajaban erkezik majd DX11 tamogatast ami szinten nem sok fizet fog zavarni, a Genghis Khan neve helyett meg mar csak MMO szerepel, Frostbite 2 enginre epulo jatek iden szerintem nem lesz, Vision Engine-re epulo jatekok kozul az egyik mar elbukta a DX11 tamogatast, a masiknak meg nevet is elfelejtettem a "sok" informaciotol amit jott rola, pedig irtam rola nehany honapja

Persze mar ismerem a sablon valaszt, hogy "20+ DX11 jatek keszul" (amik melle az AMD mentalitasat ismerve mar az NV is reg adott tamogatast, sot talan mar a maguk javara is forditottak a helyzetet), es az AMD nem beszelhet roluk, lehet igy van, de ez se az AMD-t dicseri, mert milyen tamogatas az ahol a jatekot nem hasznalhatod fel sajat magad marketing celjaira, ami ugye a jatekot is segiti, mert hypeot general. (ismet csak lenne mit tanulni a konkuenciatol az AMD-nek)

"Pár dolgot megint elfelejtesz a trenzisztorszám kapcsán. Ugye, mint informálódtam az AMD egy 20 millió tranyós egységet használ, míg az NV összesítve 80 milliósat, ami ugye 16 egységre leosztva 5 millió/egység. Nyilván az egyes SM-eknek nem kell olyan erős rendszer, mint egy egész GPU-nak. Na most itt jön még a setup motor, ami az AMD-nél egy van. Ez egészíti ki a tesszellátort, egyébként ez elég sok tranyó. Az NV-nek ebből van 4 raszter motor, és 16 geometriai motor, ergó rengeteg egység sokkal többször van. Ez összességében sokkal több tranzisztor 100 milliós nagyságrendekkel. Ebbe is érdemes belegondolni. A setup szétlövése hatalmas ár a tranzisztormennyiségben. Nem véletlen csökkent a textúrázókapacitás. Nem volt több hely."

Ezt a 20millio vs 100millio tranzisztoros dolgot neked koszonheti a forum, ezzel probaltad magyarazni mekkora kiraly is valojaban az AMD tesszelacioban

Nem az a lenyeg, hogy fekszik ki, hanem az, hogy meggyozd a jatekok fejlesztoit ugy hasznaljak, hogy az neked kezdvezzen, es ne a konkurencianak, ennyi.

Ertem en, hogy van szuk keresztmetszet az NV architekturajaban, nem is errol volt szo, csak mar nem tudsz mit irni valaszkent (vagy tenyleg nem erted mirol irtam) ezert hozod fel allandoan.

Ez mar tenyleg mokuskerek effektus lett

"A 3Dmarkban mikor lett bealázva az NV. Kb. Soha. Nem is épült pipe GS-re a Vantage. Ahol megpusztult az NV az Emil Person GI demója. Szép volt, de mégsem játék."

Sokaig nem volt meg a Vantage amikor megjelent az R600, igy amirol szo volt feladatot a 3DMark2k6 latta el.

"Khm. Ez nem teljesen van így a fejlesztőknél. A STALKER-es srácok írták, hogy a Clear Sky-ban azért nem alkalmaztak GS-t, mert sok volt a GeForce felhasználó. Mindig a célközönség számít. Sok GeForce volt a piacon és nem lehetett őket kifektetni."

Forditott esetben keves AMD felhasznalo van?

~40%-os piaci reszesedsre lehet tenni magasrol?

Amit felhoztal peldtat is azt mutatja amirol szo van, hogy az AMD szoftver tamogatasi politikaja nem eleg agressziv, akkor lenne ez jo ha az NV is ezt csinalna, de ok nem igy csinaljak, akkor tehat az AMD-nek kell hozza alkalmazkodni.

Megvolt a lehetosege az AMD-nek, sot meg most is megvan (~5millio eladott DX11 kartya VS 0), es meg jo ideig meg is lesz, ennel nagyobb ziccer nem letezik.

Remenykedni lehet gyoz a jozan esz, de regen se minden esetben gyozott, biztos most is elobb-utobb lesznek kivetelek.

(Metro2033 esetebol majd talan kiderul milyen iranyt vehet a tortenet.)"A tesszellátornál más a helyzet, mint a GS-nél. A GS-be a GeForce belehal, míg a tesszellálásba a Radeonok nem. Persze nem ez a fő probléma, hanem a keletkező háromszögek árnyalása és textúrázása."

Tehat ha jol ertem amit mondani akarsz, akkor ha csak 30%-kal lesznek lassabbak tesszelacio mellett a Radeonok mint atlagosan anelkul, akkor az az AMD sikere?

"Odaállíthatsz pénzzel, de miért jó egy fejlesztőnek, ha olyan játékot gyárt, ami semmin sem fut max. grafikán. Még a Fermin sem."

Crysis pont ilyen jatek volt.

"Nem teheti meg az AMD. Nem szarhatnak rá arra a piacra, amiből meg akarnak a jövőben élni. Régebben az NV sosem akciózott ilyen erős lefizetésekkel, meg kizárásokkal, effektek úgymond megvásárlásával. A durvább akciók nemrég kezdődtek. egy éve kb. Tudják, hogy ez árt a PC-s játékiparnak. Most azért csinálják, mert látják, hogy itt nincs hosszútávú jövőjük, így nem baj ártalmas a piacra, amíg szükségük van rá, addig el lesznek adva a termékek. Azután meg marhára mindegy lesz, hogy mit hagynak ott az AMD-nek és az Intelnek."

De megtehetnek, es meg is kene tennie mert (az NV jol bevallt strategiaja nem fog megvaltozni), ez lenne az AMD erdeke, attol mert megvesznek egy jatekot ami az atlagosnal 20%-kal jobban fut (mint a konkurens termekek) az o kartyaikon DX11 alatt , mint anelkul, akkor azzal nem rombolnak semmit. (ugye valaha meg nagy reszben az NV is igy mukodott, amikor a jatekok 90%-at tamogattak, azota mar modosult a strategia, de persze most se minden jatek "csak azert is szivjak meg az AMD felhasznaloi" elvre epul.

Gondolod a Radeon tulajok nem szeretnek egyszer megerezni milyen a kocka felso felen lenni? , es nem azt hallgatni, hogy mikor jon a patch, driver fix, stb.?

Csak Radeon kartyaim vannak mar evek ota, kivancsi lennek az NV felhasznaloi mit mondananak ha megfordul a kocka X jatekban, es nem azert mert rosszat akarnak nekik, csak kivancsi lennek akkor is viccesnek talalnak-e ezt az egeszet. (most ugye joggal rohoghetnek amikor kijon X jatek, el se indul, vagy bugos, vagy kitudja mikor jon hotfix, vagy patch hozza.)

Az emberek tobbsege nem 2-3 honappal megjelenes utan szeretne az altala nagyon vart jatekot jatszani bugok es teljesitmeny problemal nelkul, hanem megjelenes napjatol.

Atlathatoan mukodik az NV gepezete, az , hogy az AMD keptelen megtenni hasonlot azzal csak maga alatt vagjak a fat.Mostmar eljutott oda ez az egesz tortenet, hogy talan ideje lenne tullepni az NV szidasan, es feltenni a kerdest az AMD-nek, hogy miert nem kepesek hasonlora.

[ Szerkesztve ]

"A lower resolution generally means that there can be more quality per pixel."

-

Shufny

őstag

Ha az AMD is elkezdi ugyanezt játszani, annak tényleg csak az lesz a vége, hogy SENKI nem tud majd megjelenéskor játszani a játékokkal probléma mentesen, sőt lehet később se. Na most amikor a konzolosok azért rinyáltak, hogy "hosszas instalálás" akkor ez a jelenség majd biztos kellően pozitívan hat a PC -re mint platform. Ez jelenleg az AMD -t érintené rosszabbul. Amit tehetnének az egy iszonyatos kampájn, de ilyen anyagi helyzettel arról álmodni se merhetnek. Pedig ez a megoldás szerintem többszörösen megtérülne.

A Metro 2033 sokkal kevésbé sikervárományos, mint a BC2, csak ugye annál sikerült elbukni a marketing jogokat (vagy nem is voltak, nem tudom). Az AvP -nek borzasztó szintű hype -ja volt, csak erősen alulteljesített a végtermék (de most komolyan, hogy már a gugolást is kiveszik egy játékból...).

(#1039) gbors: Ejj de informálatlan vagyok, nem is tudtam, hogy pletykálnak az id Tech 6 -ról.

-

smkb

őstag

Igen, inkább ülnek várják a sültgalambot, hogy az NV egyszercsak magától feladja a piac általa birtokolt 2/3-adát. Amíg nem, addig meg szívás van AMD oldalon. Remek hozzáállás az AMD részéről. Én pl személy szerint marhára örülnék, ha a VGA gyártóm kiállna mellettem is nem csak az NV tulajok mellett a sajátjuk. Így meg addig élvezem azt, hogy patchekre meg hotfixekre várok... NFS Shift is... de élveztem, hogy a rajtnál mindig beesik 15fps alá a játék, míg egy mezei 9600GT-n is zsírul futott. Majd 3 hónap múlva mire végigszenvedtem meg jött a patch... csak már nem érintett. Nem az NV-t kell szidni, mert mögötte a piac 2/3 a van, ennyien birtokolnak NV kártyát és elégedettek. Ők nem szidják. Csak a AMD szemüveggel nézve van itt nagy nagy piacrombolás. Csak az AMD tulajoknak, a kisebbségnek fáj. NV csak szolgáltat, a vásárlóinak. AMD is megtehetné.

-

rocket

nagyúr

AMD is ezt csinalna akkor is lenne aki tudna jatszani megjelenes napjan, csak X jatek X kartyan, Y meg Y kartyan futna normalisan.

Azt nem mondom ez jo dolog, csak azt, hogy az NV nem fog valtoztatni, es azzal amit fentebb irtam jobban jarna az AMD, mintha X jatek fut normalisan X es Y kartyakon is, mig Y jatek tovabbra is csak Y kartyan fut normalisan.

Termesztesen amirol szo van nem minden jatekot erint, sot kis mennyiseget, de azok altalaban presztizs jatekok (nem feltetlen a nevuk miatt mint siker jatek varomanyos, lehet csak a hype miatt amit sikerult kialalkitani korulotte.)"Na most amikor a konzolosok azért rinyáltak, hogy "hosszas instalálás" akkor ez a jelenség majd biztos kellően pozitívan hat a PC -re mint platform. Ez jelenleg az AMD -t érintené rosszabbul. Amit tehetnének az egy iszonyatos kampájn, de ilyen anyagi helyzettel arról álmodni se merhetnek. Pedig ez a megoldás szerintem többszörösen megtérülne."

Nem ertem ezt a reszt.

Metro2033 egy uj jatek, nem egy jateknak a sokadik resze (mint a Battlefield eseteben), igy elore nehez megitelni melyik a kevesbe sikervaromanyos, persze a logika szerint a Battlefield mar egy bejarott brand, amit a neve is elad majd megha esetleg nem is lesz olyan jo mint ahogy a felhasznalok tobbsege varta, de meg ebben az esetben is megvan az eselye, hogy a Metro2033 is siker jatek legyen.

A sikert nehez kivulrol felmerni, mert tobb tenyezobol all ossze.

Mondjuk maradjunk ennel a 2 jateknal, a szamokat csak erzekeltetesul irom, mindketto 50$ lenne, Metro2033-nak 3millio$, BC2-nek 20millio$ a fejlesztesi koltsege, 1 ev alatt az elsobol eladnak 250000 darabot, a masikbol 1millio darabot, nem a BC2 lesz a sikeresebb.

(es akkor meg a tobbi osszetevorol nem is beszeltunk, mint a marketing koltsegek, stb.)Tehat a lenyeg a szoftverek eladott mennyiseg alapjan sikeresseget hirdetni nem lehet, mert az csak a teljes kep egyik reszlete.

BC2 inkabb egy multiplayer jatek mint single, ebben az esetben ugye a sokkal sikeresebb kene legyen a jatek, mert a viragbolti verzioval altalaban online jateknal falakba utkozhetnek akik ilyet hasznalnak, de ez se egyenlo a sikerrel.

COD:MW2 is inkabb MP jateknak mondhato ami ugye gatat szab a wareznak, megis siralmasan szerepelt eladasokban a PC verzio a konzolos eladasokhoz kepest PC-n, pedig mennyivel tobb potencialis vasarlonak van meg mindig PC-je, es a bill+eger is ezt a platformot kene segitse."A lower resolution generally means that there can be more quality per pixel."

-

Abu85

HÁZIGAZDA

Nem bukta el. Az Arcania sose volt DX11-re fejlesztve. Ellenben van egy Spellbound project, ami DX11-es lesz, de ez csak később lesz bejelentve. Abból jöttek a képek. A Genghis Khant fejlesztik, de más lesz a neve állítólag. Sok dolgon persze ez nem változtat.

Szerintem a legnagyobb hype-ot a Dirt 2 kapta eddig. A Metro 2033-ról még sokan nem is hallottak.

Mert információ a tranyószám. Sajnos még mindig nem érted, hogy nem a setup-on múlik a játék sebessége, hanem sok probléma lesz a textúrázókapacitás. Nincs olyan, hogy a GF100-nak fekszik, mert játékot nem lehet a háromszögek textúrázása és árnyalása nélkül elintézni. A Hemlock mindenképpen előtte lesz. Ergo nem érzem azt, hogy az NV jól döntött a setup kiizmosításán, és a textúrázókapacitás visszafogásán. Persze ha meg lenne a tervezett 2 GHz-es shader órajel, akkor ok, de nincs meg.

Melyik játékot nem használják fel marketingre az AMD. Eddig a Dirt 2-ről és az AVP-ről is sokat beszéltek. Most kötöttek szerződést a Modern Warfare 2-vel kapcsolatban. Ezt a Radeonok mellé csomagolják. Ez mi, ha nem jó marketing?

A Hemlock összességében nem lesz lassabb a GF100-nál. Így az NV csúcsmegoldása mindenhol verve lesz. Heaven-ben kevésbé, játékokban eléggé. A Setup motor nyilván erősebb a GF100-ban, de az Hemlock ezt behozza a textúrázáson. Eltérő stratégia. Dave Baumann írta a B3D-n, hogy a fejlesztők mondták, hogy egyelőre nem tervezik a tesszellálás komoly használatát, amit az eddig megjelent és hivatalosan bejelentett DX11-es játékok alá is támasztanak. Ezért döntött az AMD a számítási kapacitás erősítésén.

És a Crysis sikeres lett anyagilag? Visszahozta, amit beleültek, de ennél sokkal többre számítottak.

Ennél egyszerűbb az AMD stratégiája, új algoritmusokkal dolgoznak. Például a DX11-hez kötik, majd az AA-t. AVP-ben már láthatod.

Shufny: Kb. Ez a fő problémájuk. Nem szabad gyengíteni a PC-s játékpiacot.

A BC2 még mindig nem tiszta, de elvileg a két szerződés nem fedi egymást. Az AMD a DICE DX11 technológiáival vagy a BC2-vel reklámozhatja a Radeonokat a hivatalos bemutatókon. Az NV az EA-n keresztül készíthet színes plakátokat BC2-val, amihez GeForce-ot ajánlanak. Nagyobb problémának tűnt, de úgy néz ki nem lesz belőle nagyobb gond mint, hogy az EA GeForce-ot ajánl a BC2-höz, míg a DICE Radeont.[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Shufny

őstag

Arra írtam, hogy ha már plusz egy kattintás, az is "szopásnak" minősül a konzolosoknak, akkor mikor figyelni kell, hogy melyik game éppen melyik kártyával hajlandó rendesen futni, illetve ha már belefutottál egy olyanba, ami nem, állandóan figyelni a patchet: megoldhatatlan feladat lehet számukra -> mégtöbben térnek át véglegesen konzolra. Az ilyet pedig baromi nehéz visszaszerezni (ugye látod te is, hogy megy a rinyálás, hogy soha többet xy termék mert egyszer valami nem működött mikor az volt a közelben

). Szóval hosszú távon a viszonzással többet bukhat az AMD, mint amit nyer vele most.

). Szóval hosszú távon a viszonzással többet bukhat az AMD, mint amit nyer vele most.VGA reklámozásnál szerintem egyértelműen az eladott dbszám a lényeg. Esetleg az aktív játékosok száma. Mindkettő esetében fölényes BC2 győzelemre tippelek. (Az általad is leírt okok miatt, kiegészítve azzal, hogy nekem a Metro erősen átlagosnak néz ki)

-

DeckardCain

senior tag

-

smkb

őstag

válasz

DeckardCain

#1047

üzenetére

DeckardCain

#1047

üzenetére

szuper...akkor a megjenelésük óta a 2. áremelése jön a 40nm gpu-knak... csak most mindkét oldal termékeinek ára emelkedhet...

-

csatahajós

senior tag

Kis nyálcsorgatás:

Asus Ares (2 teljes sebességű, 850Mhz-es Cypress + 4GB GDDR5)

[ Szerkesztve ]

-

csatahajós

senior tag

válasz

csatahajós

#1049

üzenetére

csatahajós

#1049

üzenetére

Itt a Sapphire verzió is. Igazából ahogy látom csak simán rápakoltak egy Accelero Xtremet meg dupla memót, a NYÁK azon kívül hogy kék nem tűnik túslágosan különbözőnek (már amennyire ezekből a képekből meg lehet ítélni)

Új hozzászólás Aktív témák

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

MIELŐTT LINKELNÉL VAGY KÉRDEZNÉL, MINDIG OLVASS KICSIT VISSZA!!

A topik témája:

Az AMD éppen érkező, vagy jövőbeni új grafikus processzorainak kivesézése, lehetőleg minél inkább szakmai keretek között maradva. Architektúra, esélylatolgatás, érdekességek, spekulációk, stb.

) akkor veszek azt esetleg.

) akkor veszek azt esetleg.

Persze nem baj, ha így próbálsz az AMD és az NV oldal között egyensúlyt tartani, csak ez nem következetes. Sőt vicces.

Persze nem baj, ha így próbálsz az AMD és az NV oldal között egyensúlyt tartani, csak ez nem következetes. Sőt vicces.

)

)