- Az NVIDIA szerint a partnereik prémium AI PC-ket kínálnak

- Két Zen 5-ös dizájnjának mintáit is szállítja már az AMD

- A Colorful "fagyosan kompakt" alkatrészekkel megy elébe a nyárnak

- A Keychron ismét egy űr betöltését vállalta magára az egerek szegmensében

- Az átlagnál vaskosabb ventilátorok kandikáltak ki a Corsair vitorlája mögül

- Kihívás a középkategóriában: teszten a Radeon RX 7600 XT

- Milyen billentyűzetet vegyek?

- NVIDIA GeForce RTX 4080 /4080S / 4090 (AD103 / 102)

- Fujifilm X

- OLED TV topic

- NVIDIA GeForce RTX 3080 / 3090 / Ti (GA102)

- Bambu Lab X1/X1C, P1P-P1S és A1 mini tulajok

- Raspberry Pi

- AMD vs. INTEL vs. NVIDIA

- Modern monitorokra köthető 3dfx Voodoo kártya a fészerből

Hirdetés

-

Toyota Corolla Touring Sport 2.0 teszt és az autóipar

lo Némi autóipari kitekintés után egy középkategóriás autót mutatok be, ami az észszerűség műhelyében készül.

-

A legtöbb amerikai szerint a TikTok egy őket befolyásoló eszköz

it Egy felmérés szerint a legtöbb amerikai osztja azon véleményt, hogy a TikTok egy őket befolyásoló eszköz.

-

Premier előzetest kapott a V Rising

gp Napokon belül befut a teljes PC-s kiadás, az év során pedig megkapjuk a PlayStation 5 változatot.

Új hozzászólás Aktív témák

-

-

Cefet

aktív tag

nVidia... ehhh, mutatványos bódé...

-

Eclips21

őstag

micsoda marketing fogas egyertelmu hogy direkt csinaltak ez minden netes oldalon +1 ingyen nvidia reklam, amugy rontgen alatt kiderul a pontos merete nem?

[ Szerkesztve ]

-

hugo chávez

aktív tag

"Errol az AMD altal 800 millioval elszamolt Bulldozer tranzisztor szam jut eszembe

"

"Bezonyám!

És az Intel is trükközik az Ivy-Haswell tranzisztorszámokkal, mert én valahogy nem tudom elhinni, hogy a Haswellben kevesebb van, mint az Ivy-ben. És most már a tranyószám után a lapka mérete sem valós adat, marha jó...

És az Intel is trükközik az Ivy-Haswell tranzisztorszámokkal, mert én valahogy nem tudom elhinni, hogy a Haswellben kevesebb van, mint az Ivy-ben. És most már a tranyószám után a lapka mérete sem valós adat, marha jó...(#27) namaste:

"A HD Graphics hardveresen tudja az FP64-et 1/4 aránnyal, de az OpenCL driver nem támogatja."

Akkor csak jól emlékeztem, hogy tud DP-t is! Valahol olvastam még régen, de azóta sem találtam meg...

"sajnos ez a beszélgetés olyan alacsony szintre jutott, hogy a továbbiakban már nem méltó hozzám" - by Pikari

-

laceszgamer

addikt

Mondjuk szerintem amíg a teljesítmény/fogyasztása ilyen jó addig felőlem akár 2 darabból is felépülhetne.

Dovahkiin, Dovahkiin naal ok zin los vahriin wah dein vokul mahfaeraak ahst vaal! Ahrk fin norok paal graan fod nust hon zindro zaan Dovahkiin, fah hin kogaan mu draal!

-

schwartz

addikt

En valami hasanlo cimet adtam volna ennek a rendkivul magas hirertekkel biro cikknek, hogy: Az NV chipen nincs fogas, de elo kell adni valamit...Idokozben az AMD elkonyvelhet egy ujabb KO-t. (ahogy az lenni szokott )

![;]](//cdn.rios.hu/dl/s/v1.gif)

[ Szerkesztve ]

If he dies, he dies.

-

Reggie0

félisten

Az elektronikai gyartasban hasznalt rontgent nem meresre, hanem hibahely meghatarozasra hasznaljak, igy meres szempontjabol nem pontos. A legjobb meresi modszer, ha lemarjak a chip tokozasat es mikroszkoppal merik meg.

Amugy az, hogy mekkora a chip es mekkora a chipen felhasznalt terulet ket kulon dolog, ugyhogy tolomerovel felesleges meregetni.

[ Szerkesztve ]

-

Abu85

HÁZIGAZDA

Van fogás az NV-n. Csak felesleges felhozni, mert nem fognak rajta változtatni. Illetve az egész a fejlesztők munkáját akadályozza meg. De ha gondolod olvasd el: [link]

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Baryka007

őstag

válasz

#06658560

#50

üzenetére

#06658560

#50

üzenetére

Én nem tudom... amikor a Simson motorkerékpárom karbi torokátmérőjét 19 mm esre marattam ( most nem írom le miért ) és itthon rámértem tolómérővl 18,8 at mértem a NEM digitális tolómérővel ... 0.2mm volt a tévedés analóg tolómérővel... Na most az nV tudósai speckó eszközökkel ennyit tévednek .... akkor elküldeném őket Trabant Szervizbe dolgozni!

Mindenesetre ( bár AMD párti vagyok ) elhiszem az állításokat amit Abu is írt hogy csak tévedés volt! Viszont ez esetben várom az nVidia szóvivőjének a felszólalását, hogy miképpen magyarázza meg a dolgot!

![;]](//cdn.rios.hu/dl/s/v1.gif)

-

#06658560

törölt tag

válasz

Baryka007

#61

üzenetére

Baryka007

#61

üzenetére

Nem NV mérnökök akik tévednek, hanem akik mérik. Tolómérővel valószínű, nem mérőgéppel. Nálad pedig nem mérési hiba volt kizárólag, hanem gyártási tűrés is. Ugyanannak a tolómérőnek is más a pontossága furat és csap mérése esetén. A többi hibaforrást pedig soroltam már.

-

Locutus

veterán

Azért a célját elérte a cikk... megy a rágódás a gumicsonton... AMD-nek ez biztos jó.

Komplett hangrendszerem eladó - https://hardverapro.hu/apro/mackie_studio_monitorok_mr5mk3_mr10s_mk3_sub_asus/hsz_1-50.html

-

Abu85

HÁZIGAZDA

Azt fontos látni, hogy amióta szorul a hurok a fizikai határok közelítése szempontjából azóta pusztán a csíkszélesség csökkentéséből kevés előny származik. Azért nem vesszük ezt észre, mert amíg régen csak ebből táplálkoztunk, addig ma extrém költséget ölnek a cégek abba, hogy az architektúrát optimalizálják. És igen ez sokfaktoros tényező.

A mostani címekkel azért van javulás, mert a Kepler egy borzalmasan regiszterszegény architektúra. Amikor azt tervezte az NV, akkor arra gondolt, hogy az übershaderek visszaszorulnak, mert túl komplexé válnak ahhoz, hogy reális irányt jelentsenek. Ennek viszont az ellentéte történik, tehát a kevés regiszter hátrányos tényező lett.

A low-level irány mellett kulcsfontosságú a relatíve sok regiszter.Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

stratova

veterán

Köszönöm, a Kepler kontra Maxwell játékosteljesítmény javulásának ezt el is fogadom.

Ami engem meglep, hogy DX11 alatt, 1080P mellett egy AMD címnek számító Thief vagy Tomb Raider alatt is kikap - ha csak kicsivel is -még egy R9 290X is a GTX 970-től és FHD feletti felbontás kell ahhoz, hogy ez a viszony megváltozzon.

Ha jobb hát legyen jobb kérdés, hogy mi miatt. Vagy GTX 780/780Ti 290/290X nincs igazán kihasználva, vagy Maxwellel találtak el nagyon valamit.

Ha pedig csak a textúratömörítés és jobb tesszellálás ennyit jelentene, hasonló javulást egy R9-285X-nél is látnunk kellene, ha lesz belőle 4 GB-os gyorsabb RAM-mal.Szerk.: az elemzésben olvastam, hogy fajlagosan nőtt regiszterek száma/mennyisége, de még nem vetettem össze GCN-nel.

Szerk.2:

Egy CU-n belül továbbra is 64 kB-os helyi adatmegosztás, vagy más néven Local Data Share (LDS) található, melyen a négy darab, egyenként 64 kB-os regiszterterülettel rendelkező SIMD motor osztozik. Az LDS mellett egy 16 kB-os adat gyorsítótár is elérhető, melyet a CU írhat és olvashat is.Az előző bekezdésben már említett skalárfeldolgozó némileg különc a CU-n belül. Ez lényegében egy integer ALU, mely a GCN C.I. hardverekhez képest megduplázott, azaz 8 kB-os dedikált regiszterterületet kapott. A textúrázást CU-nként továbbra is egy blokk oldja meg, mely négy darab, csak szűrt mintákkal visszatérő, Gather4-kompatibilis textúrázó csatornát rejt.

Szerk 3.:

Látom az élsimitásnak is csökkent az erőforrásigénye:

Az MFAA előnye, hogy a kétmintás MSAA teljesítményigényével rendelkezik, de annál jobb munkát végez, noha képminősége nem éri el a négymintás MSAA-t – de nem is ez volt a cél. Hátránya, hogy temporálisan nem stabil, ami azt jelenti, hogy ha a kamera nem mozdul, akkor minden egymás után következő képkocka eredménye valamekkora mértékben eltér.[ Szerkesztve ]

-

Locutus

veterán

A fő ok valszeg az, hogy a sok AMD-s csodafeature a mai napig csak papíron létezik, a játékok nem használják.

Vagy amit használnak, valszeg arra sem igaz a szokásos PR anyag, hogy csak csodaAMD-n megy jól

Komplett hangrendszerem eladó - https://hardverapro.hu/apro/mackie_studio_monitorok_mr5mk3_mr10s_mk3_sub_asus/hsz_1-50.html

-

Dtomka

veterán

"AMD-s csodafeature a mai napig csak papíron létezik" Látszik, hogy Nvidia tulaj vagy...

Ezt cáfolom, mert sokan használják a Mantle-t ...amivel +20 fps simán meglehet BF4 ben. Úgy, hogy 1 mhz et sem kell tuningolni. Nvidia kártyák tudnak ilyet? Nem! Ja igaz ezen a téren le vannak maradva...

[ Szerkesztve ]

-

Locutus

veterán

Az a baj tudod, hogy már a cikk is maga sárdobálás... egy ilyen értelmetlen gumicsontot a nép elé dobni...

Tipikusan olyan érzete van az egésznek, hogy az új maxwellre nem tud mivel válaszolni jelenleg az amd, ráadásul a jóslataik a sötét jövőről is megdőlnek sorban, úgyhogy minden apró kis pr-bullshitbe belekapaszkodnak, és hírverést csinálnak zéró lényegi tartalommal.

Komplett hangrendszerem eladó - https://hardverapro.hu/apro/mackie_studio_monitorok_mr5mk3_mr10s_mk3_sub_asus/hsz_1-50.html

-

Abu85

HÁZIGAZDA

Igazából egyik hardver sincs kihasználva. 40-60% közötti a mai játékok terhelése. Azért vannak ennyire egymás nyakán. Majd ez a DX12-vel teljesen megváltozik. Meg ott az is bejön a képbe, hogy melyik fejlesztő mennyire hatékony low-level kódot ír az egyes architektúrákra.

Az regiszter/ALU szempontjából az AMD GCN 4 kB, az NV Fermi 4 kB, az Intel Gen7.5/8 3,5 kB, az NV Maxwell 2 kB, az NV Kepler 1,33 kB.

Az MFAA-t sok játék nem tudja kihasználni, az inkább külön dolog.

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

De nem akarnak egymás fejlesztéseire válaszolni. Az NVIDIA és az AMD eltérő irányt választott.

Az NV elzárkózik a fejlesztőktől, és nem segítik a munkájukat, illetve nem mondják meg, hogyan kell optimalizálni a hardvereikre, cserébe saját maguk dolgoznak ki effekteket a hardvereikre, amelyeket a fejlesztők beépíthetnek.

Az AMD ezzel szemben nagyon szorosan odaköltözött a fejlesztőkhöz, lesik minden kívánságukat (teljesítik is azokat, bármilyen extrémek, lásd Mantle) és segítik a munkájukat, viszont mindenki magára van utalva a fejlesztésnél, vagyis az effekteket a saját maguknak kell kidolgozni.Ez a piac kettészakadását eredményezi majd, mert szélsőségesen az egyik céghez húznak a stúdiók.

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

stratova

veterán

Értem, köszönöm. Így azt kell feltételeznem, jobb lett a kihasználtság Maxwell esetén. Ha technikai jellegű kérdés jut még eszembe (és nem untatlak

) majd felteszem a teszt témájában.

) majd felteszem a teszt témájában.Locutus Maxwell jelenleg gyorsabb és kevesebbet eszik, ezt szerintem kár is firtatni. Viszont éppen a változatlan gyártástechnológia miatt érdekelt pontosan minek köszönhető ez a komoly fogyasztás+teljesítménybeli ugrás, esetleg minek a kárára.

Hogy AMD-nek van-e mit új hardverként felmutatnia, nos jó kérdés. A szeptember 25-re utaló pirulás képek szerintem GPU-t sejtetnek én R9 285X-re tippelnék (elvégre nemrég futott be a kistesó), kiindulva a korábbi HD 7770 kampányból. A világot szerintem nem fogja megváltani, de remélhetőleg kiegyensúlyozottab lesz az R9 285-nél (esetleg 4 GB 6-7 GHz GDDR5)?

Nekem AMD-nél inkább a True Audio fejlesztés szimpatikus (alapvetően az ilyen kiegészítő szolgáltatások is) de ez nem a játékokban nyújtott teljesítményre hat, ellenben javíthatja a játékélményt. De a konzolokban is alapvetően a mozgással történő irányítás fogott meg.

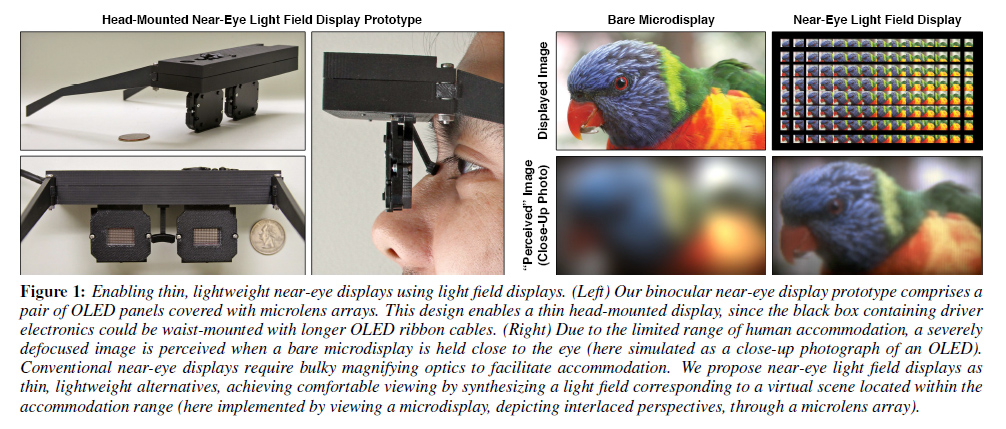

Nvidiánál a Near-Eye Light Field Display tűnt nagyon jó ötletnek.

[ Szerkesztve ]

-

Abu85

HÁZIGAZDA

Ha ez nem érdekli őket, az már fogja, hogy például a Batman: Arkham Knight, The Witcher 3: Wild Hunt, Strife, Project Cars, EVE: Valkyrie, Lords of the Fallen játékokban lesz olyan dolog, amit AMD-n nem lehet bekapcsolni, illetve a Civilization: Beyond Earth, Dragon Age: Inquisition, Star Citizen, Battlefield: Hardline, Star Wars Battlefront, Homefront: The Revolution játékokban pedig lesz olyan dolog, amit NV-n nem lehet bekapcsolni.

Ezen a DX12 sem fog segíteni. Az NV eleve nem örül ennek a low-level iránynak, mert túl kockázatos, hogy a fejlesztőkhöz kerül a kontroll, amikor ők nem tudnak a GeForce hardverekre optimalizálni. Sokan nem is akarnak majd. Egy az egyben áthozzák az Xbox One kódot, mert a DX12 erre lehetőséget ad. Ez nem előnyös a PC-nek.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Az utolsó két hozzászólásodban 5X használtál jövő időt nagyrészt kijelentő módban. Nem lenne egyszerűbb ezeket a dolgokat:

-egyrészt jóslatként kezelni és nem tényként, mert ebben az iparban maximum az a tény ami már megtörtént.

-másrészt a nagyszerű jóslásokat felírni (offline) és majd akkor leközölni őket amikor tényleg aktualitás lesz belőlük.Az olvasók kedélyei sem lennének folyamatosan borulátó jövőképekkel borzolva (amelyeknek mióta a PH-t olvasom igen alacsony a beteljesükési rátája), illetve a jövőben is lenne munició valamiről írni?Arról esetleg van infód, hogy az AMD reálisan mikor tud egy alaposan átdolgozott mikroarchitektúrát piacra dobni jelentősen javított fogyasztás/teljesítmény mutatóval?

-

mzso

veterán

"de nem valószínű, hogy emögött bármilyen félrevezetési szándék állna."

Nem. Hát ez a kifogás, hogy ne lehessen perelni, vagy nyavalyogni. -

Oliverda

félisten

És ezek hiánya mennyiben rontja a játékélményt, illetve az összképet? Sejtésem szerint nem igazán.

Túl van lihegve ez is mint sok minden más.

Majd ha arról lesz szó, hogy xy játék nem indul el NV vagy AMD GPU-n, akkor lehet aggódni.

[ Szerkesztve ]

"Minden negyedik-ötödik magyar funkcionális analfabéta – derült ki a nemzetközi felmérésekből."

-

Abu85

HÁZIGAZDA

Az említett játékokról már tényként közölték, hogy hova tartoznak és azt is, hogy exkluzív gyártói funkciókat kapnak.

Nem akarják átdolgozni. Túl sok idő egy architektúrát a programozók számára mesteri szinten elsajátítani. Viszont a low-level irányban az történik, hogy nem a gyártó fogja írni a grafikus drivert, hanem a fejlesztő fogja működtetni az architektúrát, azaz kvázi egy drivere lesz mindenkinek, maga a program. Minél jobban ismerik a célzott hardvert, annál gyorsabb kódot lehet írni rá. És a GCN-t a konzolból ismerni fogják. Ha ezt leváltják, akkor a konzolból az optimalizálás nem hozható át.

Nem véletlen, hogy lesz DX11.3. Az MS is tudja, hogy a DX12 kódot az Xbox One-ból áthozva mindenkinek rossz lesz az élménye, aki nem GCN C.I.-t használ.Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

Attól függ miről van szó. Például a Civilization: Beyond Earth esetében a felfedezett pályákon a zoom out DX11-ben 10 fps-re csökkenti az átlag sebesség. Akármilyen procit rakhatsz alá ez szoftverből keletkező korlát.

Ugyanaz a probléma, mint itt a StarCraft 2-ben. [link] - sok a draw call és abból kevés dolgozható fel időre.Az extra effektek valószínűleg nem befolyásolják majd az élményt. Maximum a vizuálisat. Ezzel valóban együtt lehet élni.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Abu85

HÁZIGAZDA

válasz

#06658560

#87

üzenetére

#06658560

#87

üzenetére

Igazából nem az AMD az egyedi működésű. Dettó így működik az Intel is, illetve az NV is ugyanígy működött a G80-as időszakban. Persze az igaz, hogy az AMD agresszívebb, mert odatelepülnek pár szoftvermérnökkel a top motorok programozói mellé, és az extrém kívánságaikat is teljesítik a Mantle-ben.

Az NVIDIA oldaláról csak az a gondjuk a top fejlesztőknek, hogy nincs dokumentációjuk, amivel a saját effektjeiket, vagy éppen a DX12-ben a saját rendererbe épített "driverüket" a GeForce-ra optimalizálhatják. Ha ez meglenne, nem lenne semmi gond. A GameWorks nem zavarna senkit, amíg van lehetőség arra, hogy a saját effekteket kigyúrják a GeForce-ra.

Ahogy most működnek annak az az eredménye, hogy xy stúdió szélsőségesen ragaszkodik az egyik gyártóhoz. Ahhoz, amelyik az igényeit teljesíti.[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

SRII

őstag

Azt fontos kiemelni, hogy amíg az AMD új HDL-t használ a Tonga cGPU esetében, tehát az előrelépés várható volt, addig az NVIDIA ebből a szempontból nem változtatott, azaz nem igazán meglepő, hogy a valós mérések szerint maradt a 12,5-12,8 millió tranzisztoros arány négyzetmilliméterenként.

most akkor ez milyen hátrányban befolyásolja a Crysis futtatását?

Légy önmagad! Mindenki más már foglalt!!

-

Az utolsó bekezdésedre reagálva annyit mondanék, hogy ez pl. engem is érdekelne, de ilyesmiről nem lehet itt olvasni, csak a flamegenerátor cikkeket futószalagon.

Egyébként idén, és jövőre még nem. A következő generációs K12 "Zen" legkorábban 2016-ra készül el, így az egész 2015-ös évet a jelenlegi modulos felépítésű egységekkel kell kihúzni.

-

Abu85

HÁZIGAZDA

válasz

antikomcsi

#91

üzenetére

antikomcsi

#91

üzenetére

Már írtam korábban. Új architektúra nem lesz. Nem fogják megtanulni a fejlesztők a működését. Márpedig ez a tényező a low-level API-k érájában komoly, 20-40%-os teljesítménykülönbséget jelent majd.

Hihetetlenül fontos megérteni, hogy a régi modell megszűnt. A programfejlesztés átalakul. Mostantól nem elég, ha a GPU gyártója érti az architektúrát, és ír rá egy hatékony drivert. A programba kell írni a hatékonyságot, mert a driverből az architektúra működtetés eltűnik, egészen pontosan átkerül az alkalmazásba, egy minden egyes architektúrát működtető univerzális "driver" formájában. És nagyon fontos, hogy azt az univerzális "drivert" az alkalmazásban xy architektúrára szabják, ha nem teszik, akkor az sebességvesztést jelent.Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

LordX

veterán

válasz

antikomcsi

#91

üzenetére

antikomcsi

#91

üzenetére

És hogyan viszonyul egy új x86-os (és btw egyszerre ARM-os) processzor mikroarchitektúra a GPU mikroarchitektúrás témához?

-

sayinpety

tag

Megtanuljuk. Dokumentacioval nem lehet problema. Az AMD inkabb attol fel, hogy a studiok nagy szazaleka szamara a PC port az xBox One port par soros kiegeszitese lesz, ami nagyon keves. Csak GCNen fog megfeleluen futni. Amig a PC csak a bevetel 10 szazalekaert felelos addig sok kiado szemeben nem celplatform. Az optimalizalast a ket console fogja kapni, sokkal tobb penz jon belole vissza.

-

Oliverda

félisten

-

Igazad van, sehogy. Ezért off. Meg kicsit be is néztem, aláírom.

Csak én ilyenekről szeretnék olvasni egy szakmai portálon, nem pedig a sehova sem vezető, állandóan feszültséget gerjesztő, tartalmilag üres cikkek közt böngészni. Lassan a vállalhatatlan szintre süllyed ezek miatt a fórum színvonala.

-

sayinpety

tag

Inkabb elony. A GCN egy stabil pont az engine tervezesenel. A low-level code nem csak szabadsag, hanem limit is. Pcn biztosan. Reszemrol a GCNt celzom csak azert mert ott a ket console es remelem, hogy evekig marad PCben is. A ma megirt low-level engine render back-endjere tehat evekig epithetek. Ha jon egy uj microarch, akkor a dragan kifejlesztett engine hatekonysaga romlik rajta. Ujra sok penzt kell befektetni az optimalizalasba. A korabbi engine verzion megjelent programokon az uj microarch teljesitmenye lassu lesz.

Az OpenCL fejlesztok ismerik a codebase portolasanak problemait. A low-level code optimalizalas a celzott microarchra hatekony. Ha a microarch megvaltozik a teljesitmeny lecsokken. A Mantle es a D3D12 ezt a modelt hozza magaval. Negativum lesz PCn, am szerintem az egyeb elonyok megerik az aldozatott. -

Oliverda

félisten

válasz

sayinpety

#98

üzenetére

sayinpety

#98

üzenetére

"Ha jon egy uj microarch, akkor a dragan kifejlesztett engine hatekonysaga romlik rajta. Ujra sok penzt kell befektetni az optimalizalasba."

A sok pénzt gondolom nem az NV-nek vagy az AMD-nek kell befektetni, ergo ők valószínűleg nem aggódnak annyira emiatt.

"Minden negyedik-ötödik magyar funkcionális analfabéta – derült ki a nemzetközi felmérésekből."

-

sayinpety

tag

Az IHVk amiatt aggodnak, hogy mennyivel lassul egy D3D12/Mantle jatek az uj hardwareken. Sok nezopont utkozik most es a valtozas teljesen felboritja az erosorrendet. Meghatarozhatatlanna teszi egy GPU varhato teljesitmenyet. A Microsoft nagyon rosszul kezeli a helyzetet. Tobb xBox One jatekot is bemutattak mar PCn/D3D12n futtatva. Kirpobaltam en is. Valoban mukodik az xBox One code modositas nelkuli futtatasa D3D12n/PCn, am egy GTX 780 nem volt olyan gyors, mint egy R9-270. Teljesen teves azt sugalni a fejlesztoknek, hogy a D3D12vel egyszerubb optimalizalni. Nem egyszerubb csak mas. Kompatibilis az xBox One code, am a teljesitmenyhez tovabbi optimalizalas kell. Az AMD R-series hardwareken az R7-260X jobban teljesit mint az R9-270. Az xBox One code GCN Sea Islands optimalizalas. Southern Islands es Volcanic Islands IPn nem fut olyan hatekonyan. Minden microarch egyedi optimalizalast igenyel.

Az IHVk szamara teljesen uj a helyzet. Kepzeld el a D3D12 VGA testeket. Sok D3D12 jatekot hasznaltok, jon egy 20%kal gyorsabb hardware. Am a tesztekben lassabb lesz a last gen VGAnal a programoptimalizalas hianyaban. Ezt nem lehet jol kommunikalni. Ugy ertelmezem te szakemberkent nem erted meg mennyire fontos a low-level code hatekonysaga, a user hogy ertse meg?

Sokat olvastam a Mantle bemutatokat. Leirta nem egy oldal, hogy a programing model ismert, regota programozunk console hardwaret low-level eleressel. Igaz. Am senki nem irta le, hogy az csak egy microarch, nem 6-7. Nekunk is uj a PCben a low-level. Egy hardwarere nem nehez. A harom GCN IPre sem. Am amint elojonnek az Intel IPk mar sokkal bonyolutabb. nVidia IPket nem is emlitem, dokumentacio nelkul eselyunk sincs optimalizalni rajuk.

Nagyon jot tenne a D3D12nek egy performance portability guide. Ilyen van a Mantlehoz es nagyon hasznos. A Microsoftnak kenyszeriteni kell az IHVket a legfontosabb adatok kiadasara a microarchrol. Dokumentacio nelkul nagyon nehez javitani a sebessegen, fix javulas lehetosege nelkul a kiado nem finanszoroz PC optimalizalast. -

-

Abu85

HÁZIGAZDA

válasz

joysefke

#102

üzenetére

joysefke

#102

üzenetére

Addig biztos nem, amíg a fejlesztők a GCN-t célozzák az optimalizálással. Eleve nincs hova modernizálni. A GCN még mindig többet tud, mint a most befutott Maxwell/GM204. Előbb arra kellene törekedni, hogy ezt a tudást kihasználják a fejlesztők, és ezért született meg a Mantle.

Azzal az AMD nem fog foglalkozni, hogy az NVIDIA az ultramobil piac célzása miatt kevesebb regisztert, kevesebb közvetlen cache-t, megosztott erőforrás-kezelést épít az architektúrába, vagy hogy kihagyják a skalár ALU-t, nem használnak OOO logikát a munkacsoportokra, illetve "dagira" tervezik a multiprocesszorokat, vagy hogy a CUDA magok nem látnak egységes memóriaképet, illetve nincsenek dedikált atomi számlálók. Ezeket okkal építette be az AMD, és nem azért, hogy egy új architektúrában kivegye őket.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

LordX

veterán

válasz

joysefke

#102

üzenetére

joysefke

#102

üzenetére

Javítások ugyanúgy lesznek..

Ez olyan, mint az Intelnél: a Haswellben kb. ugyanaz van, mint az első Core procikban, jópár iteratív fejlesztés után. És kb. ugyanolyan optimalizálni rá. Az új mikroarchitektúrára a példa az Atom vagy az Itanium - nagyon nem ugyanolyan optimalizálni rájuk, mint a Core procikra.

-

Abu85

HÁZIGAZDA

Ja igen. Ha arra vonatkozik a kérdés, akkor modernizálás egy-két évente így is lesz. Most három GCN iteráció van, de már aktívan készül a negyedik.

Ugye az első volt az alap. A másodikban érkezett az egységes memória támogatása, illetve az egységes memóriakép az ALU-k nézőpontjából. A harmadikban jött a preempció elmélyítése, így több programot is hatékonyan futtat a GPU.

Azt is lehet tudni, hogy mik az alapvető tervek: OOO logika elmélyítése, illetve tranzakcionális memóriakezelés beépítése.Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

namaste

tag

válasz

[CS]Blade2

#108

üzenetére

[CS]Blade2

#108

üzenetére

Ha kifejlesztik a gyümölcskosarat az új F.I. (Fruit Islands) architektúrával és nem küldenek kóstolót a játékfejlesztőknek még megjelenés előtt, akkor úgy járnak mint az R9 285-tel.

Új hozzászólás Aktív témák

ph Az NVIDIA 398 mm²-t mond, amit a hétköznapi mérések nem támasztanak alá. De mi az oka ennek?

- Kihívás a középkategóriában: teszten a Radeon RX 7600 XT

- Milyen billentyűzetet vegyek?

- NVIDIA GeForce RTX 4080 /4080S / 4090 (AD103 / 102)

- Microsoft Excel topic

- Fujifilm X

- Renault, Dacia topik

- OLED TV topic

- Építő/felújító topik

- NVIDIA GeForce RTX 3080 / 3090 / Ti (GA102)

- Bambu Lab X1/X1C, P1P-P1S és A1 mini tulajok

- További aktív témák...

- Újszerű - POWERCOLOR Radeon RX 5500 XT 8GB GDDR6 VGA videókártya

- Hibátlan - GIGABYTE GTX 1660Ti Windforce OC 6G 6GB GDDR6 VGA videókártya dobozos

- Hibátlan - PALIT GTX 1650 StormX 4GB GDDR5 VGA videókártya - tápcsatlakozó nélküli !!!

- ASUS ProArt GeForce RTX 4080 SUPER 16GB GDDR6X OC (ASUS-VC-PRO-RT4080S-O16G) Bontatlan új 3 év gar!

- XFX RX 6600 XT SPEEDSTER SWFT 210

És az Intel is trükközik az Ivy-Haswell tranzisztorszámokkal, mert én valahogy nem tudom elhinni, hogy a Haswellben kevesebb van, mint az Ivy-ben. És most már a tranyószám után a lapka mérete sem valós adat, marha jó...

És az Intel is trükközik az Ivy-Haswell tranzisztorszámokkal, mert én valahogy nem tudom elhinni, hogy a Haswellben kevesebb van, mint az Ivy-ben. És most már a tranyószám után a lapka mérete sem valós adat, marha jó...

![;]](http://cdn.rios.hu/dl/s/v1.gif)